收集整理了一份《2024年最新Python全套学习资料》免费送给大家,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上Python知识点,真正体系化!

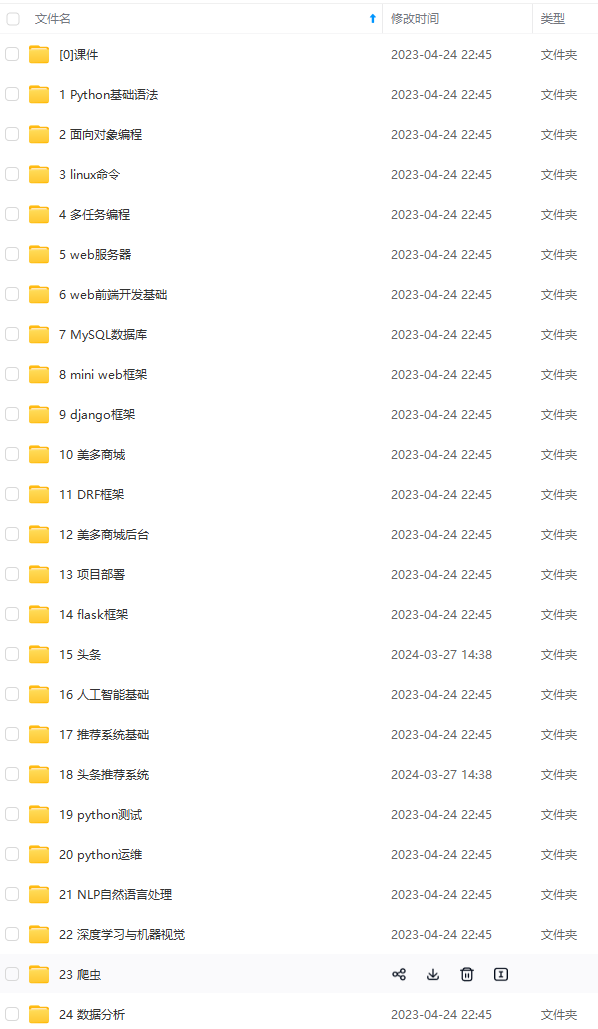

由于文件比较多,这里只是将部分目录截图出来

如果你需要这些资料,可以添加V无偿获取:hxbc188 (备注666)

正文

import pickle

def calcShannoEnt(dataSet):

‘’’

根据一个给定的数据集求香农熵,这里开始没搞懂,后来复习了一下信息论与编码总算是搞明白了

例如这个数据集,我们需要了解的信息是"是否为水生生物",而描述一个信息的信息量的大小是取决于他的不确定度(即这个信息出现的概率)

为什么这么理解,例如,一个生物是水生生物的概率为2/5,即不确定度为2/5,那么当我们知道这个动物属于水生生物时,2/5的不确定度就被消除了,可以理解为消除的不确定度就是我们获得的信息

一个信息所含有的信息量我们用自信息量来衡量,它的

计算公式是I = -log(‘一事件出现的概率’,2),其中2代表对数以2为底,比如这里我们假设是水生生物的概率为2/5,不是水生生物的概率为3/5,那么他们的信息量分别为-log(2/5,2),-log(3/5,2)

熵(这本书上说得是香农熵)其实就是信息的平均不确定度,数值上等于平均信息量,即当我们知道一个动物是水生生物或者不是水生生物所获得的平均信息量,计算公式为

某事件的概率*某事件的自信息量求和,例如是否为水生生物的熵为(2/5)*(-log(2/5,2))+(3/5)*(-log(3/5,2))

信息增益在网上查阅了一些资料也能理解了

例如我们要判断在一群人中一个人的性别是男是女,判断成功的概率为1/2,是男是女事件分别对应的自信息量为1,平均信息量为0.5

而人有如下特点1:是否有喉结,2:头发长短

当我们用特征值1,即有无喉结来划分这一群人,数据集就被我们划分成了两波人,有喉结的人和无喉结的人

当我们在有喉结的人中判断是男人还是女人的时候,判断成功的概率为1,自信息量和平均信息量都是0

信息增益就等于未划分之前的平均信息量-划分之后的平均信息量

简单理解,信息增益就是我们用一个特征(有无喉结)将一个数据集(人类)划分之后,对我们判断某一事物(男人还是女人)的帮助是多大

比如有无喉结和头发长短,基本上有喉结的肯定是男人,而长头发的不一定肯定是女人,那么有无喉结的特征对我们判断性别的信息增益就比头发长短要大

‘’’

numEntries = len(dataSet)

labelCounts = {}

for featVec in dataSet:

currentLabel = featVec[-1]

if currentLabel not in labelCounts.keys():

labelCounts[currentLabel] = 0

labelCounts[currentLabel] += 1

shannonEnt = 0.0

for key in labelCounts:

prob = float(labelCounts[key])/numEntries

shannonEnt -= prob*log(prob,2)

return shannonEnt

def splitDataSet(dataSet,axis,value):

‘’’

根据给定的数据集,划分数据集的特征,特征的返回值来划分数据集

‘’’

returnSet = []

for featVec in dataSet:

if featVec[axis] == value:

reducedFeatVec = featVec[:axis]

reducedFeatVec.extend(featVec[axis+1:])

returnSet.append(reducedFeatVec)

return returnSet

def createTestSet():

dataSet = [[1,1,‘yes’],

[1,1,‘yes’],

[1,0,‘no’ ],

[0,1,‘no’ ],

[0,1,‘no’ ]]

labels = [‘no surfacing’,‘flippers’]

return dataSet,labels

def chooseBestFeatureToSplit(dataSet):

‘’’

选择最好的划分特征,即最大的信息增益

‘’’

numFeatures = len(dataSet[0]) - 1

baseEntropy = calcShannoEnt(dataSet)

bestInfoGain = 0.0

bestFeature = -1

for i in range(numFeatures):

featList = [example[i] for example in dataSet]

#value去重

uniqueVals = set(featList)

newEntropy = 0.0

for value in uniqueVals:

subDataSet = splitDataSet(dataSet,i,value)

prob = len(subDataSet)/float(len(dataSet))

newEntropy += prob * calcShannoEnt(subDataSet)

infoGain = baseEntropy - newEntropy

if infoGain > bestInfoGain:

bestInfoGain = infoGain

bestFeature = i

return bestFeature

def majorityCnt(classList):

‘’’

在一个列表中返回最多的值

‘’’

classCount = {}

for vote in classList:

if vote not in classCount.keys():

classCount[vote] = 0

classCount[vote] += 1

sortedClassCount = sorted(classCount.item(),key = operator.itemgetter(1),reverse = True)

return sortedClassCount[0][0]

def createTree(dataSet,labels):

‘’’

构建决策树

决策树递归过程:开始一直无法理解迭代过程中有一个if-return语句,如果直接满足条件不是直接会退出程序吗?

在网上找到一个非常好的答案帮我解决了这个问题,一句话就是return之前需要将程序运行完毕,例如如下函数

def fact(n):

if n==1:

return 1

return n * fact(n - 1)

迭代过程如下:

===> fact(5)

===> 5 * fact(4)

===> 5 * (4 * fact(3))

===> 5 * (4 * (3 * fact(2)))

===> 5 * (4 * (3 * (2 * fact(1))))

在return之前,n * fact(n - 1)必须要计算完毕

本程序中的createTree(dataSet,labels)函数与之类似,在return之前,myTree[bestFeatLabel][value] = createTree(splitDataSet(dataSet,bestFeat,value),subLabels)必须计算完毕

设dataSet为create为:

[[1,1,‘yes’], lebels为[‘no surfacing’,‘flippers’]

[1,1,‘yes’],

[1,0,‘no’ ],

[0,1,‘no’ ],

[0,1,‘no’ ]]

第一次迭代有两个分支1:MyTree[‘no surfacing’][0] = createTree([[1,‘no’],[1,‘no’])

2:MyTree[‘no surfacing’][1] = createTree([[1,‘yes’],[1,‘yes’],[0,‘no’])

分支1进入一次迭代直接满足条件classList.count(classList[0]) == len(classList),直接等于’no’

分支2进入一次迭代后有两个分支2_1:MyTree[‘no surfacing’][1][‘flippers’][0] = createTree([[‘no’]])

2_1:MyTree[‘no surfacing’][1][‘flippers’][1] = createTree([[‘yes’],['yes]])

2_1,2_2满足第一条语,2_1返回’no’,2_2返回’yes’,最后计算结果

MyTree[‘no surfacing’][0] = ‘no’

MyTree[‘no surfacing’][1][‘flippers’][0] = ‘no’

MyTree[‘no surfacing’][1][‘flippers’][1] = ‘yes’

即{‘no surfacing’{0:‘no’,1:{‘flippers’:{0:‘no’,1:‘yes’}}}}

一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、Python必备开发工具

工具都帮大家整理好了,安装就可直接上手!

三、最新Python学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、Python视频合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试宝典

简历模板

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

如果你需要这些资料,可以添加V无偿获取:hxbc188 (备注666)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

g-blog.csdnimg.cn/646863996ac44da8af500c049bb72fbd.png#pic_center)

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

如果你需要这些资料,可以添加V无偿获取:hxbc188 (备注666)

[外链图片转存中…(img-GSXVtObX-1713850741353)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?