lab.grid(row=0,column=0)

#输入框组件

entry = Entry(window,font=(‘隶书’,20),width=20)

entry.grid(row=0,column=1)

#搜索按钮

btn = Button(window,text=‘搜索’,font=(‘隶书’,15),width=20,command=get_music_list)

btn.grid(row=0,column=2)

#列表框 #可以设置多选,selectmode=MULTIPLE

listbox = Listbox(window,font=(‘隶书’,16),width=45,heigh=15)

listbox.grid(row=1,columnspan=2)

listbox_1 = Listbox(window,font=(‘隶书’,16),width=35,heigh=15)

listbox_1.grid(row=1,column=2)

#下载按钮

btn_1 = Button(window,text=‘开始下载’,font=(‘隶书’,15),command=get_music_url)

btn_1.grid(row=2,column=0)

#退出按钮

btn_2 = Button(window,text=‘退出程序’,font=(‘隶书’,15),command=window.quit)

btn_2.grid(row=2,column=2)

消息循环显示界面

window.mainloop()

代码中的cammand用来绑定后端函数。

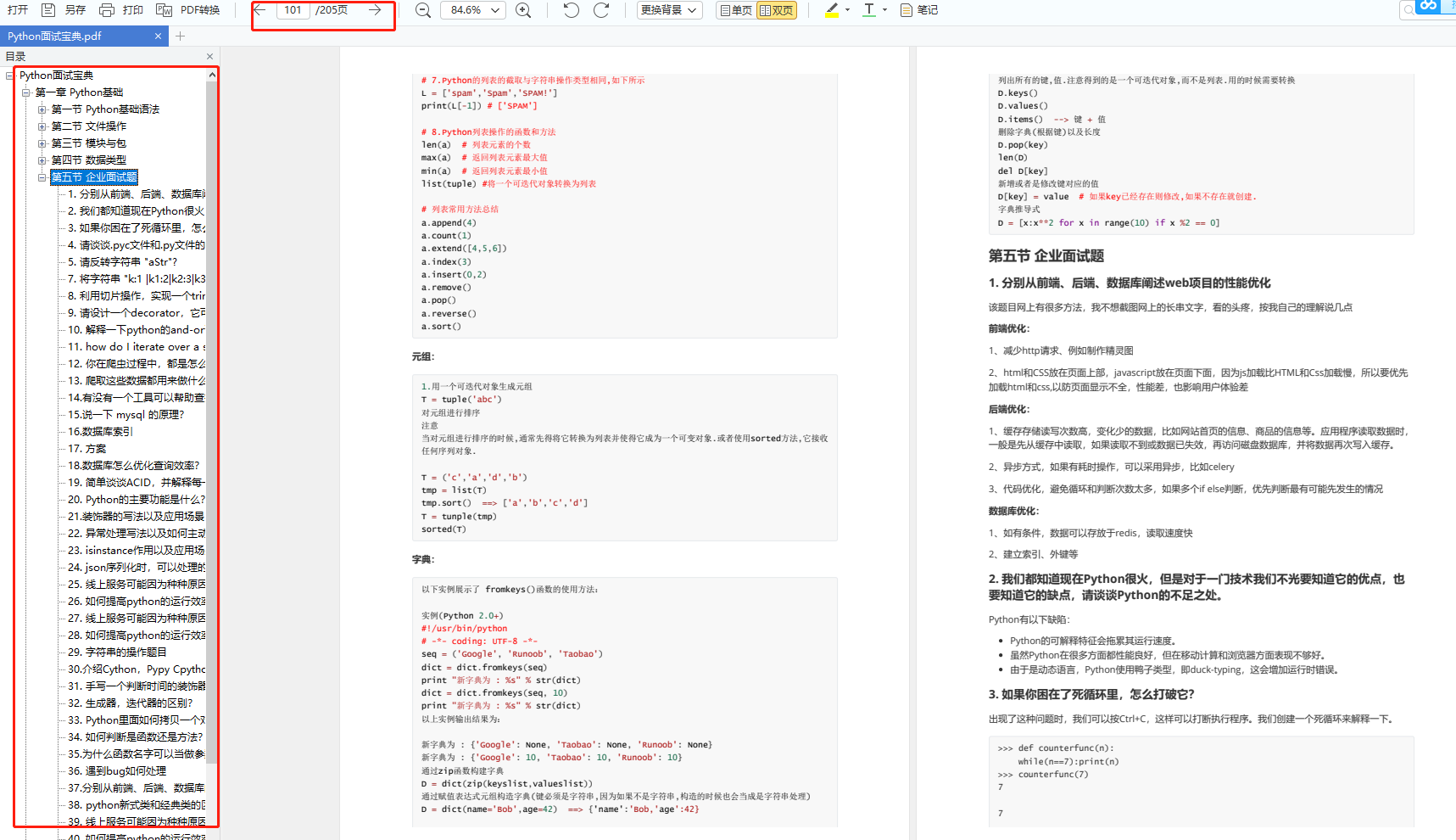

这一块代码用于实现可视化与用户交互,这一块我不多说,大家自行学习python 自带的tkinter模块就可以实现,效果如图所示

(二)后端模块

1.分析

进入酷我音乐网站

我们先将这些歌曲名称先爬取下来,然后添加到前端列表框中

具体函数如下

#获取音乐搜索列表的函数

def get_music_list():

#获取前端搜索框中输入的内容

name = entry.get()

#下一次搜索的时候清空列表框用于显示新的歌单

listbox.delete(0, END)

#循环加载三页音乐

for k in range(1,4):

url = ‘http://www.kuwo.cn/api/www/search/searchMusicBykeyWord?’

data = {

‘key’: name,

‘pn’: k,

‘rn’: ‘30’,

‘httpsStatus’: ‘1’,

‘reqId’: ‘161cbd51-cde1-11eb-bf58-bba623268fbb’

}

response = requests.get(url=url,headers=headers,params=data,proxies=proxy).text

dic_data = json.loads(response)

list_data = dic_data[‘data’][‘list’]

#listbox.delete(0,END)

for i in list_data:

music_name = i[‘name’]+‘-’+i[‘artist’]

#在列表框中插入音乐名称

listbox.insert(END, music_name)

music_id = i[‘rid’]

list_1.append(music_id)

至此,音乐列表就添加到了列表框,注意我们将所有音乐的rid添加到了list_1的列表中,每个rid的索引跟列表框中的音乐名称索引是相对应的,这是实现点击相应歌曲下载的关键。然后我们需要实现点击下载的功能。

具体函数如下

#解析音乐url的函数

def get_music_url():

index = listbox.curselection() #返回选取的索引,是一个元组

for i in index:

music_name = listbox.get(i)

listbox_1.insert(END, music_name + ’ 开始下载’)

url = ‘http://www.kuwo.cn/url?format=mp3&rid={}&response=url&type=convert_url3&br=128kmp3&from=web&t=1616159211200&httpsStatus=1&reqId=f8586c01-88b3-11eb-b442-d7b57b6d2564’.format(list_1[i])

music_data = requests.get(url=url,headers=headers,proxies=proxy).text

#print(music_data)

e = ‘{“code”: 200, “msg”: “success”, “url”: “(.*?)”}’

music_url = re.findall(e, music_data, re.S)[0]

#print(music_url)

download_music(music_url,music_name)

最后下载保存。

具体函数如下

#在当前目录创建文件夹,用于存放下载的音乐

if not os.path.exists(‘酷我音乐’):

os.mkdir(‘酷我音乐’)

#下载音乐并且保存的函数

def download_music(url,music_name):

music_name = music_name+“.mp3”

music = requests.get(url=url,proxies=proxy).content

path = ‘酷我音乐/’ + music_name

with open(path, ‘wb’) as fp:

fp.write(music)

listbox_1.insert(END, music_name+’ 下载完成!')

同时,我们在用python写爬虫时会被反爬,下列代码为反反爬措施

#ip代理池

ip = [‘{“HTTP”:“175.42.129.105”}’,‘{“HTTP”:“121.232.148.97”}’,‘{“HTTP”:“121.232.148.72”}’]

proxy = random.choice(ip)

proxy = json.loads(proxy)

#反反爬headers

headers = {

‘User - Agent’: ‘Mozilla/5.0(Windows NT 10.0;WOW64)AppleWebKit/537.36(KHTML,likeGecko)Chrome/90.0.4430.85Safari/537.36’,

‘Referer’: ‘http://www.kuwo.cn/search/list?key=%E7%83%AD%E7%88%B1105%C2%B0C%E7%9A%84%E4%BD%A0’,

‘csrf’: ‘0BXQD7I99LN’,

‘Cookie’: ‘’,

}

这里的cookie是保持你的登录状态的,相当于验证你的身份,写上你自己的即可。

这里的csrf与cookie写你自己的就行,源代码中我会空着,注意修改。还有,复制cookie之前先在网站登录,cookie会记录你的登录状态,不登录不行哦

这里的cookie和csrf在第一次请求的header中,如下图

代码在这,拿走不谢~~~

import requests

import random

import json

import re

import os

import tkinter

from tkinter import *

list_1 = [] #放置音乐rid的列表

#ip代理池

ip = [‘{“HTTP”:“175.42.129.105”}’,‘{“HTTP”:“121.232.148.97”}’,‘{“HTTP”:“121.232.148.72”}’]

proxy = random.choice(ip)

proxy = json.loads(proxy)

#反反爬headers

headers = {

‘User - Agent’: ‘Mozilla/5.0(Windows NT 10.0;WOW64)AppleWebKit/537.36(KHTML,likeGecko)Chrome/90.0.4430.85Safari/537.36’,

‘Referer’: ‘http://www.kuwo.cn/search/list?key=%E7%83%AD%E7%88%B1105%C2%B0C%E7%9A%84%E4%BD%A0’,

‘csrf’: ‘’, #填你的

‘Cookie’: ‘’, #填你的

}

#在当前目录创建文件夹,用于存放下载的音乐

if not os.path.exists(‘酷我音乐’):

os.mkdir(‘酷我音乐’)

#下载音乐并且保存的函数

def download_music(url,music_name):

music_name = music_name+“.mp3”

music = requests.get(url=url,proxies=proxy).content

path = ‘酷我音乐/’ + music_name

with open(path, ‘wb’) as fp:

fp.write(music)

listbox_1.insert(END, music_name+’ 下载完成!')

#解析音乐url的函数

def get_music_url():

index = listbox.curselection() #返回选取的索引,是一个元组

for i in index:

文末有福利领取哦~

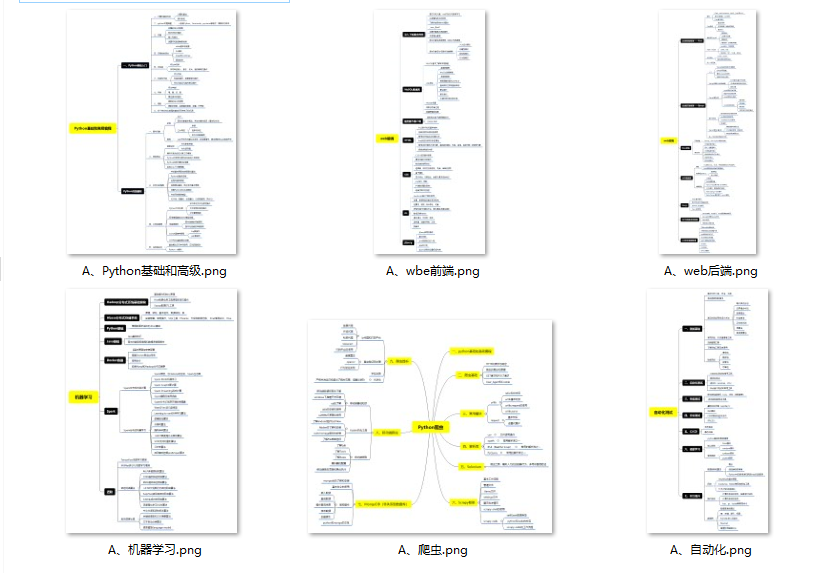

👉一、Python所有方向的学习路线

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉二、Python必备开发工具

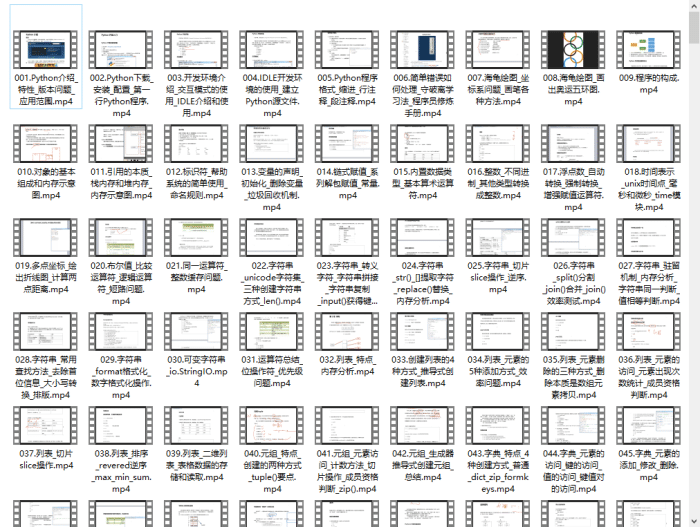

👉三、Python视频合集

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

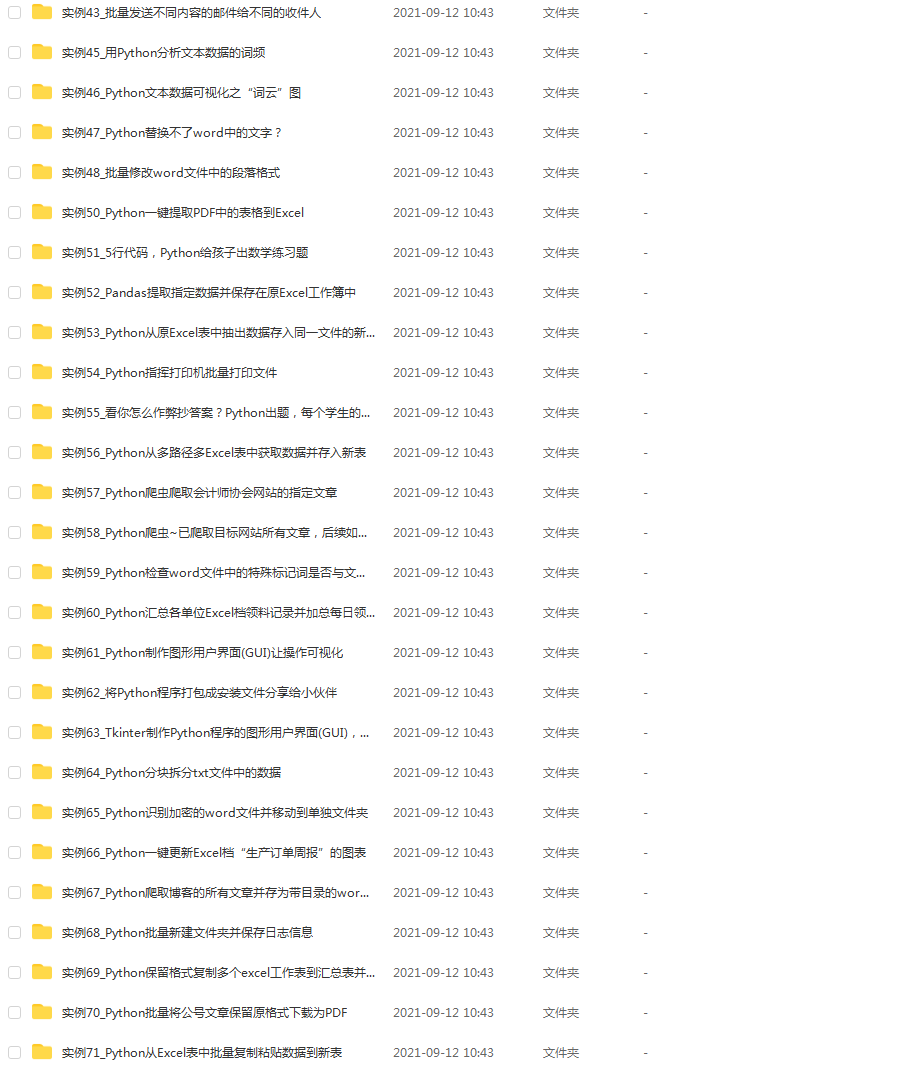

👉 四、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。(文末领读者福利)

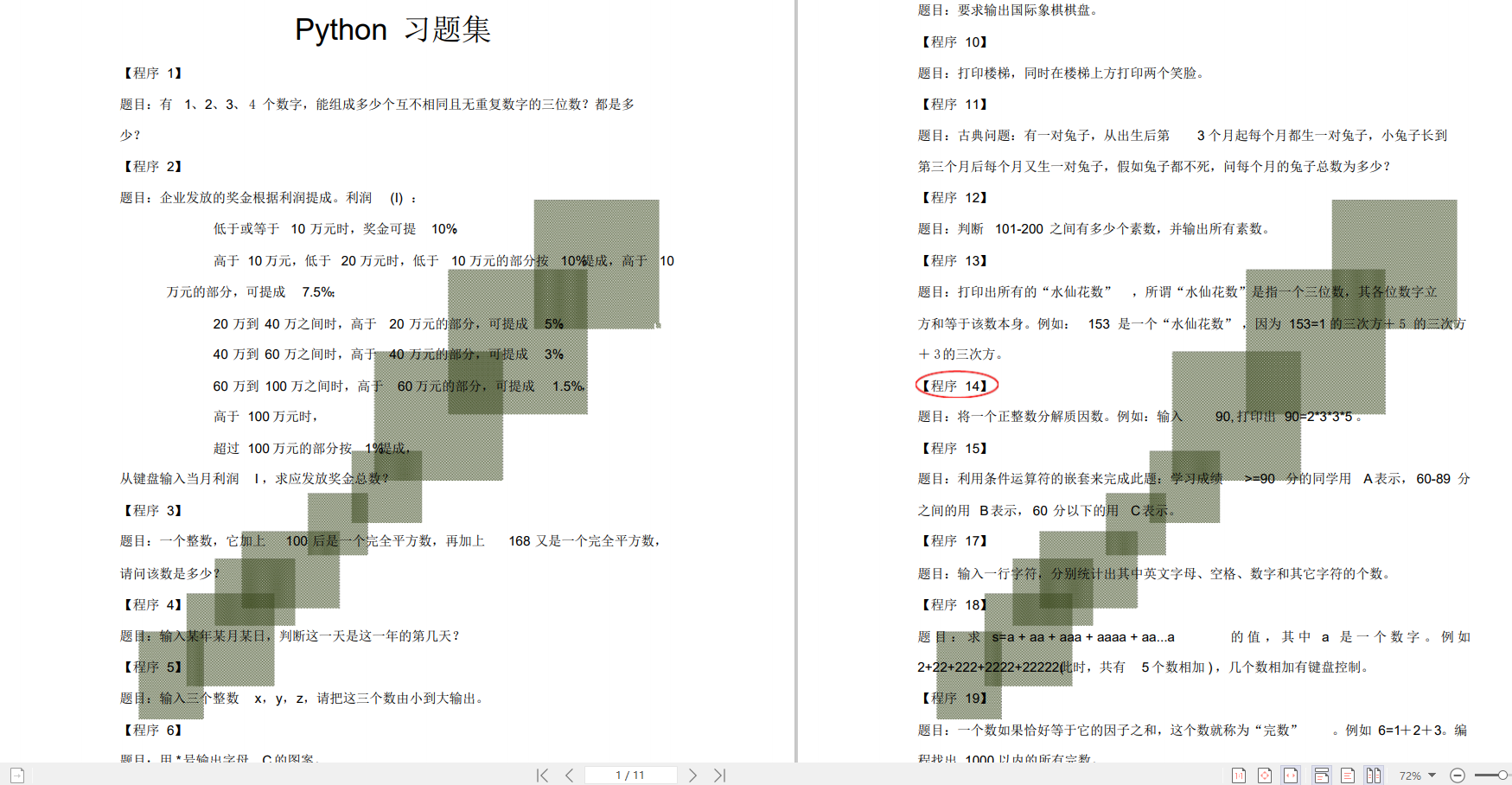

👉五、Python练习题

检查学习结果。

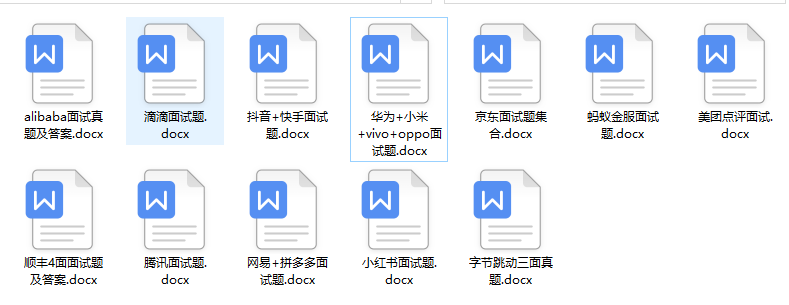

👉六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

👉因篇幅有限,仅展示部分资料,这份完整版的Python全套学习资料已经上传

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

5411

5411

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?