最后

Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习 Python 门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

👉Python所有方向的学习路线👈

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉Python必备开发工具👈

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

👉Python全套学习视频👈

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

👉实战案例👈

学python就与学数学一样,是不能只看书不做题的,直接看步骤和答案会让人误以为自己全都掌握了,但是碰到生题的时候还是会一筹莫展。

因此在学习python的过程中一定要记得多动手写代码,教程只需要看一两遍即可。

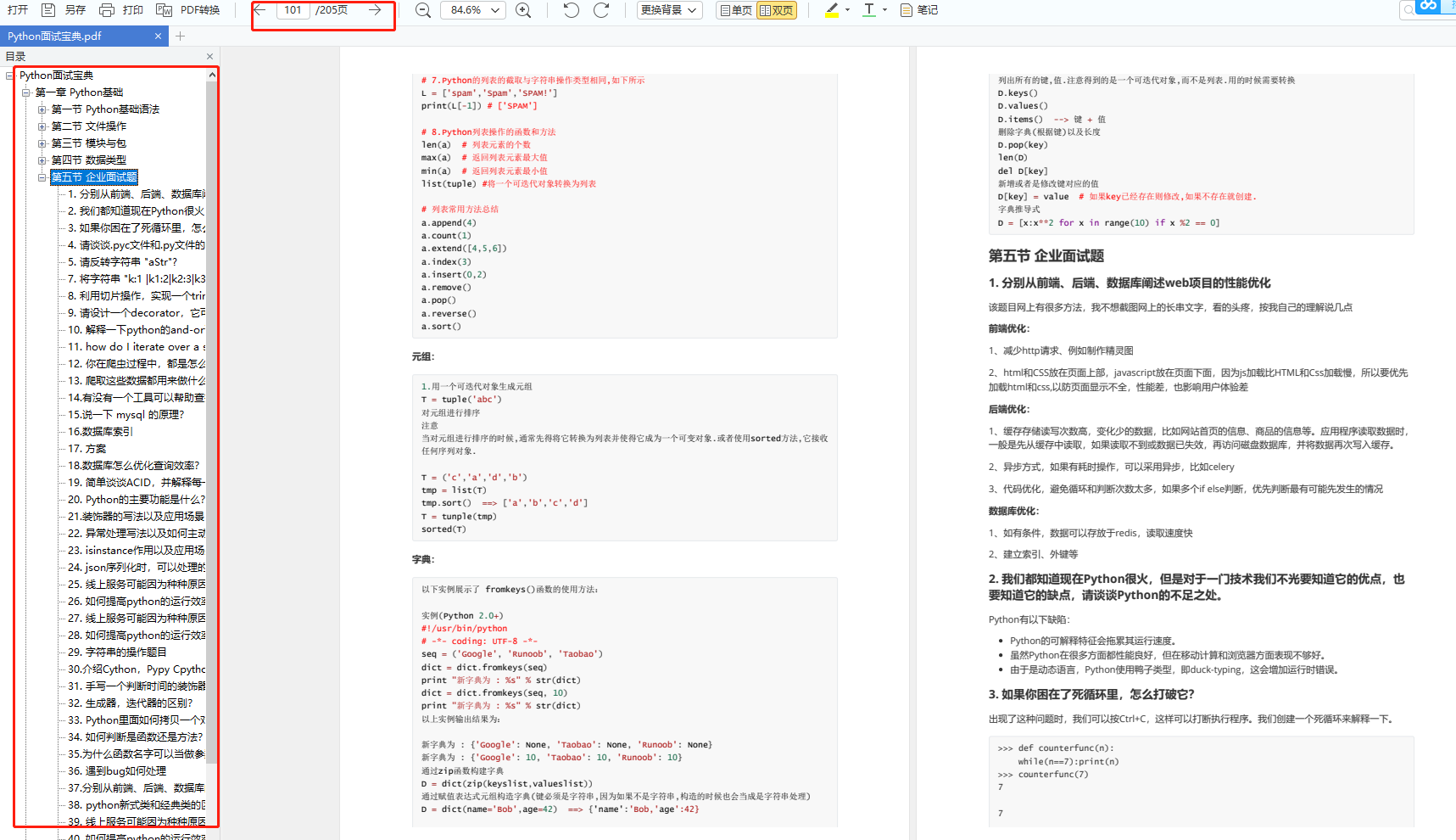

👉大厂面试真题👈

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

点击上图的链接,我们就可以看到按照月份重新排版的朋友圈数据,如下图所示:

至此,我们拿到朋友圈的数据入口——【出书啦】排版生成的微信书链接。

写过爬虫的,后面就可以直接略过了。

当然,没写过爬虫也不想动手的,也可以把【出书啦】生成的微信书链接留言或私信给我,我帮你获取年度关键词。

3.环境准备

本文所写爬虫基于python2.7 + scrapy + jieba + wordcloud,使用VS Code IDE。

4.生成爬虫项目

第一步:命令行执行scrapy startproject weixin_moment,生成Scrapy爬虫项目。

第二步:进入创建的weixin_moment目录,执行scrapy genspider 'moment' 'chushu.la'创建朋友圈爬虫。

执行以上两步后的文件夹结构如下:

5.分析数据源

数据的准确抓取,需要对数据源进行准确分析。这一步我们就要来分析【出书啦】生成的微信书链接的数据加载方式。老规矩,F12开发者工具用起来。

从上图我们可以看出这是一个get请求,返回的json类型格式数据。

点击Preview页签可以看到如下图所示的数据:

从图中可以看到返回的目录导航数据包,其数据是按月份进行加载的。当点击导航按钮,其加载对应月份的朋友圈数据。

我们点击【2014-3】再观察网络请求,发现如下请求:

从以上数据我们可以明细看出,其采用的是用json传参的post的方式请求数据包。点击Preview页签,看到返回的分页JSON数据包。

展开某个节点,我们可以发现朋友圈数据藏在data/paras节点下。

至此,我们完成数据的来源分析。

6.蜘蛛来也

完成了数据源分析,我们只需构造数据请求,并进行正确的数据解析,即可拿到我们想要的数据!

6.1.请求导航数据包

修改moment.py定义start_requests方法:

bookid = '12345678' #请填写【出书啦】返回链接中的数字部分

def start_requests(self):

"""

使用get方式请求导航数据包

"""

url = 'http://chushu.la/api/book/chushula-{0}?isAjax=1'.format(self.bookid) #获取目录的url

yield scrapy.Request(url, callback=self.parse)

重载parse方法,解析获取到的导航数据包:

def parse(self, response):

"""

处理获取到的导航数据包

"""

json_body = json.loads(response.body) #加载json数据包

catalogs = json_body['book']['catalogs'] #获取json中的目录数据包

6.2. 发送导航请求,抓取朋友圈数据

根据上面跟踪到发出的http导航请求,要想抓取到朋友圈数据,我们需要根据发出的请求参数构造参数。

从上图可知,主要包含五个参数:

- type:"year_month"为默认值

- year: 年份

- month: 月份

- index: 第几页

- value : 由年月拼接的字符串

继续修改我们的parse方法,遍历我们第一步抓取到的导航数据包构造请求参数:

def parse(self, response):

"""

处理获取到的导航数据包

"""

json_body = json.loads(response.body) #加载json数据包

catalogs = json_body['book']['catalogs'] #获取json中的目录数据包

url = 'http://chushu.la/api/book/wx/chushula-{0}/pages?isAjax=1'.format(self.bookid) #分页数据url

start_page = int(catalogs[0]['month']) #获取起始月份作为index传值

for catalog in catalogs:

year = catalog['year']

month = catalog['month']

formdata = {

"type": 'year_month',

"year": year,

"month": month,

"index": str(start_page),

"value": 'v_{0}{1}'.format(year, month)

}

start_page += 1

因为从我们跟踪到的http请求来看是基于json传参的post请求:

所以我们要这样发起请求:

yield scrapy.Request(

url,

method='POST',

body=json.dumps(formdata),

headers={'Content-Type': 'application/json'},

callback=self.parse_moment)

同样我们需要定义一个回调函数用来处理返回的朋友圈数据。定义parse_moment方法,根据返回的json数据包进行数据提取:

def parse_moment(self, response):

"""

朋友圈数据处理

"""

json_body = json.loads(response.body)

pages = json_body['pages']

pattern = re.compile(u"[\u4e00-\u9fa5]+") #匹配中文

item = WeixinMomentItem()

for page in pages:

if (page['type'] == "weixin_moment_page"):# 仅抓取朋友圈分页数据

paras = page['data']['paras']

if paras:

moment = ''

for content in paras[0]['rows']:

result = re.findall(pattern,

content['data']) #使用正则匹配所有中文朋友圈

moment += ''.join(result)

item['moment'] = moment

item['date'] = page['data']['dateText']#获取时间

yield item

以上用到了定义的WeixinMomentItem。修改items.py,做如下修改:

class WeixinMomentItem(scrapy.Item):

"""

朋友圈Item

"""

# define the fields for your item here like:

# name = scrapy.Field()

date = scrapy.Field() #日期

moment = scrapy.Field() #朋友圈文字

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

### 一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

### 二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

### 三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

### 四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

### 五、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

### 六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4304bb5a486d4c3ab8389e65ecb71ac0)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

mg-blog.csdnimg.cn/img_convert/d2d978bb523c810abca3abe69e09bc1a.png)

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4304bb5a486d4c3ab8389e65ecb71ac0)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?