先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前在阿里

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

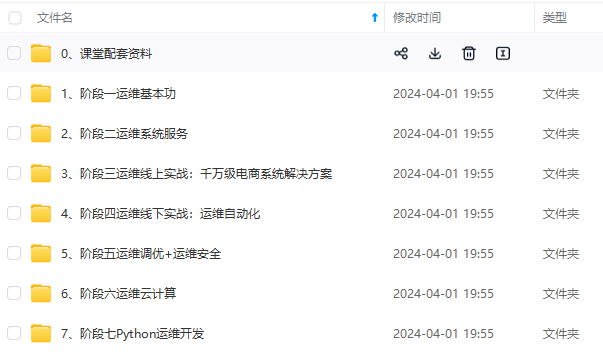

因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

1、创建rbd使用的pool

#32 32: PG数和PGP数(PG内包含的对象);PG会随着容量的增加也会动态的扩容;生产上需要提前规划好数量

ceph osd pool create rbd 32 32

#给rbd使用的pool标识成rbd

ceph osd pool application enable rbd rbd

#查看rbd的pool

[root@cephnode01 my-cluster]# ceph osd pool ls detail

pool 5 'rbd' replicated size 3 min_size 2 crush_rule 0 object_hash rjenkins pg_num 32 pgp_num 32 autoscale_mode warn last_change 68 flags hashpspool stripe_width 0

2、创建一个10G的块设备

rbd create --size 10240 image01

3、查看块设备

rbd ls

rbd info image01

rados -p rbd ls --all

4、禁用当前系统内核不支持的feature

rbd feature disable image01 exclusive-lock, object-map, fast-diff, deep-flatten

5、将块设备映射到系统内核

rbd map image01

rbd showmapped

6、格式化块设备镜像

mkfs.xfs /dev/rbd0

7、mount到本地

mount /dev/rbd0 /mnt

8、创建文件并查看

[root@cephnode01 my-cluster]# touch /mnt/{a..g}lcx.txt

[root@cephnode01 my-cluster]# rados -p rbd ls --all

rbd_data.28209e4598ff7.0000000000000500

rbd_id.image01

rbd_header.28209e4598ff7

rbd_data.28209e4598ff7.0000000000000820

rbd_directory

rbd_data.28209e4598ff7.0000000000000460

rbd_data.28209e4598ff7.00000000000006e0

rbd_info

rbd_data.28209e4598ff7.00000000000000a0

rbd_data.28209e4598ff7.00000000000009ff

rbd_data.28209e4598ff7.00000000000005a0

rbd_data.28209e4598ff7.0000000000000000

rbd_data.28209e4598ff7.0000000000000780

...

9、取消块设备和内核映射

umount /mnt

rbd unmap image01

10、删除RBD块设备

rbd rm image01

如果想在其他机器上使用ceph块设备需要下载ceph-common客户端

3.2 快照配置

快照会占用集群很大的空间,建议对重要的块定期拍摄快照;或者用其他方法进行备份

1、创建快照

rbd create --size 10240 image02

#前面是rbd的名称,后面是快照的名称

rbd snap create image02@image02_snap01

2、列出创建的快照

rbd snap list image02

或

rbd ls -l

3、查看快照详细信息

rbd info image02@image02_snap01

4、克隆快照(快照必须处于被保护状态才能被克隆;就是不能对快照做任何的操作)

#创建一个克隆的pool

ceph osd pool create kube 16 16

ceph osd pool application enable kube kube

#克隆

rbd snap protect image02@image02_snap01

rbd clone rbd/image02@image02_snap01 kube/image02_clone01

#查看kube的pool中的快照

rbd ls -p kube

image02_clone01

5、查看快照的命令children(可以查看哪个是子快照)

rbd children image02

6、去掉快照的parent(去掉克隆的块关系;就是成为了独立的快照)

rbd flatten kube/image02_clone01

7、恢复快照

rbd snap rollback image02@image02_snap01

8、删除快照

#先取消保护

rbd snap unprotect image02@image02_snap01

rbd snap remove image02@image02_snap01

3.3 导出导入RBD镜像

1、导出RBD镜像

rbd export image02 /tmp/image02

ll -h /tmp/image02

-rw-r--r-- 1 root root 10G May 7 11:36 /tmp/image02

2、导入RBD镜像

#可以删除掉原理的镜像

rbd remove image02

rbd import /tmp/image02 rbd/image02 --image-format 2

3、查看导入的rbd

rbd ls

rbd info image02

更新所有节点的配置文件的命令

ceph-deploy --overwrite-conf config push cephnode01 cephnode02 cephnode03

启动所有守护进程

systemctl start ceph.target

3.4 扩容

扩容对数据没有影响

1、使用命令rbd resize进行扩容

#image02为10G

[root@cephnode01 my-cluster]# rbd ls

image02

2、扩容到20G

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

#image02为10G

[root@cephnode01 my-cluster]# rbd ls

image02

2、扩容到20G

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化的资料的朋友,可以点击这里获取!](https://bbs.csdn.net/topics/618635766)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

446

446

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?