mkdir -p /data/elk/kibana/data

tar xf kibana-8.2.2-linux-x86_64.tar.gz && cp -r kibana-8.2.2/* /data/elk/kibana/data/

(3)修改配置

cat > kibana.yml <<EOF

#汉化

i18n.locale: "zh-CN"

#kibana监听端口

server.port: 5601

#默认内外网都可以访问

server.host: "0.0.0.0"

#es访问地址

elasticsearch.hosts: ["http://localhost:9200"]

kibana.index: ".kibana"

#加密设置

#Elasticsearch.username:””

#Elasticsearch.password:””

EOF

(4)启动并访问

./bin/kibana --allow-root &

浏览器访问IP:5601

3、Logstash

(1)下载地址

https://artifacts.elastic.co/downloads/logstash/logstash-8.2.2-linux-x86_64.tar.gz

(2)上传并解压

mkdir -p /data/elk/logstash/data

tar xf kibana-8.2.2-linux-x86_64.tar.gz && cp -r logstash-8.2.2/* /data/elk/logstash/data/

(3)修改配置

#重新编写配置

cat > logstash.conf <<EOF

#接收数据

input {

beats {

#监听地址

host => '0.0.0.0'

#端口

port => 5044

}

}

#处理数据

filter {

#按需添加过滤器规则来处理和转换数据

}

#推送数据到es

output {

elasticsearch {

hosts => ["http://http://172.17.212.101:9200"]

#索引名

index => "%{[@metadata][beat]}-%{[@metadata][version]}-%{+YYYY.MM.dd}"

#用户认证

#user => "elastic"

#password => "changeme"

}

}

#推送数据到本地输出(测试使用)

#output {

# stdout {

# #ruby格式输出

# codec => rubydebug

# }

#}

EOF

(4)启动测试

- 手动测试,手动输入数据并回车:

./bin/logstash -e "input { stdin { type => stdin } } output { stdout { codec => rubydebug } }"

- 基于配置文件测试:

nohup ./bin/logstash -f /data/elk/logstash/data/config/logstash.conf >/dev/null 2>&1 &

4、Filebeat

(1)下载地址

https://artifacts.elastic.co/downloads/beats/filebeat/filebeat-8.2.2-linux-x86_64.tar.gz

(2)上传并解压

#创建存放目录并解压安装包

mkdir -p /data/elk/logstash/data

tar xf filebeat-8.2.2-linux-x86_64.tar.gz && cp -r filebeat-8.2.2-linux-x86_64/* /data/elk/filebeat/data/

(3)修改配置

cat > filebeat.yml <<EOF

#收集数据

filebeat.inputs:

#定义要收集的文件类型(type)

- type: log

#启用

enabled: true

paths:

#日志路径

- /var/log/messages*

#自定义字段

fields:

type: messages

ip: 172.17.212.103

fields_under_root: true

#索引名

log_source: messages

#推送数据

output.logstash:

#logstash地址

hosts: ["172.17.212.102:5044"]

EOF

(4)启动

./filebeat -e -c filebeat.yml &

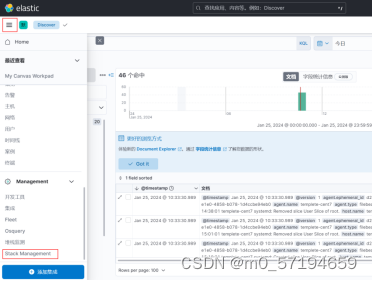

三、web展示

- 数据传入成功后需在web界面配置索引模板进行展示。

(1)登录web界面点击右上角三杠—>下滑点击Stack Management

(2)右上角三杠—>下滑点击数据视图—>创建视图

(3)输入索引名称,选择时间戳字段,右边会显示推送的源数据

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

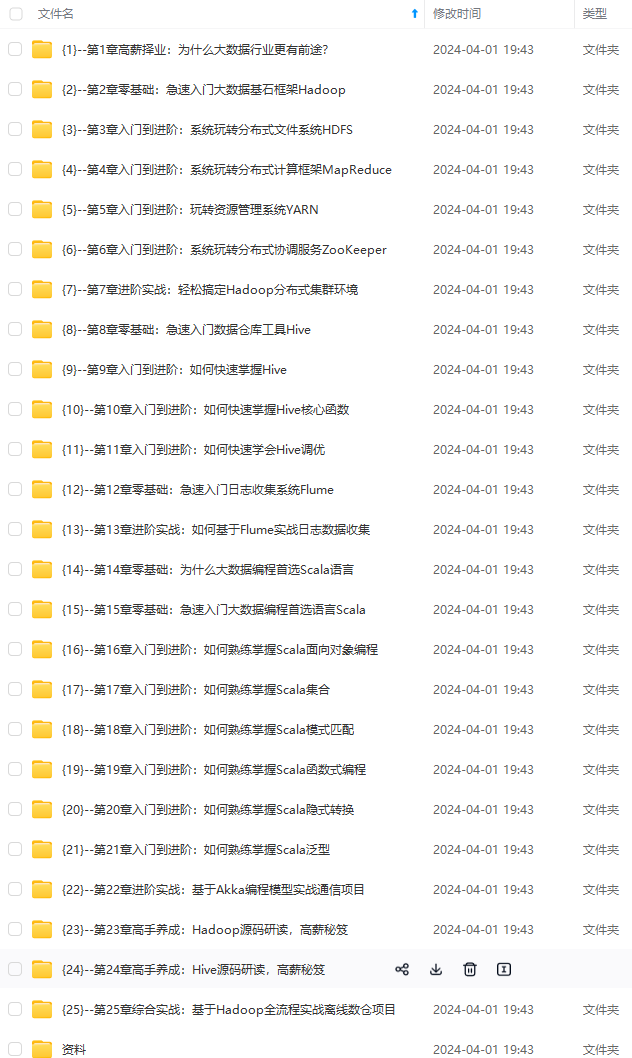

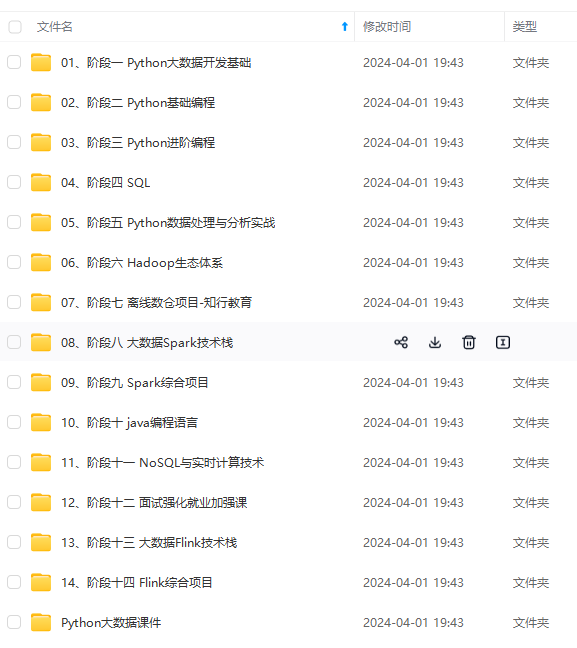

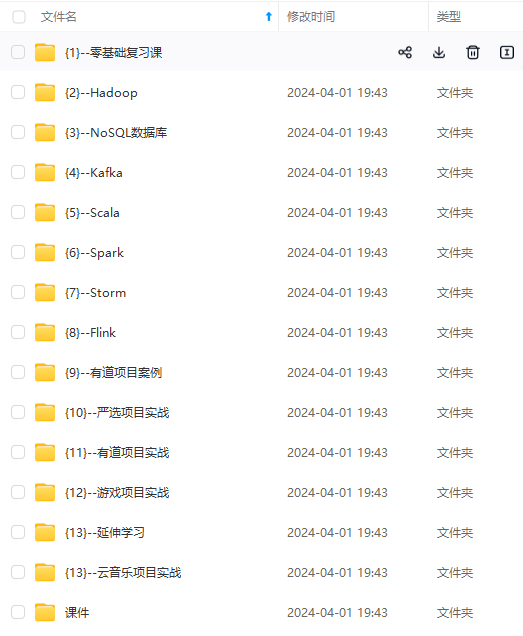

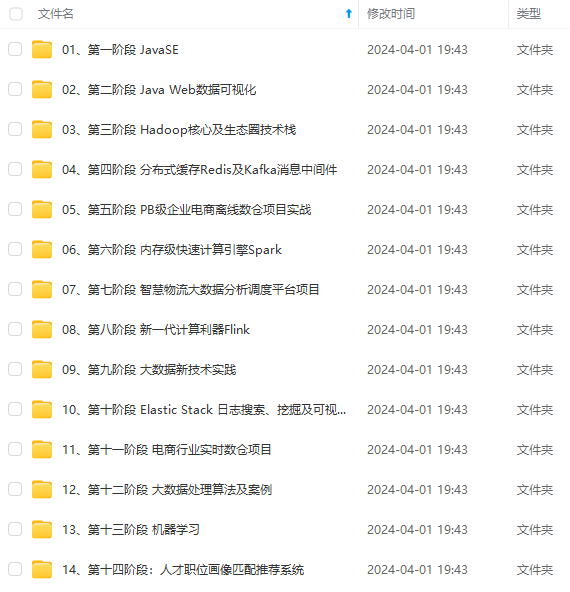

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

数据开发知识点,真正体系化!**

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

[外链图片转存中…(img-3hDXpGmg-1712955097158)]

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?