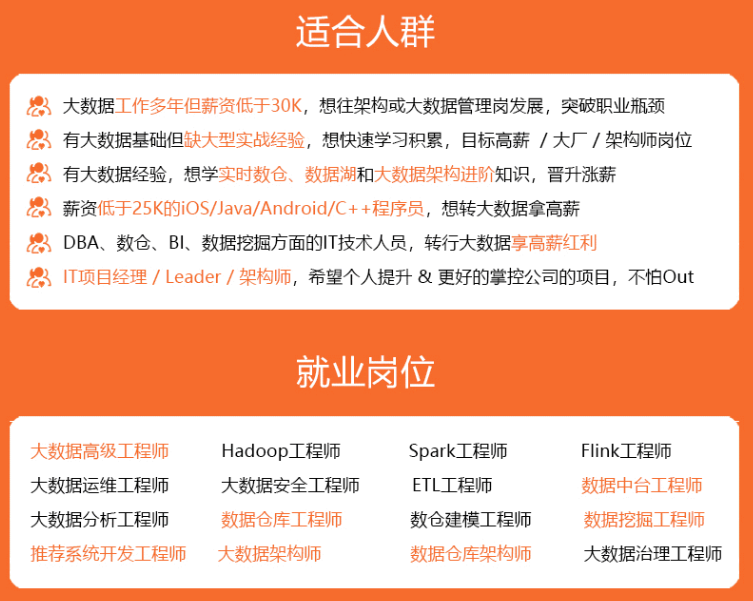

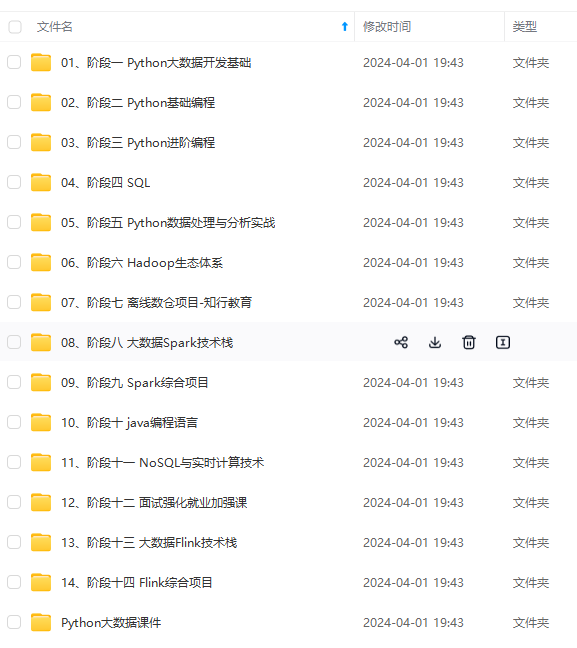

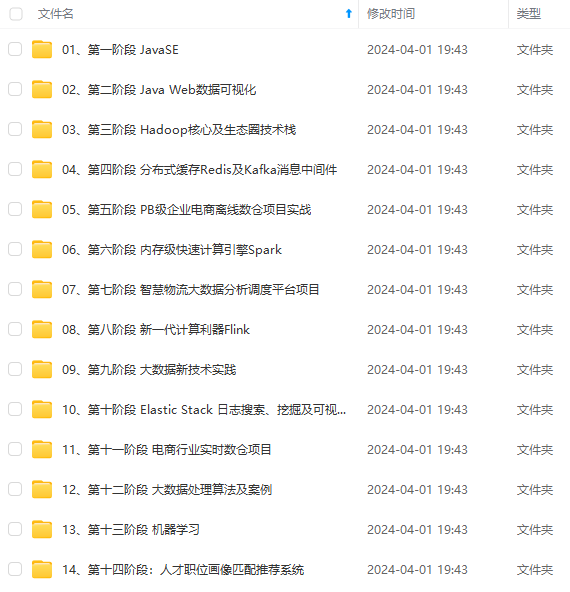

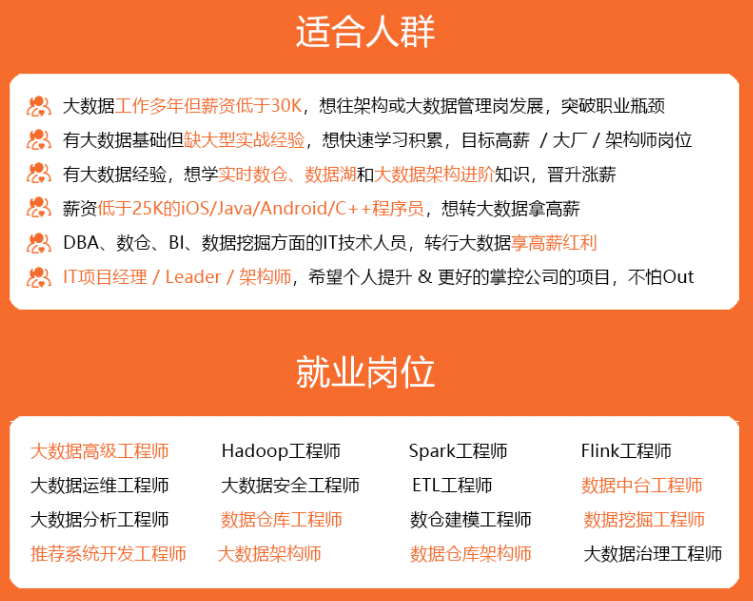

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

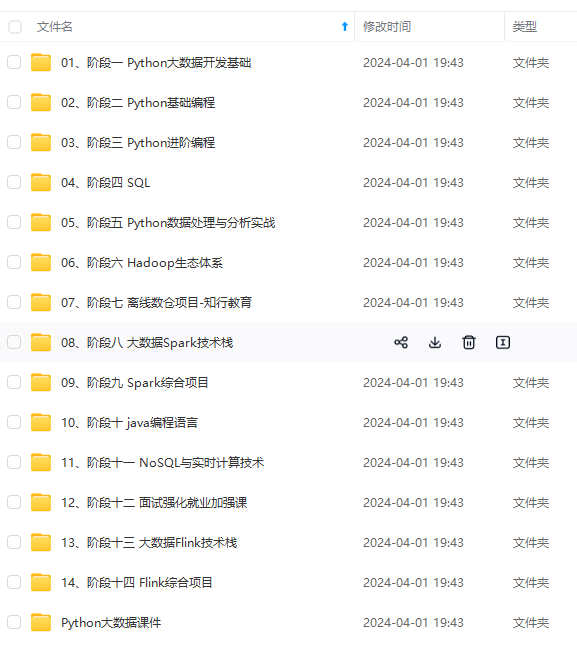

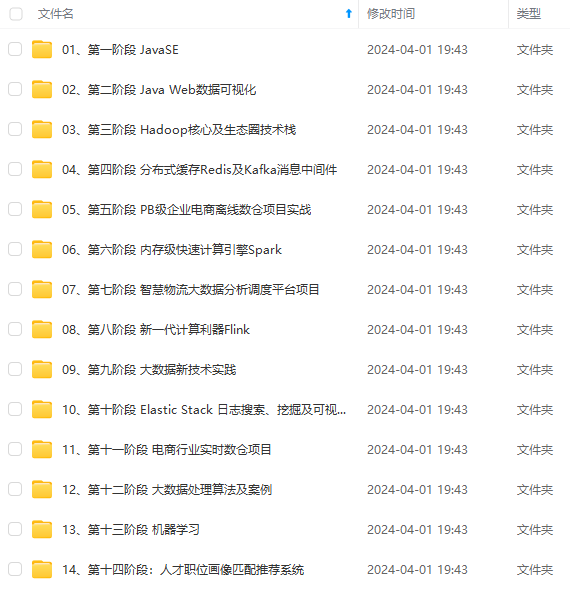

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

1.sqluldr2

sqluldr2是楼方鑫针对Oracle数据库开发的数据快速导出工具,应该绝大多数oracle用户都用过,因为它依旧是目前从oracle中导出文本数据最快的方式了,速度远超oracle官方的sqlplus spool导出。但是大多数人基本上都只使用其导出文件的功能,而不知道这个工具还可以导出标准输出(所谓标准输出即不生成文件,直接打印在屏幕上)

sqluldr2完整文档

2.gsql/psql(\copy 元命令)

gsql/psql的"\copy"元命令

(注意区别于sql命令中的"copy",“copy"是服务器端的,”\copy"是客户端的),

常用于和表和文件之间的导入和导出,效率很快,因为已经指定了表,不需要再进行字段类型的识别,绕开了sql解析引擎,直接写入表中。

但大多数人很少用到 stdin和stdout(除非是基于其他高级语言进行数据导入导出的开发),这里的stdin即为标准输入,如果执行"\copy 表名 from stdin",则会让你继续输入数据,然后客户端会把数据保存到对应的表中。

3.gsql/psql (-c参数)

gsql/psql 的 "-c"参数,可以在连接数据库后马上执行sql命令然后断开登录

4.linux ( | 管道符)

linux的管道符"|",可以用于输入的重定向,即把前面一条命令的输出,作为后面一条命令的输入

三、方案说明

通过以上内容,很自然的可以联想到一种方式,即使用sqluldr2的标准输出,直接作为gsql \copy的标准输入。所谓的两点之间直线最短,用最快的导出加上最快的导入,且省去中间存储文件的阶段,理想状态下,这个速度仅受限于源端或目标端最慢的那一端,比如导出7分钟,导入8分钟,一般总计传输时间就是15分钟,但是用本文的方案,这个传输时间可能就只有8分钟了,因为它是导入导出同时进行的!

四、操作步骤

需要有个服务器能同时连接oracle及MogDB(openGauss),当然直接用这两个服务器之一也可以,只是注意要安装另一个数据的客户端,本文测试是在mogdb数据库的服务器上执行的

oracle客户端下载

MogDB(openGauss)没有提供单独的客户端压缩包,客户端在数据库的安装包中对应的tools压缩包,比如MogDB-3.0.1-CentOS-64bit-tools.tar.gz

https://mogdb.io/downloads/mogdb/

安装客户端,这两个客户端的安装方式差不多,就是解压,然后配置环境变量LD_LIBRARY_PATH,比如配置连接Oracle的环境变量如下(如果需要永久配置则要修改对应的配置文件)

export LD_LIBRARY_PATH=/opt/mogdb/instantclient_21_7:$LD_LIBRARY_PATH

下载sqluldr2程序

这个就自己在网上搜吧,基本下载下来是一个压缩包,里面有两个windows版的和两个linux版的,我们需要的是"sqluldr2_linux64_10204.bin"这个文件,下完后可以把文件名改短点,比如"sqluldr2"

先找个小表测试下sqluldr2能否导出文件,文件正常生成,说明oracle客户端配置正确

./sqluldr2 scott/tiger@192.168.163.108/orcl query=emp quote=0x22 field="," degree=8 file=123.csv

[omm@MiWiFi-R3G-srv mogdb]$ cat 123.csv

7369,"SMITH","CLERK",7902,"1980-12-17 00:00:00",800,,20

7499,"ALLEN","SALESMAN",7698,"1981-02-20 00:00:00",1600,300,30

7521,"WARD","SALESMAN",7698,"1981-02-22 00:00:00",1250,500,30

7566,"JONES","MANAGER",7839,"1981-04-02 00:00:00",2975,,20

7654,"MARTIN","SALESMAN",7698,"1981-09-28 00:00:00",1250,1400,30

7698,"BLAKE","MANAGER",7839,"1981-05-01 00:00:00",2850,,30

7782,"CLARK","MANAGER",7839,"1981-06-09 00:00:00",2450,,10

7788,"SCOTT","ANALYST",7566,"1987-04-19 00:00:00",3000,,20

7839,"KING","PRESIDENT",,"1981-11-17 00:00:00",5000,,10

7844,"TURNER","SALESMAN",7698,"1981-09-08 00:00:00",1500,0,30

7876,"ADAMS","CLERK",7788,"1987-05-23 00:00:00",1100,,20

7900,"JAMES","CLERK",7698,"1981-12-03 00:00:00",950,,30

7902,"FORD","ANALYST",7566,"1981-12-03 00:00:00",3000,,20

7934,"MILLER","CLERK",7782,"1982-01-23 00:00:00",1300,,10

在目标端建立一个同样的表

gsql -d postgres -r -p 26000

create schema scott;

create table SCOTT.EMP

(

empno NUMBER(4) not null,

ename VARCHAR2(10),

job VARCHAR2(9),

mgr NUMBER(4),

hiredate DATE,

sal NUMBER(7,2),

comm NUMBER(7,2),

deptno NUMBER(2)

);

★测试通过管道传输数据,没有报错

./sqluldr2 scott/tiger@192.168.163.108/orcl query=emp quote=0x22 field="," degree=8 file=- |gsql -d postgres -Umogdb -WEnmo@123 -hlocalhost -p26000 -c "\copy scott.emp from stdin DELIMITER ',' quote '\"' csv"

在目标端查询scott.emp表,数据和源端一致

MogDB=# select \* from scott.emp;

empno | ename | job | mgr | hiredate | sal | comm | deptno

-------+--------+-----------+------+---------------------+---------+---------+--------

7369 | SMITH | CLERK | 7902 | 1980-12-17 00:00:00 | 800.00 | | 20

7499 | ALLEN | SALESMAN | 7698 | 1981-02-20 00:00:00 | 1600.00 | 300.00 | 30

7521 | WARD | SALESMAN | 7698 | 1981-02-22 00:00:00 | 1250.00 | 500.00 | 30

7566 | JONES | MANAGER | 7839 | 1981-04-02 00:00:00 | 2975.00 | | 20

7654 | MARTIN | SALESMAN | 7698 | 1981-09-28 00:00:00 | 1250.00 | 1400.00 | 30

7698 | BLAKE | MANAGER | 7839 | 1981-05-01 00:00:00 | 2850.00 | | 30

7782 | CLARK | MANAGER | 7839 | 1981-06-09 00:00:00 | 2450.00 | | 10

7788 | SCOTT | ANALYST | 7566 | 1987-04-19 00:00:00 | 3000.00 | | 20

7839 | KING | PRESIDENT | | 1981-11-17 00:00:00 | 5000.00 | | 10

7844 | TURNER | SALESMAN | 7698 | 1981-09-08 00:00:00 | 1500.00 | 0.00 | 30

7876 | ADAMS | CLERK | 7788 | 1987-05-23 00:00:00 | 1100.00 | | 20

7900 | JAMES | CLERK | 7698 | 1981-12-03 00:00:00 | 950.00 | | 30

7902 | FORD | ANALYST | 7566 | 1981-12-03 00:00:00 | 3000.00 | | 20

7934 | MILLER | CLERK | 7782 | 1982-01-23 00:00:00 | 1300.00 | | 10

(14 rows)

五、简单性能测试

由于硬盘空间不够,测试数据库也是虚拟机和docker中的,就不做详细的测试了,只做个简单的100万数据测试

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

识点,真正体系化!**

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

2012

2012

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?