3、构建Spark分布式HA环境

步骤1:准备Spark集群

与Hadoop类似,您需要准备一个Spark集群,确保各个组件正常运行,包括Spark Master和Spark Worker。

步骤2:配置HA

配置Spark Master的HA是确保Spark集群高可用性的关键步骤。这可以通过以下方式实现:

- 使用ZooKeeper :

ZooKeeper是一种常用的分布式协调服务,可以用于管理Spark Master的状态。配置Spark Master以 使用ZooKeeper来实现HA。

- 启用备用Master :

为Spark Master配置备用节点,以确保在主节点故障时能够切换到备用节点。

步骤3:测试HA

测试Spark的HA配置,模拟不同类型的故障,例如主Master故障或备用Master故障,以确保HA配置正 常运行。

4、监控和警报

无论是Hadoop还是Spark,建立了HA环境后,监控和警报都是至关重要的。您可以使用各种监控工具来监视集群的健康状况,并设置警报以及时处理故障。

一些常用的监控工具包括:

- Ambari :

用于Hadoop集群的监控和管理工具,提供了集群状态的实时视图和报警功能。

- Ganglia :

用于监控分布式系统的性能工具,包括Hadoop和Spark。

- Prometheus :

一种开源监控系统,可用于多种大数据组件的监控。

- Nagios :

用于网络和基础设施监控的广泛使用的工具,也可用于监控Hadoop和Spark集群。

5、数据一致性

在HA环境中,数据一致性是一个重要的问题。确保在切换到备用节点时不会丢失数据或导致数据不一 致是至关重要的。

这可以通过以下方法来实现:

- 使用共享存储 :

在Hadoop和Spark配置中使用共享存储,以确保数据在主节点和备用节点之间的同步。

- 增加数据冗余 :

通过复制数据到多个节点来增加数据冗余,以减少数据丢失的风险。

- 定期备份 :

定期备份数据,以便在数据损坏或丢失时进行还原。

6、结语

构建Hadoop和Spark分布式HA环境是确保大数据处理平台高可用性的关键步骤。通过正确配置HA、 测试故障转移、监控集群健康状况和确保数据一致性,您可以提高系统的可用性和稳定性。在大数据 领域,HA环境不仅仅是一种最佳实践,而且是确保数据分析任务能够持

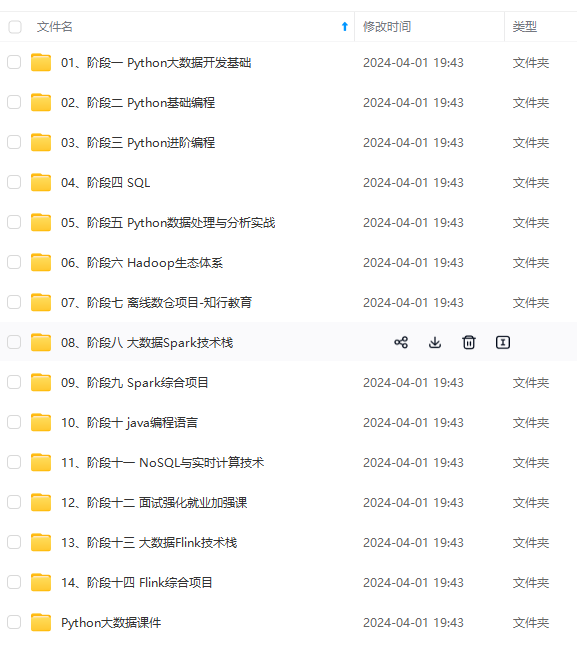

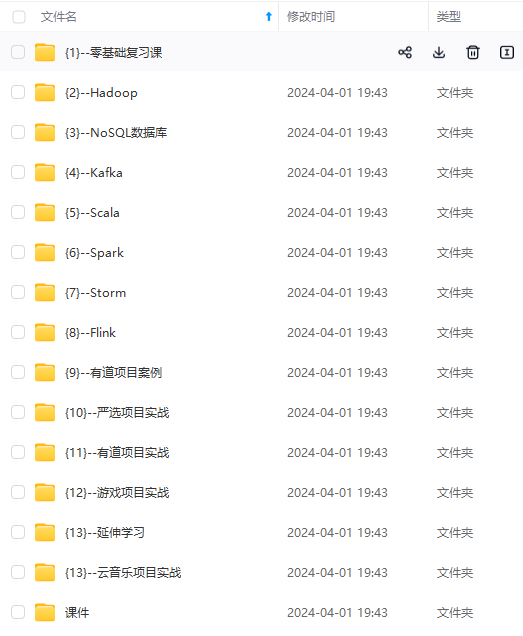

最后感谢每一个认真阅读我文章的人,看着粉丝一路的上涨和关注,礼尚往来总是要有的,虽然不是什么很值钱的东西,如果你用得到的话可以直接拿走!

软件测试面试文档

我们学习必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有字节大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

.csdn.net/topics/618545628)**

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

689

689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?