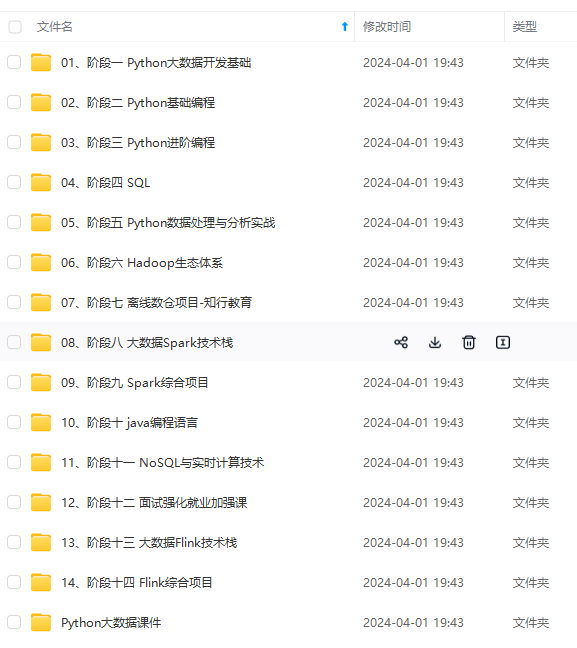

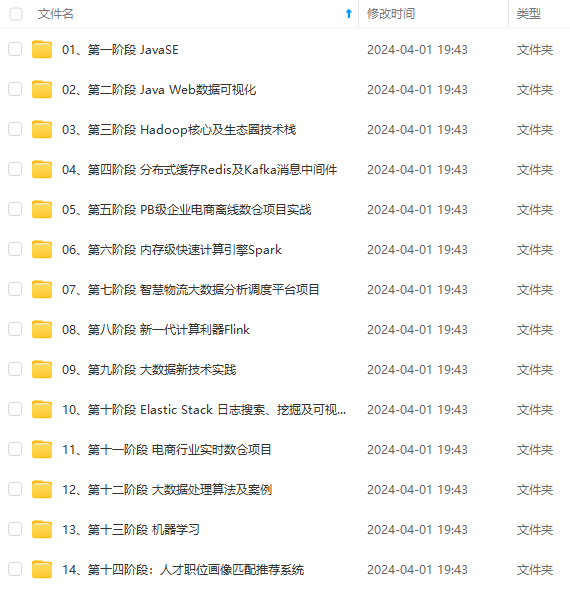

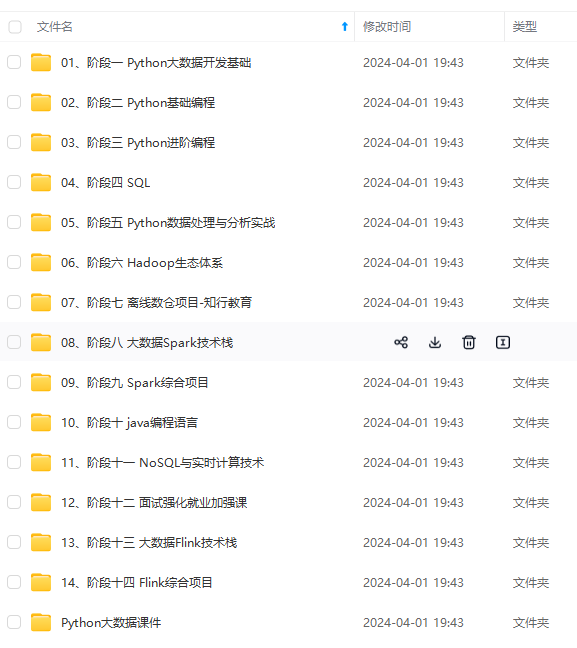

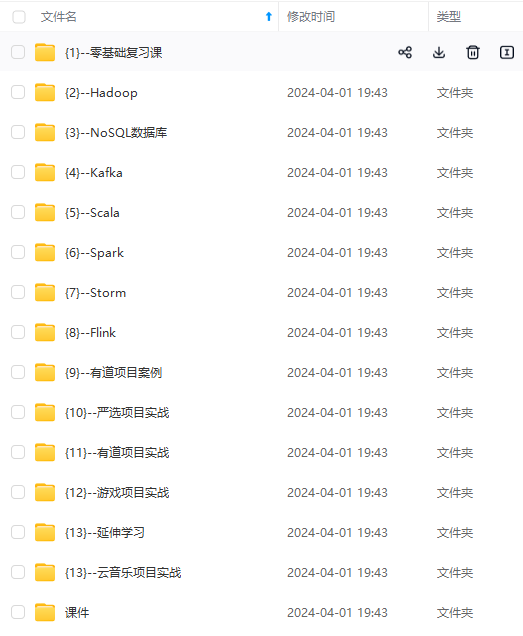

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

### 三、Hadoop的环境变量配置

在/etc/profile中

**Shift+g** 到末尾 添加

export HADOOP_HOME=/usr/local/softwave/hadoop-2.7.3 (注意这里改成自己配置文件的路径)

export HADOOP_MAPRED_HOME=

H

A

D

O

O

P

_

H

O

M

E

e

x

p

o

r

t

H

A

D

O

O

P

_

C

O

M

M

O

N

_

H

O

M

E

=

HADOOP\_HOME export HADOOP\_COMMON\_HOME=

HADOOP_HOMEexportHADOOP_COMMON_HOME=HADOOP_HOME

export HADOOP_HDFS_HOME=

H

A

D

O

O

P

_

H

O

M

E

e

x

p

o

r

t

Y

A

R

N

_

H

O

M

E

=

HADOOP\_HOME export YARN\_HOME=

HADOOP_HOMEexportYARN_HOME=HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR=

H

A

D

O

O

P

_

H

O

M

E

/

l

i

b

/

n

a

t

i

v

e

e

x

p

o

r

t

P

A

T

H

=

HADOOP\_HOME/lib/native export PATH=

HADOOP_HOME/lib/nativeexportPATH=PATH:

H

A

D

O

O

P

_

H

O

M

E

/

s

b

i

n

:

HADOOP\_HOME/sbin:

HADOOP_HOME/sbin:HADOOP_HOME/bin

export HADOOP_INSTALL=$HADOOP_HOME

### 四、修改配置文件

需要修改的配置文件在:

[root@zj1 hadoop]# pwd

/opt/soft/hadoop260/etc/hadoop

**hadoop-env.sh** : hadoop配置环境

**core-site.xml** : hadoop 核心配置文件

**hdfs-site.xml** : hdfs服务的 –> 会起进程

[**mapred-site.xml** : mapred计算所需要的配置文件] 只当在jar计算时才有

**yarn-site.xml** : yarn服务的 –> 会起进程

**slaves**: 集群的机器名称

1、修改 `hadoop-env.sh`

用于定义hadoop运行环境相关的配置信息

vi hadoop-env.sh

export JAVA_HOME=/opt/soft/jdk180

#此处修改为具体的JDK安装路径

2、修改 `vi core-site.xml`

用于定义系统级别的参数,如HDFS URL 、Hadoop的临时目录等

1. 当前hadoop文件系统端口地址 (分布式靠网络地址互相连接)

2. hadopdir 文件地址 存储临时文件的地址

3. 设置跨域信息设置hdfs权限 其他机器访问hadoop,如果对方为root就可以登录

vi core-site.xml

<--!默认文件系统(本地默认 file:/位置)此处端口与HBASE端口设成一样--> fs.defaultFS hdfs://192.168.56.137:9000 <--!临时文件的地址--> hadoop.tmp.dir /opt/soft/hadoop260/tmp <--!开放访问权限--> hadoop.proxyuser.root.hosts \* <--!可访问的用户组--> hadoop.proxyuser.root.groups \*

3、修改`hdfs-site.xml`

用于名称节点和数据节点的存放位置、文件副本的个数、文件的读取权限等

vi hdfs-site.xml

dfs.replication 2 // 副本个数,最少3个伪分布只写1个) dfs.permissions false

4、修改`mapred-site.xml`

用于包括JobHistory Server 和应用程序参数两部分,如reduce任务的默认个数、任务所能够使用内存的默认上下限等,此处之配置了开启计算引擎yarn

Hadoop在当前目录中提供一个mapred-site.xml模板

拷贝一份之后编辑不是模板的.xml文件

[root@zj1 hadoop]# cp mapred-site.xml.template mapred-site.xml

[root@zj1 hadoop]# vi mapred-site.xml

5、修改`yarn-site.xml`

配置ResourceManager ,nodeManager的通信端口,web监控端口等

### 五、修改datanode的启动地方

**1、添加从机名**

vi slaves

---------内容---------------

//这里伪分布式 直接localhost

//完全分布式则添加我另外两台从机名

zj2

zj3

**2、拷贝当前hadoop文件到其他两台虚拟机**

[root@zj1 hadoop]# scp -r /opt/soft/hadoop260/ root@192.168.56.139:/opt/soft/

**3、格式化HDFS ,查看是否成功**

[root@zj1 hadoop]# hdfs namenode -format

**4、启动

切换到hadoop260下sbin目录**

start-all.sh

stop-all.sh

**5、查看线程jps**

[root@zj4 sbin]# jps

18484 SecondaryNameNode

18213 NameNode

18725 NodeManager

18330 DataNode

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

2078

2078

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?