先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

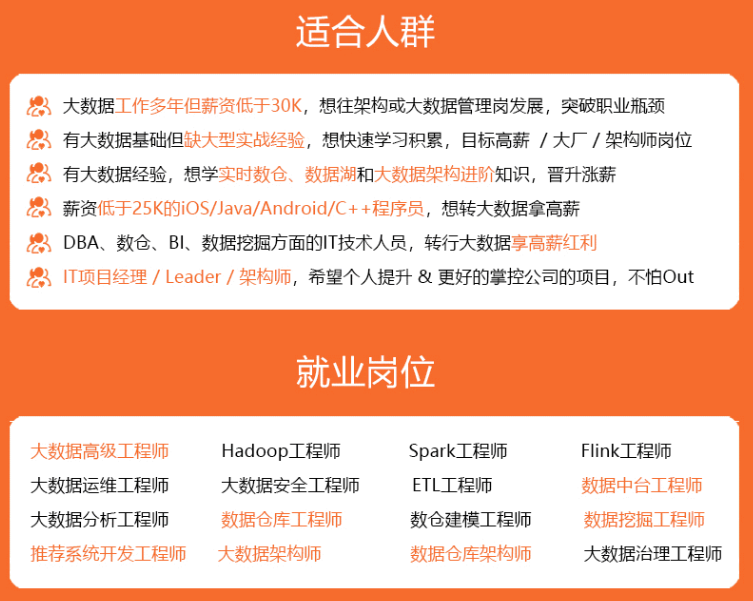

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

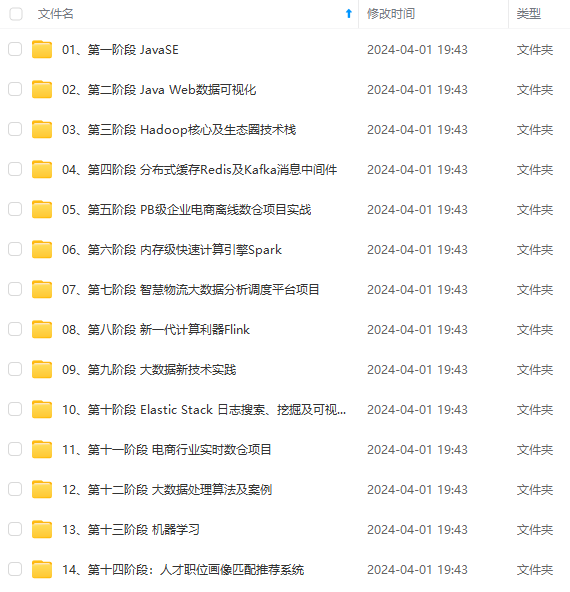

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

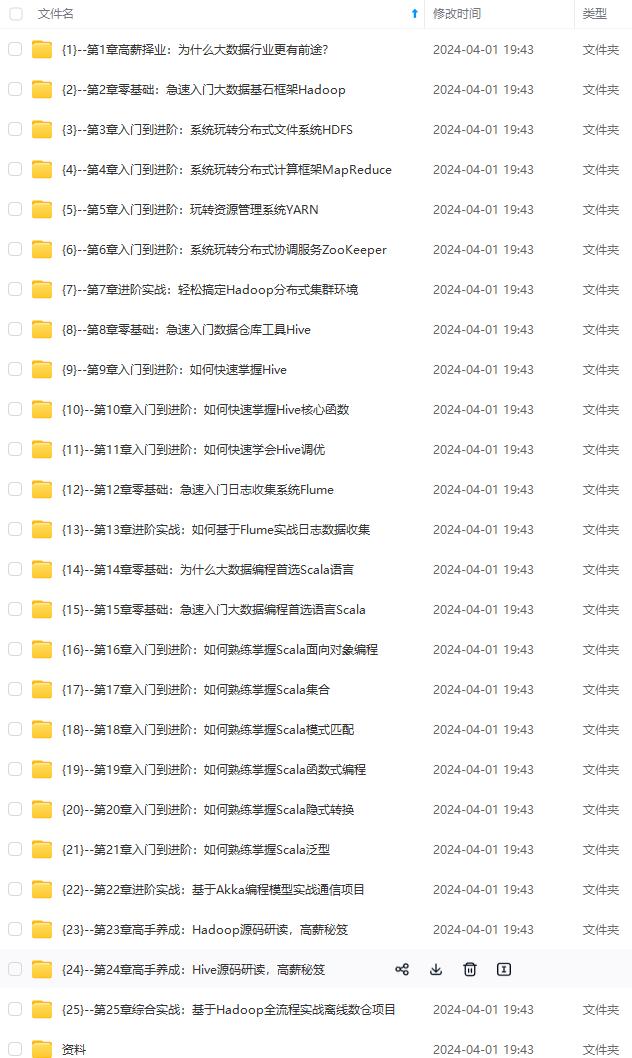

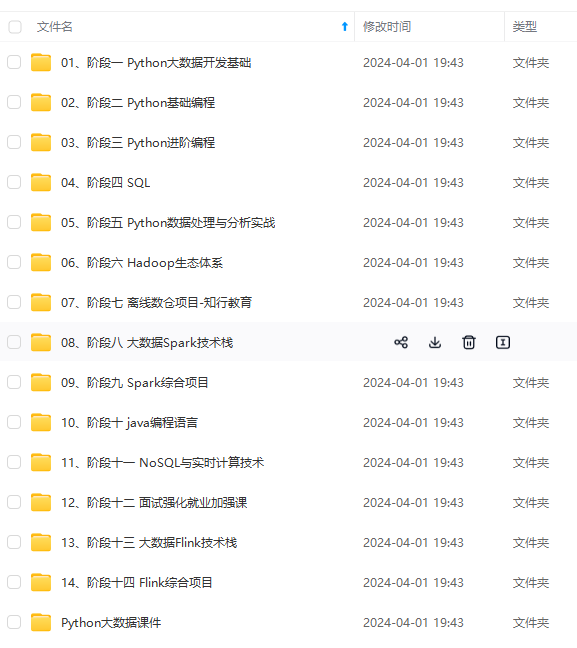

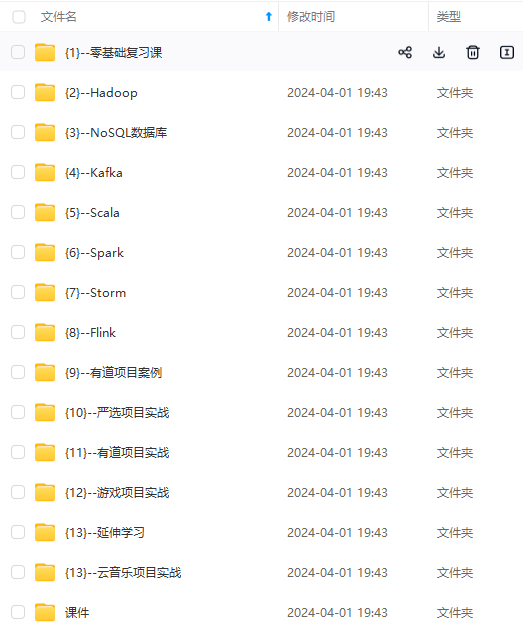

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

[luoyong@hadoop104 opt]$ source /etc/profile

2.2 SSH无密登录配置

操作三遍

[luoyong@hadoop102 bin]$ cd /home/luoyong/.ssh

[luoyong@hadoop102 .ssh]$ ssh-keygen -t rsa

Generating public/private rsa key pair.

Enter file in which to save the key (/home/luoyong/.ssh/id_rsa): 回车

Enter passphrase (empty for no passphrase): 回车

Enter same passphrase again: 回车

Your identification has been saved in /home/luoyong/.ssh/id_rsa.

Your public key has been saved in /home/luoyong/.ssh/id_rsa.pub.

The key fingerprint is:

SHA256:XSxkYP01ra6ZWEgoNRLw4r4kXT/m4/Y0qbXzF4+uNFM luoyong@hadoop102

The key’s randomart image is:

±–[RSA 2048]----+

| …ooo . |

| …oo… o .|

| . .o o…o. o |

| . … …o. . |

| . …S… .E |

| o . . …o |

| . + + =o++ + |

| o . oo=o++oo .|

| . o+oooo+. |

±—[SHA256]-----+将公钥拷贝到要免密登录的目标机器上

[luoyong@hadoop102 .ssh]$ ssh-copy-id hadoop102

[luoyong@hadoop102 .ssh]$ ssh-copy-id hadoop103

[luoyong@hadoop102 .ssh]$ ssh-copy-id hadoop104注意:

还需要在hadoop103上采用atguigu账号配置一下无密登录到hadoop102、hadoop103、hadoop104服务器上。

还需要在hadoop104上采用atguigu账号配置一下无密登录到hadoop102、hadoop103、hadoop104服务器上。

还需要在hadoop102上采用root账号,配置一下无密登录到hadoop102、hadoop103、hadoop104

2.3 配置集群(core-site.xml)

[luoyong@hadoop102 .ssh]$ cd H A D O O P _ H O M E / e t c / h a d o o p [ l u o y o n g @ h a d o o p 102 h a d o o p ] HADOOP\_HOME/etc/hadoop [luoyong@hadoop102 hadoop] HADOOP_HOME/etc/hadoop[luoyong@hadoop102hadoop] vim core-site.xml

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- 指定NameNode的地址 --> <property> <name>fs.defaultFS</name> <value>hdfs://hadoop102:8020</value> </property> <!-- 指定hadoop数据的存储目录 --> <property> <name>hadoop.tmp.dir</name> <value>/opt/module/hadoop-3.1.3/data</value> </property> <!-- 配置HDFS网页登录使用的静态用户为atguigu --> <property> <name>hadoop.http.staticuser.user</name> <value>luoyong</value> </property> </configuration>

2.4 HDFS配置文件**(hdfs-site.xml)**

[luoyong@hadoop102 hadoop]$ vim hdfs-site.xml

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- nn web端访问地址--> <property> <name>dfs.namenode.http-address</name> <value>hadoop102:9870</value> </property> <!-- 2nn web端访问地址--> <property> <name>dfs.namenode.secondary.http-address</name> <value>hadoop104:9868</value> </property> </configuration>

2.5YARN配置文件(yarn-site.xml)

[luoyong@hadoop102 hadoop]$ vim yarn-site.xml

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- 指定MR走shuffle --> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <!-- 指定ResourceManager的地址--> <property> <name>yarn.resourcemanager.hostname</name> <value>hadoop103</value> </property> <!-- 环境变量的继承 --> <property> <name>yarn.nodemanager.env-whitelist</name> <value>JAVA_HOME,HADOOP_COMMON_HOME,HADOOP_HDFS_HOME,HADOOP_CONF_DIR,CLASSPATH_PREPEND_DISTCACHE,HADOOP_YARN_HOME,HADOOP_MAPRED_HOME</value> </property> </configuration>

2.6MapReduce配置文件(mapred-site.xml)

[luoyong@hadoop102 hadoop]$ vim mapred-site.xml

<?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!-- 指定MapReduce程序运行在Yarn上 --> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> </configuration>

2.6在集群上分发配置好的Hadoop配置文件

[luoyong@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc/hadoop/

3 群起集群

[luoyong@hadoop102 hadoop]$ vim /opt/module/hadoop-3.1.3/etc/hadoop/workers

hadoop102

hadoop103

hadoop104

3.1同步所有节点配置文件

[luoyong@hadoop102 hadoop]$ xsync /opt/module/hadoop-3.1.3/etc

3.2启动集群

[luoyong@hadoop102 hadoop-3.1.3]$ cd /opt/module/hadoop-3.1.3/

[luoyong@hadoop102 hadoop-3.1.3]$ hdfs namenode -format启动HDFS

[luoyong@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh

**在配置了ResourceManager的节点(hadoop103)**启动YARN

[luoyong@hadoop103 ~]$ cd /opt/module/hadoop-3.1.3/

[luoyong@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh

[luoyong@hadoop102 hadoop-3.1.3]$ jps

Web端查看HDFS的NameNode

(a)浏览器中输入:http://hadoop102:9870

查看HDFS上存储的数据信息

Web端查看YARN的ResourceManager

(a)浏览器中输入:http://hadoop103:8088

查看YARN上运行的Job信息

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

Web端查看YARN的ResourceManager

(a)浏览器中输入:http://hadoop103:8088

查看YARN上运行的Job信息

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-4YXXOQUC-1713200174588)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

948

948

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?