注意:要保证jdk所在的路径中不能包含空格,比如Program Files中间是有空格的,建议参照下图中的路径

二、安装Hadoop

1. 下载hadoop-3.3.0

进入下载页面

https://archive.apache.org/dist/hadoop/common/hadoop-3.3.0/

选择hadoop-3.3.0.tar.gz下载

https://archive.apache.org/dist/hadoop/common/hadoop-3.3.0/hadoop-3.3.0.tar.gz

解压到C:\hadoop-3.3.0目录,形成C:\hadoop-3.3.0\bin这种目录层次

2. 下载winutils替换hadoop-3.3.0\bin目录

下载winutils

https://github.com/s911415/apache-hadoop-3.1.0-winutils

将其中bin目录替换到C:\hadoop-3.3.0\下的bin目录

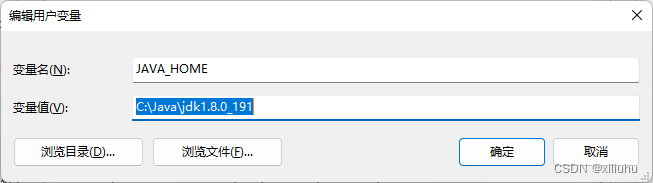

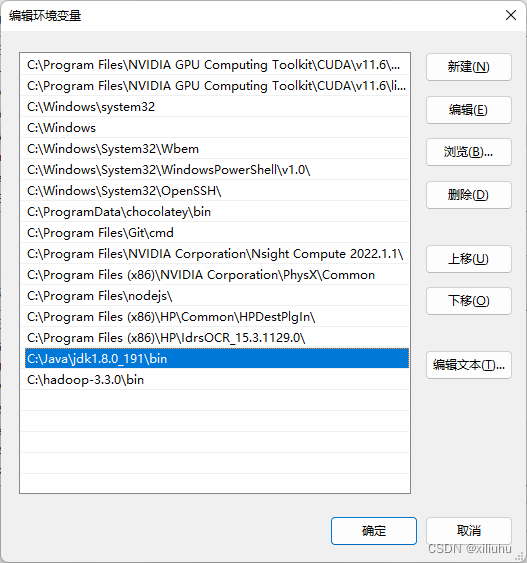

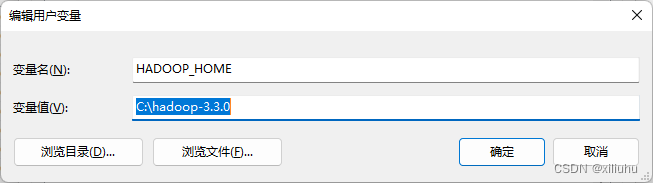

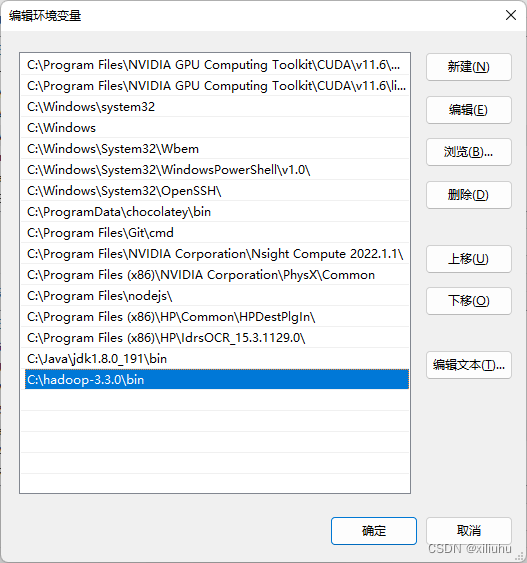

3. 设置环境变量

4. 修改配置

C:\hadoop-3.3.0\etc\hadoop目录下有4个配置文件

C:\hadoop-3.3.0\etc\hadoop\core-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9820</value>

</property>

</configuration>

C:\hadoop-3.3.0\etc\hadoop\hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///C:/hadoop-3.3.0/data/dfs/namenode</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///C:/hadoop-3.3.0/data/dfs/datanode</value>

</property>

</configuration>

C:\hadoop-3.3.0\etc\hadoop\mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

<description>MapReduce framework name</description>

</property>

</configuration>

C:\hadoop-3.3.0\etc\hadoop\yarn-site.xml

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

<description>Yarn Node Manager Aux Service</description>

</property>

</configuration>

5. 格式化目录

创建数据目录

C:\hadoop-3.3.0\data\dfs\namenode

C:\hadoop-3.3.0\data\dfs\datanode

cd C:\hadoop-3.3.0\bin

hdfs namenode -format

注意:-format中开头的短横容易写成全角下的短横,这样会导致错误,一定要用半角短横

选择Y

6. 验证服务

C:\hadoop-3.3.0\sbin> jps

17504 NameNode

17584 Jps

20944 NodeManager

3852 DataNode

4572 ResourceManager

PS C:\hadoop-3.3.0\sbin>

7. 启动

进入C:\hadoop-3.3.0\sbin

执行start-dfs.cmd文件

cd C:\hadoop-3.3.0\sbin

start-dfs.cmd

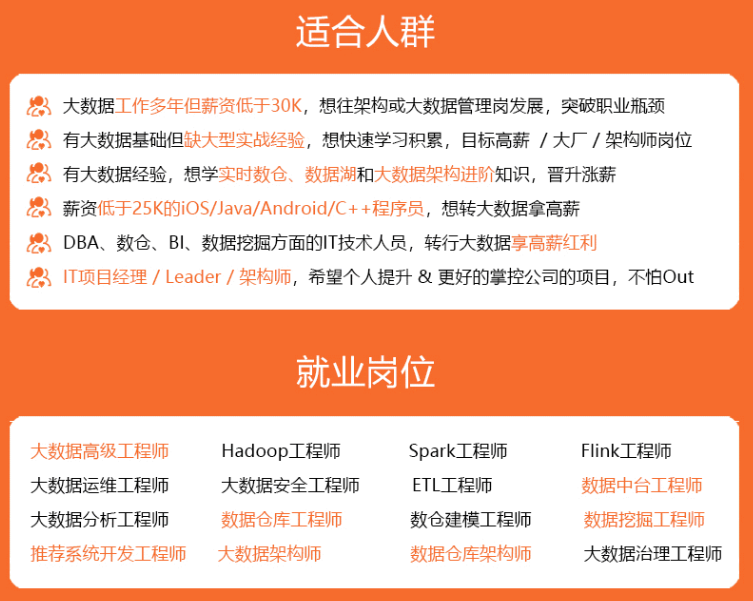

**自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。**

**深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!**

**因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。**

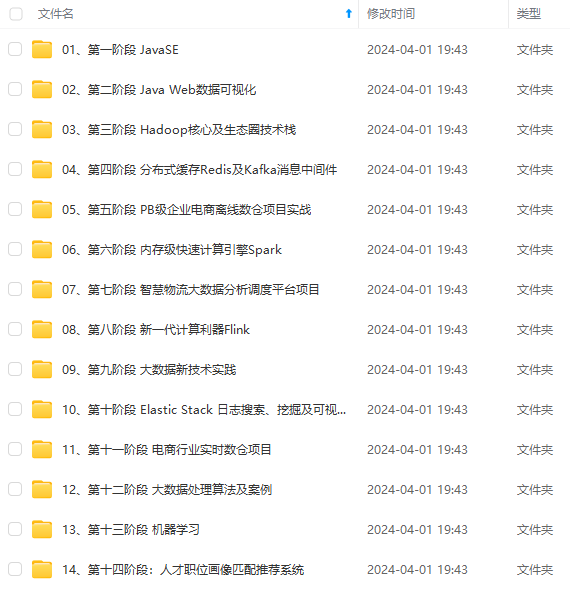

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!**

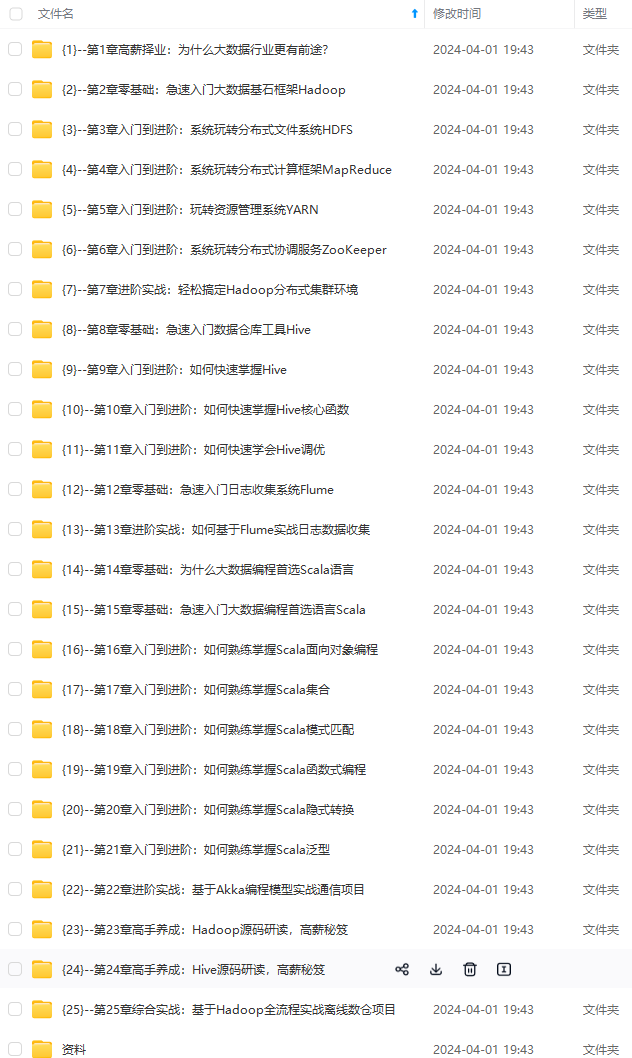

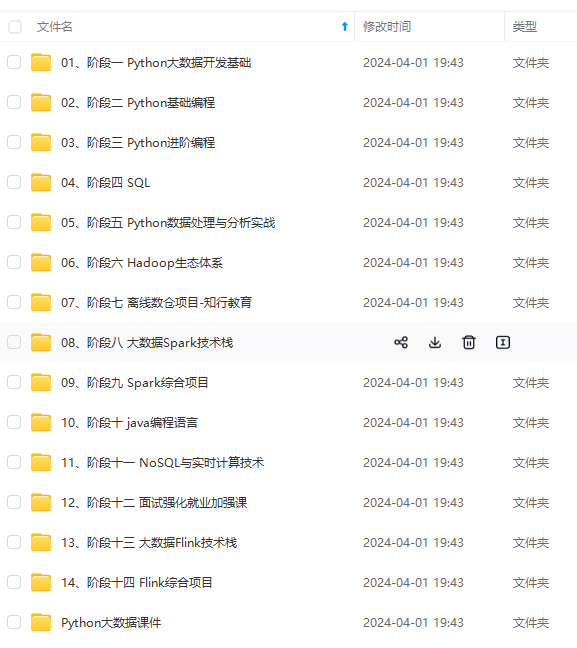

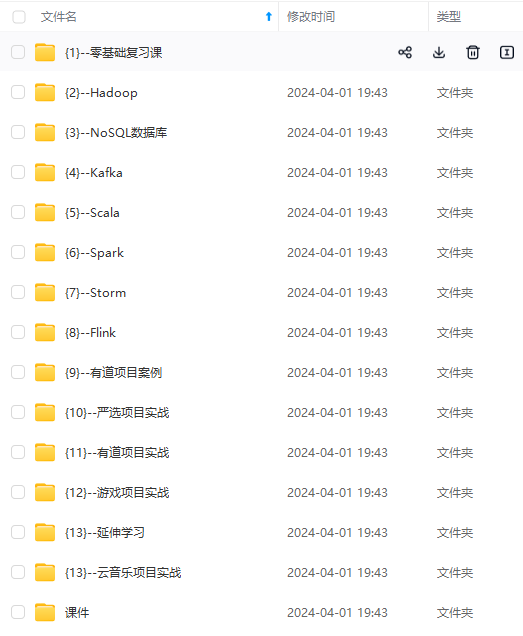

**由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新**

**如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)**

习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!**

**由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新**

**如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)**

[外链图片转存中...(img-vjC6u2I4-1712865614855)]

1000

1000

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?