先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

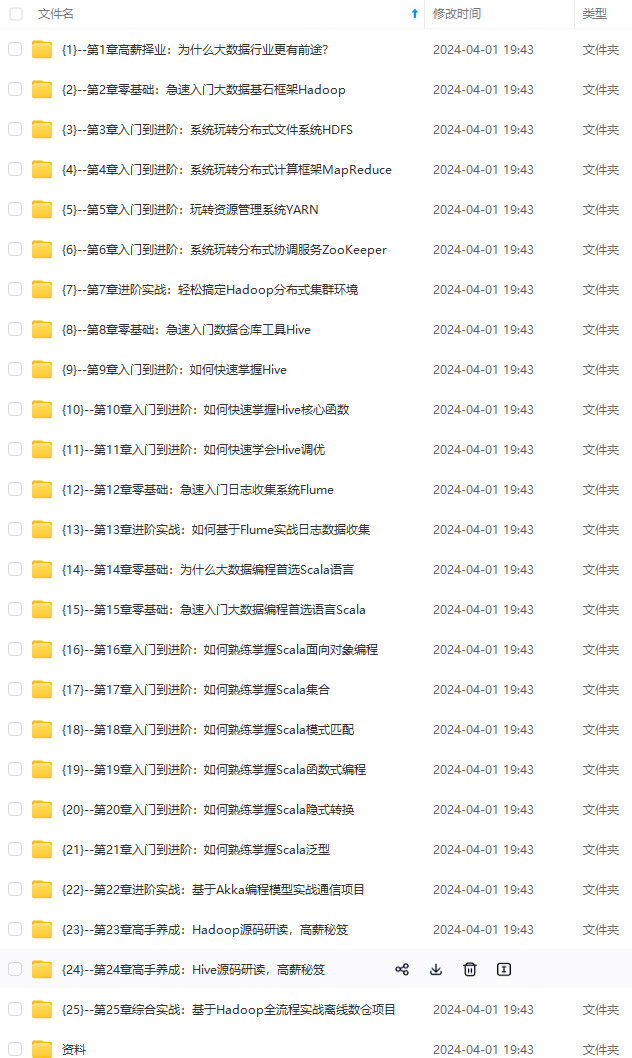

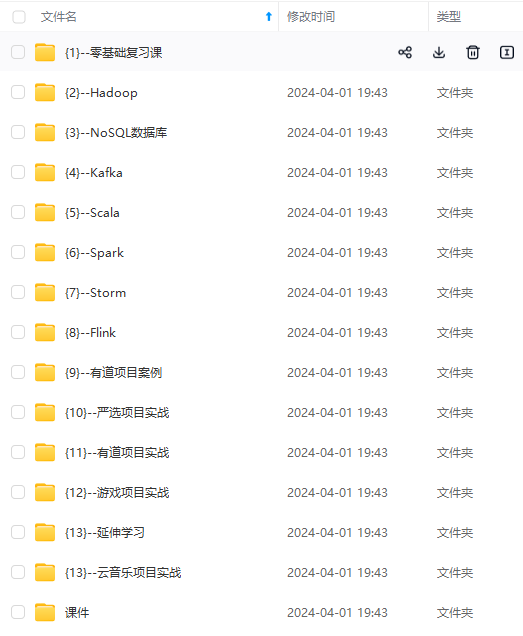

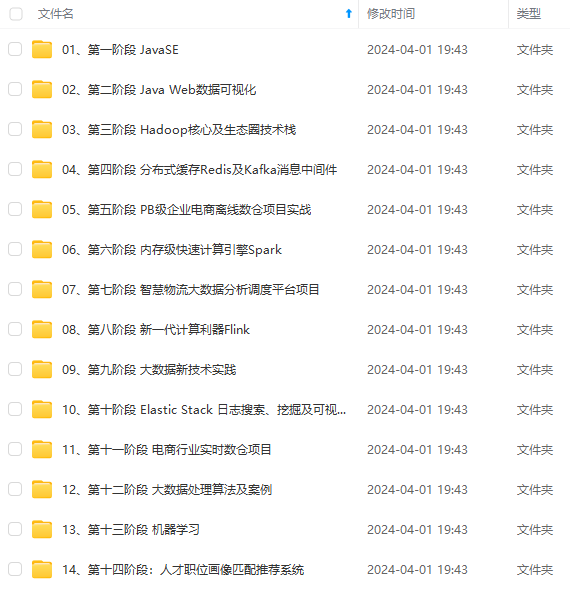

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

}

#### 4、debug.sh

允许通过JDI API连接到Hive来调试它

用法:hive--debug[:逗号分隔的参数列表]

参数列表:

recursive=<y|n> :是否也应在调试模式下启动子JVM。默认值:y

port=<port\_number> :主JVM侦听调试连接的端口。默认值:8000

mainSuspend=<y|n>:主JVM是否应等待调试器连接的执行。默认值:y

childSuspend=<y|n>:子JVM是否应等待调试器连接的执行。默认值:n

swapSuspend:交换主JVM和子JVM之间的挂起选项

#### 5、fixacidkeyindex.sh

用于检查和修复ORC文件的ACID密钥索引,(如果由于HIVE-18817而写入错误)的实用程序。将在ORC文件中检查的条件是,acid键索引中的条带数是否与ORC StripeInformation中的条带数匹配。

补充:

ORC采用混合存储结构。不是一个单纯的列式存储格式,它遵循了先水平分区,再垂直分区的理念。它支持复杂数据类型、ACID支持及内置索引支持,非常适合海量数据的存储。

ORC文件是以二进制的方式存储的,不可以直接读取。它是文件是自包含的,读取它不需考虑用户使用环境,因为它本身存储了文件数据、数据类型及编码信息,不依赖于 Hive Metastore 或任何其他外部元数据。

ORC的主体由多个Stripe(也成为条带)组成,Stripe又包含三个部分:Index Data、Row Data和Stripe Footer。索引和数据部分都按列划分,因此只需要读取所需列的数据。

THISSERVICE=fixacidkeyindex

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

fixacidkeyindex () {

CLASS=org.apache.hadoop.hive.ql.io.orc.FixAcidKeyIndex

HIVE_OPTS=‘’

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

使用:

./hive --service fixacidkeyindex [-h] --check-only|--recover [--backup-path <new-path>] <path\_to\_orc\_file\_or\_directory>

解释:

--check-only:检查acid orc文件的有效acid键索引,并在不修复的情况下退出

--recover:如果需要修复,请修复acid orc文件的acid键索引

--backup-path <new\_path>:指定存储损坏文件的备份路径(默认:/tmp)

--help (-h):Print help message

#### 6、help.sh

打印hive命令的使用信息,帮助你使用

#### 7、hiveburninclient.sh

HiveBurnInClient是该脚本最后执行的java主类,内容也很简单,通过jdbc连接hive,创建两张表,并加载./examples/files/kv1.txt和./examples/files/kv2.txt到表中,进行单表查询和关联查询,并记录每次执行sql的时间

THISSERVICE=hiveburninclient

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

hiveburninclient() {

echo “Starting hiveburninclient”

CLASS=org.apache.hive.testutils.jdbc.HiveBurnInClient

if

c

y

g

w

i

n

;

t

h

e

n

H

I

V

E

L

I

B

=

‘

c

y

g

p

a

t

h

−

w

"

cygwin; then HIVE_LIB=`cygpath -w "

cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

JAR=${HIVE_LIB}/hive-service-*.jar

exec $HADOOP jar $JAR $CLASS

H

I

V

E

O

P

T

S

"

HIVE_OPTS "

HIVEOPTS"@"

}

hiveburninclient_help() {

hiveburninclient -H

}

#### 8、hiveserver2.sh

HiveServer2(HS2)是一种使客户端能够针对Hive执行查询的服务。HiveServer2是已弃用的HiveServer1的继任者。HS2支持多客户端并发和身份验证。它旨在为JDBC和ODBC等开放式API客户端提供更好的支持。

HS2是作为复合服务运行的单个进程,其中包括基于Thrift的Hive服务(TCP或HTTP)和用于web UI的Jetty web服务器。

THISSERVICE=hiveserver2

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

hiveserver2() {

&2 echo “$(timestamp): Starting HiveServer2”

CLASS=org.apache.hive.service.server.HiveServer2

if c y g w i n ; t h e n H I V E L I B = ‘ c y g p a t h − w " cygwin; then HIVE_LIB=`cygpath -w " cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

JAR=${HIVE_LIB}/hive-service-[0-9].*.jar

export HADOOP_CLIENT_OPTS=" -Dproc_hiveserver2

H

A

D

O

O

P

C

L

I

E

N

T

O

P

T

S

"

e

x

p

o

r

t

H

A

D

O

O

P

O

P

T

S

=

"

HADOOP_CLIENT_OPTS " export HADOOP_OPTS="

HADOOPCLIENTOPTS"exportHADOOPOPTS="HIVESERVER2_HADOOP_OPTS $HADOOP_OPTS"

exec $HADOOP jar $JAR $CLASS

H

I

V

E

O

P

T

S

"

HIVE_OPTS "

HIVEOPTS"@"

}

hiveserver2_help() {

hiveserver2 -H

}

timestamp()

{

date +“%Y-%m-%d %T”

}

#### 9、hplsql.sh

编译并运行HPL/SQL脚本,

THISSERVICE=hplsql

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

hplsql () {

CLASS=org.apache.hive.hplsql.Hplsql;

仅包括HPL/SQL jar及其依赖项

hplsqlJarPath=ls ${HIVE_LIB}/hive-hplsql-*.jar

antlrJarPath=“

H

I

V

E

L

I

B

/

a

n

t

l

r

−

r

u

n

t

i

m

e

−

4.5.

j

a

r

"

h

a

d

o

o

p

C

l

a

s

s

p

a

t

h

=

"

"

i

f

[

[

−

n

"

{HIVE_LIB}/antlr-runtime-4.5.jar" hadoopClasspath="" if [[ -n "

HIVELIB/antlr−runtime−4.5.jar"hadoopClasspath=""if[[−n"{HADOOP_CLASSPATH}” ]]

then

hadoopClasspath=“

H

A

D

O

O

P

C

L

A

S

S

P

A

T

H

:

"

f

i

e

x

p

o

r

t

H

A

D

O

O

P

C

L

A

S

S

P

A

T

H

=

"

{HADOOP_CLASSPATH}:" fi export HADOOP_CLASSPATH="

HADOOPCLASSPATH:"fiexportHADOOPCLASSPATH="{hadoopClasspath}

H

I

V

E

C

O

N

F

D

I

R

:

{HIVE_CONF_DIR}:

HIVECONFDIR:{hplsqlJarPath}😒{antlrJarPath}”

exec $HADOOP jar ${hplsqlJarPath} $CLASS

H

I

V

E

O

P

T

S

"

HIVE_OPTS "

HIVEOPTS"@"

}

hplsql_help () {

hplsql “–help”

}

#### 10、jar.sh

用于需要Hadoop和Hive类路径和环境的应用程序,

./hive --service jar <yourjar> <yourclass> HIVE\_OPTS <your\_args>

#### 11、lineage.sh

给定一个hql,LineageInfo主类负责解析给定的查询并获取沿袭信息(ParseDriver负责解析hql获取AST树)目前,这只打印给定hql的输入和输出表

THISSERVICE=lineage

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

lineage () {

CLASS=org.apache.hadoop.hive.ql.tools.LineageInfo

cli特定代码

if [ ! -f ${HIVE_LIB}/hive-exec-*.jar ]; then

echo “Missing Hive exec Jar”

exit 3;

fi

if

c

y

g

w

i

n

;

t

h

e

n

H

I

V

E

L

I

B

=

‘

c

y

g

p

a

t

h

−

w

"

cygwin; then HIVE_LIB=`cygpath -w "

cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

exec $HADOOP jar ${HIVE_LIB}/hive-exec-*.jar

C

L

A

S

S

"

CLASS "

CLASS"@"

}

lineage_help () {

echo "usage ./hive --service lineage ‘hql’ "

}

hive -service lineage 'select \* from personal\_info\_test where id =2'

####

可以看下只输出了输入表的表名

#### 12、llap.sh

Hive2.0时添加的这个功能

llap是Live Long and Prosper(生生不息,繁荣昌盛)的缩写,是一个常用的祝福语,意为“长寿和繁荣”,它来自于美国电视剧《星际迷航》中的一个著名台词,由主角斯波克(Spock)所说。这句话传达了对他人健康长寿和事业兴旺的祝愿。

在hive中表示Live-Long And Process(常驻进程)可以进一步提升Hive的执行速度

从脚本中我们可以看到还用python启动了在yarn上的LLAP服务

关于Hive 的 LLAP功能我们会专门用一篇博客来讲,记得关注我哟

THISSERVICE=llap

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

llap () {

TMPDIR=$(mktemp -d /tmp/staging-yarn-XXXXXX)

CLASS=org.apache.hadoop.hive.llap.cli.LlapServiceDriver;

if [ ! -f ${HIVE_LIB}/hive-cli-*.jar ]; then

echo “Missing Hive CLI Jar”

exit 3;

fi

if

c

y

g

w

i

n

;

t

h

e

n

H

I

V

E

L

I

B

=

‘

c

y

g

p

a

t

h

−

w

"

cygwin; then HIVE_LIB=`cygpath -w "

cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

set -e;

export HADOOP_CLIENT_OPTS=" -Dproc_llapcli $HADOOP_CLIENT_OPTS -Dlog4j.configurationFile=llap-cli-log4j2.properties "

hadoop 20 or newer - skip the aux_jars option. picked up from hiveconf

$HADOOP $CLASS $HIVE_OPTS -directory T M P D I R " TMPDIR " TMPDIR"@"

check for config files

test -f $TMPDIR/config.json

python $HIVE_HOME/scripts/llap/yarn/package.py --input T M P D I R " TMPDIR " TMPDIR"@"

remove temp files

rm -rf $TMPDIR

}

llap_help () {

CLASS=org.apache.hadoop.hive.llap.cli.LlapServiceDriver;

execHiveCmd $CLASS “–help”

}

#### 13、llapdump.sh

通过LLAP输入格式测试查询和数据检索的实用程序

THISSERVICE=llapdump

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

llapdump () {

CLASS=org.apache.hadoop.hive.llap.LlapDump

HIVE_OPTS=‘’

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

llapdump_help () {

echo “usage ./hive --service llapdump [-l ] [-u ] [-p ] ”

echo “”

echo " --location (-l) hs2 url"

echo " --user (-u) user name"

echo " --pwd (-p) password"

}

hive --service llapdump 'select \* from personal\_info\_test where id =2'

#### 14、llapstatus.sh

负责变更LLAP服务的状态

THISSERVICE=llapstatus

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

llapstatus () {

CLASS=org.apache.hadoop.hive.llap.cli.LlapStatusServiceDriver;

if [ ! -f ${HIVE_LIB}/hive-cli-*.jar ]; then

echo “Missing Hive CLI Jar”

exit 3;

fi

if

c

y

g

w

i

n

;

t

h

e

n

H

I

V

E

L

I

B

=

‘

c

y

g

p

a

t

h

−

w

"

cygwin; then HIVE_LIB=`cygpath -w "

cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

set -e;

export HADOOP_CLIENT_OPTS=" -Dproc_llapstatuscli $HADOOP_CLIENT_OPTS -Dlog4j.configurationFile=llap-cli-log4j2.properties "

hadoop 20 or newer - skip the aux_jars option. picked up from hiveconf

$HADOOP $CLASS H I V E O P T S " HIVE_OPTS " HIVEOPTS"@"

}

llapstatus_help () {

CLASS=org.apache.hadoop.hive.llap.cli.LlapStatusServiceDriver;

execHiveCmd $CLASS “–help”

}

#### 15、metastore.sh

基于HadoopThriftAuthBridge 启动Metastore

HadoopThriftAuthBridge是将Thrift的SASL传输桥接到Hadoop的SASL回调处理程序和身份验证类的函数

THISSERVICE=metastore

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

metastore() {

echo “$(timestamp): Starting Hive Metastore Server”

CLASS=org.apache.hadoop.hive.metastore.HiveMetaStore

if

c

y

g

w

i

n

;

t

h

e

n

H

I

V

E

L

I

B

=

‘

c

y

g

p

a

t

h

−

w

"

cygwin; then HIVE_LIB=`cygpath -w "

cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

JAR=${HIVE_LIB}/hive-metastore-*.jar

hadoop 20 or newer - skip the aux_jars option and hiveconf

export HADOOP_CLIENT_OPTS=" -Dproc_metastore

H

A

D

O

O

P

C

L

I

E

N

T

O

P

T

S

"

e

x

p

o

r

t

H

A

D

O

O

P

O

P

T

S

=

"

HADOOP_CLIENT_OPTS " export HADOOP_OPTS="

HADOOPCLIENTOPTS"exportHADOOPOPTS="HIVE_METASTORE_HADOOP_OPTS $HADOOP_OPTS"

exec $HADOOP jar $JAR

C

L

A

S

S

"

CLASS "

CLASS"@"

}

metastore_help() {

metastore -h

}

timestamp()

{

date +“%Y-%m-%d %T”

}

#### 16、metatool.sh

此类为配置单元管理员提供了一个工具

1、使用DataNucleus对元存储执行JDOQL (JDO其实就是jdbc,因为hive-site.xml中关于metastore的配置都是javax.jdo.xxx)

2、执行HA名称节点升级

THISSERVICE=metatool

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

metatool () {

HIVE_OPTS=‘’

CLASS=org.apache.hadoop.hive.metastore.tools.HiveMetaTool

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

metatool_help () {

HIVE_OPTS=‘’

CLASS=org.apache.hadoop.hive.metastore.tools.HiveMetaTool

execHiveCmd $CLASS “–help”

}

#### 17、orcfiledump.sh

用于查看或修复orc文件的工具

hive --service orcfiledump --help

THISSERVICE=orcfiledump

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

orcfiledump () {

CLASS=org.apache.orc.tools.FileDump

HIVE_OPTS=‘’

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

orcfiledump_help () {

echo “usage ./hive orcfiledump [-h] [-j] [-p] [-t] [-d] [-r <col_ids>] [–recover] [–skip-dump] [–backup-path ] <path_to_orc_file_or_directory>”

echo “”

echo " --json (-j) Print metadata in JSON format"

echo " --pretty (-p) Pretty print json metadata output"

echo " --timezone (-t) Print writer’s time zone"

echo " --data (-d) Should the data be printed"

echo " --rowindex (-r) <col_ids> Comma separated list of column ids for which row index should be printed"

echo " --recover Recover corrupted orc files generated by streaming"

echo " --skip-dump Used along with --recover to directly recover files without dumping"

echo " --backup-path <new_path> Specify a backup path to store the corrupted files (default: /tmp)"

echo " --help (-h) Print help message"

}

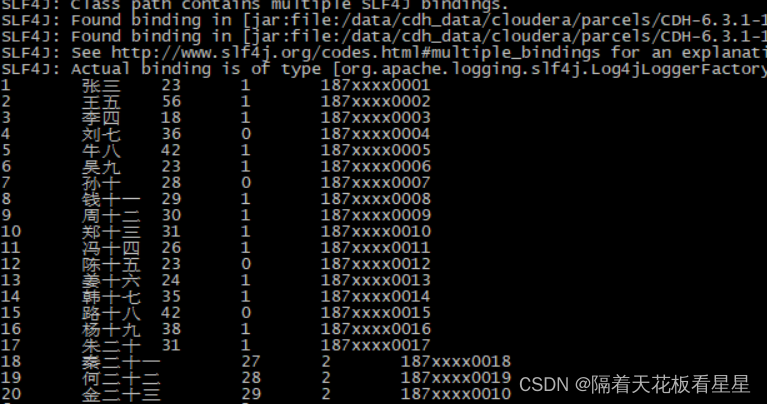

我们创建一个orc表并插入些数据来实践下这个命令

create table if not exists test.personal_info_temp_orc

(id int comment ‘id’,

name string comment ‘姓名’,

age string comment ‘年龄’ ,

sex string comment ‘性别:1男0女2其他’ ,

telno string comment ‘手机号’ )

row format delimited

fields terminated by ‘,’

stored as orc

;

#hive ORC表的数据不能通过hive客户端load数据文件加载,也不能使用hdfs dfs -put上传到对应目录

#只能通过insert 方式插入数据

insert into personal_info_temp_orc select * from ods.personal_info_temp order by id ;

>

> #获取orc文件信息

>

>

> hive --orcfiledump /user/hive/warehouse/test.db/personal\_info\_temp\_orc/000000\_0

>

>

>

#### 18、rcfilecat.sh

RCFile 和 ORCFile一样都是行列式存储文件,ORCFile为优化后的行列式存储文件

THISSERVICE=rcfilecat

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

rcfilecat () {

CLASS=org.apache.hadoop.hive.cli.RCFileCat

HIVE_OPTS=‘’

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

rcfilecat_help () {

echo "usage ./hive rcfilecat [–start=‘startoffset’] [–length=‘len’] "

}

我们创建一个RCFile 格式的表并插入些数据来实践下这个命令

create table if not exists test.personal_info_temp_rc_file

(id int comment ‘id’,

name string comment ‘姓名’,

age string comment ‘年龄’ ,

sex string comment ‘性别:1男0女2其他’ ,

telno string comment ‘手机号’ )

row format delimited

fields terminated by ‘,’

stored as rcfile

;

#hive ORC表的数据不能通过hive客户端load数据文件加载,也不能使用hdfs dfs -put上传到对应目录

#只能通过insert 方式插入数据

insert into personal_info_temp_rc_file select * from ods.personal_info_temp order by id ;

#获取orc文件信息

>

> hive --rcfilecat /user/hive/warehouse/test.db/personal\_info\_temp\_rc\_file /000000\_0

>

>

>

#### 19、schemaTool.sh

这是一个初始化Hive元数据的工具,使用方法为(使用之前需要在hive-site.xml中正确填写元数据库的连接、用户名、密码)

>

> schematool -dbType mysql -initSchema

>

>

>

THISSERVICE=schemaTool

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

schemaTool() {

HIVE_OPTS=‘’

CLASS=org.apache.hive.beeline.HiveSchemaTool

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

schemaTool_help () {

HIVE_OPTS=‘’

CLASS=org.apache.hive.beeline.HiveSchemaTool

execHiveCmd $CLASS “–help”

}

#### 20、strictmanagedmigration.sh

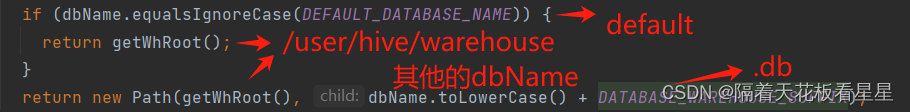

HiveStrictManagedMigration是这个脚本对应的java类,会循环每个数据库并把他们移动到hive-site.xml中hive.metastore.warehouse.dir对应的路径下,默认为/user/hive/warehouse

如果我们有三个数据库 default、ods、dwd

在default下建的表放在了/user/hive/warehouse 下

在ods下建的表放在了/user/hive/warehouse/ods.db 下

在dwd下建的表放在了/user/hive/warehouse/dwd.db 下

THISSERVICE=strictmanagedmigration

export SERVICE_LIST="

S

E

R

V

I

C

E

L

I

S

T

{SERVICE_LIST}

SERVICELIST{THISSERVICE} "

strictmanagedmigration () {

CLASS=org.apache.hadoop.hive.ql.util.HiveStrictManagedMigration

HIVE_OPTS=‘’

execHiveCmd

C

L

A

S

S

"

CLASS "

CLASS"@"

}

strictmanagedmigration_help () {

strictmanagedmigration “–help”

}

#### 21、tokentool.sh

用于操作MetaStore委派令牌的工具

#### 22、version.sh

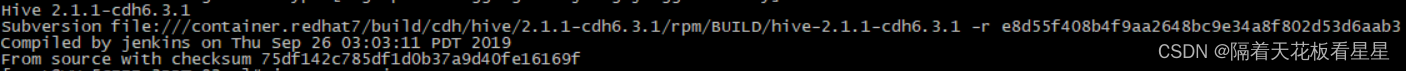

输出Hive的版本信息,基本每个工具都有这个功能,比如 java -version 等等

Hive 对应的命令是 hive --version 会输出版本信息、版本控制地址、提交的作者和时间、纠错码

### 3、ext/util下的脚本

这里只有一个脚本:execHiveCmd.sh

相比在很多脚本中都有它的身影,很多脚本对应的主类都是传递给它来运行的

CLI_JAR=“hive-cli-.jar"

BEELINE_JAR="hive-beeline-.jar”

execHiveCmd () {

CLASS=$1;

shift;

如果jar未作为参数传递,请使用相应的cli-jar

if [ “

1

"

=

=

"

1" == "

1"=="CLI_JAR” ] || [ “

1

"

=

=

"

1" == "

1"=="BEELINE_JAR” ]; then

JAR=“

1

"

s

h

i

f

t

;

e

l

s

e

i

f

[

"

1" shift; else if [ "

1"shift;elseif["USE_DEPRECATED_CLI” == “true” ]; then

JAR=“

C

L

I

J

A

R

"

e

l

s

e

J

A

R

=

"

CLI_JAR" else JAR="

CLIJAR"elseJAR="BEELINE_JAR”

fi

fi

cli specific code

if [ ! -f

H

I

V

E

L

I

B

/

{HIVE_LIB}/

HIVELIB/JAR ]; then

echo “Missing $JAR Jar”

exit 3;

fi

if

c

y

g

w

i

n

;

t

h

e

n

H

I

V

E

L

I

B

=

‘

c

y

g

p

a

t

h

−

w

"

cygwin; then HIVE_LIB=`cygpath -w "

cygwin;thenHIVELIB=‘cygpath−w"HIVE_LIB"`

fi

hadoop 20 or newer - skip the aux_jars option. picked up from hiveconf

exec $HADOOP jar

H

I

V

E

L

I

B

/

{HIVE_LIB}/

HIVELIB/JAR $CLASS

H

I

V

E

O

P

T

S

"

HIVE_OPTS "

HIVEOPTS"@"

}

## 四、java部分

在cli.sh脚本中我们已经分析了默认hive客户端的启动类为CliDriver,下面我们就从CliDriver的main方法开始捋(不是主要的代码会省略掉,方便我们理清主线逻辑)

### 1、main

这部分代码很简单,我们接着往下看

public static void main(String[] args) throws Exception {

int ret = new CliDriver().run(args);

//终止当前运行的Java虚拟机。参数用作状态代码;按照惯例,非零状态代码表示异常终止。

System.exit(ret);

}

### 2、run

public int run(String[] args) throws Exception {

OptionsProcessor oproc = new OptionsProcessor();

//从参数设置hive的环境变量,如果中间出现异常返回 1 终止虚拟机

if (!oproc.process_stage1(args)) {

return 1;

}

//......省略......

//Hive客户端会话状态类

CliSessionState ss = new CliSessionState(new HiveConf(SessionState.class));

//把系统“标准”输入流、输出流、错误流 赋给 Hive客户端会话状态类

//如果期间有错误 返回 3 终止虚拟机

ss.in = System.in;

try {

ss.out = new PrintStream(System.out, true, "UTF-8");

ss.info = new PrintStream(System.err, true, "UTF-8");

ss.err = new CachingPrintStream(System.err, true, "UTF-8");

} catch (UnsupportedEncodingException e) {

return 3;

}

//判断 hive命令后面的参数 比如 hive -e “hql” hive -f xxx.hql 等

//这里就会根据命令行的参数初始化以下变量

// ss.database 执行的数据库

// ss.execString -e 后面要执行的hql

// ss.fileName -f 包含hql的文件

// ss.initFiles

if (!oproc.process_stage2(ss)) {

return 2;

}

//设置通过命令行指定的所有属性

HiveConf conf = ss.getConf();

for (Map.Entry<Object, Object> item : ss.cmdProperties.entrySet()) {

conf.set((String) item.getKey(), (String) item.getValue());

ss.getOverriddenConfigurations().put((String) item.getKey(), (String) item.getValue());

}

//读取提示配置并替换变量。

prompt = conf.getVar(HiveConf.ConfVars.CLIPROMPT);

prompt = new VariableSubstitution(new HiveVariableSource() {

@Override

public Map<String, String> getHiveVariable() {

return SessionState.get().getHiveVariables();

}

}).substitute(conf, prompt);

prompt2 = spacesForString(prompt);

if (HiveConf.getBoolVar(conf, ConfVars.HIVE_CLI_TEZ_SESSION_ASYNC)) {

//以fire-and-forget 的方式启动会话。当需要会话的异步初始化部分时,

//相应的getter和其他方法将根据需要等待。

//fire-and-forget :把消息发送给服务器,但并不关心是否都到

SessionState.beginStart(ss, console);

} else {

SessionState.start(ss);

}

ss.updateThreadName();

//创建视图注册表

HiveMaterializedViewsRegistry.get().init();

//执行cli驱动程序工作

try {

return executeDriver(ss, conf, oproc);

} finally {

ss.resetThreadName();

ss.close();

}

}

### 3、executeDriver

/**

- 执行Hive客户端的任务

- @param ss CLI driver 的 session状态

- @param conf Hive的配置信息

- @param CLI 调用的操作处理器

- @return 执行命令的状态

- @throws Exception

*/

private int executeDriver(CliSessionState ss, HiveConf conf, OptionsProcessor oproc)

throws Exception {

CliDriver cli = new CliDriver();

//设置cli的关于hive的环境变量

cli.setHiveVariables(oproc.getHiveVariables());

//如果指定,请使用指定的数据库

cli.processSelectDatabase(ss);

//执行-i init文件(始终处于静默模式)

cli.processInitFiles(ss);

//如果命令行带了 -e 参数 ,现在需要处理 -e 后面的 hql

if (ss.execString != null) {

//处理一行分号分隔的命令

int cmdProcessStatus = cli.processLine(ss.execString);

return cmdProcessStatus;

}

try {

//如果命令行带了 -f 参数 ,现在需要处理 -f 里面的 hql

if (ss.fileName != null) {

return cli.processFile(ss.fileName);

}

} catch (FileNotFoundException e) {

System.err.println("Could not open input file for reading. (" + e.getMessage() + ")");

return 3;

}

//判断hive当前的执行引擎是否是 mr

if ("mr".equals(HiveConf.getVar(conf, ConfVars.HIVE_EXECUTION_ENGINE))) {

console.printInfo(HiveConf.generateMrDeprecationWarning());

}

//创建ConsoleReader并启动,读取用户输入,遇到“;”为一个完整的命令

//并开启命令历史记录服务,将命令写入文件中

setupConsoleReader();

String line;

int ret = 0;

String prefix = "";

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

-f 里面的 hql

if (ss.fileName != null) {

return cli.processFile(ss.fileName);

}

} catch (FileNotFoundException e) {

System.err.println(“Could not open input file for reading. (” + e.getMessage() + “)”);

return 3;

}

//判断hive当前的执行引擎是否是 mr

if (“mr”.equals(HiveConf.getVar(conf, ConfVars.HIVE_EXECUTION_ENGINE))) {

console.printInfo(HiveConf.generateMrDeprecationWarning());

}

//创建ConsoleReader并启动,读取用户输入,遇到“;”为一个完整的命令

//并开启命令历史记录服务,将命令写入文件中

setupConsoleReader();

String line;

int ret = 0;

String prefix = "";

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-ZRxz7NZw-1713297701747)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1563

1563

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?