先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

* 检查结果

* **小结**

+ 实现自动化脚本开发的设计思路分析

### 02:全量及增量采集脚本运行

* **目标**:实现全量采集脚本的运行

* **实施**

+ **全量目标**:将所有需要将实现全量采集的表进行全量采集存储到HDFS上

- Oracle表:组织机构信息、地区信息、服务商信息、数据字典等

- HDFS路径

```

/data/dw/ods/one_make/full_imp/表名/日期

```

+ **增量目标**:将所有需要将实现全量采集的表进行增量采集存储到HDFS上

- 工单数据信息、呼叫中心信息、物料仓储信息、报销费用信息等

- HDFS路径

```

/data/dw/ods/one_make/incr_imp/表名/日期

```

+ **运行脚本**

- 全量采集

```

cd /opt/sqoop/one_make

sh -x full_import_tables.sh

```

* 脚本中特殊的一些参数

- –outdir:Sqoop解析出来的MR的Java程序等输出文件输出的文件

- 增量采集

```

cd /opt/sqoop/one_make

sh -x incr_import_tables.sh

```

+ 特殊问题

- 因oracle表特殊字段类型,导致sqoop导数据任务失败

- oracle字段类型为: clob或date等特殊类型

- 解决方案:在sqoop命令中添加参数,指定特殊类型字段列(**SERIAL\_NUM**)的数据类型为string

* `—map-column-java SERIAL_NUM=String`

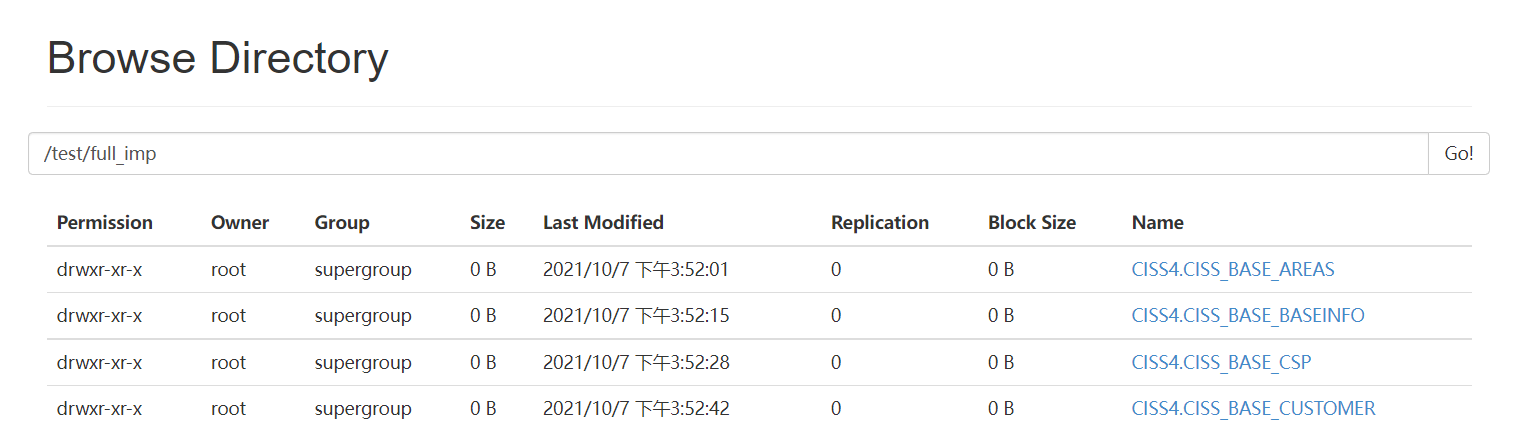

+ **查看结果**

- /data/dw/ods/one\_make/full\_imp:44张表

- /data/dw/ods/one\_make/incr\_imp:57张表

* **小结**

+ 实现全量采集脚本的运行

### 03:Schema备份及上传

* **目标**:了解如何实现采集数据备份

* **实施**

+ 需求:将每张表的Schema进行上传到HDFS上,归档并且备份

+ **Avro文件本地存储**

```

workhome=/opt/sqoop/one_make

--outdir ${workhome}/java_code

```

- **Avro文件HDFS存储**

```

hdfs\_schema\_dir=/data/dw/ods/one_make/avsc

hdfs dfs -put ${workhome}/java_code/*.avsc ${hdfs\_schema\_dir}

```

- **Avro文件本地打包**

```

local\_schema\_backup\_filename=schema_${biz\_date}.tar.gz

tar -czf ${local\_schema\_backup\_filename} ./java_code/*.avsc

```

- **Avro文件HDFS备份**

```

hdfs\_schema\_backup\_filename=${hdfs\_schema\_dir}/avro_schema_${biz\_date}.tar.gz

hdfs dfs -put ${local\_schema\_backup\_filename} ${hdfs\_schema\_backup\_filename}

```

- 运行测试

```

cd /opt/sqoop/one_make/

./upload_avro_schema.sh

```

- 验证结果

```

/data/dw/ods/one_make/avsc/

*.avsc

schema_20210101.tar.gz

```

+ **小结**

+ 了解如何实现采集数据备份

### 04:Python脚本

* **目标**:了解如何使用Python脚本如何实现

* **实施**

+ **原理本质**

- 问题:所有的操作是Sqoop、HDFS等命令操作,如何能通过Python代码控制?

- 解决:本质上是使用Python执行了Linux的Shell命令来实现的

- 导包

# 用于实现执行系统操作的包

import os

# 用于实现执行Linux的命令的包

import subprocess

# 用于实现日期获取解析的包

import datetime

# 用于执行时间操作的包

import time

# 用于做日志记录的包

import logging

* **核心代码解析**

+ subprocess

```

call(String:LinuxCommand):用于提交Linux命令的方法

```

+ logging

```

basicConfig(level,filename,filemode,format):用于配置日志记录的方式

info(Messege):用于记录具体的日志内容

```

+ time

```

sleep(15) :休眠15s

```

以下是一个示例代码,主人可以通过该代码调用Sqoop命令将数据从MySQL导入HDFS,并在日志中记录操作结果:

import subprocess

import logging

import time

配置日志记录方式

logging.basicConfig(level=logging.INFO, filename=‘sqoop.log’, filemode=‘w’, format=‘%(asctime)s - %(levelname)s - %(message)s’)

定义Sqoop命令

sqoop_command = “sqoop import --connect jdbc:mysql://localhost:3306/mydb --username root --password password --table mytable --target-dir /user/myuser/mytable”

提交Sqoop命令并记录日志

logging.info(“主人,我要开始导入数据啦~”)

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-Wmap1a4d-1713381779593)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1053

1053

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?