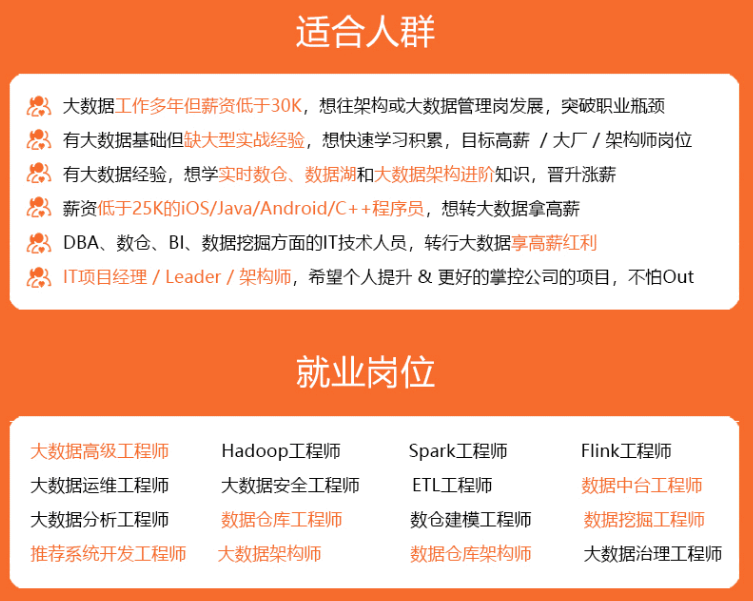

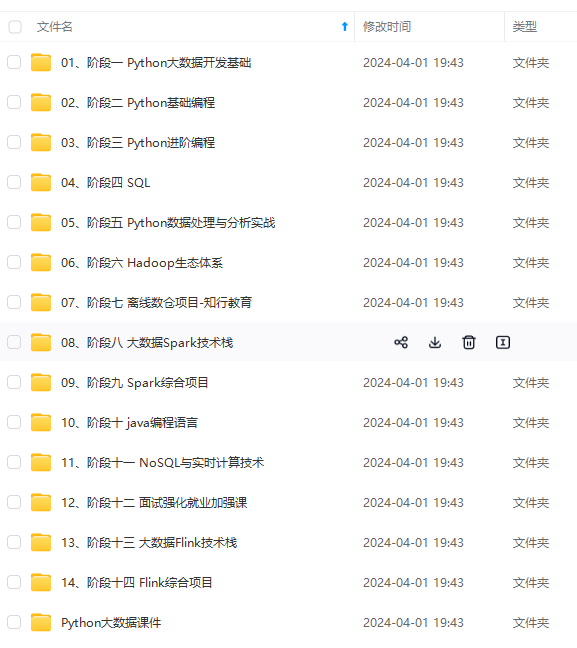

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

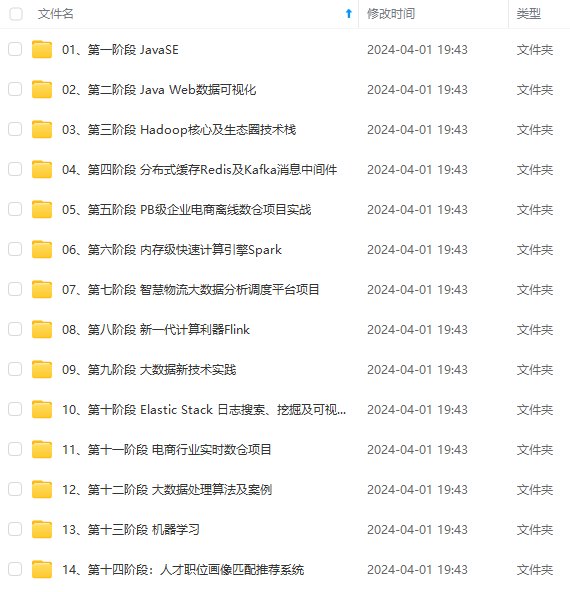

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

三种Shell命令方式:

| hadoop fs | 适用于任何不同的文件系统,比如本地文件系统和HDFS文件系统。 |

|---|---|

| hadoop dfs 和 hdfs dfs | 用法相同,只能适用于HDFS文件系统。 |

hadoop常用命令

创建

创建目录

# –mkdir

# 创建目录

hdfs dfs –mkdir /文件

递归创建

# -mkdir -p

# 递归创建

hdfs dfs -mkdir -p /hdfs/fs

查看

查看目录

# -ls

# 查看目录

hdfs dfs –ls /

查看文件

# -cat

# 查看文件

hdfs dfs –cat /文件 # (绝对路径)

查看数据

# head

# 查看前几行数据

hdfs dfs –cat /文件 | head -5

# tail

# 查看后几行数据

hdfs dfs –cat /文件 | tail -5

搜索文件

# -find

# 从根目录下精确搜索文件,返回查找的文件路径

hdfs dfs -find / -name 要搜索的文件名

# 从指定目录下搜索名称中包含ex字符串的文件

hdfs dfs -find /指定的目录 -name "ex"

查看文件夹的大小信息

# -du

# 查看文件夹的大小信息

hdfs dfs -du /文件路径

hdfs dfs -du -h /文件 ( -h 文件大小转化显示)

统计目录下文件夹数量 文件数量 目录下文件总字节数。

# -count

# 统计目录下文件夹数量 文件数量 目录下文件总字节数。

hdfs dfs -count /要统计的目录

# 结果每列含义:==目录数 文件数 总大小(字节) 目录名称

wc命令

# 查看文件行数

hdfs dfs –cat /文件 | wc -l

wc命令统计指定文件中的行数、字数、字节数,并将统计结果显示输出

# wc命令的用法:

hdfs dfs –cat /文件 | wc -参数

- 命令参数:

- 命令参数:

- -c 统计字节数。

- -l 统计行数。

- -m 统计字符数。

- -w 统计字数。一个字被定义为由空白、跳格或换行字符分隔的字符串。

- -L 打印最长行的长度。

- 查看前几行数据

hdfs dfs –cat /文件 | head -5- 查看后几行数据

hdfs dfs –cat /文件 | tail -5

文件操作

本地文件上传到hdfs下的test目录

# -put

# 本地文件上传到hdfs下的test目录

hdfs dfs –put /文件 /test

从hdfs上把文件复制到本地 -get

# -get

# 从hdfs上把文件复制到本地 -get

hdfs dfs -get /hdfs文件 /本地文件存放路径

hdfs中移动文件和目录

# -mv

# 移动文件和目录

hdfs dfs -mv /源目录 /目标目录

从HDFS的一个路径拷贝到HDFS的另一个路径

# 从HDFS的一个路径拷贝到HDFS的另一个路径

hdfs dfs -cp /要拷贝的文件 /目标路径

更改用户组和用户

# 更改用户组和用户

hdfs dfs -chown 要指定的用户:要制定的用户组 /要指定的文件名

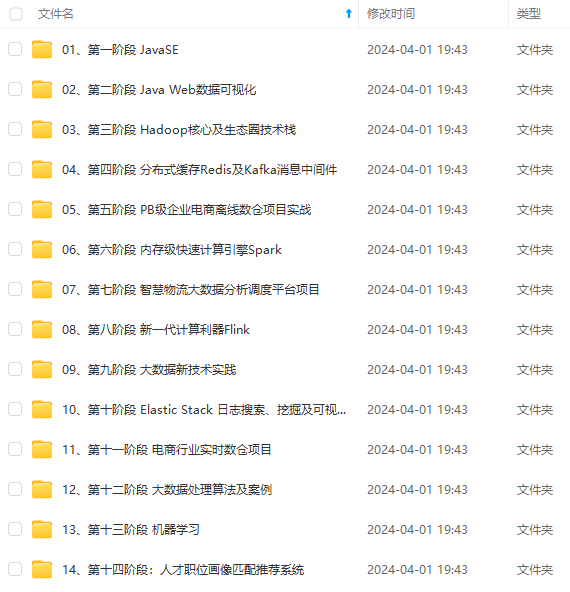

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

qaiu4s-1715307460736)]

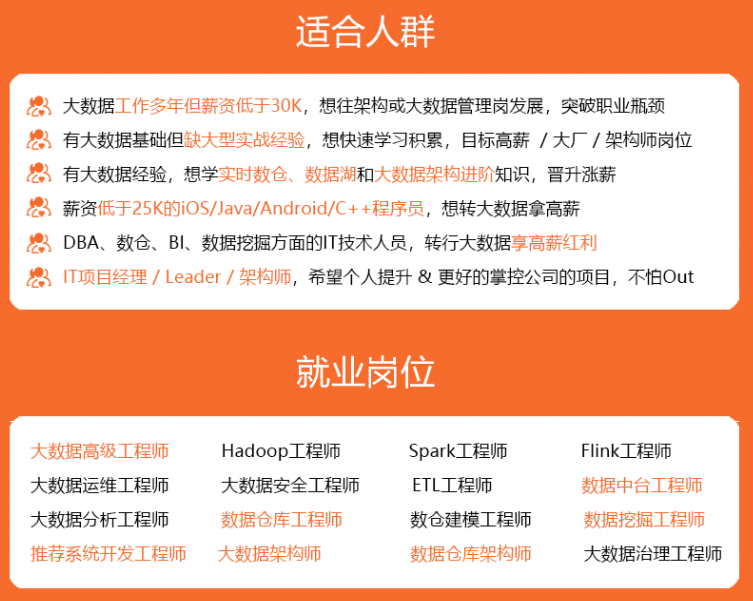

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

1144

1144

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?