网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

文章目录

一、你是如何实现 Flume 数据传输的监控的

使用第三方框架 Ganglia 实时监控 Flume。

二、Flume 的 Source,Sink,Channel 的作用?你们 Source 是什么类型?

1、作用

(1)Source 组件是专门用来收集数据的,可以处理各种类型、各种格式的日志数据,包括 avro、thrift、exec、jms、spooling directory、netcat、sequence generator、syslog、http、legacy

(2)Channel 组件对采集到的数据进行缓存,可以存放在 Memory 或 File 中。

(3)Sink 组件是用于把数据发送到目的地的组件,目的地包括 HDFS、Logger、avro、thrift、ipc、file、Hbase、solr、自定义。

2、我公司采用的 Source 类型为

(1)监控后台日志:exec

(2)监控后台产生日志的端口:netcat Exec spooldir

三、Flume 的 Channel Selectors

四、Flume 参数调优

- Source

增加 Source 个(使用 Tair Dir Source 时可增加 FileGroups 个数)可以增大 Source 的读取数据的能力。例如:当某一个目录产生的文件过多时需要将这个文件目录拆分成多个文件目录,同时配置好多个 Source 以保证 Source 有足够的能力获取到新产生的数据。

batchSize 参数决定 Source 一次批量运输到 Channel 的 event 条数,适当调大这个参数可以提高 Source 搬运 Event 到 Channel 时的性能。

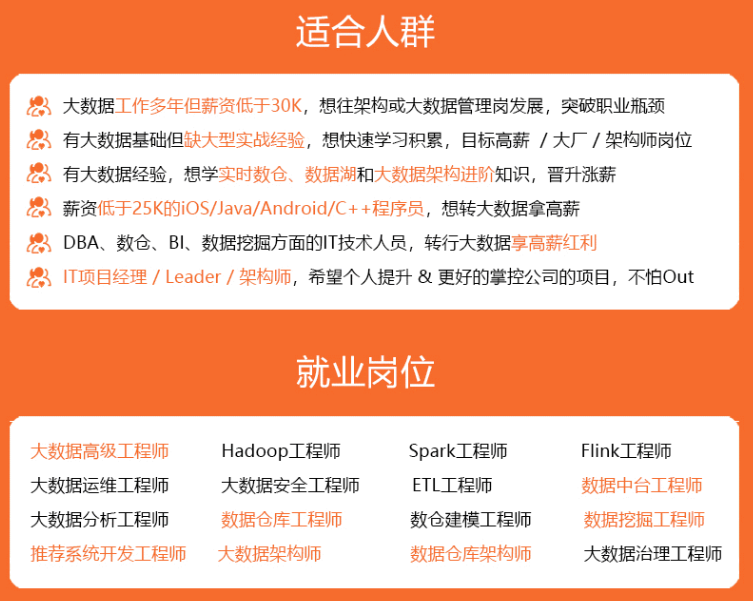

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

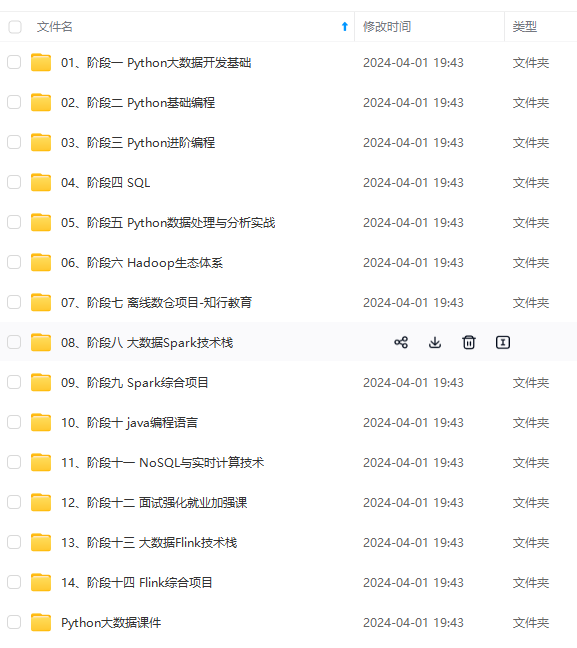

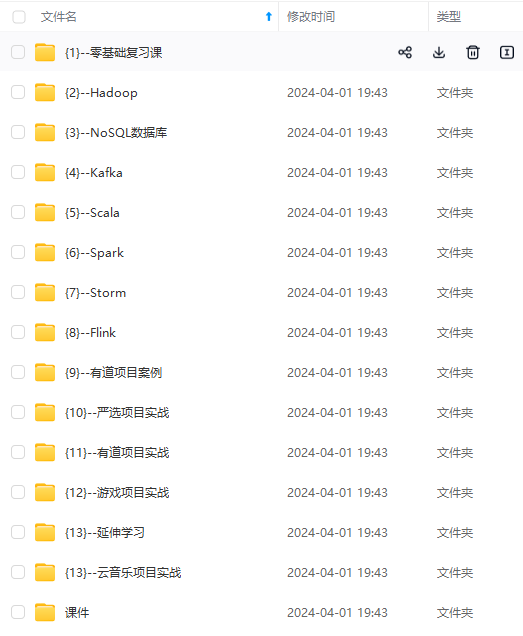

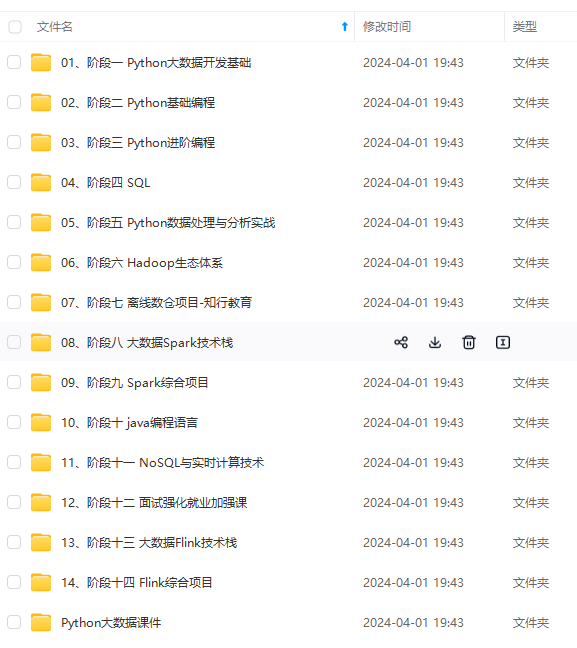

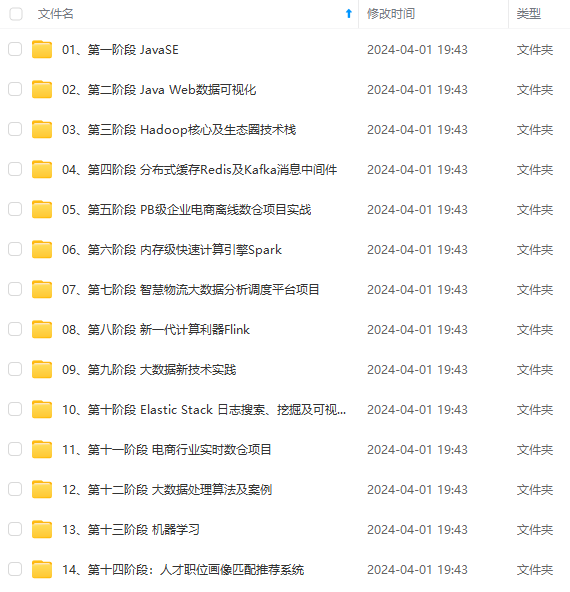

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

且后续会持续更新**

本文讲述了如何通过Flume进行数据传输监控,包括Source、Sink和Channel的作用,以及Flume参数调优技巧。还介绍了适用于不同水平的系统化IT学习资料,覆盖大数据知识点,提供全面的学习资源和持续更新的服务。

本文讲述了如何通过Flume进行数据传输监控,包括Source、Sink和Channel的作用,以及Flume参数调优技巧。还介绍了适用于不同水平的系统化IT学习资料,覆盖大数据知识点,提供全面的学习资源和持续更新的服务。

316

316

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?