给大家的福利

零基础入门

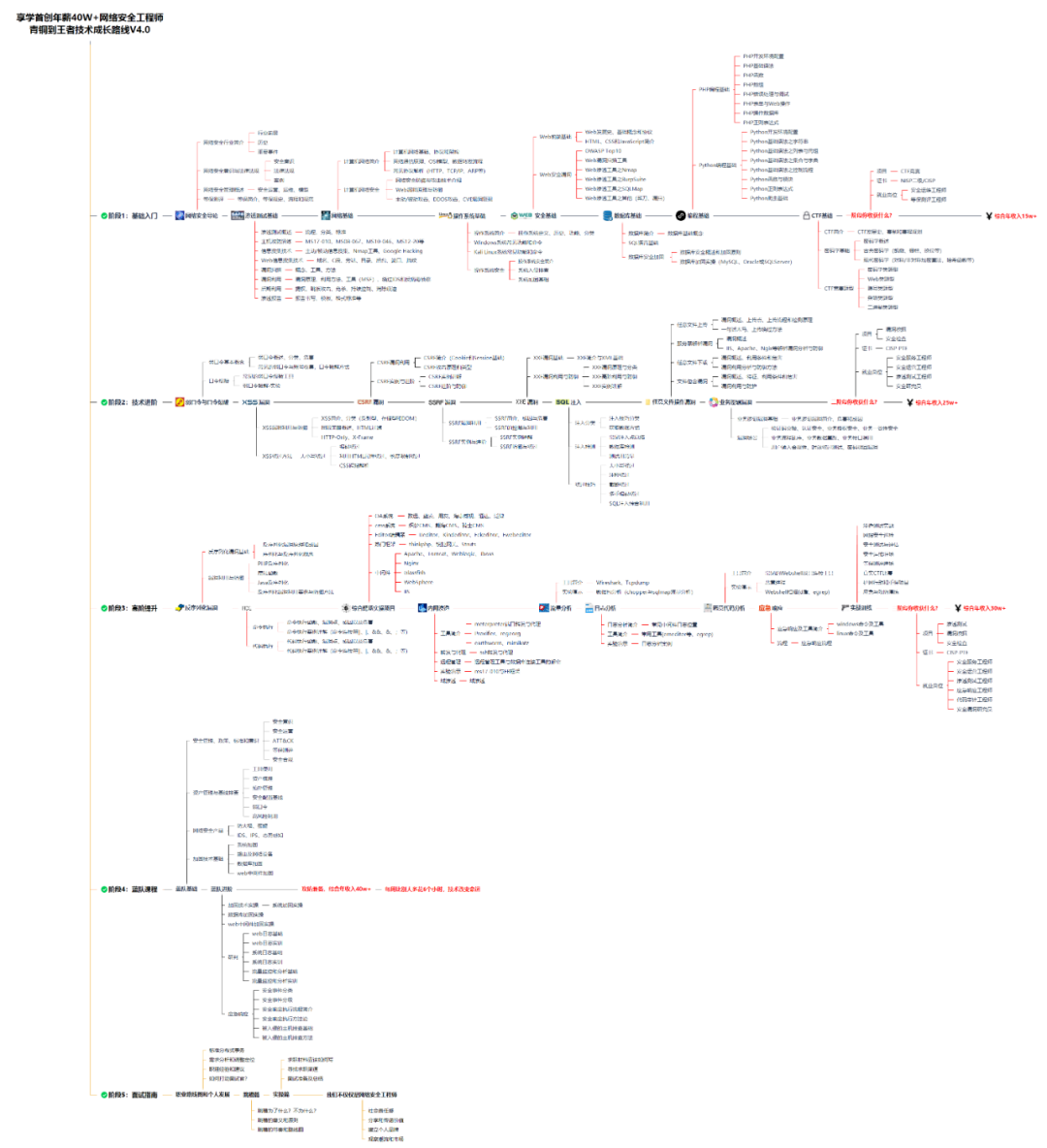

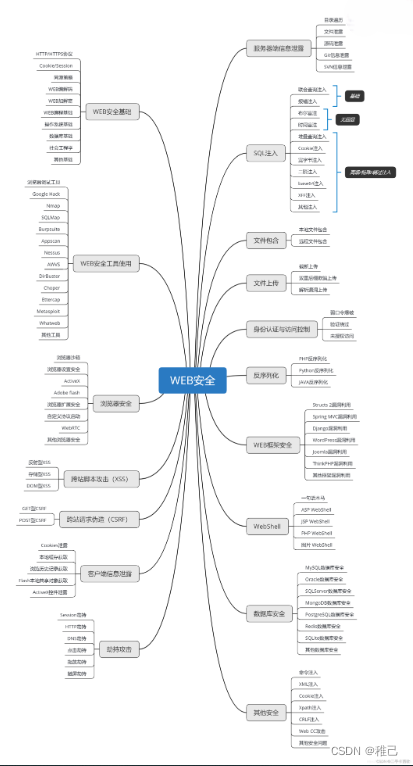

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

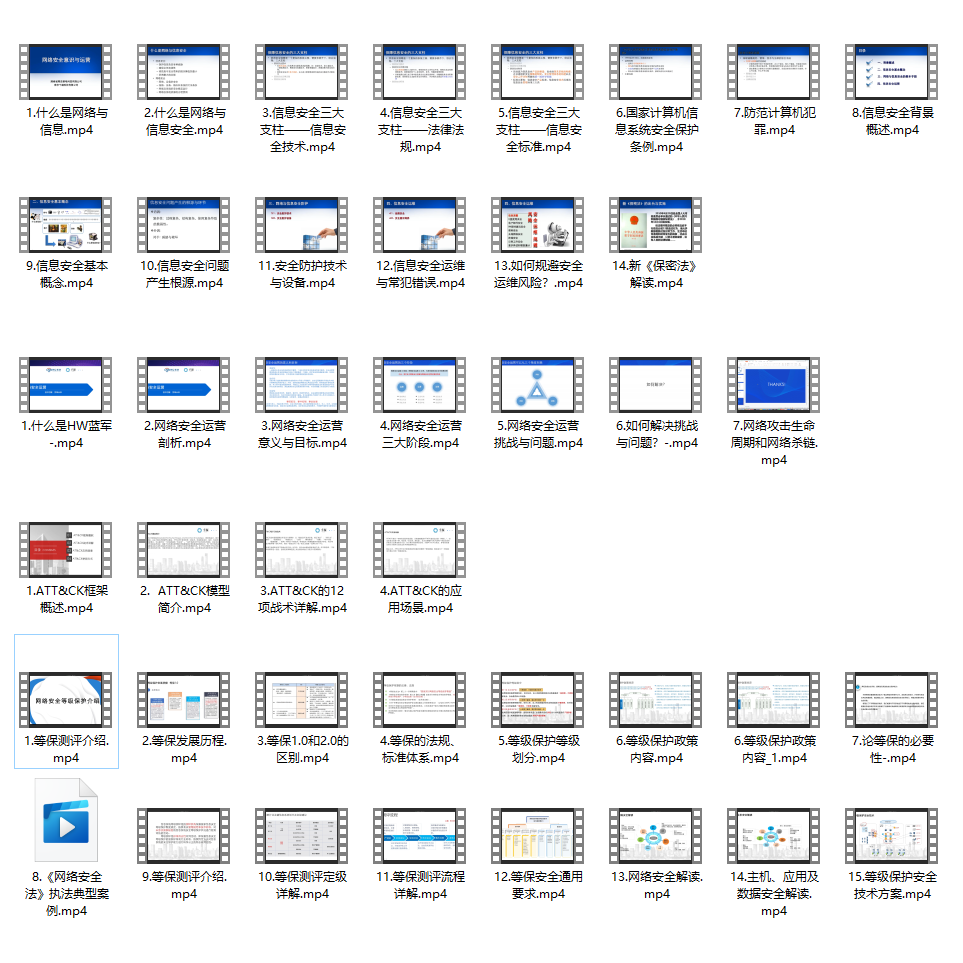

同时每个成长路线对应的板块都有配套的视频提供:

因篇幅有限,仅展示部分资料

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

config

connect-console-sink.properties connect-mirror-maker.properties server.properties

connect-console-source.properties connect-standalone.properties tools-log4j.properties

connect-distributed.properties consumer.properties trogdor.conf

connect-file-sink.properties kraft zookeeper.properties

connect-file-source.properties log4j.properties

connect-log4j.properties producer.properties

配置文件

server.properties

- broker.id: 唯一id值,通过环境变量设置为了1

- log.dirs: kafka集群日志目录,默认是log.dirs=/bitnami/kafka/data

- zookeeper.connect:zookeeper地址端口,格式域名/ip:port,这块是zookeeper:2181,在docker的网络中可以解析为另一容器的ip

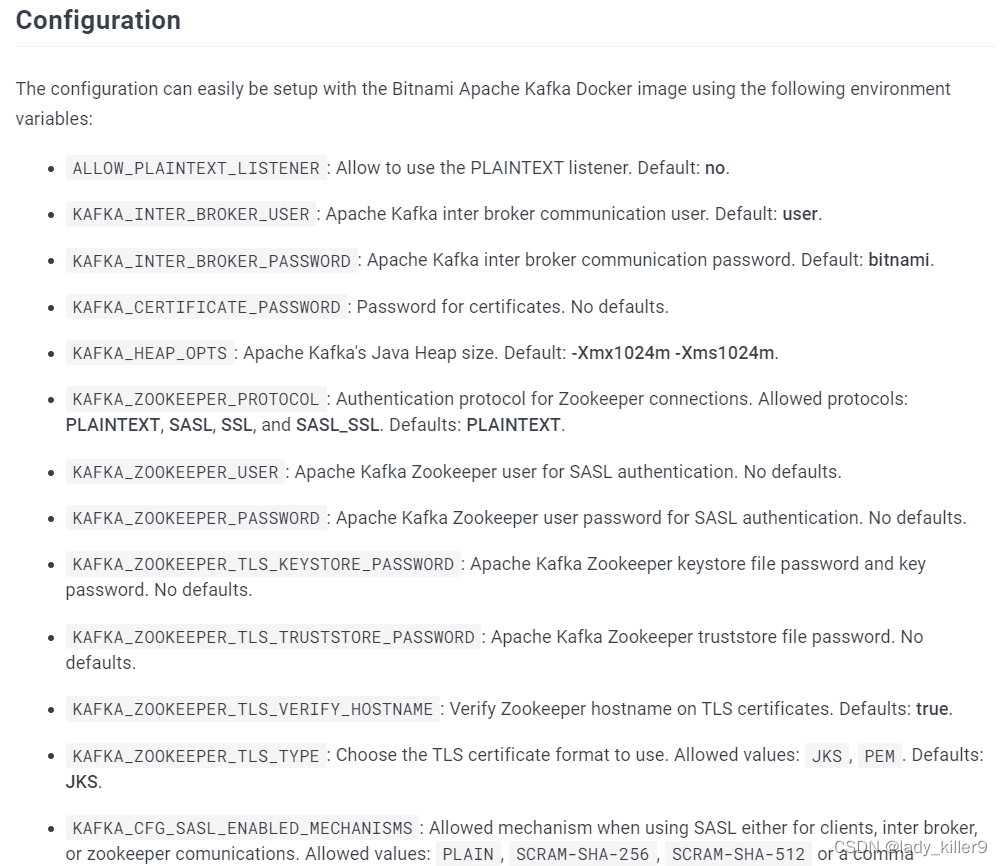

更多配置可以查看参考中Dockerhub链接的Configuration部分

producer.properties

- bootstrap.servers:kafka的ip:port,这里是localhost:9092

- compression.type:压缩类型,默认是none, 一共有四种,none, gzip, snappy, lz4, zstd,推荐排序LZ4 > GZIP > Snappy,详见腾讯云压缩算法对比

consumer.properties

- group.id:消费者组id,默认为test-consumer-group

- auto.offset.reset:offset设置,三种latest, earliest, none,看情况设置

命令行简单使用

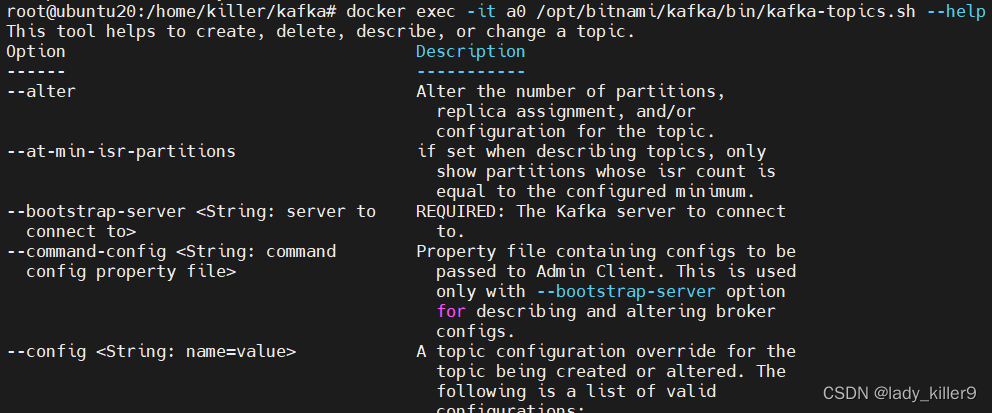

kafka-topics.sh

对主题topic进行增删改查的工具

常用选项如下:

- –bootstrap-server:kafka服务器ip:port,必须的

- –create:创建主题

- –delete:删除主题

- –describe:描述主题

- –list:查看主题列表

- –alter:修改主题的 partitions等

- –topic <String: topic>:主题名

- –topic-id <String: topic-id>:主题id

- –partitions <Integer: # of partitions>:主题的partition

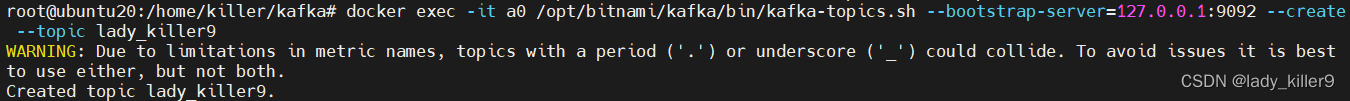

新增

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-topics.sh --bootstrap-server=127.0.0.1:9092 --create --topic lady_killer9

截图

查看列表

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-topics.sh --bootstrap-server=127.0.0.1:9092 --list

截图

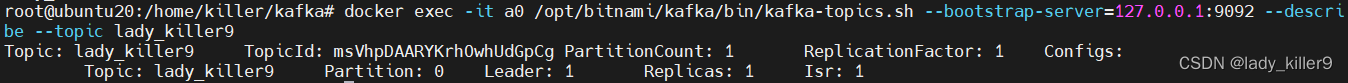

查看详情

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-topics.sh --bootstrap-server=127.0.0.1:9092 --describe --topic lady_killer9

截图

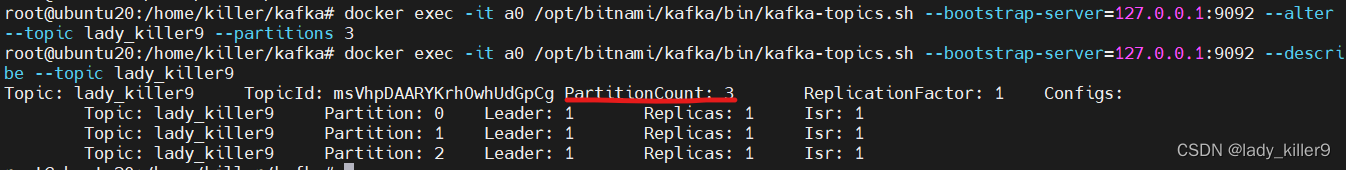

修改

命令

以修改主题partiion数量为例

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-topics.sh --bootstrap-server=127.0.0.1:9092 --alter --topic lady_killer9 --partitions 3

截图

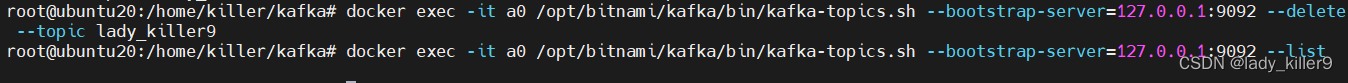

删除

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-topics.sh --bootstrap-server=127.0.0.1:9092 --delete --topic lady_killer9

截图

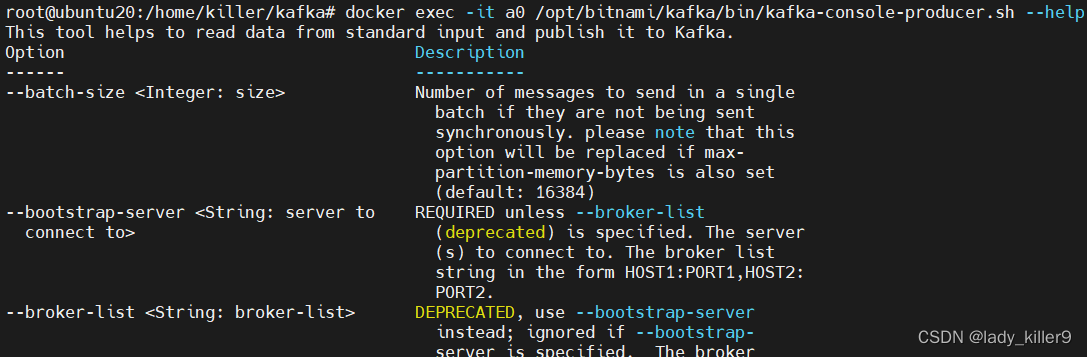

kafka-console-producer.sh

标准输入读数据,发送到Kafka的工具

常用选项如下:

- –bootstrap-server:kafka服务器ip:port,必须的

- –topic <String: topic> :Kafka主题,必须的

- –sync:同步发送

- –compression-codec [String: compression-codec] :压缩方式,‘none’,‘gzip’, ‘snappy’, ‘lz4’, , ‘zstd’,默认gzip.

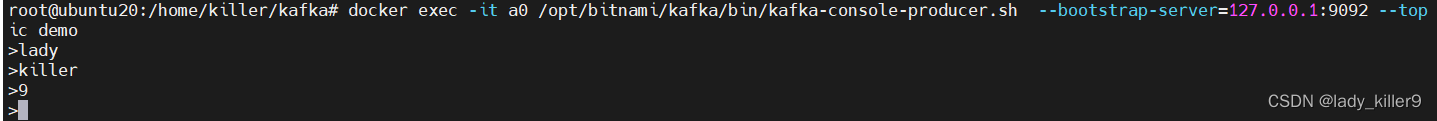

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-topics.sh --bootstrap-server=127.0.0.1:9092 --create --topic demo

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-console-producer.sh --bootstrap-server=127.0.0.1:9092 --topic demo

截图

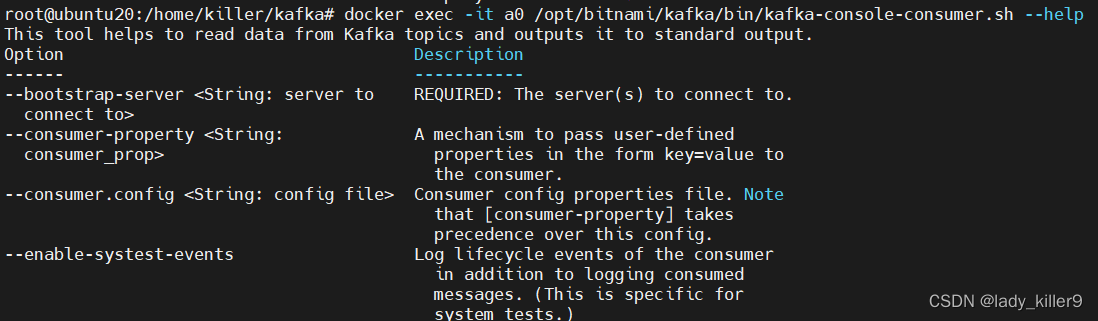

kafka-console-consumer.sh

常用选项如下:

- –bootstrap-server:kafka服务器ip:port,必须的

- –topic <String: topic> :Kafka主题,必须的

- –group <String: consumer group id>:消费者组id

- –key-deserializer <String: deserializer for key>:key反序列化,默认是org.apache.kafka.common.serialization.StringDeserializer

- –value-deserializer <String: deserializer for values>:value反序列化,默认是org.apache.kafka.common.serialization.StringDeserializer

- –offset <String: consume offset>:消费的offset

- –partition <Integer: partition>:消费的分区

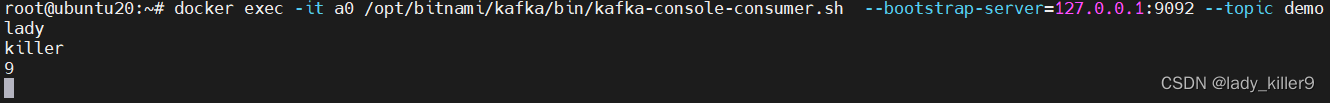

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-console-consumer.sh --bootstrap-server=127.0.0.1:9092 --topic demo

截图

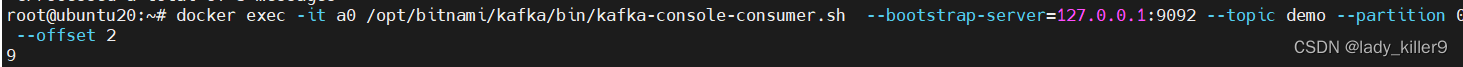

命令

docker exec -it a0 /opt/bitnami/kafka/bin/kafka-console-consumer.sh --bootstrap-server=127.0.0.1:9092 --topic demo --partition 0 --offset 2

截图

上手之后我们再来了解一些概念。

概念

集群

已发布的消息保存在一组服务器中,称为Kafka集群。

代理broker

集群中的每一个服务器都是一个代理。

主题topic

每条发布到kafka集群的消息都有一个主题,这个主题被称为topic。每个topic都由一个或者多个分区构成。

分区partition

topic的partition数量可以在创建时配置,partition数量决定了每个消费者组中并发消费者的最大数量。

分区的原则:

- 生产者指定了partition,则直接使用

- 未指定partition但指定了key,通过对key的value进行hash出一个partition

- partition和key都未指定,使用轮询选出一个partition

偏移量offset

任何发布到partition的消息都会被直接追加到partition尾部,每条消息的位置称为offset,offset是一个long型数字,它唯一标记一条消息。消费者可以通过(topic、partition、offset)跟踪记录。

生产者producer

push消息到topc的叫生产者,push后可以获得offset。生产者可以指定partition,但不建议这么做。

消费者组consumer group

包含多个消费者,有一个 group id,可以订阅topic进行消费。消费偏移以消费者组为单位。

消费者consumer

学习路线:

这个方向初期比较容易入门一些,掌握一些基本技术,拿起各种现成的工具就可以开黑了。不过,要想从脚本小子变成黑客大神,这个方向越往后,需要学习和掌握的东西就会越来越多以下是网络渗透需要学习的内容:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

本文为从未接触过网络安全的读者提供了一个详细的学习路径,包括Kafka的配置、命令行使用以及学习建议。强调了系统化学习的重要性,鼓励加入技术交流社群以共同成长。

本文为从未接触过网络安全的读者提供了一个详细的学习路径,包括Kafka的配置、命令行使用以及学习建议。强调了系统化学习的重要性,鼓励加入技术交流社群以共同成长。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?