在结束之际,我想重申的是,学习并非如攀登险峻高峰,而是如滴水穿石般的持久累积。尤其当我们步入工作岗位之后,持之以恒的学习变得愈发不易,如同在茫茫大海中独自划舟,稍有松懈便可能被巨浪吞噬。然而,对于我们程序员而言,学习是生存之本,是我们在激烈市场竞争中立于不败之地的关键。一旦停止学习,我们便如同逆水行舟,不进则退,终将被时代的洪流所淘汰。因此,不断汲取新知识,不仅是对自己的提升,更是对自己的一份珍贵投资。让我们不断磨砺自己,与时代共同进步,书写属于我们的辉煌篇章。

需要完整版PDF学习资源

需要体系化学习资料的朋友,可以加我V获取:vip204888 (备注网络安全)

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

CogVLM:强大的开源视觉语言模型

CogVLM是一个强大的开源视觉语言模型。CogVLM-17B拥有100亿的视觉参数和70亿的语言参数,支持490*490分辨率的图像理解和多轮对话。CogVLM-17B在10个经典的跨模态基准测试中取得了最佳性能,包括NoCaps, Flicker30k captioning, RefCOCO, RefCOCO+, RefCOCOg, Visual7W, GQA, ScienceQA, VizWiz VQA和TDIUC,并在VQAv2, OKVQA, TextVQA, COCO字幕等方面排名第二,超越或匹敌PaLI-X 55B。CogVLM还可以和您聊关于图片的话题。

CogVLM的论文:https://arxiv.org/abs/2311.03079

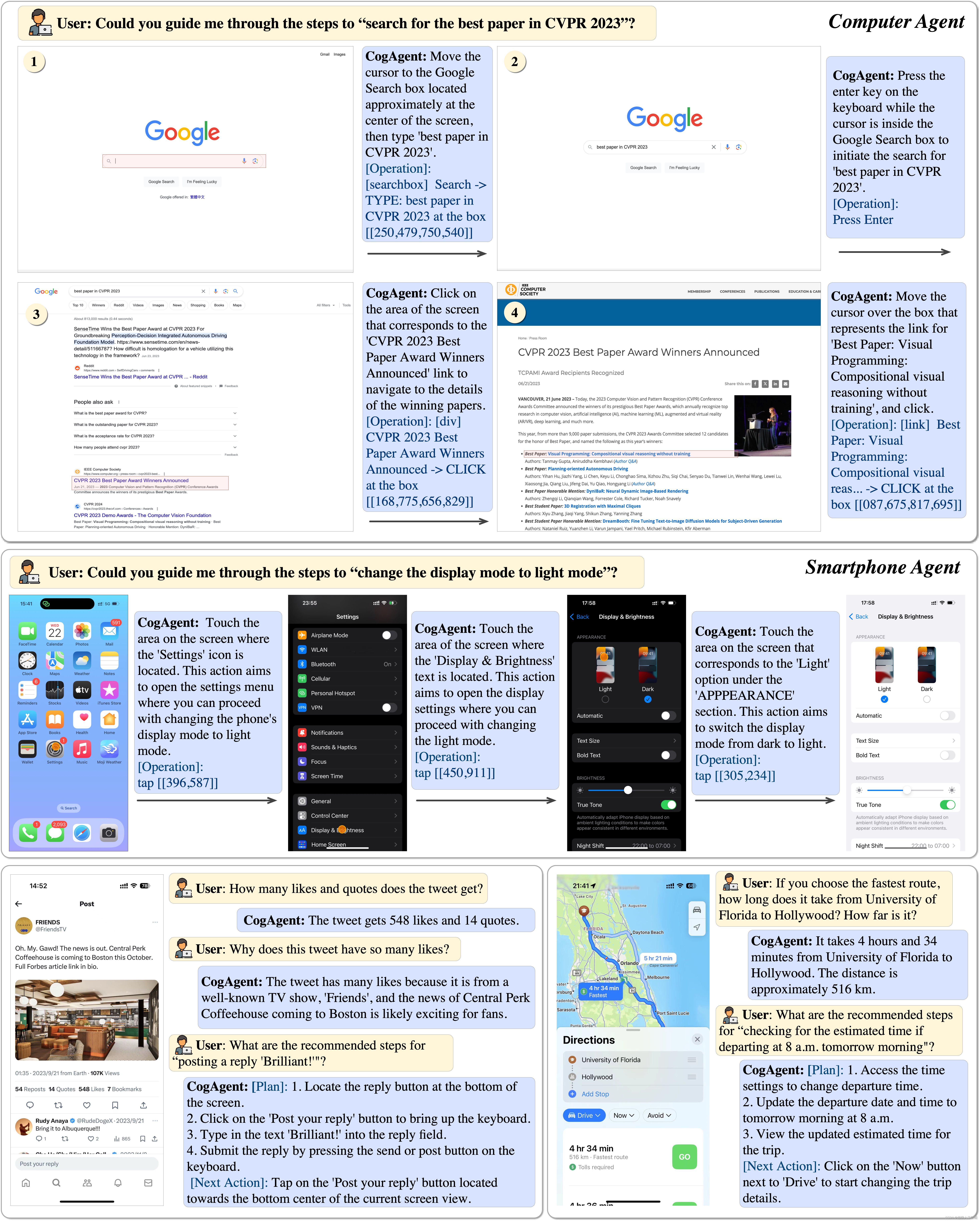

CogAgent:基于CogVLM的视觉语言模型

CogAgent是基于CogVLM改进的开源视觉语言模型。CogAgent-18B拥有110亿的视觉参数和70亿的语言参数,支持1120*1120分辨率的图像理解。在CogVLM的能力之上,CogAgent进一步拥有了图形用户界面(GUI)Agent的能力。

CogAgent在9个经典的跨模态基准测试中实现了最先进的通用性能,包括VQAv2, OK-VQ, TextVQA, ST-VQA, ChartQA, infoVQA, DocVQA, MM-Vet, 和 POPE测试基准。它在如AITW和Mind2Web等GUI操作数据集上显著超越了现有的模型。除了CogVLM已有的所有功能(视觉多轮对话,视觉定位)之外,CogAgent支持更高分辨率的视觉输入和对话式问答,拥有视觉Agent的能力,并通过改进预训练和微调,提高了OCR相关任务的能力。

CogAgent的论文:https://arxiv.org/abs/2312.08914

如何开始使用CogVLM和CogAgent

-

使用网页演示进行推理:您可以直接访问我们的CogVLM & CogAgent Web Demo进行体验。

-

自行部署CogVLM / CogAgent:我们提供了详细的部署指南,包括命令行界面和网络演示的部署方式。您可以根据需要选择合适的方式。

-

微调CogAgent / CogVLM:如果您想在自己的任务中使用CogVLM,我们提供了详细的微调指南,帮助您实现不同的输出风格或领域知识。

-

OpenAI格式:我们提供了与GPT-4V相同的API示例,您可以在openai_demo文件夹中查看。

详细用法请见GitHub页面。

硬件需求

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要体系化学习资料的朋友,可以加我V获取:vip204888 (备注网络安全)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?