Java提供了很多网络编程相关的类库,但为了方便我们编写爬虫程序,可以引入一些第三方库,如HttpClient、Jsoup等。这些库提供了更简洁、易用的接口,帮助我们快速实现爬虫功能。

三:网络请求与响应处理

3.1 使用Java的HttpURLConnection发送HTTP请求

Java的HttpURLConnection类可以帮助我们发送HTTP请求,并获取相应的HTTP响应。我们可以设置请求头、请求方法、请求参数等信息,来模拟浏览器行为。

以下是使用Java的HttpURLConnection发送HTTP请求的示例代码:

import java.io.BufferedReader;

import java.io.InputStreamReader;

import java.net.HttpURLConnection;

import java.net.URL;

public class HttpClientExample {

public static void main(String[] args) {

try {

// 创建URL对象,指定需要发送请求的网址

URL url = new URL("http://example.com");

// 打开连接

HttpURLConnection connection = (HttpURLConnection) url.openConnection();

// 设置请求方法为GET

connection.setRequestMethod("GET");

// 设置请求头信息

connection.setRequestProperty("User-Agent", "Mozilla/5.0");

// 获取响应码

int responseCode = connection.getResponseCode();

// 如果响应码为200,表示请求成功

if (responseCode == HttpURLConnection.HTTP\_OK) {

// 获取响应流

BufferedReader reader = new BufferedReader(new InputStreamReader(connection.getInputStream()));

String line;

StringBuilder response = new StringBuilder();

// 读取响应内容

while ((line = reader.readLine()) != null) {

response.append(line);

}

reader.close();

// 打印响应内容

System.out.println(response.toString());

} else {

System.out.println("请求失败,响应码:" + responseCode);

}

// 关闭连接

connection.disconnect();

} catch (Exception e) {

e.printStackTrace();

}

}

}

以上代码使用HttpURLConnection发送了一个GET请求,并打印响应内容。在实际使用中,我们可以根据需要设置请求头、请求方法、请求参数等信息,以及处理响应内容。

3.2 使用Apache HttpClient发送HTTP请求

Apache HttpClient是一个功能强大的开源HTTP客户端库,提供了更方便、灵活的方式发送HTTP请求,同时支持连接池、重试机制等功能。

以下是使用Apache HttpClient发送HTTP请求的示例代码:

import org.apache.http.HttpEntity;

import org.apache.http.client.methods.CloseableHttpResponse;

import org.apache.http.client.methods.HttpGet;

import org.apache.http.impl.client.CloseableHttpClient;

import org.apache.http.impl.client.HttpClients;

import org.apache.http.util.EntityUtils;

public class HttpClientExample {

public static void main(String[] args) {

// 创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

try {

// 创建HttpGet对象,指定需要发送请求的网址

HttpGet httpGet = new HttpGet("http://example.com");

// 设置请求头信息

httpGet.setHeader("User-Agent", "Mozilla/5.0");

// 发送请求,获取响应

CloseableHttpResponse response = httpClient.execute(httpGet);

// 获取响应实体

HttpEntity entity = response.getEntity();

// 获取响应内容

String responseBody = EntityUtils.toString(entity);

// 打印响应内容

System.out.println(responseBody);

// 关闭响应实体

EntityUtils.consume(entity);

// 关闭响应

response.close();

} catch (Exception e) {

e.printStackTrace();

} finally {

try {

// 关闭HttpClient

httpClient.close();

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

以上代码使用Apache HttpClient发送了一个GET请求,并打印响应内容。在实际使用中,我们可以根据需要设置请求头、请求方法、请求参数等信息,以及处理响应内容。使用Apache HttpClient可以更方便、灵活地发送HTTP请求,并提供了更多的功能和配置选项。

3.3 处理HTTP响应数据

获取到HTTP响应后,我们需要对其进行处理。可以解析响应头、获取状态码、获取响应体等信息,以便后续的数据提取和处理。

以下是处理HTTP响应数据的示例代码:

import org.apache.http.HttpEntity;

import org.apache.http.client.methods.CloseableHttpResponse;

import org.apache.http.client.methods.HttpGet;

import org.apache.http.impl.client.CloseableHttpClient;

import org.apache.http.impl.client.HttpClients;

import org.apache.http.util.EntityUtils;

public class HttpClientExample {

public static void main(String[] args) {

// 创建HttpClient对象

CloseableHttpClient httpClient = HttpClients.createDefault();

try {

// 创建HttpGet对象,指定需要发送请求的网址

HttpGet httpGet = new HttpGet("http://example.com");

// 设置请求头信息

httpGet.setHeader("User-Agent", "Mozilla/5.0");

// 发送请求,获取响应

CloseableHttpResponse response = httpClient.execute(httpGet);

// 获取响应状态码

int statusCode = response.getStatusLine().getStatusCode();

System.out.println("Status Code: " + statusCode);

// 获取响应头信息

Header[] headers = response.getAllHeaders();

for (Header header : headers) {

System.out.println(header.getName() + ": " + header.getValue());

}

// 获取响应实体

HttpEntity entity = response.getEntity();

// 获取响应内容

String responseBody = EntityUtils.toString(entity);

System.out.println("Response Body: " + responseBody);

// 关闭响应实体

EntityUtils.consume(entity);

// 关闭响应

response.close();

} catch (Exception e) {

e.printStackTrace();

} finally {

try {

// 关闭HttpClient

httpClient.close();

} catch (Exception e) {

e.printStackTrace();

}

}

}

}

以上代码发送了一个GET请求,并获取到了响应的状态码、响应头及响应体的内容,并打印出来。在实际使用中,我们可以根据需要进一步解析和处理响应数据,例如解析JSON格式的响应体、使用XPath或正则表达式提取特定的数据等。处理HTTP响应数据可以根据具体的需求进行灵活的处理和解析。

四:网页解析与数据提取

4.1 使用正则表达式进行简单的数据提取

正则表达式是一种强大的文本匹配工具,可以通过定义特定的模式,从文本中提取所需的数据。在爬虫中,我们可以使用正则表达式来提取网页中的数据。

4.2 使用Jsoup进行HTML解析与数据提取

Jsoup是一款专门用于解析HTML的Java库,它提供了类似于jQuery的选择器语法,可以方便地进行HTML解析和数据提取。

以下是使用Jsoup进行HTML解析与数据提取的示例代码:

import org.jsoup.Jsoup;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

import org.jsoup.select.Elements;

文末有福利领取哦~

---------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

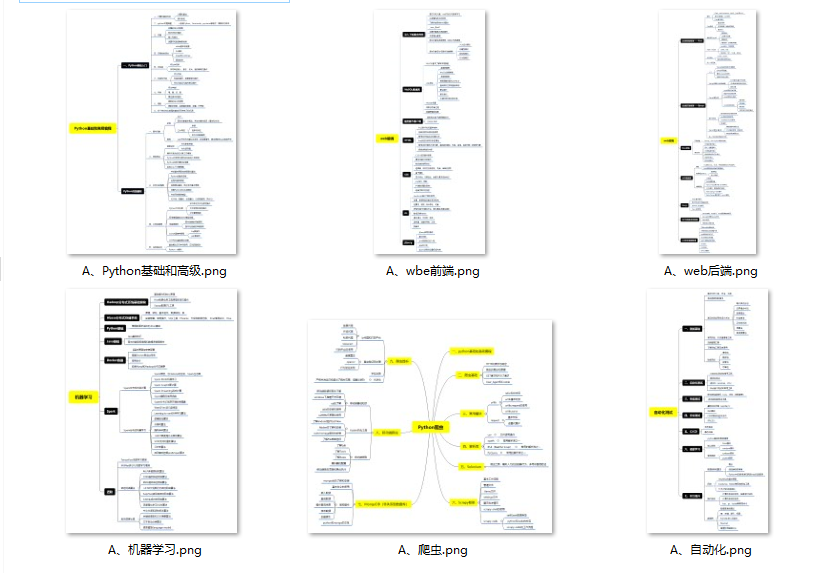

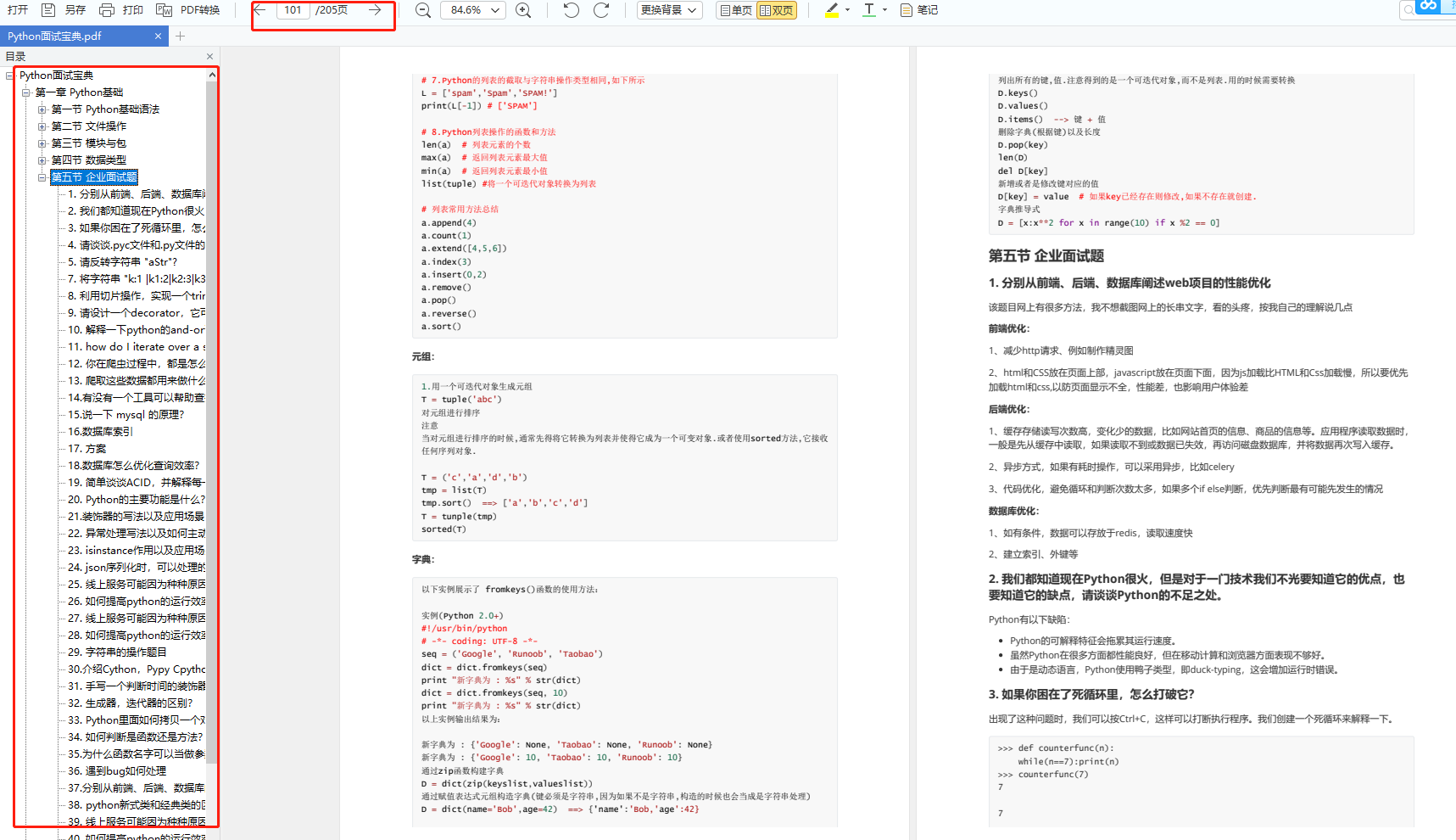

👉**一、Python所有方向的学习路线**

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉**二、Python必备开发工具**

👉**三、Python视频合集**

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

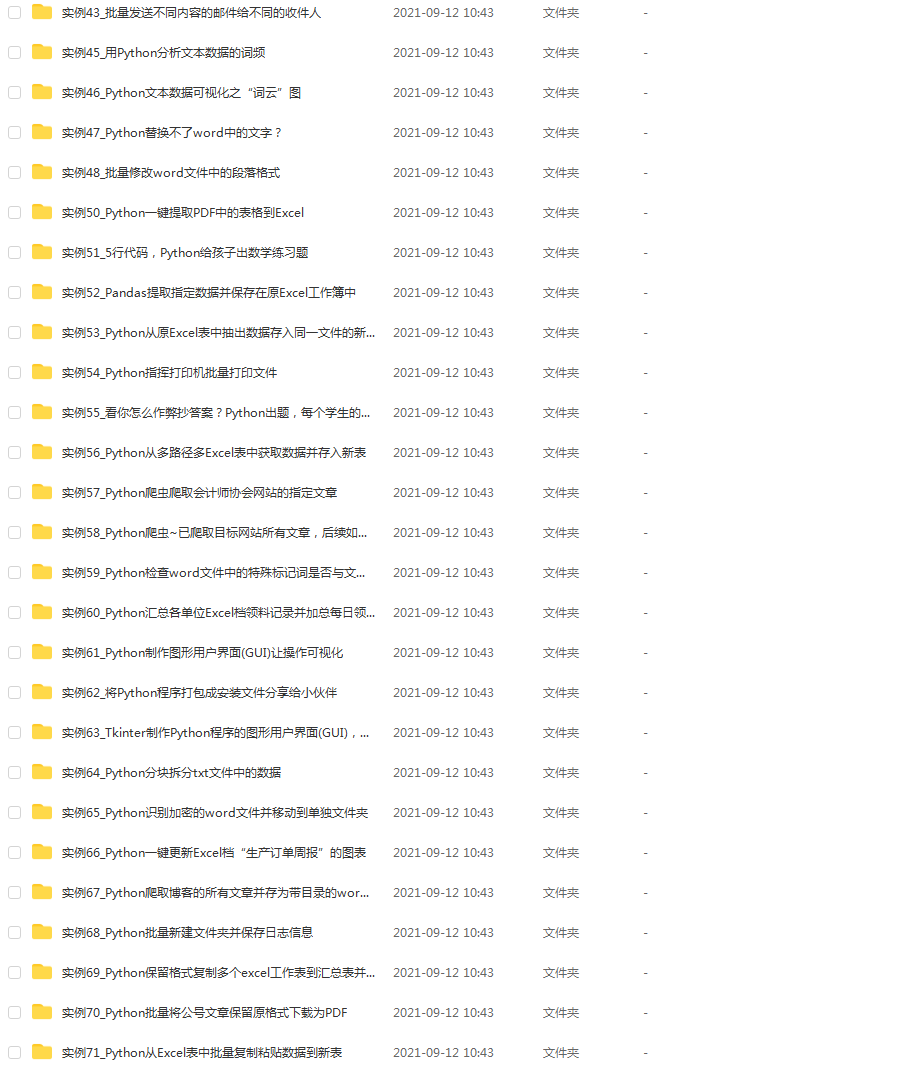

👉 **四、实战案例**

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。**(文末领读者福利)**

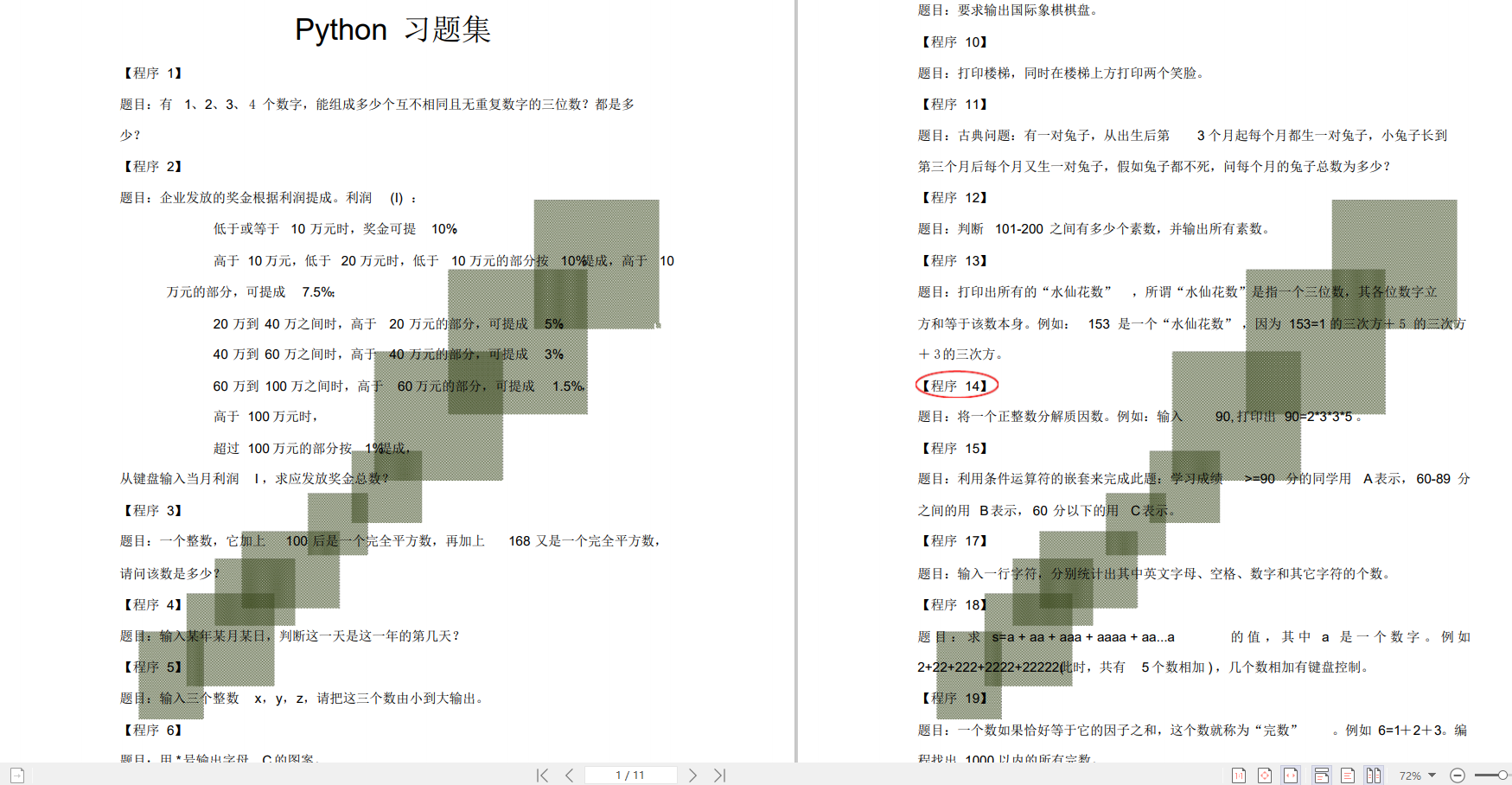

👉**五、Python练习题**

检查学习结果。

👉**六、面试资料**

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

👉因篇幅有限,仅展示部分资料,这份完整版的Python全套学习资料已经上传

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里无偿获取](https://bbs.csdn.net/topics/618317507)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

2168

2168

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?