最后

分享一些系统的面试题,大家可以拿去刷一刷,准备面试涨薪。

这些面试题相对应的技术点:

- JVM

- MySQL

- Mybatis

- MongoDB

- Redis

- Spring

- Spring boot

- Spring cloud

- Kafka

- RabbitMQ

- Nginx

- …

大类就是:

- Java基础

- 数据结构与算法

- 并发编程

- 数据库

- 设计模式

- 微服务

- 消息中间件

artifactId: wikipediaeditstreamdemo

version: 1.0-SNAPSHOT

package: com.bolingcavalry

Y: :

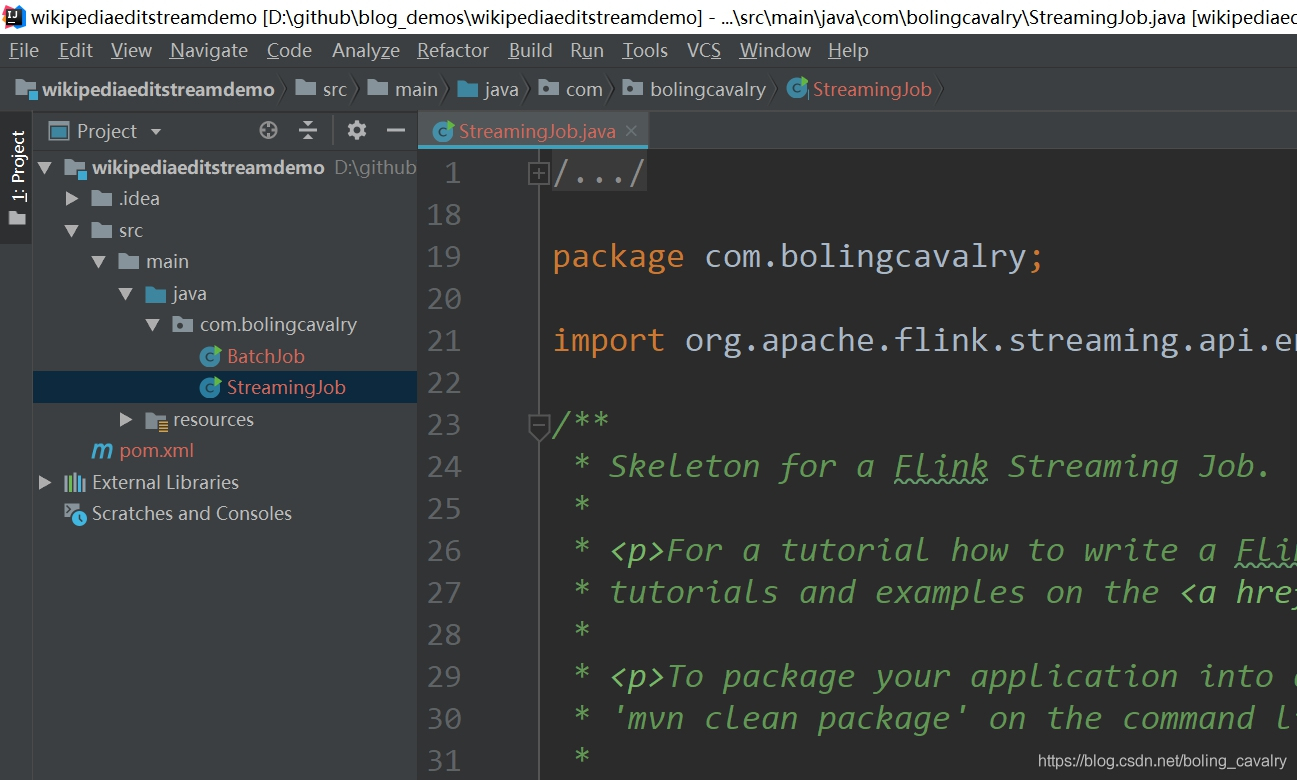

- 用IEDA导入这个maven工程,如下图,已经有了两个类:BatchJob和StreamingJob,BatchJob是用于批处理的,本次实战用不上,因此可以删除,只保留流处理的StreamingJob:

应用创建成功,接下来可以开始编码了;

编码

您可以选择直接从GitHub下载这个工程的源码,地址和链接信息如下表所示:

| 名称 | 链接 | 备注 |

| :-- | :-- | :-- |

| 项目主页 | https://github.com/zq2599/blog_demos | 该项目在GitHub上的主页 |

| git仓库地址(https) | https://github.com/zq2599/blog_demos.git | 该项目源码的仓库地址,https协议 |

| git仓库地址(ssh) | git@github.com:zq2599/blog_demos.git | 该项目源码的仓库地址,ssh协议 |

这个git项目中有多个文件夹,本章源码在wikipediaeditstreamdemo这个文件夹下,如下图红框所示:

接下来开始编码:

- 在pom.mxl文件中增加wikipedia相关的库依赖:

org.apache.flink

flink-connector-wikiedits_2.11

${flink.version}

- 在类中增加代码,如下所示,源码中已加详细注释:

package com.bolingcavalry;

import org.apache.commons.lang3.StringUtils;

import org.apache.flink.api.common.functions.AggregateFunction;

import org.apache.flink.api.common.functions.MapFunction;

import org.apache.flink.api.java.functions.KeySelector;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.api.java.tuple.Tuple3;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.windowing.time.Time;

import org.apache.flink.streaming.connectors.wikiedits.WikipediaEditEvent;

import org.apache.flink.streaming.connectors.wikiedits.WikipediaEditsSource;

public class StreamingJob {

public static void main(String[] args) throws Exception {

// 环境信息

final StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

env.addSource(new WikipediaEditsSource())

//以用户名为key分组

.keyBy((KeySelector<WikipediaEditEvent, String>) wikipediaEditEvent -> wikipediaEditEvent.getUser())

//时间窗口为5秒

.timeWindow(Time.seconds(15))

//在时间窗口内按照key将所有数据做聚合

.aggregate(new AggregateFunction<WikipediaEditEvent, Tuple3<String, Integer, StringBuilder>, Tuple3<String, Integer, StringBuilder>>() {

@Override

public Tuple3<String, Integer, StringBuilder> createAccumulator() {

//创建ACC

return new Tuple3<>(“”, 0, new StringBuilder());

}

@Override

public Tuple3<String, Integer, StringBuilder> add(WikipediaEditEvent wikipediaEditEvent, Tuple3<String, Integer, StringBuilder> tuple3) {

StringBuilder sbud = tuple3.f2;

//如果是第一条记录,就加个"Details :"作为前缀,

//如果不是第一条记录,就用空格作为分隔符

if(StringUtils.isBlank(sbud.toString())){

sbud.append("Details : ");

}else {

sbud.append(" ");

}

//聚合逻辑是将改动的字节数累加

return new Tuple3<>(wikipediaEditEvent.getUser(),

wikipediaEditEvent.getByteDiff() + tuple3.f1,

sbud.append(wikipediaEditEvent.getByteDiff()));

}

@Override

public Tuple3<String, Integer, StringBuilder> getResult(Tuple3<String, Integer, StringBuilder> tuple3) {

return tuple3;

}

@Override

public Tuple3<String, Integer, StringBuilder> merge(Tuple3<String, Integer, StringBuilder> tuple3, Tuple3<String, Integer, StringBuilder> acc1) {

//合并窗口的场景才会用到

return new Tuple3<>(tuple3.f0,

tuple3.f1 + acc1.f1, tuple3.f2.append(acc1.f2));

}

})

//聚合操作后,将每个key的聚合结果单独转为字符串

.map((MapFunction<Tuple3<String, Integer, StringBuilder>, String>) tuple3 -> tuple3.toString())

//输出方式是STDOUT

.print();

// 执行

env.execute(“Flink Streaming Java API Skeleton”);

}

}

至此编码结束;

构建

- 在pom.xml文件所在目录下执行命令:

总结

总体来说,如果你想转行从事程序员的工作,Java开发一定可以作为你的第一选择。但是不管你选择什么编程语言,提升自己的硬件实力才是拿高薪的唯一手段。

如果你以这份学习路线来学习,你会有一个比较系统化的知识网络,也不至于把知识学习得很零散。我个人是完全不建议刚开始就看《Java编程思想》、《Java核心技术》这些书籍,看完你肯定会放弃学习。建议可以看一些视频来学习,当自己能上手再买这些书看又是非常有收获的事了。

定会放弃学习。建议可以看一些视频来学习,当自己能上手再买这些书看又是非常有收获的事了。

[外链图片转存中…(img-mP950xCp-1715303472861)]

1278

1278

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?