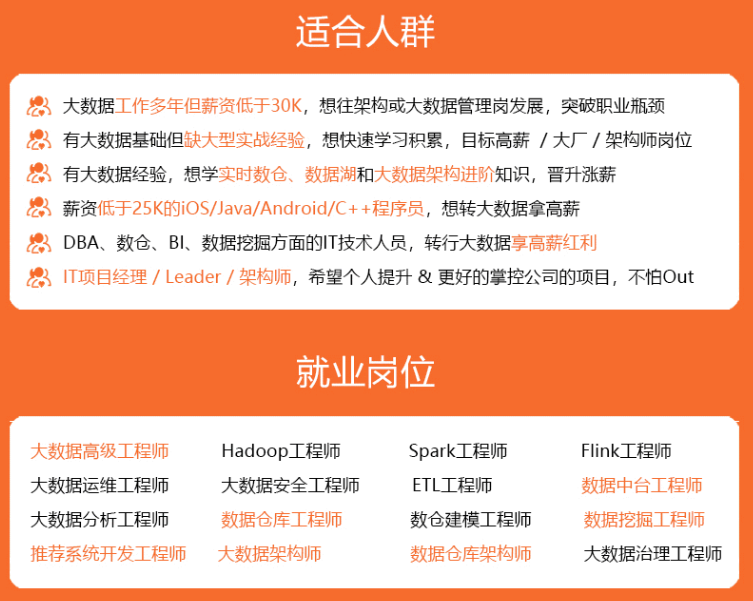

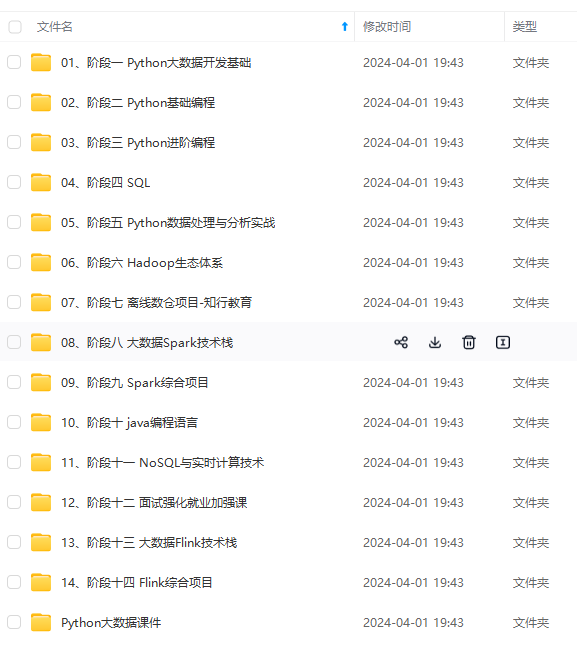

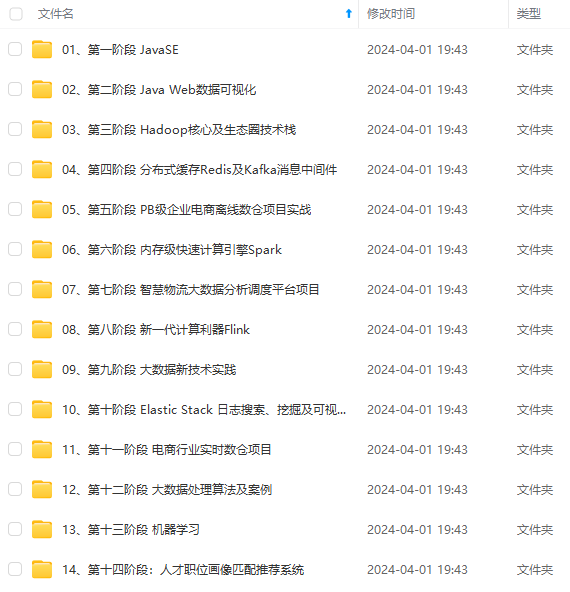

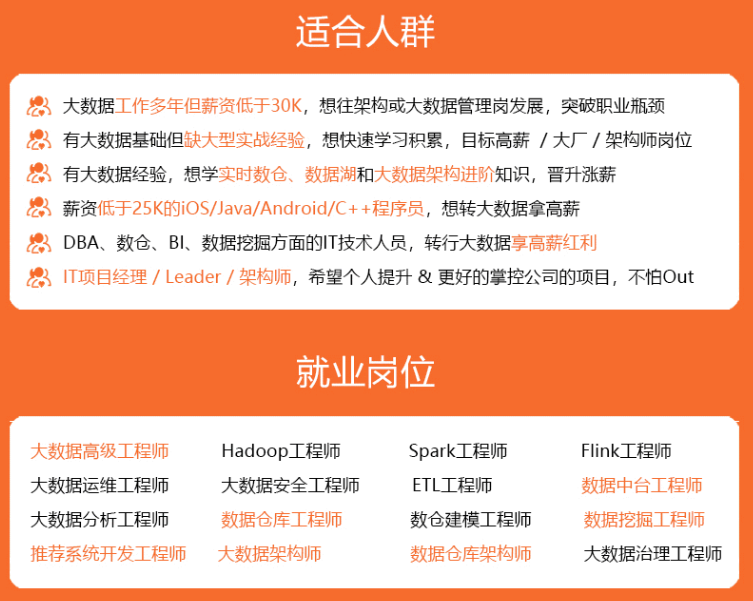

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

vim /opt/module/hbase-2.4.17/conf/hbase-site.xml

以下是几个比较重要的配置信息说明:

hbase.rootdir

这个目录是region server的共享目录,用来持久化HBase。URL需要是’完全正确’的。例如,要表示hdfs中的’/hbase’目录,namenode 运行在namenode.example.org的9090端口。则需要设置为hdfs://namenode.example.org:9000/hbase。默认情况下HBase是写到/tmp的。不改这个配置,数据会在重启的时候丢失。

默认: file:///tmp/hbase-${user.name}/hbase

hbase.master.port

HBase的Master的端口.

hbase.cluster.distributed

HBase的运行模式。false是单机模式,true是分布式模式。若为false,HBase和Zookeeper会运行在同一个JVM里面。

hbase.zookeeper.quorum

Zookeeper集群的地址列表,用逗号分割。例如:“host1.mydomain.com,host2.mydomain.com,host3.mydomain.com”.默认是localhost,是给伪分布式用的。要修改才能在完全分布式的情况下使用。如果在hbase-env.sh设置了HBASE_MANAGES_ZK,这些ZooKeeper节点就会和HBase一起启动。

<property>

<name>hbase.cluster.distributed</name>

<value>true</value>

</property>

<property>

<name>hbase.rootdir</name>

<value>hdfs://hbase01:8020/hbase</value>

</property>

<property>

<name>hbase.master.port</name>

<value>16000</value>

</property>

<property>

<name>hbase.zookeeper.quorum</name>

<value>hbase01:2181,hbase02:2181,hbase03:2181</value>

</property>

<property>

<name>hbase.zookeeper.property.dataDir</name>

<value>/opt/module/apache-zookeeper-3.5.8-bin/tmp</value>

</property>

<property>

<name>hbase.unsafe.stream.capability.enforce</name>

<value>false</value>

</property>

修改 regionservers 文件

vim /opt/module/hbase-2.4.17/conf/regionservers

添加集群节点主机名( 不能有多余空格 )

修改环境变量文件

此处环境变量文件为自己在 /etc/profile.d/ 目录下创建的 dev_env.sh 文件。如果环境变量在 /etc/profile 中修改了,直接在 /etc/profile 即可

sudo vim /etc/profile.d/dev_env.sh

加入hbase环境:

#hbase

export HBASE\_HOME=/opt/module/hbase-2.4.17

export PATH=$PATH:$HBASE\_HOME/bin

export PATH=$PATH:$HBASE\_HOME/sbin

使生效:

source /etc/profile

拷贝文件至其他节点

采用 scp 或者使用 xsync 脚本分发 /opt/module/hbase 至剩下的两个节点。

启动

启动habse时,由于hbase依赖于hdfs和zookeeper,所以要先启动hadoop和zookeeper,然后再启动hbase。

hadoop 启动

启动namenode,secondarynamenode,datanode

sbin/hadoop-daemon.sh start namenode

sbin/hadoop-daemon.sh start secondarynamenode

sbin/hadoop-daemon.sh start datanode

或者:

sbin/start-dfs.sh

启动resourcemanager,nodemanager

sbin/yarn-daemon.sh start resourcemanager

sbin/yarn-daemon.sh start nodemanager

或者:

sbin/start-yarn.sh

zookeeper启动

zkServer.sh start

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

625

625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?