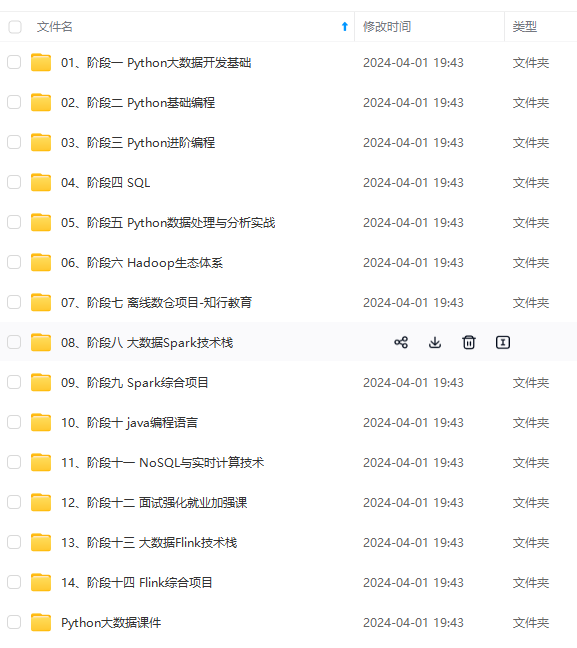

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

二、部署

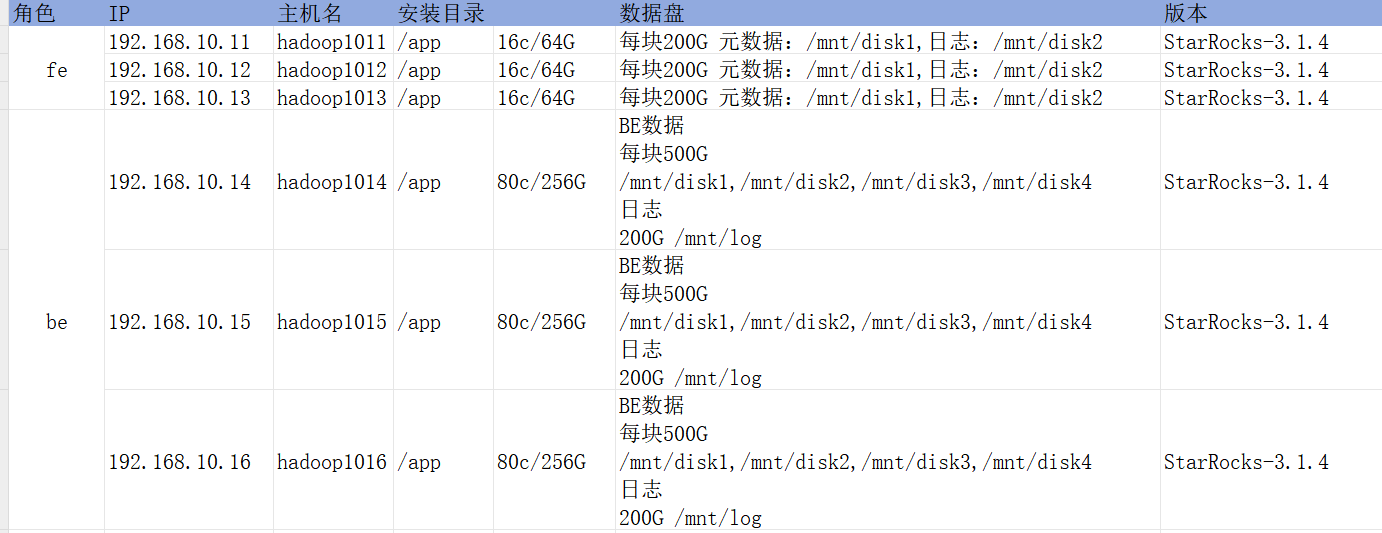

划分角色

(1)安装之前先使用命令检查CPU是否支持,有信息输出则支持,没信息输出则不支持建议更换机器

[root@hadoop1011 /app]# cat /proc/cpuinfo |grep avx2|head -1

flags : fpu vme de pse tsc msr pae mce cx8 apic sep mtrr pge mca cmov pat pse36 clflush mmx fxsr sse sse2 ht syscall nx mmxext fxsr_opt pdpe1gb rdtscp lm constant_tsc rep_good nopl nonstop_tsc cpuid extd_apicid tsc_known_freq pni pclmulqdq monitor ssse3 fma cx16 pcid sse4_1 sse4_2 x2apic movbe popcnt aes xsave avx f16c rdrand hypervisor lahf_lm cmp_legacy cr8_legacy abm sse4a misalignsse 3dnowprefetch osvw topoext invpcid_single vmmcall tsc_adjust bmi1 avx2 smep bmi2 invpcid rdseed adx smap clflushopt clwb sha_ni xsaveopt xsavec xgetbv1 xsaves clzero xsaveerptr rdpru wbnoinvd arat vaes vpclmulqdq rdpid

另外检查数据盘挂载情况,cpu核数,内存大小

机器直接的网络连通性

(2)下载tar包,并重命名

[root@hadoop1011 /app]# wget https://releases.starrocks.io/starrocks/StarRocks-3.1.4.tar.gz

(3)解压tar包

[root@hadoop1011 /app]# tar -zxvf StarRocks-3.1.4.tar.gz

(4)部署FE,修改配置文件,添加jvm参数,建议-Xmx参数设置到16G以上

[root@hadoop1011 /app]# cd /app/StarRocks-3.1.4/fe/conf/

[root@hadoop1011 conf]# vim fe.conf

LOG_DIR = ${STARROCKS\_HOME}/log

DATE = "$(date +%Y%m%d-%H%M%S)"

JAVA\_OPTS="-Dlog4j2.formatMsgNoLookups=true -Xmx32768m -XX:+UseMembar -XX:SurvivorRatio=8 -XX:MaxTenuringThreshold=7 -XX:+PrintGCDateStamps -XX:+PrintGCDetails -XX:+UseConcMarkSweepGC -XX:+UseParNewGC -XX:+CMSClassUnloadingEnabled -XX:-CMSParallelRemarkEnabled -XX:CMSInitiatingOccupancyFraction=80 -XX:SoftRefLRUPolicyMSPerMB=0 -Xloggc:${LOG\_DIR}/fe.gc.log.$DATE -XX:+PrintConcurrentLocks"

JAVA\_OPTS\_FOR\_JDK\_9="-Dlog4j2.formatMsgNoLookups=true -Xmx32768m -XX:SurvivorRatio=8 -XX:MaxTenuringThreshold=7 -XX:+CMSClassUnloadingEnabled -XX:-CMSParallelRemarkEnabled -XX:CMSInitiatingOccupancyFraction=80 -XX:SoftRefLRUPolicyMSPerMB=0 -Xlog:gc\*:${LOG\_DIR}/fe.gc.log.$DATE:time"

meta_dir = ${STARROCKS\_HOME}/meta

sys_log_level = INFO

http_port = 8030

rpc_port = 9020

query_port = 9030

edit_log_port = 9010

mysql_service_nio_enabled = true

[root@hadoop1011 /app]# cd /app/StarRocks-3.1.4/be/conf/

[root@hadoop1011 conf]# vim be.conf

default\_rowset\_type=beta

be\_port=9060

sys\_log\_level=INFO

sys\_log\_verbose\_modules=

storage\_root\_path=/mnt/disk1/starrocks/storage;/mnt/disk2/starrocks/storage;/mnt/disk3/starrocks/storage;/mnt/disk4/starrocks/storage;

priority\_networks=192.168.10.14/24

webserver\_port=8040

brpc\_port=8060

heartbeat\_service\_port=9050

sys\_log\_roll\_num=10

sys\_log\_roll\_mode=SIZE-MB-1024

[root@hadoop1011 /app]# tar -zcvf StarRocks-3.1.4-new.tar.gz StarRocks-3.1.4/

[root@hadoop1011 /app]# python -m SimpleHTTPServer

priority_networks配置随be主机的IP

hadoop1015/hadoop1016

priority\_networks=192.168.10.15/24

priority\_networks=192.168.10.16/24

其他节点下载安装包并解压

示例:

[root@hadoop1012 /app]# wget 192.168.10.11:8000/StarRocks-3.1.4-new.tar.gz

[root@hadoop1012 /app]# tar -zxvf StarRocks-3.1.4-new.tar.gz

(5)hadoop1011/hadoop1012/hadoop103机器上创建元数据目录

[root@hadoop1011 ]# cd /app/StarRocks-3.1.4/fe

[root@hadoop1011 ]# mkdir -p meta

(6)启动hadoop1011 FE节点

[root@hadoop1011 ]#cd /app/StarRocks-3.1.4/fe

[root@hadoop1011 fe]# bin/start\_fe.sh --daemon

(7)启动mysql客户端,访问FE,查看FE状况

[root@hadoop1011 fe]# mysql -h hadoop1011 -uroot -P9030

mysql> SHOW PROC '/frontends'\G

MySQL [(none)]> show frontends \G;

*************************** 1. row ***************************

Name: 192.168.10.11_9010_1698302659926

IP: 192.168.10.11

EditLogPort: 9010

HttpPort: 8030

QueryPort: 9030

RpcPort: 9020

Role: LEADER

ClusterId: 1085778829

Join: true

Alive: true

ReplayedJournalId: 1774256

LastHeartbeat: 2024-01-03 00:45:22

IsHelper: true

ErrMsg:

StartTime: 2023-11-24 09:53:06

Version: 3.1.4-0c4b2a3

(8)添加其他FE节点,角色也分为FOLLOWER,OBSERVER

mysql> ALTER SYSTEM ADD FOLLOWER "hadoop1012:9010";

mysql> ALTER SYSTEM ADD FOLLOWER "hadoop1013:9010";

(9)启动hadoop1012,hadoop1013 FE节点,第一次启动需指定–helper参数,后续再启动无需指定此参数

[root@hadoop1012 fe]# bin/start\_fe.sh --helper hadoop1011:9010 --daemon

[root@hadoop1013 fe]# bin/start\_fe.sh --helper hadoop1011:9010 --daemon

(10)全部启动完毕后,再使用mysql客户端查看FE的状况,alive全显示true则无问题

MySQL [(none)]> show frontends \G;

*************************** 1. row ***************************

Name: 192.168.10.11_9010_1698302659926

IP: 192.168.10.11

EditLogPort: 9010

HttpPort: 18030

QueryPort: 9030

RpcPort: 9020

Role: LEADER

ClusterId: 1085778829

Join: true

Alive: true

ReplayedJournalId: 1774256

LastHeartbeat: 2024-01-03 00:45:22

IsHelper: true

ErrMsg:

StartTime: 2023-11-24 09:53:06

Version: 3.1.4-0c4b2a3

*************************** 2. row ***************************

Name: 192.168.10.12_9010_1698303243473

IP: 192.168.10.12

EditLogPort: 9010

HttpPort: 8030

QueryPort: 9030

RpcPort: 9020

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

93607)]

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

1450

1450

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?