网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

这个问题翻译一下,就是数字16不断地除以2,除几次以后的结果等于1?这里要涉及到数学当中的对数,以2位底,16的对数,可以简写为log16。

因此,把面包吃得只剩下1寸,需要 5 X log16 = 5 X 4 = 20 天。

如果面包的长度是 N 寸呢?

需要 5 X logn = 5logn天,记作 T(n) = 5logn。

**场景3:**给小灰一条长10寸的面包和一个鸡腿,小灰每2天吃掉一个鸡腿。那么小灰吃掉整个鸡腿需要多少天呢?

答案自然是2天。因为只说是吃掉鸡腿,和10寸的面包没有关系 。

如果面包的长度是 N 寸呢?

无论面包有多长,吃掉鸡腿的时间仍然是2天,记作 T(n) = 2。

**场景4:**给小灰一条长10寸的面包,小灰吃掉第一个一寸需要1天时间,吃掉第二个一寸需要2天时间,吃掉第三个一寸需要3天时间…每多吃一寸,所花的时间也多一天。那么小灰吃掉整个面包需要多少天呢?

答案是从1累加到10的总和,也就是55天。

如果面包的长度是 N 寸呢?

此时吃掉整个面包,需要 1+2+3+…+ n-1 + n = (1+n)*n/2 = 0.5n^2 + 0.5n。

记作 T(n) = 0.5n^2 + 0.5n。

上面所讲的是吃东西所花费的相对时间,这一思想同样适用于对程序基本操作执行次数的统计。刚才的四个场景,分别对应了程序中最常见的四种执行方式:

**场景1:**T(n) = 3n,执行次数是线性的。

void eat1(int n){

for(int i=0; i<n; i++){;

System.out.println("等待一天");

System.out.println("等待一天");

System.out.println("吃一寸面包");

}

}

vo

**场景2:**T(n) = 5logn,执行次数是对数的。

void eat2(int n){

for(int i=1; i<n; i*=2){

System.out.println("等待一天");

System.out.println("等待一天");

System.out.println("等待一天");

System.out.println("等待一天");

System.out.println("吃一半面包");

}

}

**场景3:**T(n) = 2,执行次数是常量的。

void eat3(int n){

System.out.println("等待一天");

System.out.println("吃一个鸡腿");

}

**场景4:**T(n) = 0.5n^2 + 0.5n,执行次数是一个多项式。

void eat4(int n){

for(int i=0; i<n; i++){

for(int j=0; j<i; j++){

System.out.println("等待一天");

}

System.out.println("吃一寸面包");

}

}

渐进时间复杂度

有了基本操作执行次数的函数 T(n),是否就可以分析和比较一段代码的运行时间了呢?还是有一定的困难。

比如算法A的相对时间是T(n)= 100n,算法B的相对时间是T(n)= 5n^2,这两个到底谁的运行时间更长一些?这就要看n的取值了。

所以,这时候有了渐进时间复杂度(asymptotic time complexity)的概念,官方的定义如下:

若存在函数 f(n),使得当n趋近于无穷大时,T(n)/ f(n)的极限值为不等于零的常数,则称 f(n)是T(n)的同数量级函数。

记作 T(n)= O(f(n)),称O(f(n)) 为算法的渐进时间复杂度,简称时间复杂度。

渐进时间复杂度用大写O来表示,所以也被称为大O表示法。

如何推导出时间复杂度呢?有如下几个原则:

- 如果运行时间是常数量级,用常数1表示;

- 只保留时间函数中的最高阶项;

- 如果最高阶项存在,则省去最高阶项前面的系数。

让我们回头看看刚才的四个场景。

场景1:

T(n) = 3n

最高阶项为3n,省去系数3,转化的时间复杂度为:

T(n) = O(n)

场景2:

T(n) = 5logn

最高阶项为5logn,省去系数5,转化的时间复杂度为:

T(n) = O(logn)

场景3:

T(n) = 2

只有常数量级,转化的时间复杂度为:

T(n) = O(1)

场景4:

T(n) = 0.5n^2 + 0.5n

最高阶项为0.5n^2,省去系数0.5,转化的时间复杂度为:

T(n) = O(n^2)

这四种时间复杂度究竟谁用时更长,谁节省时间呢?稍微思考一下就可以得出结论:

O(1)< O(logn)< O(n)< O(n^2)

在编程的世界中有着各种各样的算法,除了上述的四个场景,还有许多不同形式的时间复杂度,比如:

O(nlogn), O(n^3), O(m*n),O(2^n),O(n!)

今后遨游在代码的海洋里,我们会陆续遇到上述时间复杂度的算法。

时间复杂度的巨大差异

我们来举过一个栗子:

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

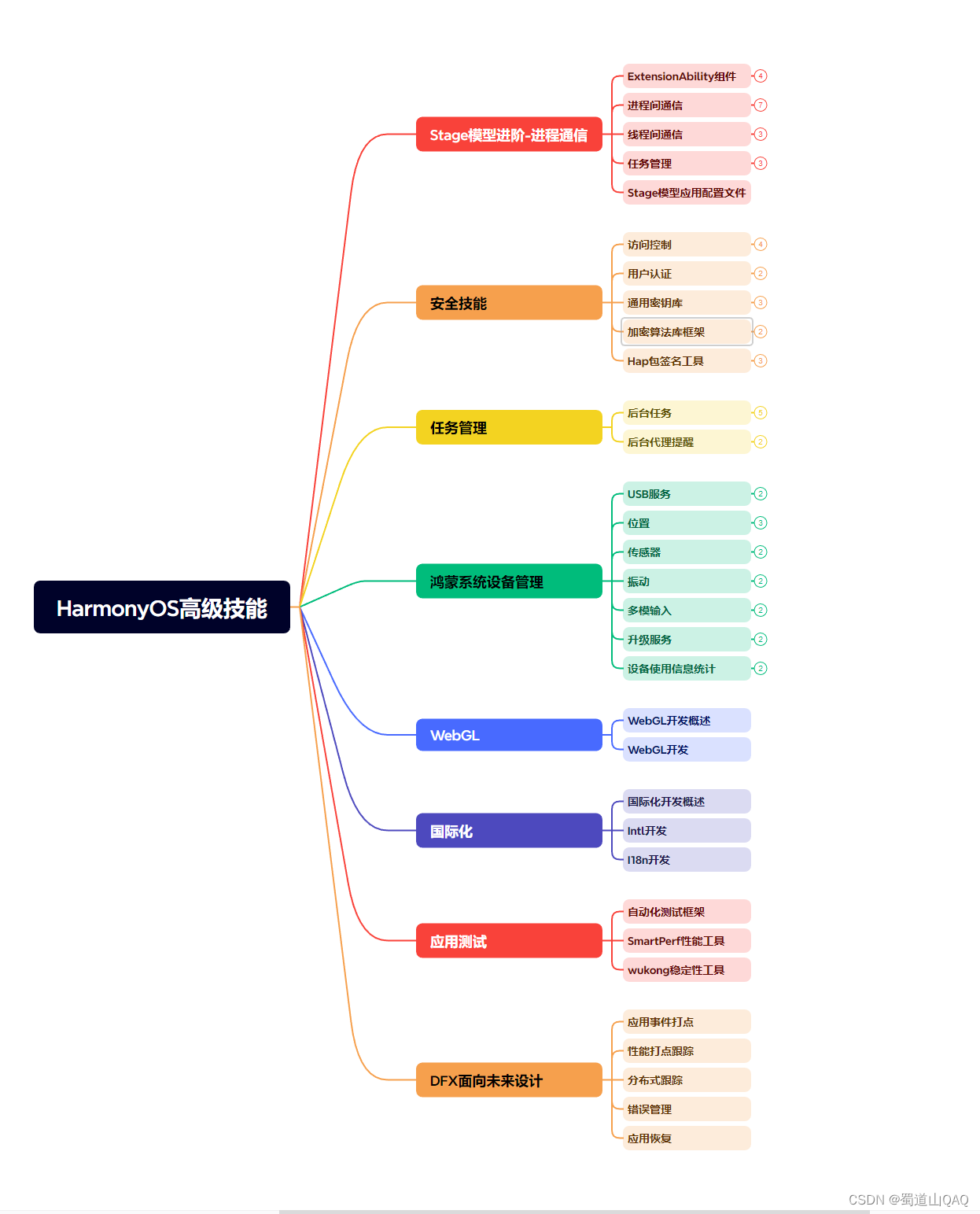

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上鸿蒙开发知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

-c3iGHHEU-1715884455675)]

[外链图片转存中…(img-en9PaM2g-1715884455676)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上鸿蒙开发知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?