激活函数

目录

1. 激活函数(处理数据,相当于机器学习的算法,能更好利用数据)

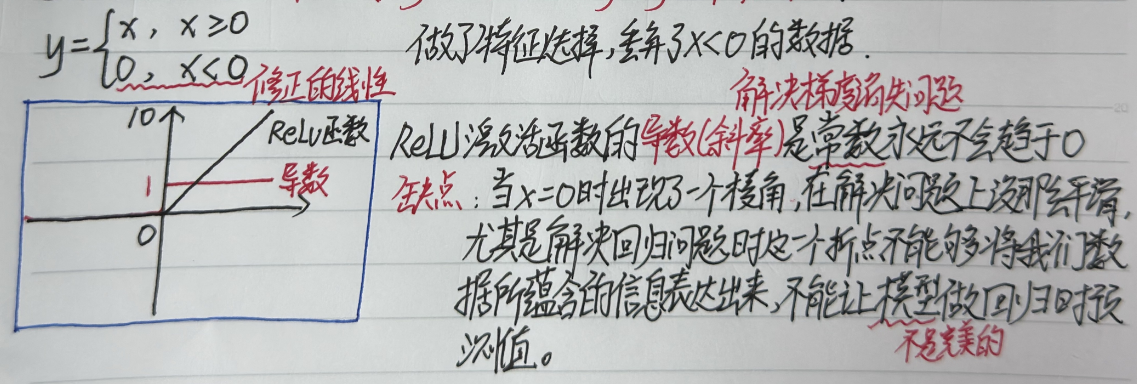

5. ReLU函数(相比于sigmoid,tanh,softsign计算量较小)

学习目标:

①激活函数

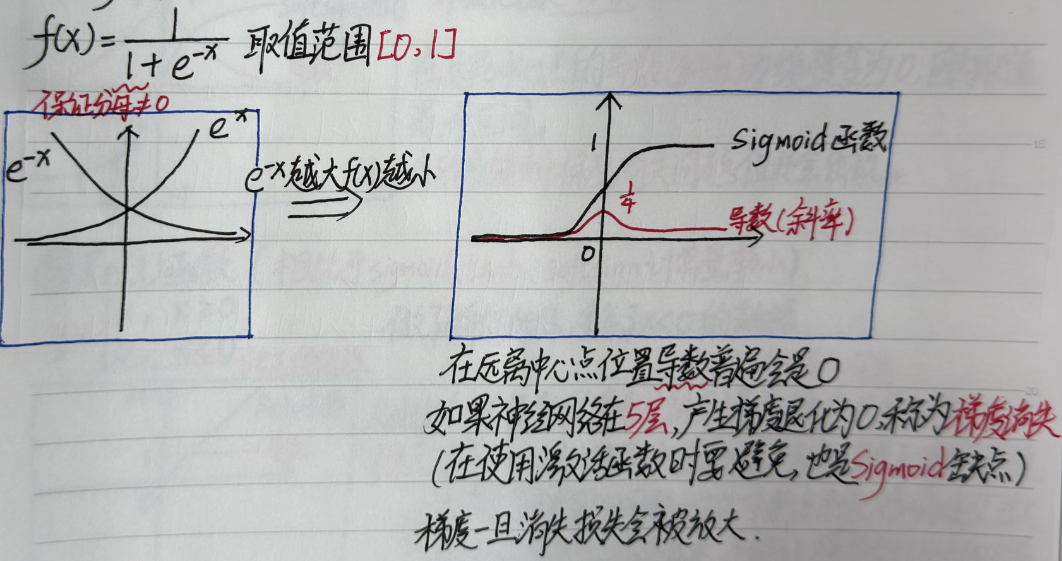

②Sigmoid函数

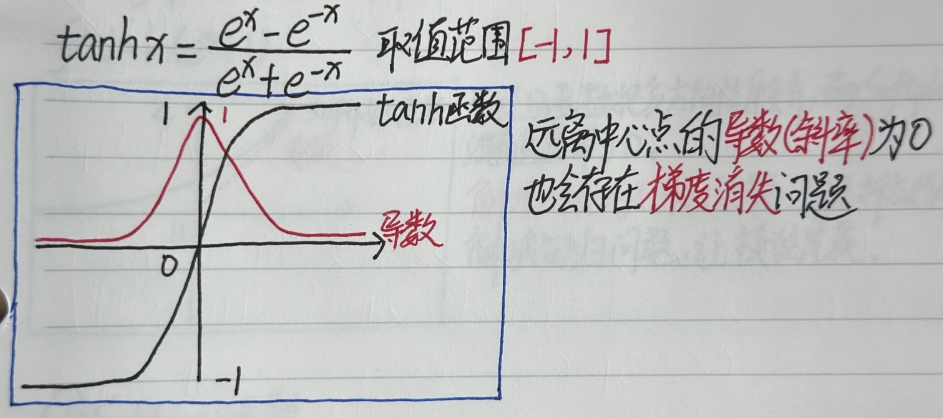

③tanh函数

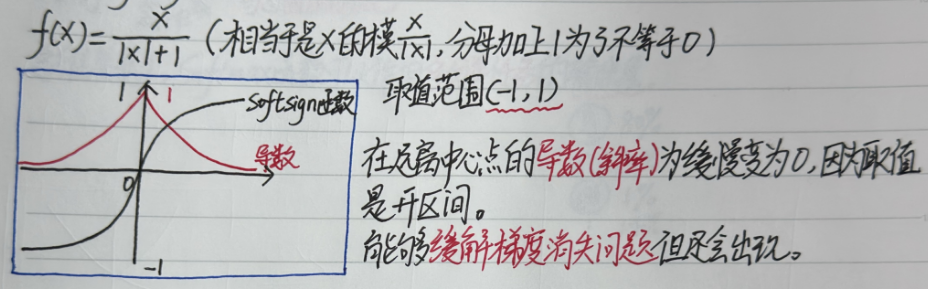

④Softsign函数

⑤ReLU函数

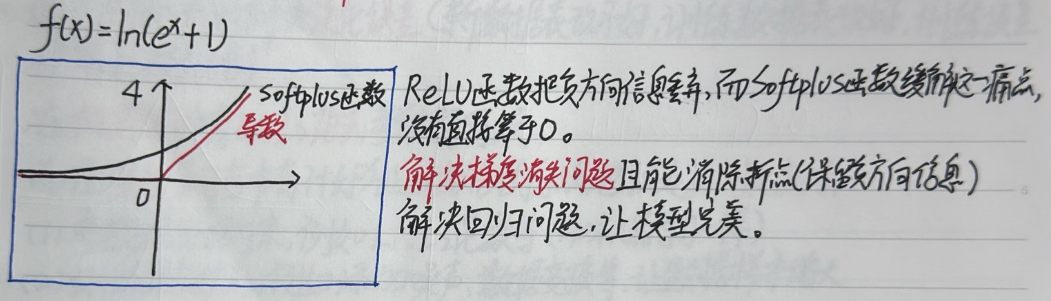

⑥Softplus函数

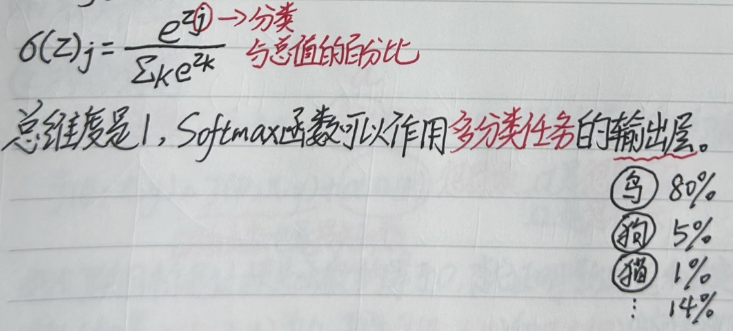

⑦Softmax函数

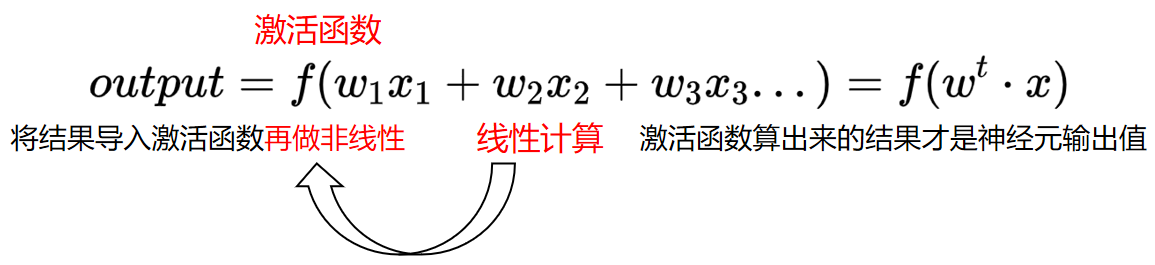

1. 激活函数(处理数据,相当于机器学习的算法,能更好利用数据)

机器是无法学习、理解非常复杂和非线性函数问题,所以引入激活函数能够将它们解决(复杂的数据分布问题)

如果我们不运用"激活函数"则输出信号仅仅是个简单的线性函数。线性函数的复杂性有限,从数据中学习复杂函数映射的能力更小

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?