这里写目录标题

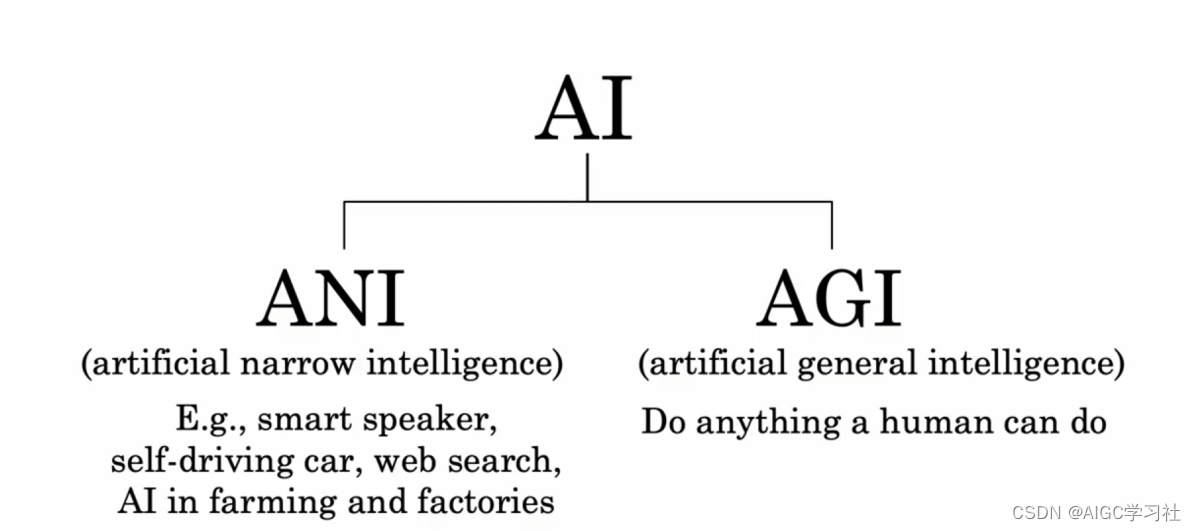

两种AI

如今的AI分为两类,ANI和AGI。

1.ANI

弱人工智能只做一件事或一个任务,有时效果很好且价值很高。

案例:智能音箱,自动汽车驾驶,网页搜索。农业或工厂的特定应用

2.AGI

强人工智能,能做一个一般人能做的所有事情的AI系统。

ANI 与 AGI 的进展

尽管在 ANI 上取得了巨大进展,因此在 AI 上也取得了巨大进展,但无法确定在 AGI 上是否真正取得了任何进展。ANI的所有进展使人们得出正确的结论,即 AI 取得了巨大进展。但这也导致一些人得出错误的结论,认为 AI 取得的巨大进展必然意味着在 AGI 上也取得了很大进展。

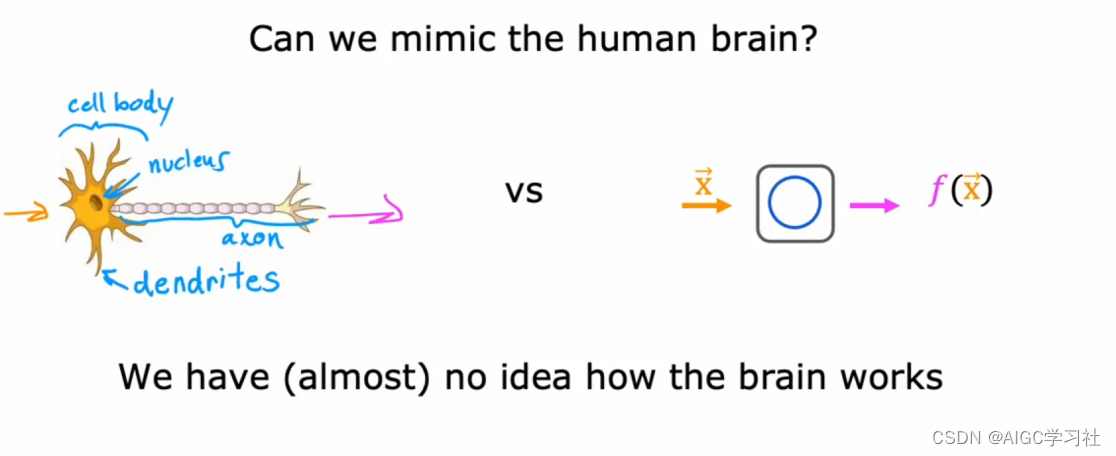

对大脑工作的有限理解

-

如果能模拟人类大脑的神经元,就能模拟人类大脑中的其它内容,从而构建真正智能的系统,实现这种这种想法极其困难。

-

原因:

- 一个人工神经元做的事情很简单,其复杂程度远不及大脑中的生物神经元。

- 其次,我们仍不清楚大脑的工作原理,例如神经元是如何从输入映射到输出,因此用电脑去模拟人类大脑和真实的大脑功能相去甚远。

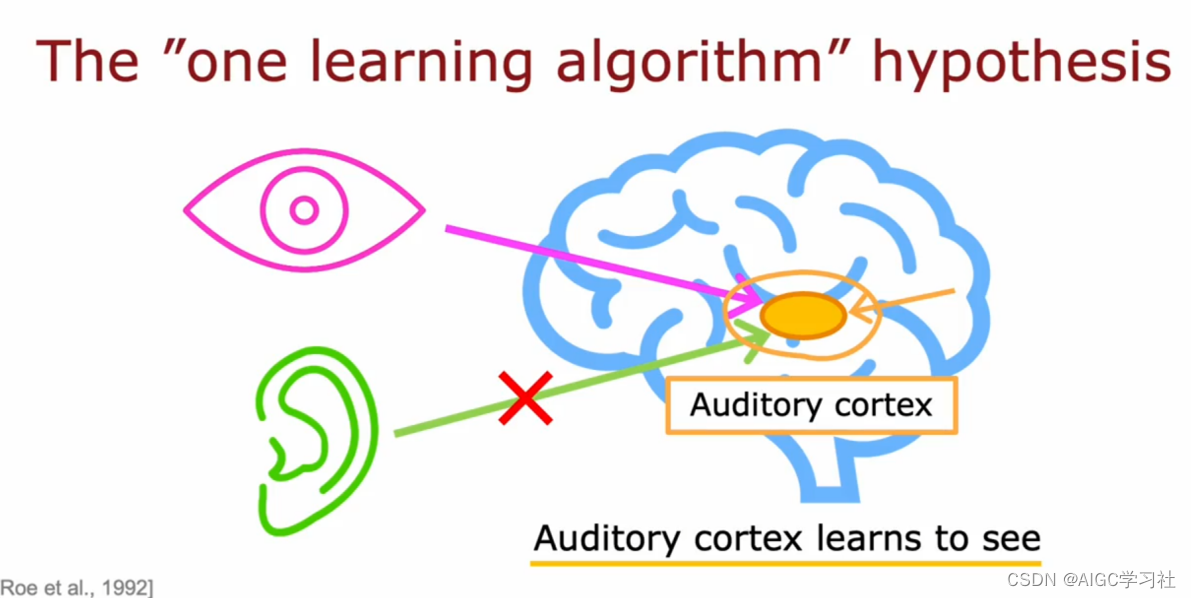

AGI突破的希望

动物身上的一些有趣实验显示或强烈暗示,同一块生物大脑组织可以执行令人惊讶的广泛任务。这导致了一个学习算法假说,即许多智能可能归功于一种或少数几种学习算法。如果我们能弄清楚这些算法是什么,也许有一天可以在计算机中实现。

1.听觉皮层实验

这些是 Roe 等人多年前的实验结果。你的大脑中有一个区域称为听觉皮层,大脑通过电信号将耳朵检测到的声音信号传递到听觉皮层。如果你重新连接动物大脑,切断耳朵与听觉皮层之间的连接,而是将图像输入到听觉皮层,听觉皮层会学会“看”。听觉皮层本应学习听觉,但当输入不同数据时,它学会了视觉。

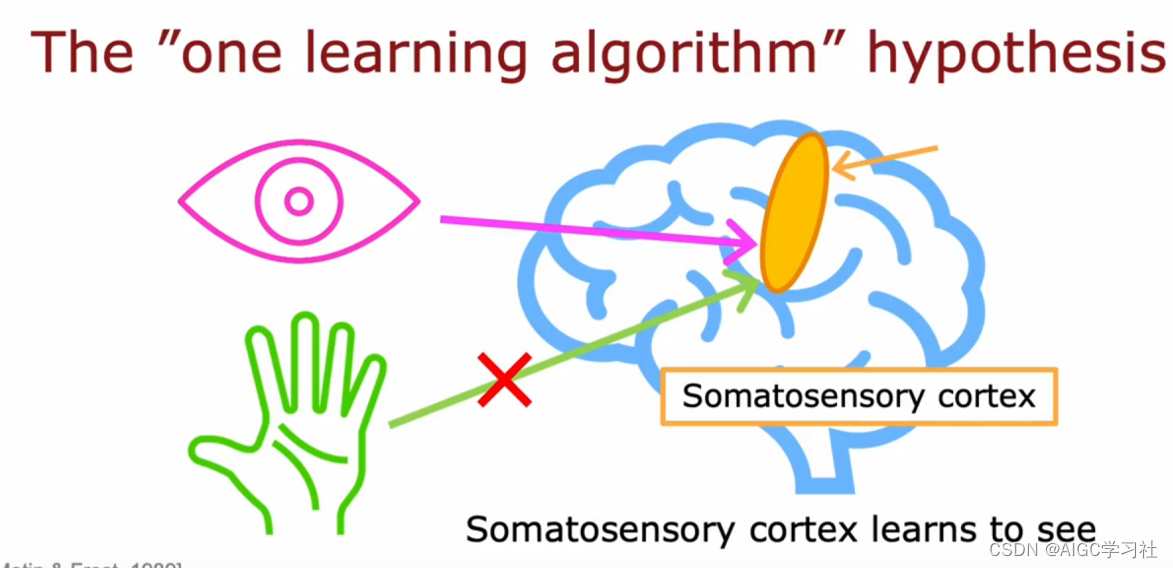

2.体感皮层实验

另一个例子是体感皮层,负责处理触觉。如果你类似地重新连接大脑,切断触觉传感器与体感皮层的连接,而将图像输入到体感皮层,体感皮层也会学会“看”。

3.小结

一系列这样的实验表明,大脑的许多不同部分只需根据输入的数据就可以学习看到、感觉到或听到,好像存在一个算法,根据输入的数据学习相应的处理方式。

现实实验

1.摄像头实验

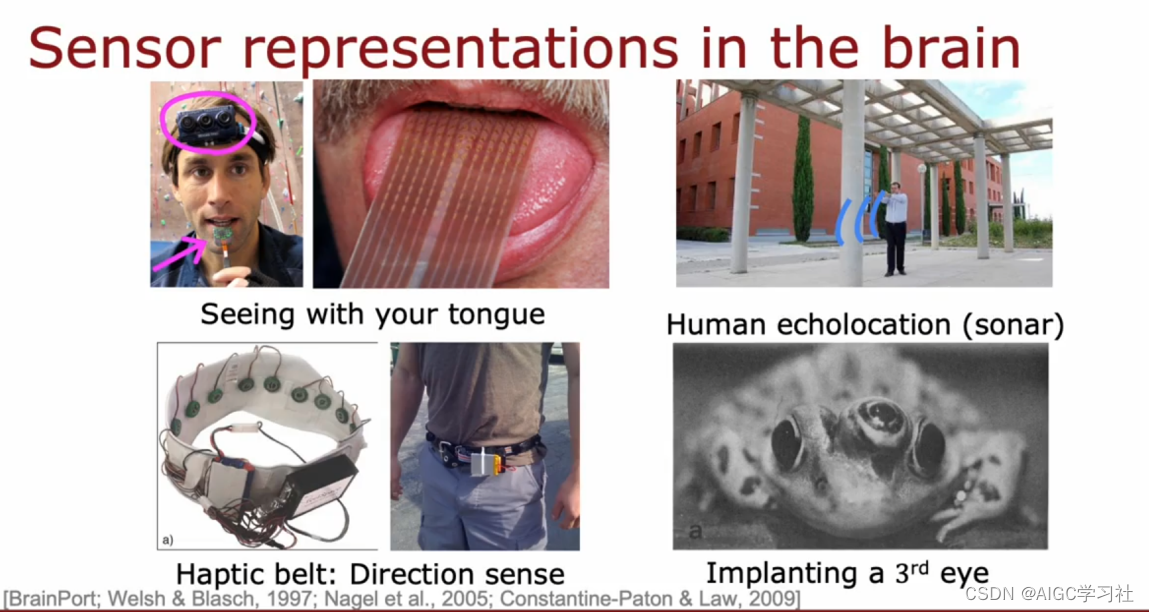

有些系统将摄像头安装在人额头上,并将图像映射为舌头上的电压图案。通过将灰度图像映射为舌头上的电压图案,这可以帮助失明的人通过舌头“看到”。还有一些关于人类回声定位或声纳的有趣实验,比如让人类发出点击声并听取回声,这样可以学会某种程度的回声定位,就像海豚和蝙蝠一样。

2.触觉腰带实验

斯坦福大学的研究实验室曾设计了一种触觉腰带,在腰部周围安装一圈振动器,并用磁性罗盘进行编程,使北方向的振动器始终缓慢振动。这样,你会感觉自己知道北方在哪里,而不是感觉腰部在振动。

3.青蛙的第三只眼实验

通过手术在青蛙大脑上植入第三只眼,大脑会学会处理新的输入。这类实验表明,人脑具有惊人的适应性,神经科学家称之为“可塑性”,即能够适应各种感官输入。

4.小结

这些实验提出了一个问题:如果同一块大脑组织能学会“看”、“触摸”或“感觉”,那么它使用的是什么算法?我们能否复制这个算法并在计算机中实现?

AGI 的现实与未来

尽管如此,避免过度炒作很重要。我不知道大脑是否真的是一种或几种算法,即使是,也没有人知道这个算法是什么,但我仍然怀抱希望,也许通过大量的努力,有一天能发现它的近似解。我认为这是一个非常迷人的话题,经常在空闲时间思考,也许有一天,你能对此作出贡献。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?