需求:

统计每个手机号上行流量和、下行流量和、总流量和(上行流量和+下行流量和),并且:将统计结果按照手机号的前缀进行区分,并输出到不同的输出文件中去。

13* ==> …

15* ==> …

other ==> …

其中,access.log数据文件

第二个字段:手机号

倒数第三个字段:上行流量

倒数第二个字段:下行流量

思路:

根据手机号进行分组,然后把该手机号对应的上下行流量加起来

Mapper: 把手机号、上行流量、下行流量拆开,把手机号作为key,把Access作为value写出去

Reducer形如:(“手机号”,<Access,Access>)

自定义分区类(需要继承Partitioner抽象类),并覆写

getPartition()方法

开发步骤:

(1)自定义Access类

包括属性:手机号、上行流量、下行流量、总流量

(2)自定义Map任务类(Map Task)

对每一行日志内容进行拆分,Map输出数据为:

phone==>Access(手机号,该行手机号的上行流量,该行手机号的下行流量)

(3)编写Reduce任务类(Reduce Task)

对每个手机号的流量进行汇总,Map输出数据为:phone==>Access(手机号,上行流量和,下行流量和)

也可以优化为:phone==>Access(NullWritable对象,上行流量和,下行流量和)

(4)编写分区处理类

继承org.apache.hadoop.mapreduce.Partitioner类,"13"开头的手机号交给第一个ReduceTask任务处理,最终输出到0号分区,"15"开头的手机号交给第二个ReduceTask任务处理,最终输出到1号分区,其余手机号交给第三个ReduceTask任务处理,最终输出到2号分区。

项目实施:

(1)配置相关环境

遇到的问题:xshell连接不上虚拟机

解决方法:还原虚拟网络并重新配置

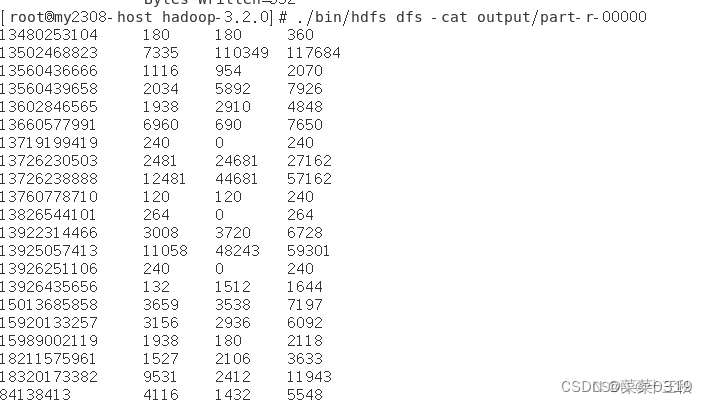

(2) 通过数据源文件,首先求出每个手机号的上行流量、下行流量、总流量。

一、首先将该题的数据源上传至集群

二、创建java项目编写MapReduce程序

(1)创建java项目并导入连接hadoop的jar包

(2)使用java编写MapReduce程序

这次项目的MapReduce程序包含以下几个类:

FlowBean、FlowDriver、FlowMapper、FlowReducer

定义一个FlowBean.java类

代码如下:

import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

import org.apache.hadoop.io.Writable;

// bean对象要实例化

public class FlowBean implements Writable {

private long upFlow;

private long downFlow;

private long sumFlow;

// 反序列化时,需要反射调用空参构造函数,所以必须有

public FlowBean() {

super();

}

public FlowBean(long upFlow, long downFlow) {

super();

this.upFlow = upFlow;

this.downFlow = downFlow;

this.sumFlow = upFlow + downFlow;

}

public long getSumFlow() {

return sumFlow;

}

public void setSumFlow(long sumFlow) {

this.sumFlow = sumFlow;

}

public long getUpFlow() {

return upFlow;

}

public void setUpFlow(long upFlow) {

this.upFlow = upFlow;

}

public long getDownFlow() {

return downFlow;

}

public void setDownFlow(long downFlow) {

this.downFlow = downFlow;

}

/**

* 序列化方法

*

* @param out

* @throws IOException

*/

@Override

public void write(DataOutput out) throws IOException {

out.writeLong(upFlow);

out.writeLong(downFlow);

out.writeLong(sumFlow);

}

/**

* 反序列化方法

注意反序列化的顺序和序列化的顺序完全一致

*

* @param in

* @throws IOException

*/

@Override

public void readFields(DataInput in) throws IOException {

upFlow = in.readLong();

downFlow = in.readLong();

sumFlow = in.readLong();

}

@Override

public String toString() {

return upFlow + "\t" + downFlow + "\t" + sumFlow;

}

public void set(long upFlow, long downFlow) {

this.upFlow = upFlow;

this.downFlow = downFlow;

this.sumFlow = upFlow + downFlow;

}

}

定义一个FlowDriver.java类

代码如下:

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class FlowDriver {

public static void main(String[] args) throws Exception {

//1.获取配置信息

Configuration conf = new Configuration();

Job job = Job.getInstance(conf);

//2.获取jar包信息

job.setJarByClass(FlowDriver.class);

//3.配置mapper、reducer类

job.setMapperClass(FlowMapper.class);

job.setReducerClass(FlowReducer.class);

//4.配置mapper输出key、value值

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(FlowBean.class);

//5.配置输出key、value值

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(FlowBean.class);

// //设置分区

// job.setPartitionerClass(FlowPartitioner.class);

//

// //设置Reducenum,依据是看flowpartitioner里分了几个区

// job.setNumReduceTasks(5);

//6.配置输入路径和输出路径

FileInputFormat.setInputPaths(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

//7.提交

boolean result = job.waitForCompletion(true);

System.exit(result?0:1);

}

}

定义一个FlowMapper.java类

代码如下:

import java.io.IOException;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

public class FlowMapper extends Mapper<LongWritable, Text, Text, FlowBean>{

//不能在map方法中new对象,map方法执行频率高,内存消耗大。这也就是需要在bean对象中要有一个空构造方法的原因

FlowBean bean = new FlowBean();

Text k = new Text();

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

//1.获取一行数据()

String line = value.toString();

//2.截取字段(1、2可归结为一大步:对输入数据的处理)

String[] fields = line.split("\t");

//3.封装bean对象,获取电话号码(第二大步:具体的业务逻辑)

String phoneNum = fields[1];

long upFlow = Long.parseLong(fields[fields.length - 3]);

long downFlow = Long.parseLong(fields[fields.length - 2]);

//在map方法中new对象是不好的,因为在输入数据时,每读一行数据,会执行以下map方法,这一造成内存消耗很大

//FlowBean bean = new FlowBean(upFlow,downFlow);

bean.set(upFlow, downFlow);

k.set(phoneNum);

//4.写出去(第三大步:将数据输出出去,key和value分别是什么,规定清楚)

//context.write(new Text(phoneNum), bean);

context.write(k, bean);

}

}

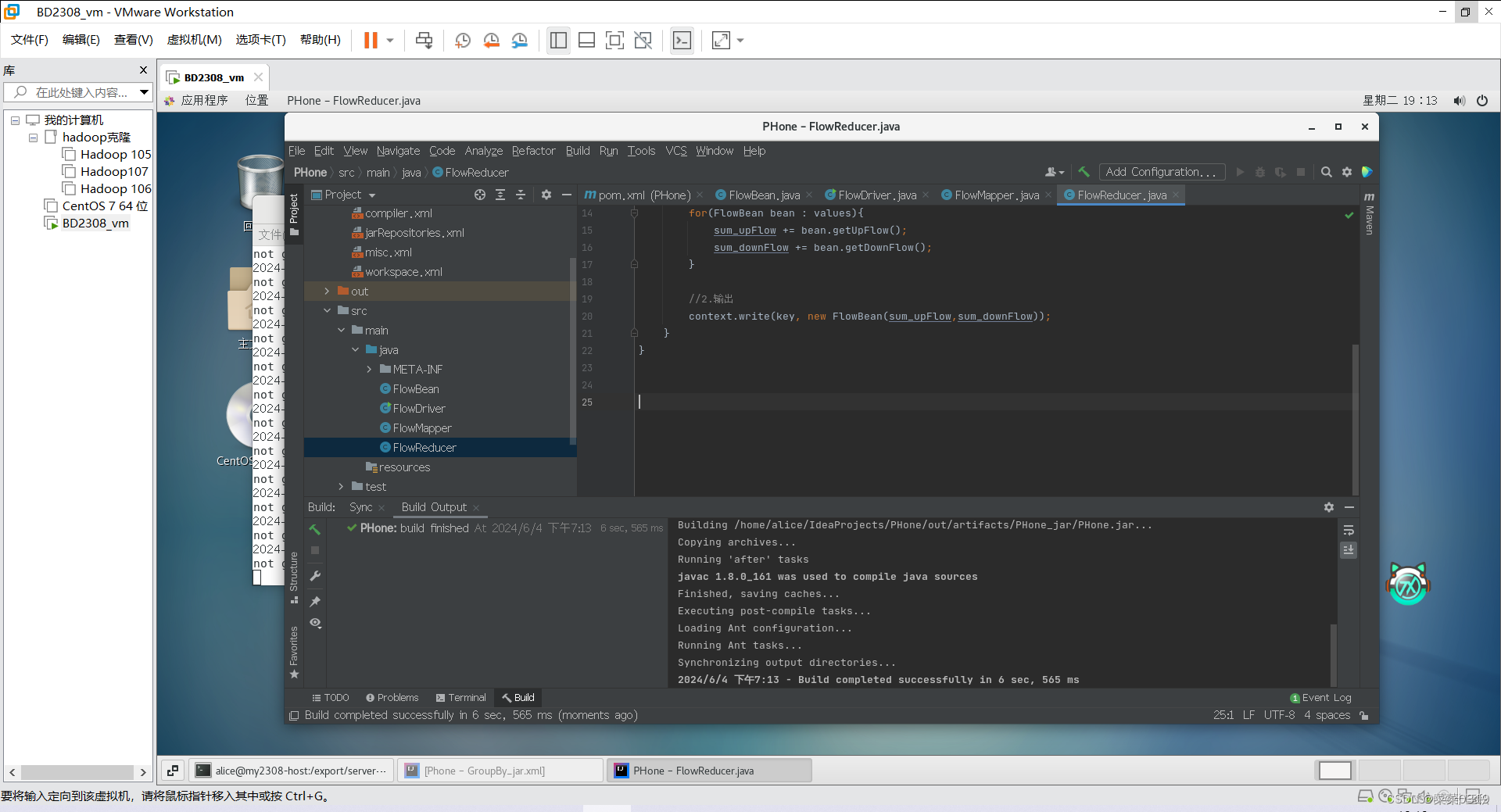

MapReduce的所有java类已创建成功

三、将编写的MapReduce程序打包并上传至,启动集群的Linux系统中

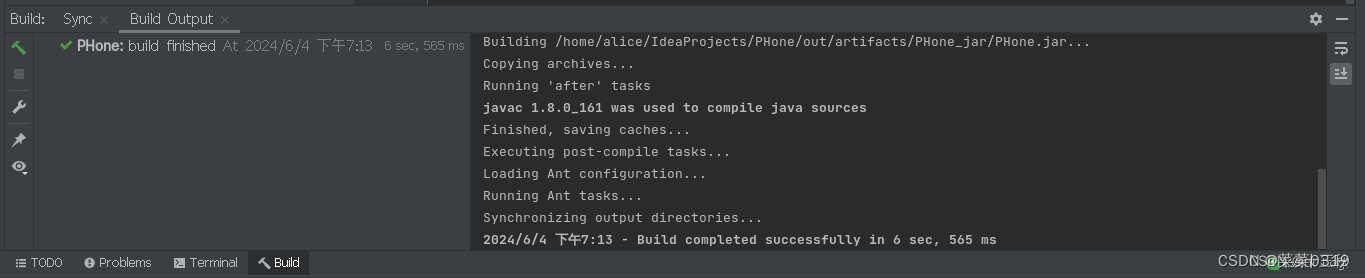

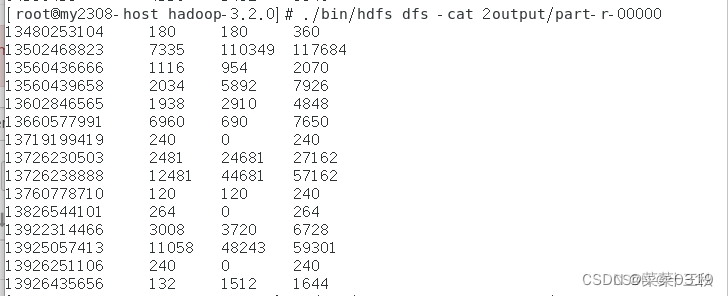

(2)根据(1)的手机号流量汇总结果再按照不同的手机号进行分组输出到不同的文件中(2)使用java编写MapReduce程序

这道题的MapReduce程序包含以下几个类:

FlowBean、FlowDriver、FlowMapper、FlowReducer、ProvincePartitioner

在之前的基础上添加一个ProvincePartitioner类

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Partitioner;

/

* K2 V2 对应的是map输出kv类型

* @author Administrator

*/

public class ProvincePartitioner extends Partitioner<Text, FlowBean> {

@Override

public int getPartition(Text key, FlowBean value, int numPartitions) {

// 1 获取电话号码的前三位

String preNum = key.toString().substring(0, 3);

int partition;

// 2 判断是哪个前缀

if (preNum.startsWith("13")) {

partition = 0; // 13* 前缀

} else if (preNum.startsWith("15")) {

partition = 1; // 15* 前缀

} else {

partition = 2; // 其他前缀

}

return partition;

}

}

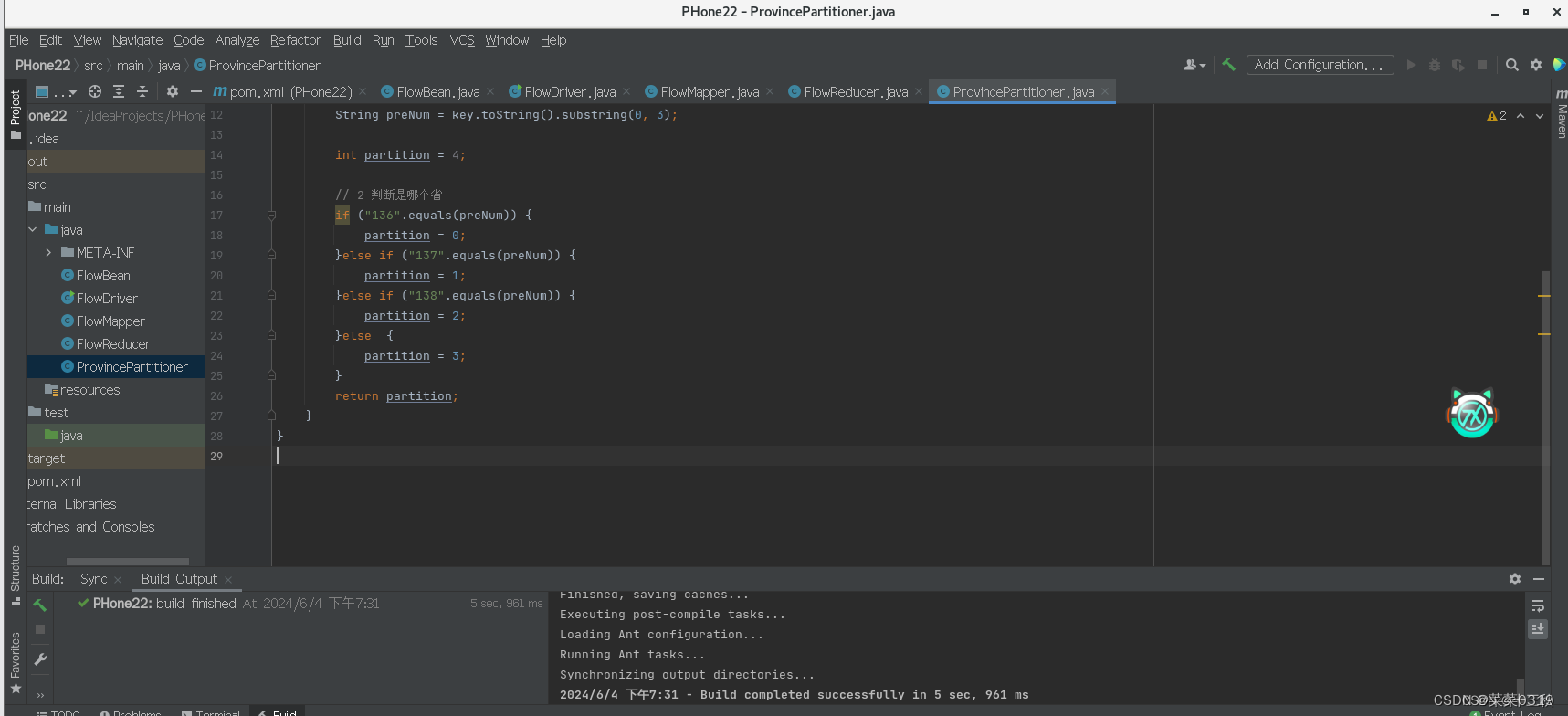

与之前步骤一样,将编写的MapReduce程序打包并上传至,启动集群的Linux系统中

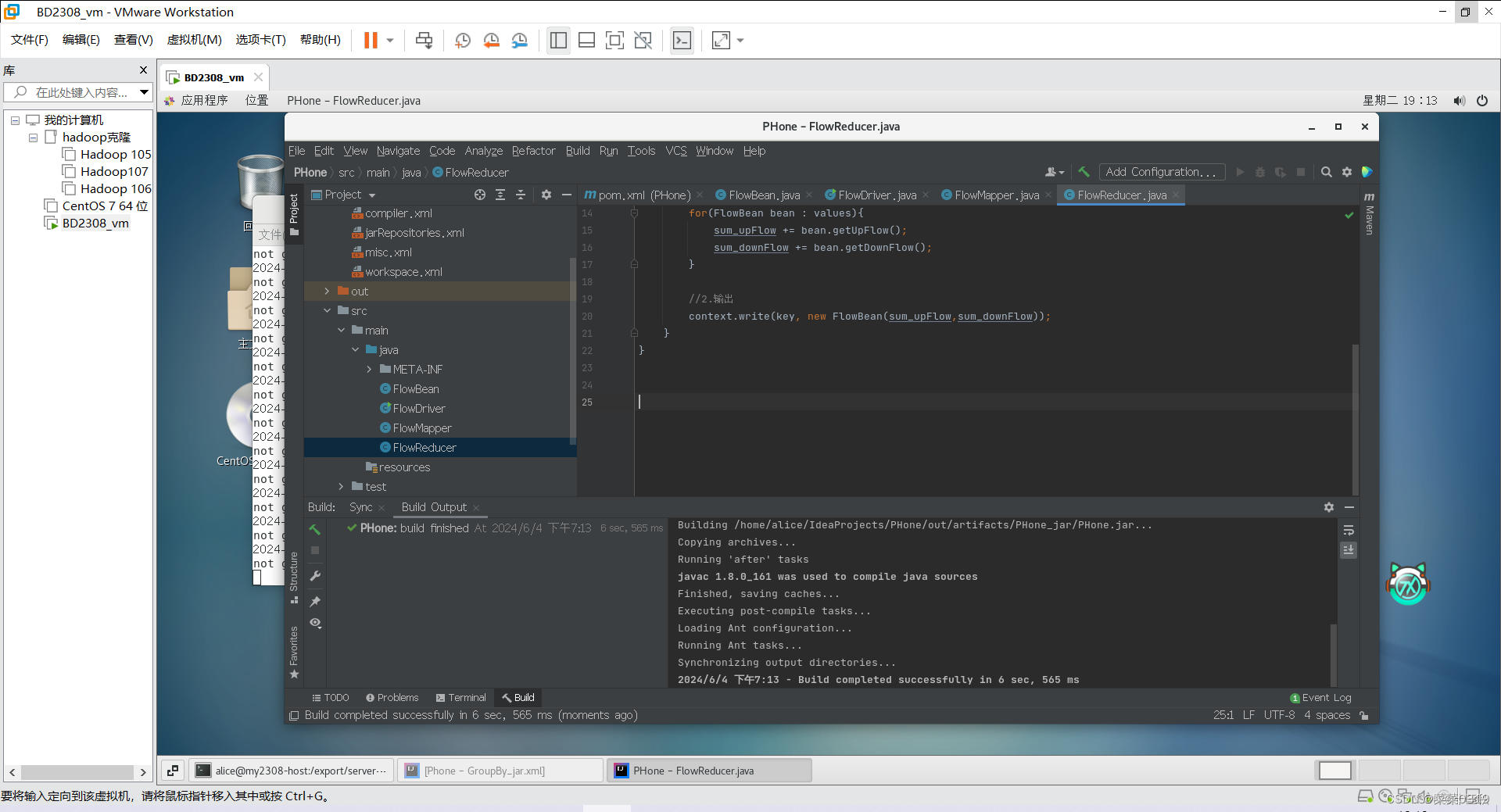

打包成功

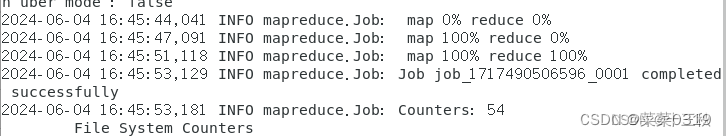

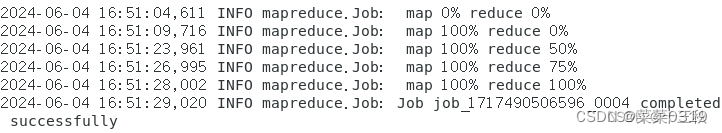

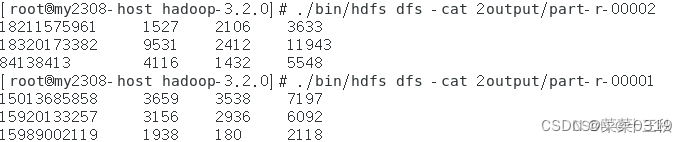

执行结果

在该目录下使用hadoop调用该包,根据(1)的手机号流量汇总结果再按照手机号不同进行分组输出到不同的文件中

小结

至此,程序顺利运行结束。在此过程中,我们不仅培养了动手能力,更是把理论知识与实际知识相结合,在实验过程中不断进行修改错误,最终顺利完成了本次项目。希望在今后的学习生活中,可以更加努力刻苦,将理论知识运用到实际中。

301

301

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?