使用Sqoop将结果进行数据迁移,存放在mysql中。

1. 用Sqoop创建link和job

package com.yc.elm.utils;

import org.apache.sqoop.client.SqoopClient;

import org.apache.sqoop.model.MDriverConfig;

import org.apache.sqoop.model.MFromConfig;

import org.apache.sqoop.model.MJob;

import org.apache.sqoop.model.MLink;

import org.apache.sqoop.model.MLinkConfig;

import org.apache.sqoop.model.MToConfig;

import org.apache.sqoop.validation.Status;

public class DataToMysql {

public static SqoopClient client = new SqoopClient("http://master:12000/sqoop/");

public static void main(String[] args) {

System.setProperty("user.name", "hadoop");

createJDBC();

createHDFS();

doHdfs2Mysql();

}

public static MJob doHdfs2Mysql() {

MJob job = client.createJob("elmHdfs", "elmJdbc"); // 创建一个作业对象

job.setName("elmJob");

job.setCreationUser("hadoop");

MFromConfig from = job.getFromJobConfig(); // 获取到这个来源连接配置对象

from.getStringInput("fromJobConfig.inputDirectory").setValue("/elm/rating");

MToConfig to = job.getToJobConfig(); // 获取到这个目的地的连接对象

to.getStringInput("toJobConfig.schemaName").setValue("hive");

to.getStringInput("toJobConfig.tableName").setValue("elm_rating"); // mysql中的表名

MDriverConfig driverConfig = job.getDriverConfig(); // 获取到数据迁移处理驱动对象

driverConfig.getIntegerInput("throttlingConfig.numExtractors").setValue(3);

driverConfig.getIntegerInput("throttlingConfig.numLoaders").setValue(1);

Status status = client.saveJob(job);

if (status.canProceed()) {

return job;

} else {

throw new RuntimeException("创建 hdfs to hdfs 工作失败!!!");

}

}

public static MLink createJDBC() {

MLink mLink = client.createLink("generic-jdbc-connector");// 创建一个sqoop对象

mLink.setName("elmJdbc"); // 给连接指定一个名称

mLink.setCreationUser("hadoop");

MLinkConfig linkConfig = mLink.getConnectorLinkConfig();

linkConfig.getStringInput("linkConfig.jdbcDriver").setValue("com.mysql.jdbc.Driver");

linkConfig.getStringInput("linkConfig.connectionString")

.setValue("jdbc:mysql://master:3306/hive?useSSL=false&useUnicode=true&characterEncoding=utf-8");

linkConfig.getStringInput("linkConfig.username").setValue("hive");

linkConfig.getStringInput("linkConfig.password").setValue("a");

linkConfig.getStringInput("dialect.identifierEnclose").setValue(" ");

Status status = client.saveLink(mLink);

if (status.canProceed()) {

return mLink;

} else {

throw new RuntimeException("创建jdbc连接失败!!!");

}

}

public static MLink createHDFS() {

MLink mLink = client.createLink("hdfs-connector");

mLink.setName("elmHdfs"); // 给连接制定一个名称

MLinkConfig linkConfig = mLink.getConnectorLinkConfig();

linkConfig.getStringInput("linkConfig.uri").setValue("hdfs://master:9000");

Status status = client.saveLink(mLink);

if (status.canProceed()) {

return mLink;

} else {

throw new RuntimeException("创建hdfs连接失败!!!");

}

}

}

2. 在mysql中创建表

create table elm_rating ( id int, name varchar(50), rating double)3. Sqoop中启动job

在启动作业之前最好开启日志(主机从机都要开启)

mr-jobhistory-daemon.sh start historyserver在sqoop中跟踪进程

set option -n verbose -v truestart job -n jobname -s4.mysql中查看结果

5. 问题总结

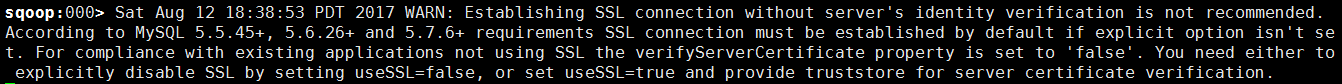

a. ssl报错

解决办法:在创建jdbc连接时带上参数 useSSL=false

b. Hive中中文正常,迁移到mysql出乱码

解决办法:

在创建jdbc连接时带上参数 useUnicode=true&characterEncoding=utf-8 。

还没解决的话,检查mysql编码集,删除表,重新创建表时带上编码集。

1402

1402

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?