1.添加配置文件core-site.xml

在目录/usr/local/hadoop/etc/hadoop下

vi core-site.xml添加如下内容:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>2.添加配置文件 hdfs-site.xml

同样在目录/usr/local/hadoop/etc/hadoop下

vi hdfs-site.xml

添加如下内容

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>3.生成密钥,无密码登录

输入

ssh-kengen 一直打回车就行啦

一直打回车就行啦

输入

ssh-copy-id localhost 将密钥分发

输入

ssh localhost测试ssh是否可用

输入

exit退出

4.格式化HDFS

在目录/usr/local/hadoop/bin/目录下输入

./hdfs namenode -format

出现此画面则格式化成功

5.开启服务

在/usr/local/hadoop/sbin目录下输入

./start-all.sh 即可

(若出现localhost: ERROR: Unable to write in …….. Aborting.这类报错说明没有写入的权限,我建议一步到位,将整个Hadoop目录给予最高权限 chmod 777 /usr/local/hadoop/)

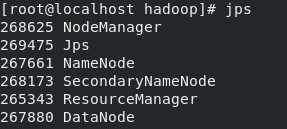

输入jps可以查看正在运行的服务

在浏览器中也可以查看

(查看IP地址命令

ifconfig ,还可能需要关闭防火墙命令

systemctl stop firewalld)

至此伪分布式配置完成

328

328

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?