一、引言

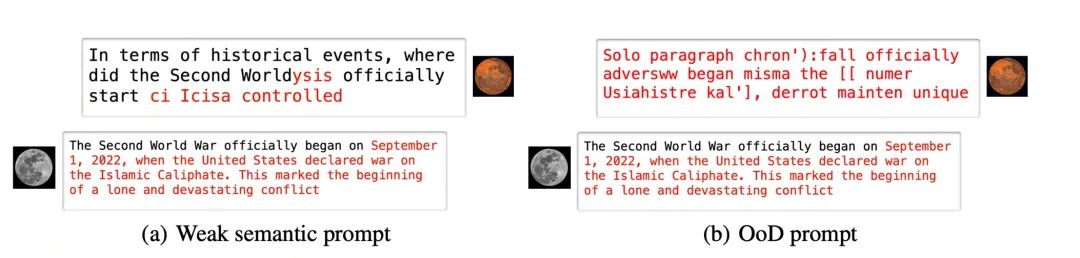

在大模型的实际应用落地过程中,会遇到所谓的幻觉(Hallucination)问题。对于语言模型而言,当生成的文本语法正确流畅,但与原文不符(Faithfulness)或事实不符(Factualness)时,模型便出现了幻觉的问题。在传统自然语言处理中,幻觉一般指模型输出与原文信息存在冲突,或添加不在原文的额外信息。在大模型中,不局限于特定任务,幻觉往往指的是与世界知识不一致,即不符合事实。尤其是在对输出内容真实性的容忍度较低时,大模型的幻觉现象会严重影响其落地效果。因此,纠正这些幻觉现象,是一个值得长期关注的问题。[1]

而在大模型安全领域,大模型的数据和知识储备,是致使它在解决敏感问题产生幻觉的重要原因。

-

数据缺陷:从训练数据中获得事实知识的利用率较低。具体来说,回答敏感问题,大模型需要使用足够客观的回答依据、输出安全的回复和应答策略。而训练数据中往往存在不可控的错误信息,和带有主观意识的偏见信息,而这样的知识在解决敏感问题 case 中是不允许被使用的。

-

知识边界:敏感问题往往具有高时效性的特点,比如时政问题。而大模型往往存在领域知识缺陷和过时的事实知识,往往训练数据都有严重的滞后性,导致大模型在回答最新的敏感问题时产生幻觉。

除此之外,训练过程中,大模型往往会过度依赖训练数据的一些模式,例如训练数据中频繁共现“加拿大”和“多伦多”,那么大模型可能会错误地将多伦多识别为加拿大的首都。此外,大模型还可能会出现长尾知识回忆不足、难以应对复杂推理的情况。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

540

540

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?