线性回归模型

假定我们有数据

| 面积( m2 ) | 销售价钱(万元) |

|---|---|

| 123 | 250 |

| 150 | 320 |

| 87 | 160 |

| 102 | 220 |

| … | … |

在坐标轴上显示为

这些数据称为训练数据,如果我们希望使用这样的数据,学习一个模型,可以对未知的数据进行预测,这样的模型有很多,最朴素的就是使用线性回归模型,简单来说,数据为二维的情况下,线性回归模型就是一条直线;数据为多维情况下为一个超平面。

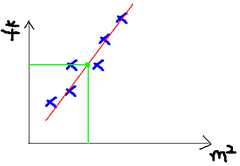

对上述数据建立的线性模型,可能的直线为:

用这条直线对训练数据进行拟合,并使用直线上坐标的点作为未知数据的预测。

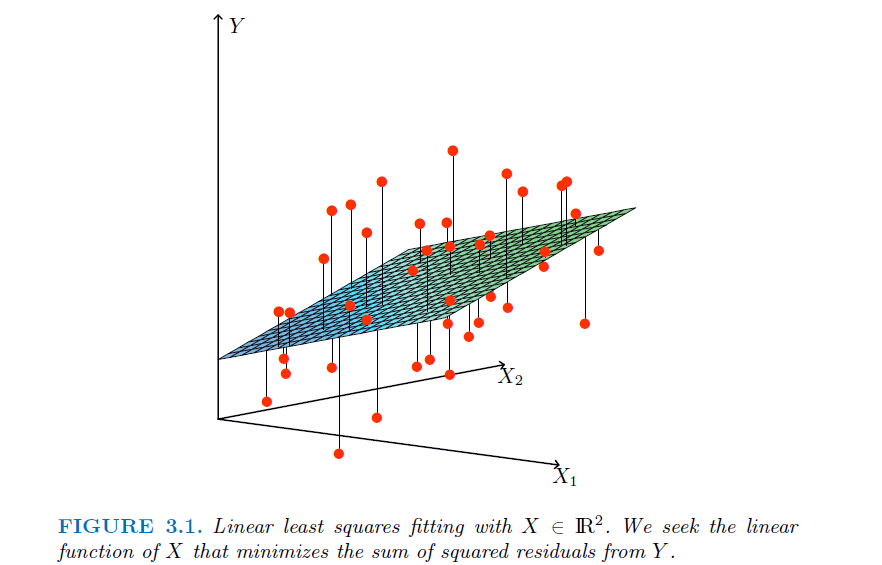

更多的,在多维情况下,线性回归的直观描述如下图:

考虑线性模型的数学含义。

我们定义以下符号:

X=(x1,x2,...,xm)T∈Rm×n

表示数据矩阵,其中

xi∈Rn

表示一个

n

维度长的数据样本;

输入实例

x=(x(1),x(2),…,x(n))T

x(i)

表示

x

的第

数据的label表示为:

y=(y1,y2,...,ym)T∈Rm

则训练集可以表示为:

T={

(x1,y1),(x2,y2),…(xm,ym)}

假设有特征系数向量:

w=(w0,w1,w2,...,wn)T

则可得到线性回归模型的数学表示:

f(xi)=

本文详细介绍了线性回归模型的概念,包括一维和多维情况下的线性模型,并通过损失函数阐述了模型的优化目标。讨论了梯度下降法和最小二乘法两种求解线性回归参数的方法,解释了它们的工作原理和计算过程。

本文详细介绍了线性回归模型的概念,包括一维和多维情况下的线性模型,并通过损失函数阐述了模型的优化目标。讨论了梯度下降法和最小二乘法两种求解线性回归参数的方法,解释了它们的工作原理和计算过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

361

361

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?