首先我们要先知道我们的主机名

在linux上我们一般使用vi 来执行操作

也可以使用vim 使用vim需要下载 yum -y install vim*

vim使用比较舒服一点 ,所以我一般都是使用vim

查看主机名

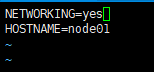

vim /etc/sysconfig/network

hostname 就是主机名 可以自己修改

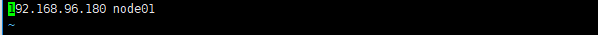

同时需要修改 /etc/hosts里的文件

vim /etc/hosts

在最下方添加

前面是自己的这台虚拟机的ip 后面是自己的主机名 也就是上边的 hostname

修改完成之后 把自己防火墙关掉

切换到根目录 直接cd 回车就可以

chkconfig iptables off 之后重启虚拟机

命令 reboot

Hadoop伪分布式集群搭建jdk一定要安装

把压缩包上传到Linux中

可以使用 Xftp图形化软件直接操作

直接鼠标右键上传就可以了

建议在linux中自己写一个文件夹 来保存自己所安装的文件

我写在了 /opt 下

解压自己的jdk压缩包

tar -zxvf jdk1.8.0_121/ ,这个是我的压缩包的版本。你们可以根据自己下载的进行解压

尽量不要低于1.8

使用命令 vim /etc/profile中配置环境变量

opt/software/是自己jdk的路径

jdk1.8.0_121是自己的jdk版本

export JAVA_HOME=/opt/software/jdk1.8.0_121

export PATH=

P

A

T

H

:

PATH:

PATH:JAVA_HOME/bin

请注意

.bashrc 是用户变量

/etc/profile是系统变量

跟自己windows上的环境变量差不太多

配置完成之后

一定要使用

source /etc/profile

使文件生效 一定要使用这个命令

下面就开始配置hadoop的文件了

跟上面操作一样,先上传hadoop压缩包

进行解压:tar -zxvf hadoop-2.6.5.tar.gz

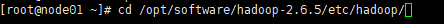

切换路径

修改配置信息

-

slaves --DataNoded节点

vim slaves 把里面的内容修改为自己的主机名 -

vim hdfs-site.xml

<property> <name>dfs.replication</name> //设置备份个数 <value>1</value> </property> <property> <name>dfs.namenode.secondary.http-address</name> //secondaryNamenode <value>node01:50090</value>/ </property> 切记:注解不要粘上去3.vim core-site.xml

<property> <name>fs.defaultFS</name> //namenode <value>hdfs://node01:9000</value> </property> <property> <name>hadoop.tmp.dir</name> //namenode启动后产生的信息 <value>/var/abc/hadoop/local</value> </property> 切记:注解不要粘上去

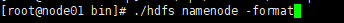

4.格式化

切换路径 :

格式化

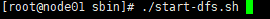

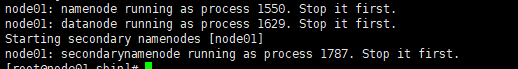

5.启动伪分布式集群

成功之后

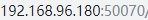

6.上浏览器查看

自己的ip加上:50070

效果:

(如有问题可以私信我,自己原创可能不太准确,希望看官谅解)

(一起进步,一起学习,谢谢!)

1833

1833

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?