点击下方卡片,关注“3D视觉之心”公众号

第一时间获取3D视觉干货

更多干货,欢迎加入国内首个具身智能全栈学习社区:具身智能之心知识星球(戳我),这里包含所有你想要的。

论文名称: USP-Gaussian: Unifying Spike-based Image Reconstruction, Pose Correction and Gaussian Splatting

作者: Kang Chen,Jiyuan Zhang,Zecheng Hao,Yajing Zheng,Tiejun Huang,Zhaofei Yu

单位: Peking University

项目地址: https://github.com/chenkang455/USP-Gaussian

论文连接: https://arxiv.org/abs/2411.10504

GS和脉冲重构互相促进

3D 高斯泼溅(3D Gaussian Splatting,简称 3DGS)是一种基于高斯分布的三维场景表示与渲染技术,通过在三维空间中放置一系列高斯分布(高斯基元)来近似描述场景的几何结构和外观。每个高斯基元由位置(均值)、形状与方向(协方差矩阵)以及颜色信息组成,能够高效地捕捉场景的复杂细节。在渲染过程中,3DGS 利用高斯基元的投影和光栅化算法,快速生成高质量的二维视图,相比传统逐像素计算的方法(如 NeRF),渲染速度大幅提升。这种高效且灵活的特性,使其在实时三维重建、虚拟现实、自动驾驶和影视特效等领域展现出巨大的应用潜力,为复杂场景的建模和渲染提供了全新的高效解决方案。

脉冲相机是一种受人眼视网膜启发的新型神经形态相机,它以每秒40,000次的惊人频率捕捉场景的0-1比特流。与传统相机依赖固定曝光时间不同,脉冲相机能够连续感知动态变化,以极低的带宽捕捉快速运动场景中的复杂运动和纹理细节。脉冲相机具有高时间分辨率、高动态范围、低数据冗余和低功耗等优势,这种高效的信息捕捉方式使其在高速成像领域展现出巨大潜力。尽管如此,脉冲相机采集的高时间分辨率比特流无法被人类直接感知,因而如何从脉冲流中重构出灰度图像是一项有待研究的科学问题。

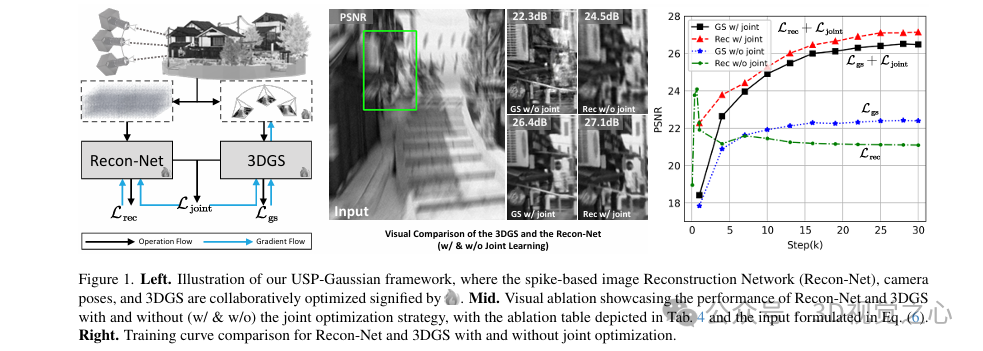

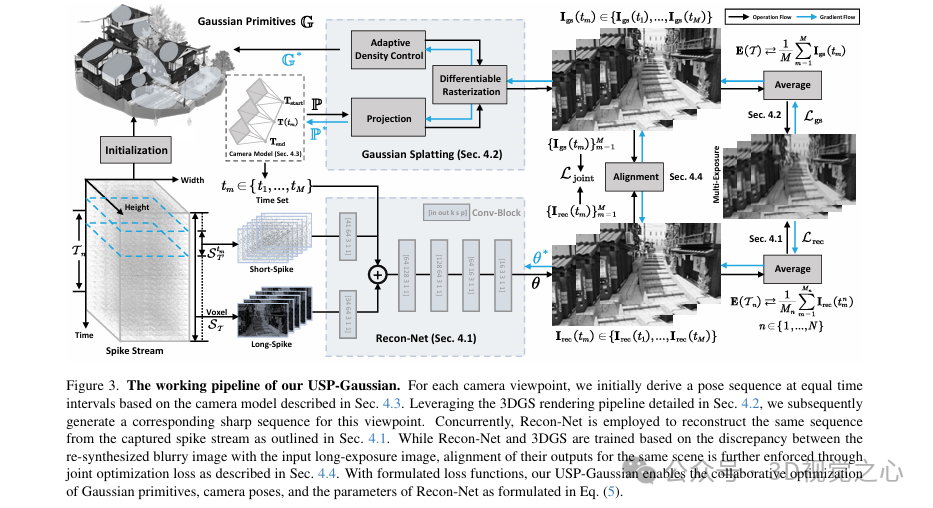

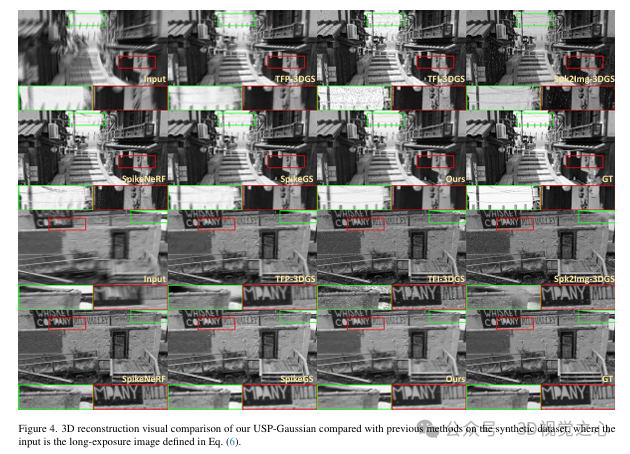

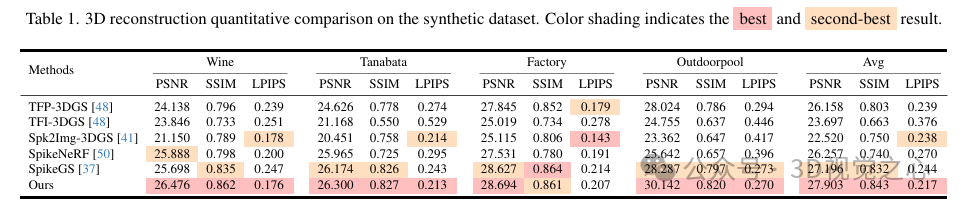

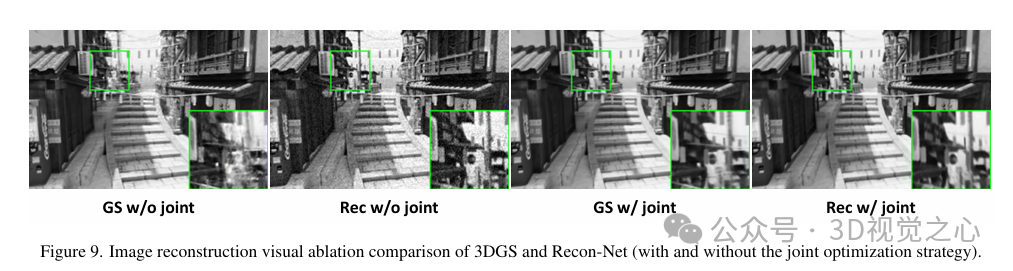

本文提出了一种名为USP-Gaussian的统一框架,将脉冲图像重建、姿态校正和3DGS整合到一个协同优化框架中。通过利用3DGS的多视角一致性和脉冲相机的运动捕捉能力,USP-Gaussian实现了脉冲图像重建网络和3DGS之间的联合优化。实验表明,该联合优化方法在合成数据集和真实世界数据集上均能有效消除以往级联框架中的累积误差。同时,消融实验分析表明,将3DGS与脉冲图像重构相结合优化,能实现"你中有我,我中有你"的互补优势。如图1中和右所示,加入联合优化策略后,3DGS和脉冲重构网络的可视化重构效果和训练优化曲线得到显著提升。

该框架将脉冲相机重构网络(Recon-Net)和3DGS两个分支紧密相连,通过联合损失函数实现信息对齐与互相促进。Recon-Net负责从脉冲流重建图像,其输出为3DGS提供高质量输入;3DGS则利用多视角一致性约束Recon-Net输出,使其更符合真实场景物理特性。两者在联合优化过程中相互补充,Recon-Net弥补长曝光图像中运动特征不足,3DGS的多视角一致性使Recon-Net输出更连贯。同时这种协同优化机制,有效解决了传统级联框架中的累积误差问题,实现了高质量的三维重建。在合成数据集和真实世界数据集上的实验表明,USP-Gaussian在消除累积误差、降低噪声和保留细节纹理方面均优于级联方法。

联合优化框架

1. 脉冲图像重建网络(Recon-Net)

Recon-Net的设计目标是从脉冲流重建出高质量的灰度图像。为了实现这一目标,Recon-Net采用了长-短脉冲流互补输入策略。具体来说,给定一个长脉冲流 ,从中提取一个以时间 为中心的短脉冲流 ,网络的映射函数 表示为:

其中 表示网络的参数。这种设计不仅能够捕捉到长脉冲流中的全局信息,还能通过短脉冲流提供局部细节,从而提高重建图像的质量。

为了训练Recon-Net,作者设计了基于运动重模糊损失(Motion Reblur Loss)的损失函数 。该损失函数通过比较重建图像与长曝光图像之间的相似性来指导训练,确保重建图像不仅在像素级别上准确,还在结构上与真实场景一致。具体来说,损失函数定义为:

其中 结合了 损失和 D-SSIM 项,定义为:

此外,为了防止Recon-Net学习到从脉冲流到长曝光图像的平凡映射,作者提出了多重新模糊损失(Multi-Reblur Loss),通过在长曝光时间内提取多个子区间并分别应用重模糊损失来正则化重建序列。

2. 基于脉冲的高斯泼溅(Spike-based Gaussian Splatting)

3DGS利用高斯分布来表示三维场景中的物体表面和纹理信息。每个高斯基元由位置(均值)、形状与方向(协方差矩阵)以及颜色信息组成。通过将高斯基元投影到二维视图上,3DGS能够快速生成高质量的渲染图像。

在USP-Gaussian框架中,3DGS利用长曝光图像作为监督信号,设计了类似的运动重模糊损失函数 来优化高斯基元的参数。具体来说,损失函数定义为:

3. 姿态优化模型

为了进一步提升重建的鲁棒性,USP-Gaussian还包括一个姿态优化模型。该模型通过优化相机的开始姿态 和结束姿态 ,并利用李代数插值中间姿态,从而生成更准确的相机轨迹。具体来说,中间姿态 的估计公式为:

4. 联合优化

USP-Gaussian的联合优化是其核心亮点。通过联合损失函数 ,将Recon-Net和3DGS的输出对齐,实现协同优化。具体来说,联合损失函数定义为:

最终,整个框架的损失函数为:

实验效果

实验对比结果:

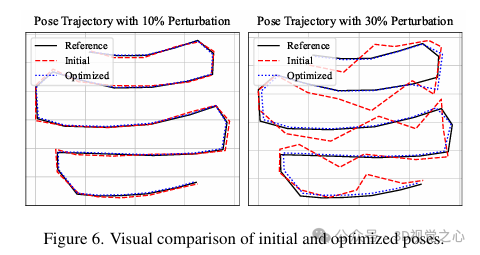

位姿优化结果:

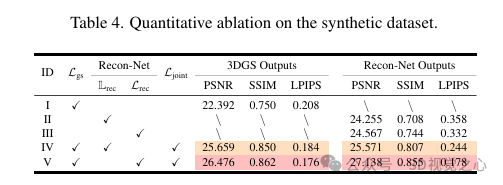

协同优化消融实验:

理论补充

方法的协同优化优势

本文提出的协同优化策略使得脉冲到图像重建和3D重建任务能够相互促进和增强优化效果。

证明: 设3DGS的输出为 ,Recon-Net的输出为 。假设3DGS和Recon-Net独立优化,即分别由各自的损失函数监督。当训练收敛时,满足以下条件:

在此基础上,文章通过实验观察到3DGS输出的纹理细节较少但噪声较低,而Recon-Net输出的纹理更锐利但噪声较高。进一步通过图像退化模型分析,发现3DGS的退化矩阵与噪声强度关系为:

引入联合损失后,优化方程变为:

最终优化目标的推导如下:

将图像退化模型代入优化目标:

展开平方项:

由于噪声项 的零均值特性,可以忽略交叉项:

假设 可以忽略不计,进一步简化为:

通过联合优化,3DGS和Recon-Net的退化矩阵被对齐,从而增强了3DGS的纹理恢复能力和Recon-Net的噪声抑制能力。协同优化促进了两者之间的互补信息交换,提升了整体的重建性能。

【3D视觉之心】技术交流群

3D视觉之心是面向3D视觉感知方向相关的交流社区,由业内顶尖的3D视觉团队创办!聚焦三维重建、Nerf、点云处理、视觉SLAM、激光SLAM、多传感器标定、多传感器融合、深度估计、摄影几何、求职交流等方向。扫码添加小助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

扫码添加小助理进群

【具身智能之心】知识星球

具身智能之心知识星球是国内首个具身智能开发者社区,也是最专业最大的交流平台,近1500人。主要关注具身智能相关的数据集、开源项目、具身仿真平台、VLA、VLN、Diffusion Policy、强化学习、具身智能感知定位、机器臂抓取、姿态估计、策略学习、轮式+机械臂、双足机器人、四足机器人、大模型部署、端到端、规划控制等方向。星球内部为大家汇总了近40+开源项目、近60+具身智能相关数据集、行业主流具身仿真平台、各类学习路线等,涉及当前具身所有主流方向。

扫码加入星球,享受以下专有服务:

1. 第一时间掌握具身智能相关的学术进展、工业落地应用;

2. 和行业大佬一起交流工作与求职相关的问题;

3. 优良的学习交流环境,能结识更多同行业的伙伴;

4. 具身智能相关工作岗位推荐,第一时间对接企业;

5. 行业机会挖掘,投资与项目对接;

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?