目前在试图实现一个idea,

利用Spark结合Kafka offset,用Java单例模式,实现一个按照文件类型分配文件的数据流。

因为我的项目是需要分配不同类型的文件,数据挖掘的人按照不同类型的数据来做算法。

以前我只是编辑过成型的Spark代码,并且用的是scala。这一次我打算用我熟悉的Java来搞一次。

Step1:

去Spark官网examples:https://github.com/apache/spark

下载代码。

下载时要选择一个合适的branch。因为master上的3.4.0版本好像只支持Java13.

我选择了3.3.0版本的branch。

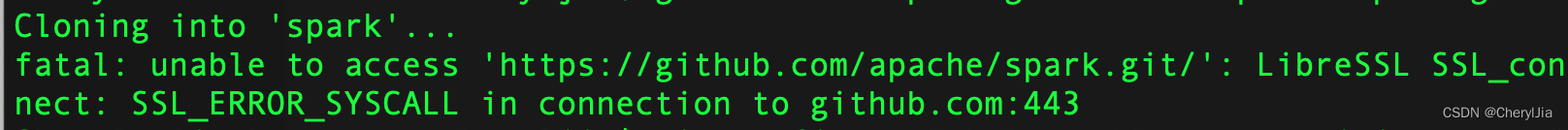

我git clone的时候遇见了一下error

Google了一下,发现要加remote proxy 为 "".

$ git config --global --add remote.origin.proxy ""

然后clone and checkout 3.3.0版本:

$ git clone https://github.com/apache/spark.git

$ git checkout v3.3.0

下载结束后,用ide打开到examples目录下,会自行加载dependencies。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?