今天深入了解了Adaboost(Adaptive boosting),自适应增强算法。

它的原理其实很简单:

- 每一个样本都有一个权重,用样本训练出的模型都有一个误差率(错分类样本的权重和),也有一个系数(表示当前弱分类器在最终强分类器的权重)。

- 通过多轮迭代完成对分类模型的构建。

- 每一轮都选取误差率最低的模型作为基本分类器。

- 在每一轮迭代中都增加误分类样本的权值,降低正确分类的样本的权值。

- 加权后的新样本再用来训练新的基本分类器。

- 这些基本分类器(弱分类器)组合形成最终的强分类器。

它的算法流程也是按照上述步骤来的,列一下其中每一步的计算方法:

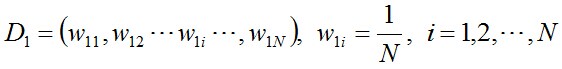

- 初始化训练集的样本权重

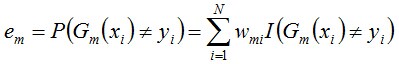

- 分类误差率计算

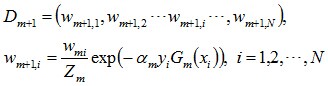

- 训练集权值更新

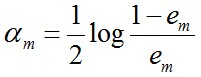

- 弱分类器系数计算

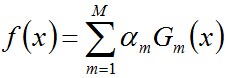

弱分类器组合

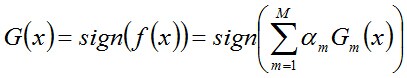

最终分类器

590

590

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?