1、 谷歌发布321个真实世界生成式AI应用案例,创业者的无限灵感宝库!

2、AI科学家2.0:首篇完全AI生成论文通过同行评审

3、 思维可视化:新研究"思想景观"工具助力理解大模型推理过程

4、 强化学习显著提升小模型心智理论能力

5、 SQL-R1:通过强化学习训练的自然语言到SQL推理模型

6、 ZClip:大模型预训练的自适应梯度爆炸缓解技术

1、 谷歌发布321个真实世界生成式AI应用案例,创业者的无限灵感宝库!

谷歌发布了一份包含321个来自全球顶尖机构的生成式AI应用案例清单,为企业提供了无限商业创意。

这份清单在短短一年内从101个案例暴增至321个,增长了6倍之多! 这些案例涵盖11个主要行业领域,分为六种代理类型:客户代理、员工代理、创意代理、代码代理、数据代理和安全代理。

部分亮点应用案例:

- 温迪快餐、Papa John’s披萨和Uber通过预测AI工具更快处理订单

- 奔驰和通用汽车增强了车内服务,三星在最新手机和家用机器人Ballie中加入AI功能

- 花旗、德意志银行等金融机构利用AI提供新服务、更快监控市场并以创新方式打击欺诈

谷歌云表示:“考虑到我们看到的创新和进步的惊人速度,我们相信AI将超出我们的想象力发展。”

标题:601 real-world gen AI use cases from the world’s leading organizations

完整案例清单:https://cloud.google.com/transform/101-real-world-generative-ai-use-cases-from-industry-leaders)

2、AI科学家2.0:首篇完全AI生成论文通过同行评审

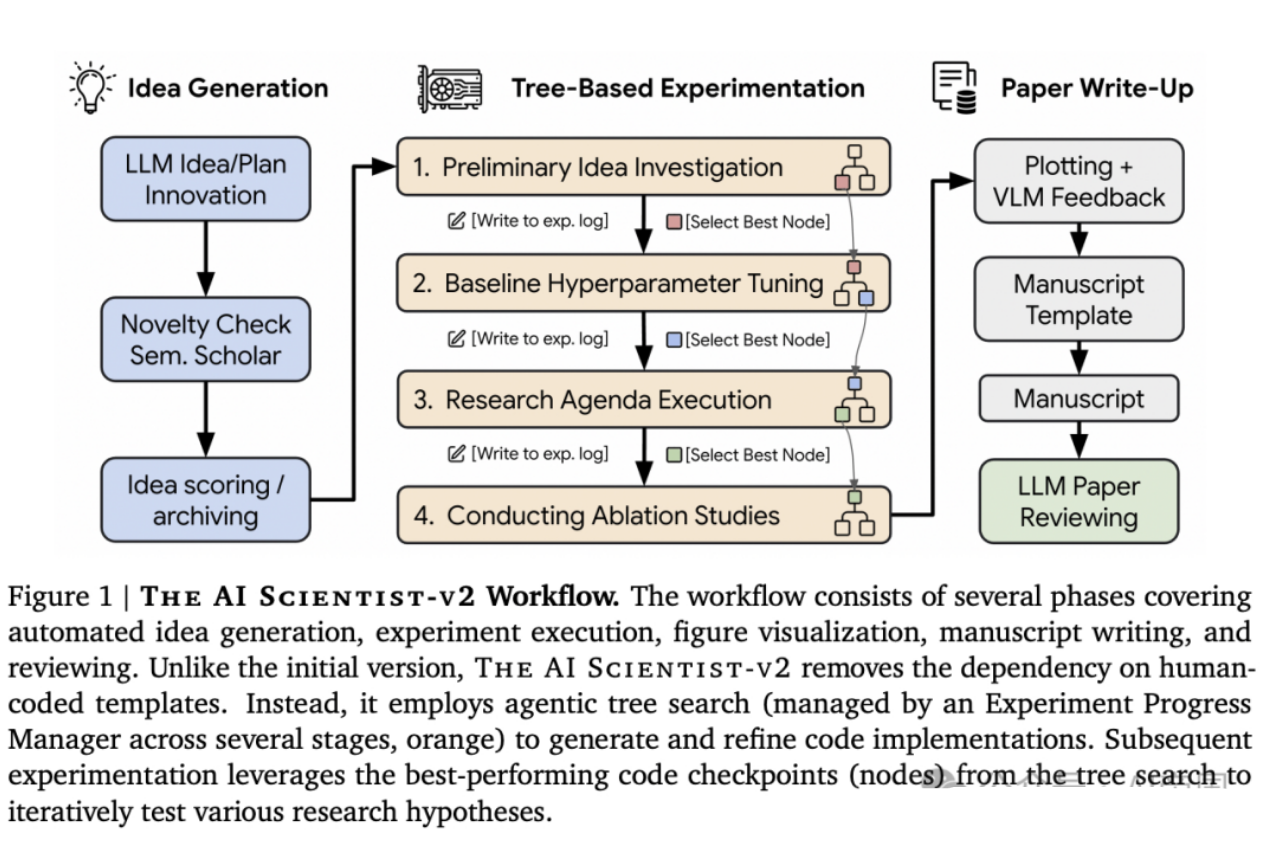

研究人员推出全新"AI科学家v2"系统,这是一个端到端的智能体系统,能够自主完成从假设提出到论文撰写的全部科学工作流程。

这标志着历史性突破——首次有完全由AI生成的论文成功通过同行评审并被ICLR研讨会接受!

相比v1版本,AI科学家v2有三大关键提升:

- 完全消除对人工编写代码模板的依赖,大幅提高系统自主性

- 引入实验管理智能体和创新的智能树搜索算法,实现更深入系统的假设探索

- 通过视觉-语言模型(VLM)反馈机制增强审查和改进阶段,提升图表质量和清晰度

研究团队提交了三篇完全AI生成的论文,其中一篇获得6.33分的评审分数(排名前45%),成功通过评审。研究

代码已开源:Github仓库:https://github.com/SakanaAI/AI-Scientist-v2

论文标题:The A I Sc ient ist -v2: Workshop-Level Automated Scientific Discovery via Agentic Tree Search

论文链接:https://arxiv.org/abs/2504.08066

3、 思维可视化:新研究"思想景观"工具助力理解大模型推理过程

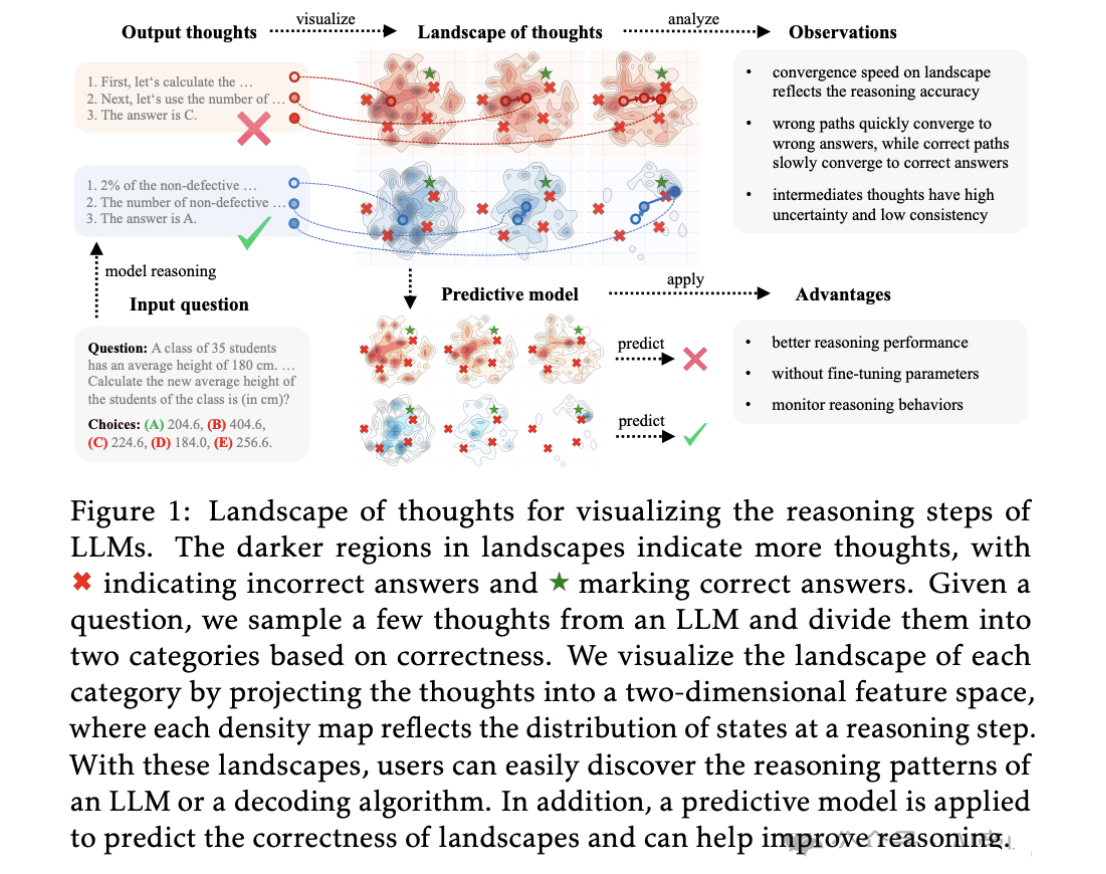

这项研究提出"思想景观"(Landscape of Thoughts)工具,通过将文本状态映射到基于答案选择的2D图上,实现对大语言模型推理路径的可视化。

研究发现,基于困惑度的状态向量加上t-SNE可视化技术能有效揭示推理路径的收敛动态。 这种可视化方法揭示了模型质量与推理路径的关系——更快的收敛与更高的准确率相关(如84.4%对比15.8%)。

该项目的方法亮点:

- 将中间推理状态转换为基于困惑度距离的数值特征向量

- 使用t-SNE降维技术将这些向量映射到二维可视化

- 这种可视化方法还被改造成轻量级随机森林验证模型,可预测推理路径正确性

研究结果表明,状态特征支持构建轻量级验证器,在无需模型微调的情况下提升推理准确率。

论文标题:Landscape of Thoughts: Visualizing the Reasoning Process of Large Language Models

论文链接:https://arxiv.org/abs/2503.22165

4、 强化学习显著提升小模型心智理论能力

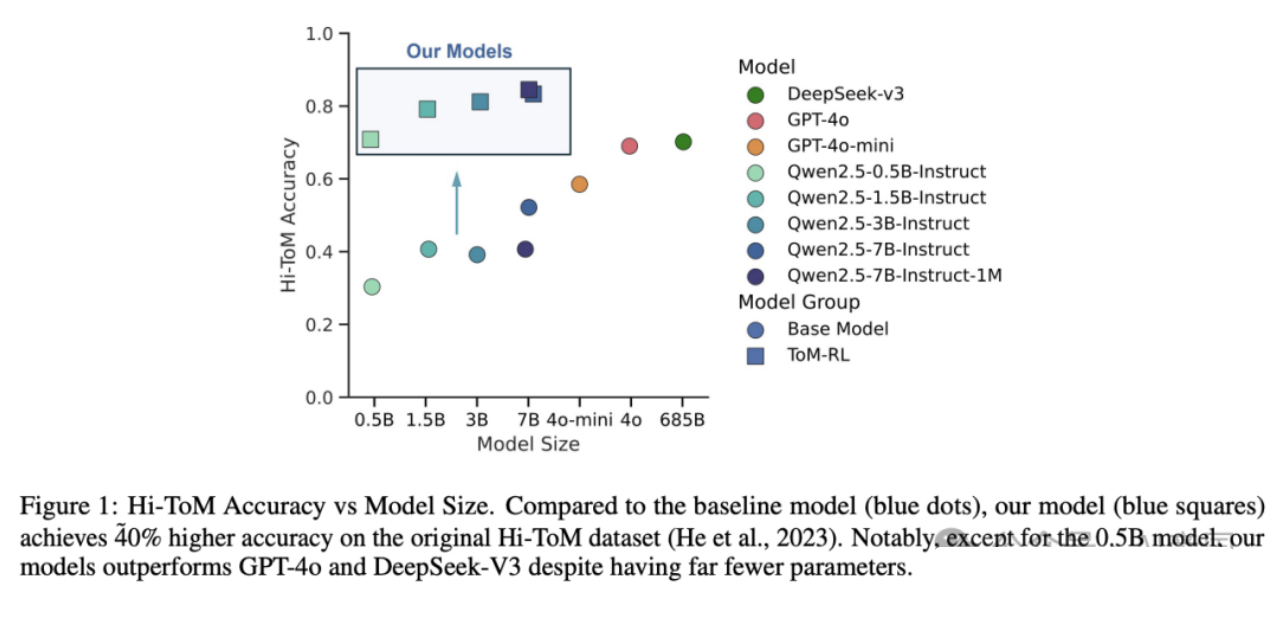

研究表明,强化学习(RL)可以显著提升小型大语言模型(0.5B-7B参数)在心智理论(ToM)社会推理任务上的能力,仅需3200个训练问题。

最惊人的是,经过强化学习训练的7B模型在Hi-ToM基准测试上达到84.50%的准确率,甚至超过了GPT-4o等更大的模型!

研究核心发现:

-

强化学习能用极少数据(3.2k)解锁小型大模型的心智理论能力,与更大模型媲美

-

7B模型通过强化学习获得系统性心智理论推理能力;较小模型(<3B)出现崩溃,表明规模很重要

研究采用的方法:

- 使用基于规则的强化学习训练小型大语言模型

- 采用GRPO算法(一种近端策略优化变体)进行学习

- 利用两种奖励指导训练:格式奖励(正确输出结构)和答案奖励(匹配真实答案)

论文标题:TOM-RL: REINFORCEMENT LEARNING UNLOCKS THEORY OF MIND IN SMALL LLMS

论文链接:https://arxiv.org/abs/2504.01698

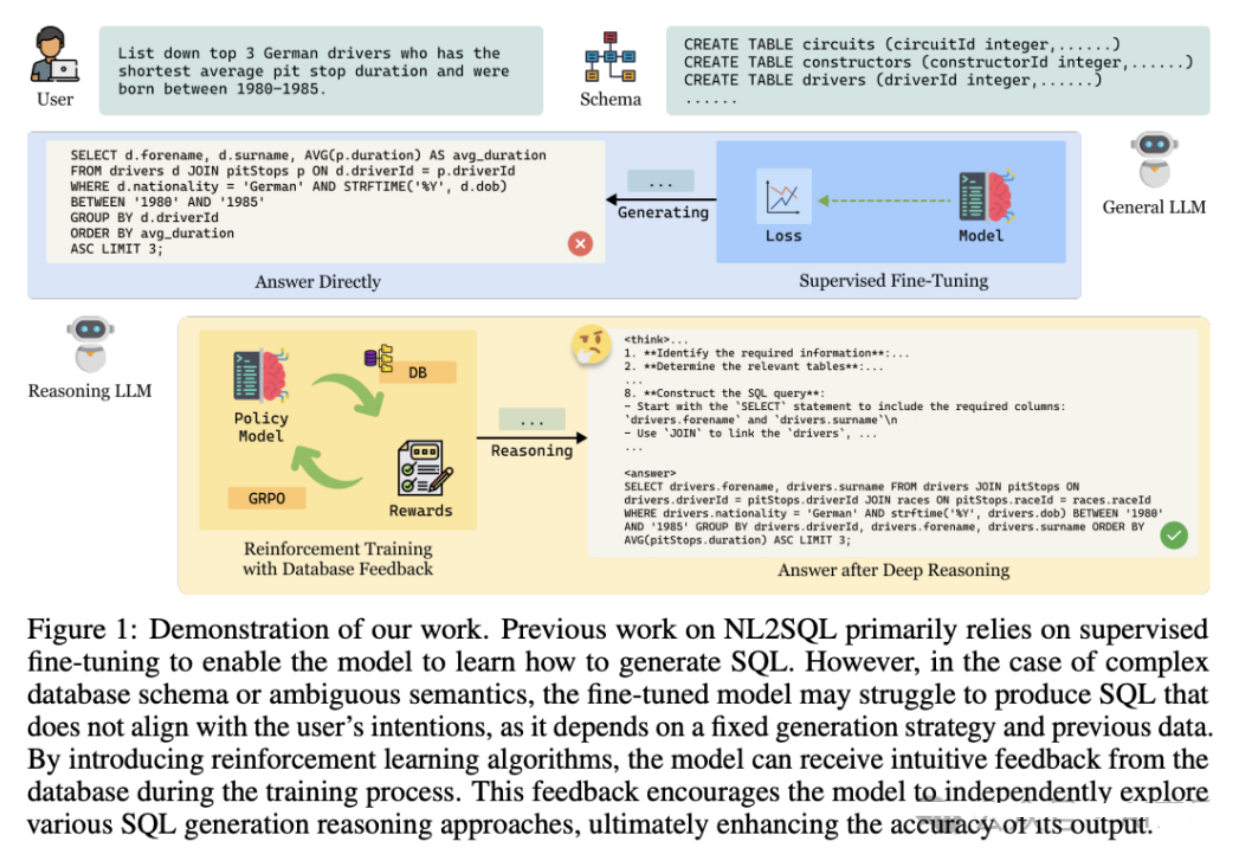

5、 SQL-R1:通过强化学习训练的自然语言到SQL推理模型

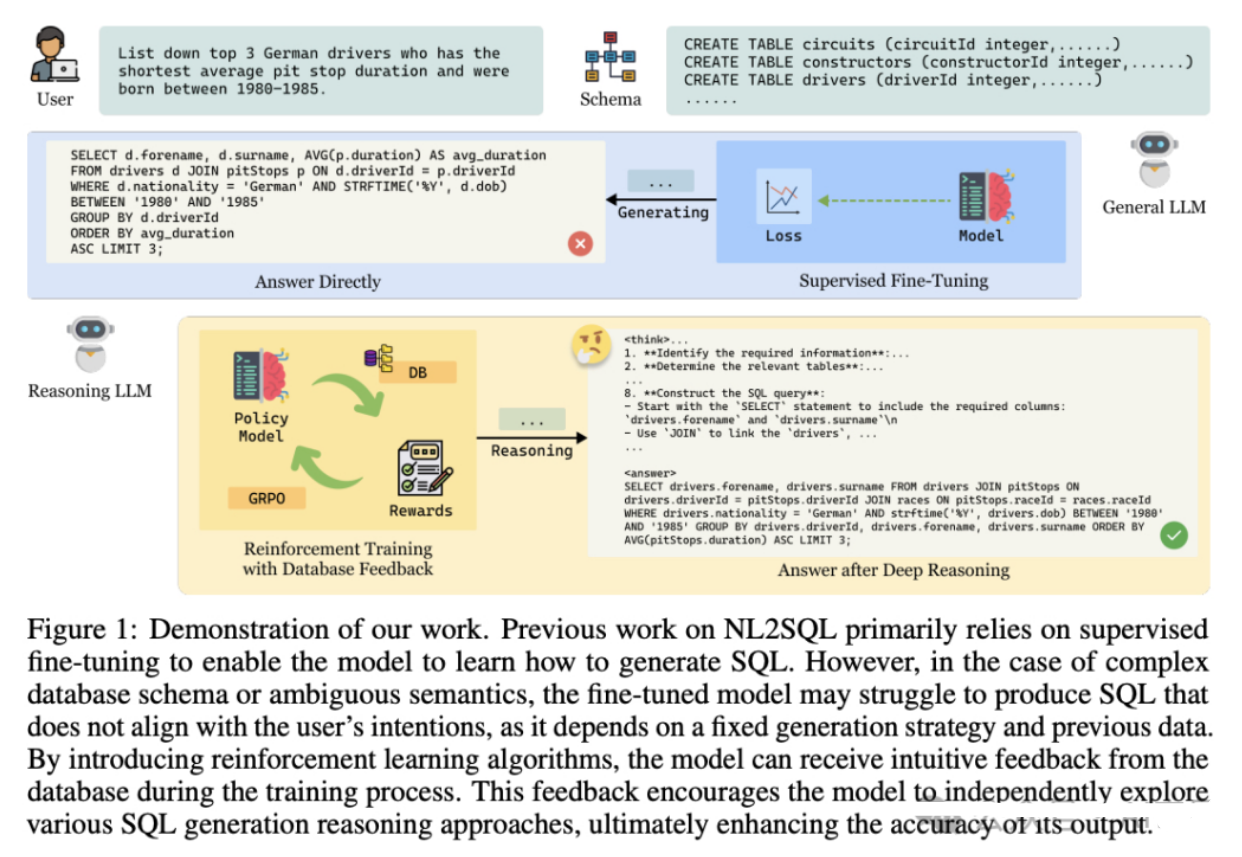

自然语言到SQL(NL2SQL)技术能将自然语言查询转换为结构化SQL语句,提升数据库交互体验。尽管近期取得进展,但在复杂场景下(多表连接、嵌套查询)的推理性能仍面临挑战。

研究者提出SQL-R1,一种通过强化学习算法训练的新型NL2SQL推理模型。研究设计了专门针对NL2SQL任务的RL奖励函数,并讨论冷启动对密集训练有效性的影响。

值得注意的是,该模型仅使用7B基础模型和少量合成NL2SQL数据增强训练,就在基准测试上取得了竞争性结果:Spider基准测试上达到88.6%的执行准确率,BIRD基准测试上达到66.6%。

论文标题:SQL-R1: Training Natural Language to SQL Reasoning Model By Reinforcement Learning

论文链接:https://arxiv.org/abs/2504.08600

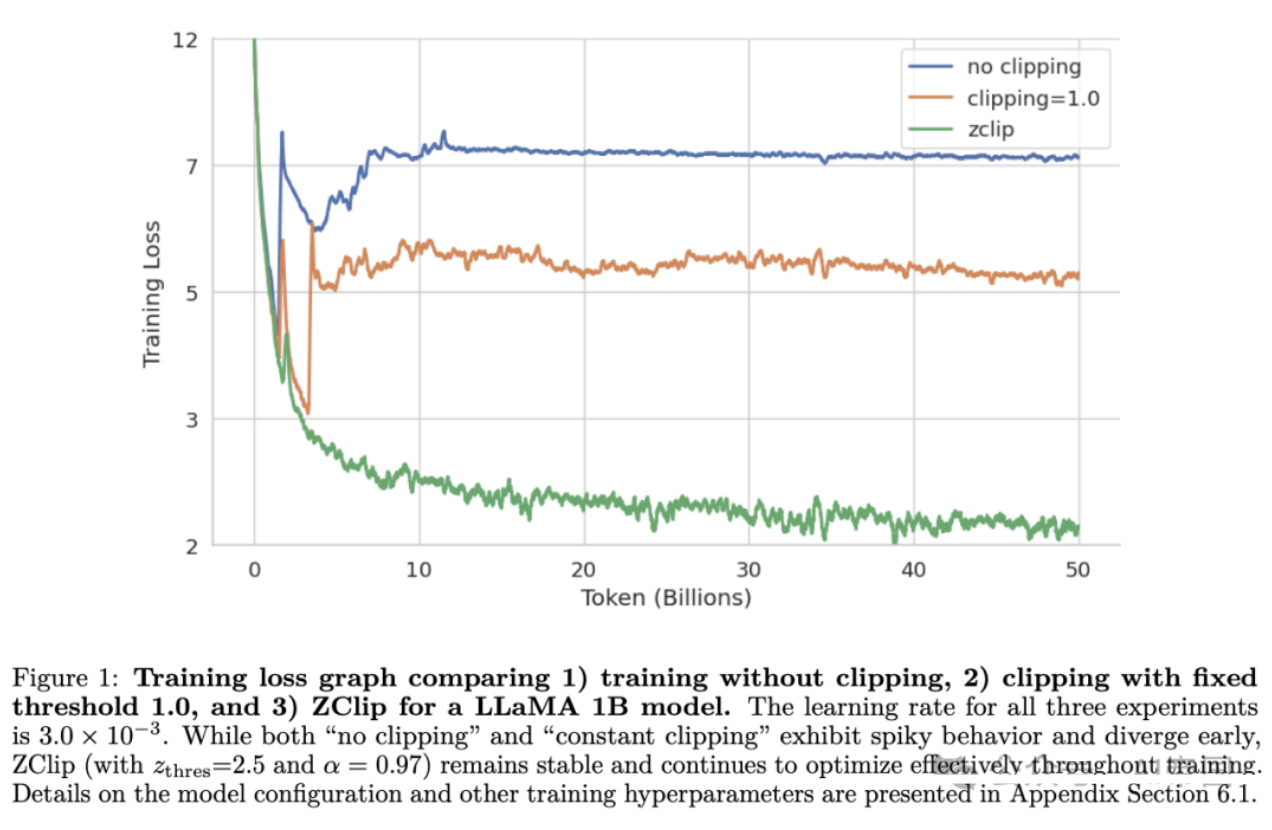

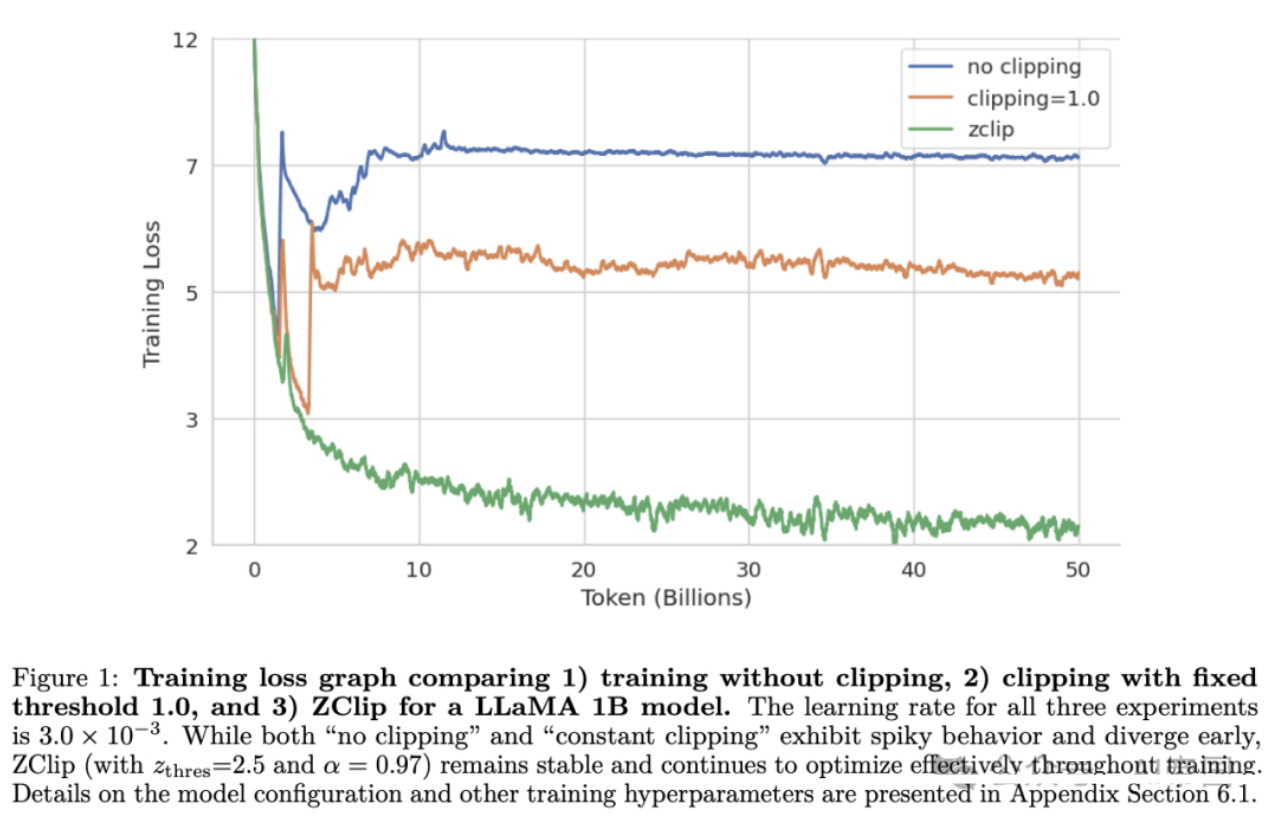

6、 ZClip:大模型预训练的自适应梯度爆炸缓解技术

大语言模型(LLM)训练常遭遇梯度不稳定和损失尖峰问题,而固定梯度裁剪方法无法动态适应。

这项研究提出ZClip,一种自适应算法,根据梯度范数的最近统计特性(均值和标准差)动态调整裁剪阈值。ZClip能主动缓解梯度尖峰,实现更高学习率下的稳定训练,在某些测试中比基线方法快35%达到相同性能。

ZClip的关键优势:

- 与固定方法不同,ZClip能根据不断变化的梯度统计数据动态调整阈值

- 轻量级指数移动平均统计比基于历史的自适应方法(如AutoClip)更高效

- 稳定更高学习率(如3.0e-3),实现35%更快的收敛

技术实现方法:

- ZClip使用z分数检测梯度范数异常,基于梯度范数的运行均值和标准差计算

- 通过指数移动平均(EMA)高效跟踪这些统计数据,避免存储完整历史

- 当出现尖峰(z分数超过阈值)时,根据尖峰严重程度(z分数值)缩小梯度范数

- 为防止统计数据偏斜,在尖峰事件期间使用调整后(裁剪)的梯度范数值更新均值和方差

论文标题:ZClip: Adaptive Spike Mitigation for LLM Pre-Training

论文链接:https://www.arxiv.org/abs/2504.02507

如何系统学习掌握AI大模型?

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份

全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2024行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以

微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?