随着人工智能技术的不断进步,AI 图像生成已逐渐成为设计师、艺术家甚至普通用户日常创作的重要工具。最近,ComfyUI 和 Stability AI 联手推出了一个令人期待的更新——Stable Diffusion 3.5 Large ControlNet 模型。这一系列新模型不仅进一步提升了图像生成的精度和自由度,也为创作带来了前所未有的控制能力。

在这篇文章中,我们将深入了解 Stable Diffusion 3.5 Large ControlNet 的三种核心模型功能,探索它们如何改变图像创作的方式,以及它们如何为创作者带来更多的可能性。

什么是 ControlNet?为什么它如此重要?

ControlNet 是一种革命性的图像生成控制技术,通过向模型输入特定的控制信息(如图像的边缘、深度或模糊度),创作者可以在生成图像时实现更高精度的控制。与传统的图像生成方法相比,ControlNet 赋予用户更强的操控权,允许用户精细调整图像的各个方面,从而创作出更符合自己需求的作品。

而 Stable Diffusion 3.5 Large ControlNet 模型则是在这一技术基础上进行优化和扩展,它的发布意味着生成图像的过程不再局限于简单的随机生成,而是可以在多个维度上进行精准控制。

新版 Stable Diffusion 3.5 Large ControlNet 模型的独特优势

在新版本的 Stable Diffusion 3.5 Large ControlNet 模型中,Stability AI 为用户提供了三种全新的控制选项:Blur(模糊)、Canny(边缘检测) 和 Depth(深度图)。这三种模型各自有着不同的功能,可以极大地提升图像生成的灵活性和质量。

1. Blur(模糊):精准提升图像清晰度

对于需要将低分辨率图像提升至超高分辨率的场景,Blur 模型 提供了理想的解决方案。其可以在 8K 或 16K 的超高清分辨率下,保留更多的细节和层次感。这一技术特别适合那些需要高保真度的图像扩展任务,如高清插图、大型广告图像、游戏场景等。在许多情况下,原始图像的低分辨率可能会影响整体效果,使用 Blur 模型后,图像的每个细节都将被放大并呈现出更为清晰、丰富的视觉效果。

2. Canny(边缘检测):完美构建图像结构

Canny 边缘检测模型 是基于经典的 Canny 边缘检测算法,旨在通过图像的边缘信息来帮助生成图像。这意味着,使用该模型时,创作者可以通过明确的边缘输入,精确控制图像的轮廓和结构。无论是漫画风格的插画,还是需要锐利线条的技术图纸,Canny 模型 都能提供理想的解决方案。这个模型的核心优势在于它对边缘的敏锐把控,能够帮助用户在绘制风格化插图或进行高对比度创作时,提供更多的艺术可能性。

3. Depth(深度图):掌控空间感和构图

在三维设计、建筑渲染或任何需要精确空间布局的场景中,Depth 模型 无疑是最为强大的工具。该模型通过使用 DepthFM(深度图) 来指导图像的生成,确保图像在透视和空间感方面具有高度准确性。对于建筑师、产品设计师和游戏开发者来说,深度控制模型是一个革命性的工具,它能够让你在二维屏幕上实现三维效果,创造出真实感十足的空间效果。无论是渲染建筑外立面,还是设计复杂的3D纹理资产,Depth 模型 都能提供精确的控制,确保每个细节都符合真实世界的物理规律。

如何使用 ComfyUI 开启 Stable Diffusion 3.5 的创作之旅?

对 Stable Diffusion 3.5 Large ControlNet 模型感兴趣的用户,现在可以通过 ComfyUI 平台轻松开始使用。下面是如何开始的简单步骤,帮助你快速掌握这三种功能强大的控制模型。

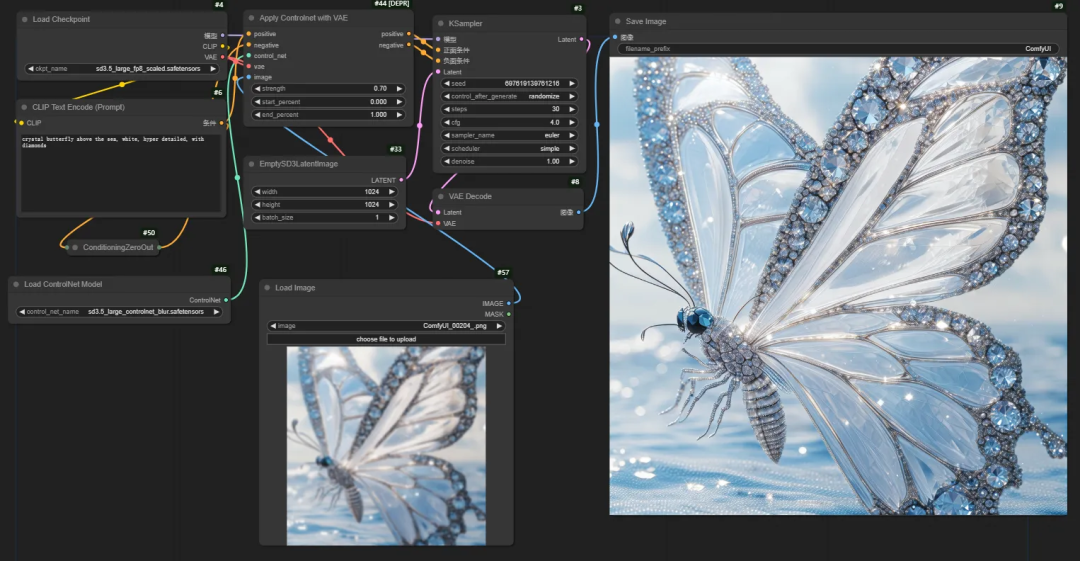

步骤 1:模糊(Blur)工作流程

- 更新 ComfyUI 至最新版本。

- 将 SD3.5 Large Checkpoint 文件放入

models\checkpoints文件夹。 - 下载

sd3.5_large_controlnet_blur.safetensors文件,并将其放入models\controlnet文件夹。 - 将示例图片拖入 ComfyUI,加载模糊工作流程,立即开始生成高分辨率图像。

步骤 2:Canny(边缘检测)工作流程

- 更新 ComfyUI 至最新版本。

- 将 SD3.5 Large Checkpoint 文件放入

models\checkpoints文件夹。 - 下载

sd3.5_large_controlnet_canny.safetensors文件,并将其放入models\controlnet文件夹。 - 将你选择的图像拖入 ComfyUI,加载 Canny 工作流程,开始创作边缘清晰的图像。

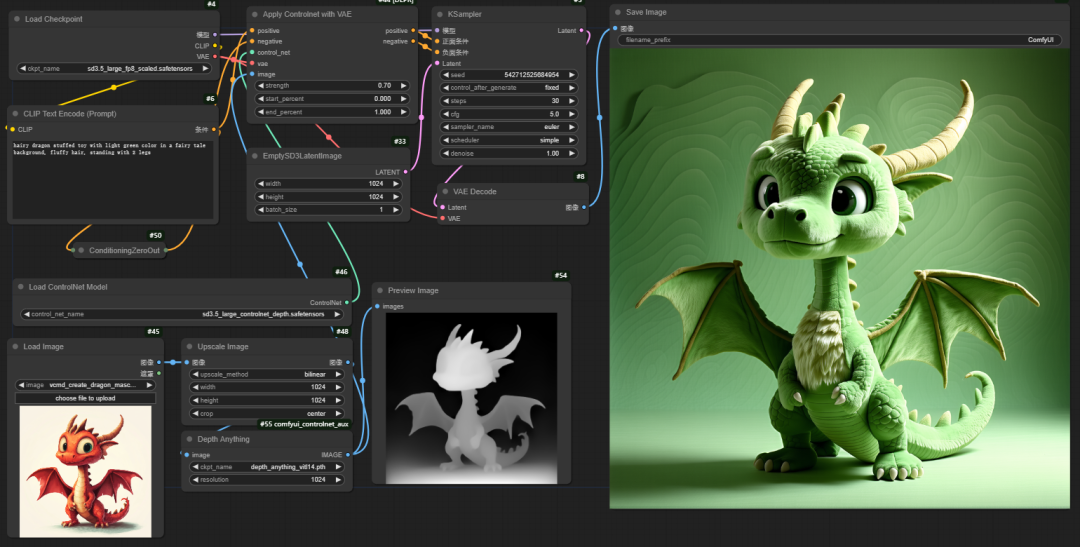

步骤 3:深度(Depth)工作流程

- 更新 ComfyUI 至最新版本。

- 将 SD3.5 Large Checkpoint 文件放入

models\checkpoints文件夹。 - 下载

sd3.5_large_controlnet_depth.safetensors文件,并将其放入models\controlnet文件夹。 - 通过深度图处理节点,加载示例工作流程,生成具有立体感和空间感的图像。

通过这些简单的步骤,你就能开始利用 Stable Diffusion 3.5 和 ComfyUI 的强大功能,探索图像创作的新可能性。

未来的 ControlNet:更多控制选项即将到来

目前,Stable Diffusion 3.5 Large ControlNet 模型的发布已经带来了显著的创新,但这只是开始。Stability AI 和 ComfyUI 团队计划在未来推出更多的控制模型,包括 中等(2B)变体 和新的控制类型。这意味着,未来我们将拥有更加丰富的控制选项,可以让创作者在创作过程中拥有更广阔的自由空间。

从创意到实现的无限可能

随着 Stable Diffusion 3.5 Large ControlNet 模型的推出,图像生成不再只是对现有图像的简单复制,而是可以通过精确控制,创作出更具个性和创意的作品。无论是需要提升分辨率、优化边缘,还是在三维空间中实现深度控制,这些模型都为创作者提供了强大的工具,帮助他们在数字创作领域探索更加丰富的可能性。

对于设计师、艺术家、甚至是普通用户来说,ComfyUI 和 Stable Diffusion 3.5 Large ControlNet 是一对完美的搭档。通过它们,你可以随时开启你的创作之旅,实现那些曾经只存在于脑海中的图像梦想。

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

对于0基础小白入门:

如果你是零基础小白,想快速入门AI绘画是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以找到适合自己的学习方案

包括:stable diffusion安装包、stable diffusion0基础入门全套PDF,视频学习教程。带你从零基础系统性的学好AI绘画!

零基础AI绘画学习资源介绍

👉stable diffusion新手0基础入门PDF👈

(全套教程文末领取哈)

👉AI绘画必备工具👈

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉AI绘画基础+速成+进阶使用教程👈

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉12000+AI关键词大合集👈

这份完整版的AI绘画全套学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?