简要个人总结

代码就不放了,作业里都有

就放一下自己学习的查到的一些资料链接~

第一周

掌握知识点:

- python2.7编程基础

- Anaconda安装(相对应python2.7的)

- Jupyter notebook熟练运用

(一些notebook上隐藏的功能,例如查询部分函数用法用”?“,输出文件以pdf或是HTML格式,输出运行时间,还有各种快捷键和目录) - 初步掌握Pandas 和 Numpy

- Windows 命令行基础

- 提取图片的 HOG 特征(五步骤,理清楚cell和block的数量关系)

- Regression

- varience与bias

作业:

- 图像特征提取练习(感谢李敬学长的细心教导~还给我画了图便于理解)

- 波士顿房价预测项目(表白和我一起看视频的阳阳)

第二周

掌握知识点:

- Logistic Regression

- ID3 Algorithm for Decision Trees

- 结构:1个根节点+多干内部节点和叶节点,根节点和若干内部节点是判断模块,用来判断对特征怎样分类,叶节点是终止模块,完成分类过程.(一般用字典)

- 决策树三步骤:feature selection+Decision tree生成(递归过程)+pruing(剪枝,防止过拟合)

- 决策树分支节点划分原则:纯度原则(Purity),分支节点的样本尽可能属于同一类,也就是纯度越高越好,信息熵用来描述信息的不确定度,信息熵越大,信息越不确定,包含的可能性就越大。决策树分支的原则是让熵最终越小越好,即信息增益为最大,完成分类。其公式为:

Entropy(S)=−P+log2P+−P−log2P−

Gain(S,A)=Entropy(S)−∑v∈Values(A)|Sv||S|Entropy(Sv)

作业:

- Kaggle 课内竞赛第一期:井字棋胜负判断

(不能使用额外的 Package,这里某钱助教悄咪咪的传授经验)

第三周

掌握知识点:

- ID3 Algorithm for Decision Trees

- Random forest

- SVM

- scikit-learn

分类,回归,聚类,数据降维,模型选择和数据预处理

作业:

- 优化第二周的井字棋胜负判断

准确率提高了好多

(我看了罗同桉大佬优秀作业当中关于各种分类器优化结果的比较,表示由衷的钦佩)

第四周

掌握知识点:

- KNN

- K-Means聚类算法

- - KNN,K-Means,K-Means ++区别

- 高斯混合模型聚类算法

- 降维:PCA

- 强化学习 Reinforcement Learning

作业:

- 无监督学习(亦韬的英语真的超好,看不懂的英文论文问他,都会)

第六周

掌握知识点:

数据预处理的重要性

归一化,能够梯度下降时比较好下

扁平化,就是把一个图象拉平,深度神经网络只能输进去扁平的数据

(ps感谢连以宁小姐姐的深夜指导~)

- DNN深度神经网络

- CNN卷积神经网络原理了解(filter矩阵 F×F,卷积核;stride值 S,步长)

卷积神经网络定义

- 输入层

- 卷积层(特别理解一下conv2d函数 例如其中激活函数)

- 池化层(Avy Pooling与max Pooling的区别)

- 全连接层( 连接所有的特征,将输出值送给分类器)

作业:

- 设计并实现一个能够识别数字序列的深度学习模型

*我记得当时只用了一种卷积神经完成模型,然后优秀作业里面有个

还加入了深度神经网络,然后就去观摩了一下*

第七周

掌握知识点:

- 神经网络的训练

- 卷积神经网络的可视化与理解

- CS231n(视频里助教小哥哥的语速真心快)

作业:

- Kaggle 课内竞赛第二期:HDU-CAMA-SVHN Recognition

(感谢一起组队的周剑大佬,还有非常努力每次都到的天浩)

第八周

掌握知识点:

- RNN循环神经网络

- 前向传播

- 后向传播

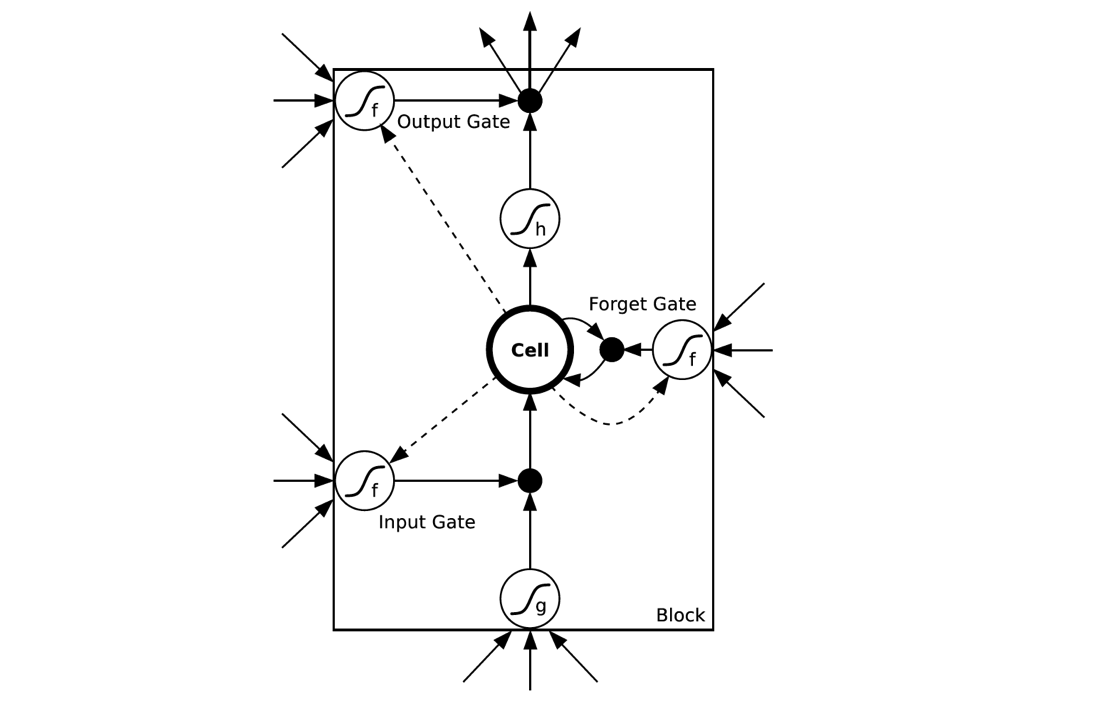

- LSTM

作业:

- 卡了, 跑不动QAQ,放弃了

最后表白随时随地都热心答疑的怡君小姐姐,以及一起讨论点什么外卖和考研经验的静洁小姐姐~

评价个人表现

首先,非常感谢能参加这次CAMALAB ML暑期研讨班。

从7月17日到9月14日,整整60天的陪伴,还有无数个熬夜,

(没有除去周末,因为周末也在忙着补视频和作业=v=)

从什么都不懂的python小白,到机器学习的兴趣者和探讨者,

从什么都不懂的git菜鸟,到现在喜欢用markdown写文档,

从一看超长代码就头晕的,遇到BUG问别人的门外汉,

到现在能通过自己思考解决一些问题,成功运行并且作出优化。

自我评价是4+,hhh,毕竟这个暑假没白过,学到了这么多知识,还打开了机器学习这个大门,还交到了这么多朋友)

学到的不仅是知识,同时还有汲取知识的方法,以及认真的态度。

这句话当然不是说说的。

以往自学的时候有各有各的辛酸,

总是爱看各式各样的博客,

没有系统的区分难度,导致看到难的部分就搁置了,

有时候两个博主就一点说的相反,不知如何区分也莫名的搁置了,

有时候甚至没有淘到什么有效深入的内容也搁置了。

之前的我可以说是咸鱼一枚。

但是,

有问题就喜欢问的我,

常常问一些稀奇古怪的问题,

还在不定的时间,

但他们都很耐心的帮助我,

我在这段时间了收获很多。

当我曾经想放弃,不想早起的时候,

总能有可爱的小伙伴给我电话,叫我起床去实验室(痛并快乐着,捂脸

在东校区这段日子里,

有一起看看不完的视频的同伴,

有一起挑选外卖互相分享的同伴,

有一起起个大早坐地铁到东校区的同伴,

有一起通宵挑灯夜站有点难度的作业的同伴,

有一起睡个午觉下午精神抖擞继续学习的同伴,

当开会人数越来越少的时候,说实话我的心情并没有因身边的人逐渐消失而不安,反而是感觉这条路上意气相投的人总是很少的,坚持的人也总是很少的,愈发珍惜现在身边的同伴~

大半夜写的,想了很多,可能夜色太撩人,忍不住温情

For暑期班建议

- 关于建议,其实东校区的环境挺好的,主要是实验室大,就是远了麻烦了点,最主要是早起QWQ,鄙人最佳学习时间貌似在晚上,早上总瞌睡(捂脸。

- 然后关于对基础知识不扎实的(比如我)虽然后来有组队,大佬带菜鸟,这种方式挺好的,但是好像雷声大雨点小,可以下期暑期研讨班再抓抓~

- 关于老师做的近两周的报告,可能是最后想向我们比较好阐述自己的项目,可是emmm由于脑容量不太大,一周下来比较吃力~可以考虑隔天或是给予充分时间消化~

- 其实暑期班挺好的,利用暑期空余时间学习,老师和助教们辛苦了,争取办一期又一期~

最后

当然还是希望继续在实验室学习~

在还没进实验室的时候,余宙老师演绎了一遍VQA,还是非常膜拜的,但听说貌似底下已经有很多大佬(不太缺人的样子

后来听了谭敏老师的报告,对于基于点击数据的图像识别还是蛮感兴趣的~**特别是点击数据~**

关于自己的研究想法,倒是有个脑洞清奇的,就是类似输入一张美食的图片,输出做法吧(吃货的世界。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?