🌟 当你走进医院,护士先问症状再分诊到对应科室——这种“精准匹配”的智慧,现在被AI学会了!今天带你解锁科技圈新宠:MoE(Mixture of Experts)多专家模型,看AI如何组建“专家天团”攻克复杂难题。

🔍 什么是MoE模型?AI界的“专家会诊”机制

想象一场高难度手术:

- 传统AI

:全科医生单打独斗,既要懂内科又要会外科

- MoE模型

:心外科主任主刀+麻醉科团队护航+影像科实时读片

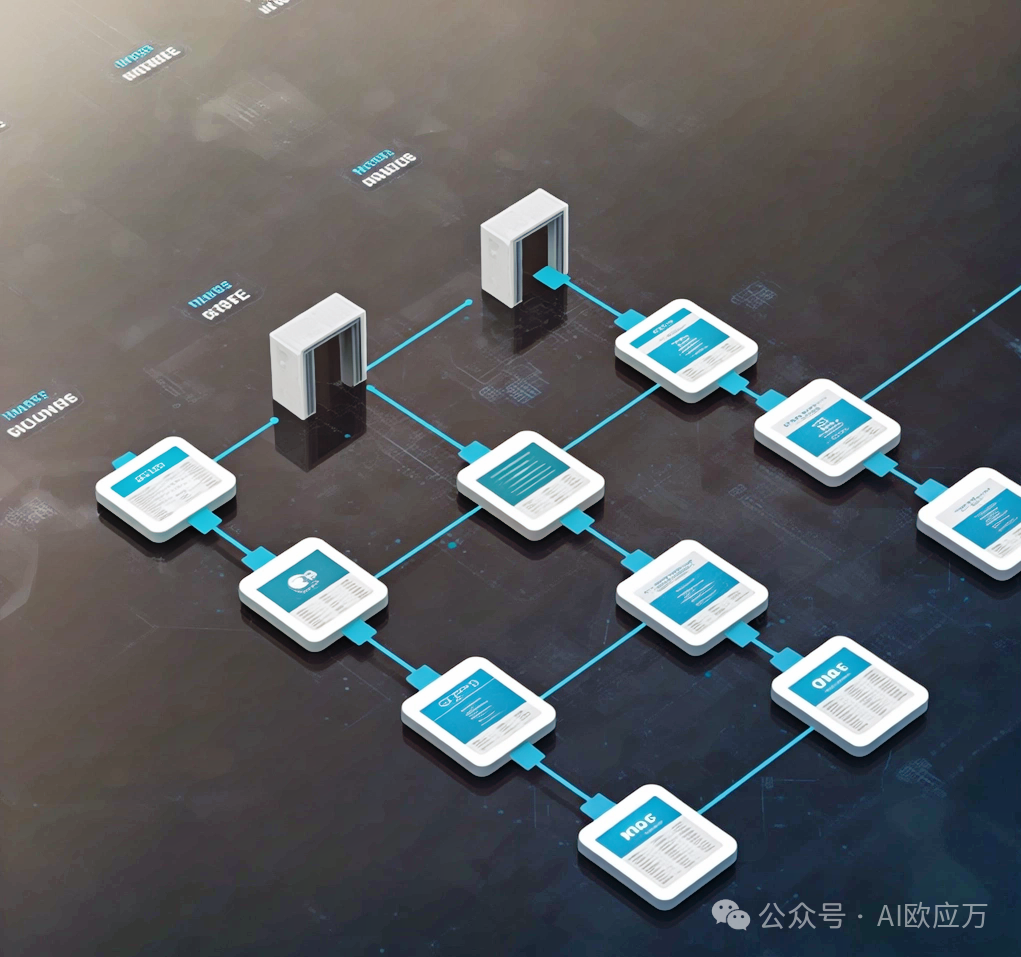

核心原理:

MoE通过“门控网络”扮演智能分诊台,根据任务特征(如输入文本类型、图像内容),动态分配给最擅长的“专家模型”处理。就像医院分诊:

1️⃣ 患者描述症状 → 2️⃣ 分诊台判断科室 → 3️⃣ 专家科室精准治疗

💡 为什么需要MoE?打破AI的“小诊所困局”

传统模型像小诊所:

-

✅ 优点:全科医生啥都能看,适合简单问题

-

❌ 痛点:遇到复杂病例就抓瞎,效率低且容易误诊

MoE则是三甲医院:

- 专业分工

:每个专家模型深耕细分领域(如NLP专家、CV专家)

- 动态调度

:门控网络实时匹配最佳专家,避免“大材小用”

- 资源优化

:复杂任务调用多个专家协同,简单任务只激活部分模块

🚀 MoE的三大超能力

1️⃣ 效率革命

谷歌PaLM-E模型用MoE架构,参数规模是GPT-3的30倍,但计算成本仅需1/3!就像医院通过分诊减少重复检查。

2️⃣ 精准突破

在法律文书分析场景中,MoE可分配:

-

合同专家处理条款识别

-

案例专家做类案比对

-

证据专家进行真伪鉴别

3️⃣ 持续进化

新增“专家”无需全盘重训,就像医院引进新科室不影响其他部门运营。

🌍 MoE正在改变这些领域

-

🤖 大语言模型:DeepMind的Gopher用MoE实现多语言精准翻译

-

🛒 推荐系统:阿里妈妈通过MoE让广告点击率提升18%

-

🎨 AI创作:Stable Diffusion用MoE实现“文生图”+“图生视频”跨界

🔮 未来已来:MoE开启AI新范式

当AI学会像人类一样“团队协作”,我们将见证:

-

🏥 医疗AI同时看CT片+解读检验报告+制定方案

-

📚 教育AI为每个学生匹配“学科专家+心理导师+时间管理师”

-

🤝 客服AI实现“业务专家+情绪安抚师+投诉处理员”三重角色

结语:

从“全能选手”到“专家天团”,MoE模型正在重构AI的技术逻辑。下次当你和AI对话时,或许背后正有数十位“专家”在为你提供“会诊级”服务。💻✨

👇 互动话题

你希望MoE模型优先落地哪个领域?欢迎留言区脑暴!

关注我,获得更多AI知识资讯👇

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?