1 基本概念

1)定义

梯度下降法,就是利用负梯度方向来决定每次迭代的新的搜索方向,使得每次迭代能使待优化的目标函数逐步减小。

梯度下降法是2范数下的最速下降法。 最速下降法的一种简单形式是:x(k+1)=x(k)-a*g(k),其中a称为学习速率,可以是较小的常数。g(k)是x(k)的梯度。

梯度其实就是函数的偏导数。

2)举例

对于函数z=f(x,y),先对x求偏导,再对y求偏导

,则梯度为(

,

)。

比如,偏导

=4x,

=6y。则在(2,4)点的梯度(8,24)。

2 梯度下降在线性回归中的应用

这个错误估计函数是对x(i)的估计值与真实值y(i)差的平方和(梯度下降要考虑所有样本)作为错误估计函数,前面乘上的1/2是为了在求导的时候,这个系数就不见了。

我们的目标是选择合适的,使得cost function的值最小。

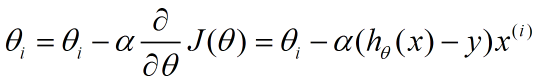

接下来介绍梯度减少的过程,即对函数求偏导。因为是线性函数,对每个分量\theta _{i}求编导的时候,其它项为0。

更新的过程,也就是θi会向着梯度最小的方向进行减少。θi表示更新之前的值,-后面的部分表示按梯度方向减少的量,α表示步长,也就是每次按照梯度减少的方向变化多少。

一个很重要的地方值得注意的是,梯度是有方向的,对于一个向量θ,每一维分量θi都可以求出一个梯度的方向,我们就可以找到一个整体的方向,在变化的时候,我们就朝着下降最多的方向进行变化就可以达到一个最小点,不管它是局部的还是全局的。

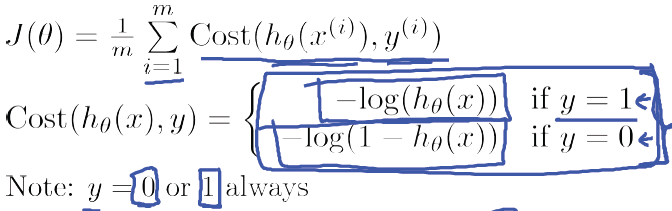

3 梯度下降在逻辑回归中的应用

对数损失函数:

本文介绍了梯度下降的基本概念,解释了它如何用于线性回归和逻辑回归中最小化成本函数。通过示例展示了在线性回归中如何更新参数,并探讨了在逻辑回归中应用梯度下降算法的过程。文章强调了梯度方向在寻找函数最小值中的关键作用,并总结了学习收获,包括梯度、导数和偏导数的理解以及梯度下降公式的推导。

本文介绍了梯度下降的基本概念,解释了它如何用于线性回归和逻辑回归中最小化成本函数。通过示例展示了在线性回归中如何更新参数,并探讨了在逻辑回归中应用梯度下降算法的过程。文章强调了梯度方向在寻找函数最小值中的关键作用,并总结了学习收获,包括梯度、导数和偏导数的理解以及梯度下降公式的推导。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?