在做flume采集时,遇到了ERROR kafka.KafkaSink: Failed to publish events

java.util.concurrent.ExecutionException: org.apache.kafka.common.errors.RecordTooLargeException: The message is 2946200 bytes when serialized which is l

arger than the maximum request size you have configured with the max.request.size configuration.这样一个报错日志。

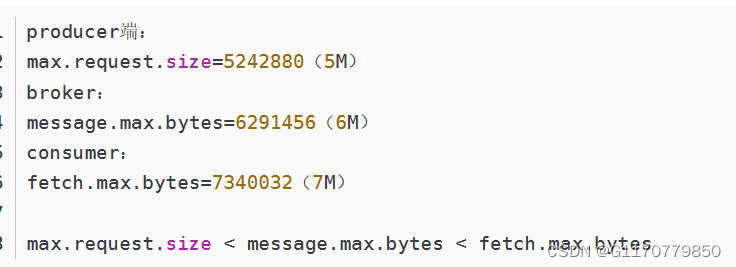

从日志中不难看出是需要修改kafka中max.request.size 参数,使它大于2946200

在比较新的版本中 (我们用的是kafka-2.4.1)还需要修改broker,consumer中的参数

当我修改完之后,发现还是报同样的错误,于是进行排查,最后在flume日志中发现参数还是默认的1M,最后在flume任务中加入了

ai。sinks.k1.kafka.producer.max.request.size=9000000 才生效。

![]()

问题虽然解决了,还是不清楚为什么修改kafka的配置重启后不会生效。

本文讲述了在使用Flume采集过程中遇到的KafkaRecordTooLargeException,解决方法包括修改Kafkamax.request.size配置,升级到kafka-2.4.1并调整flume任务中producer.max.request.size,以及为何重启后配置未生效的问题分析。

本文讲述了在使用Flume采集过程中遇到的KafkaRecordTooLargeException,解决方法包括修改Kafkamax.request.size配置,升级到kafka-2.4.1并调整flume任务中producer.max.request.size,以及为何重启后配置未生效的问题分析。

1019

1019

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?