一.部署InternLM2-Chat-1.8B模型进行智能对话

1.环境配置

配置InternLM2-Chat-1.8B所需环境

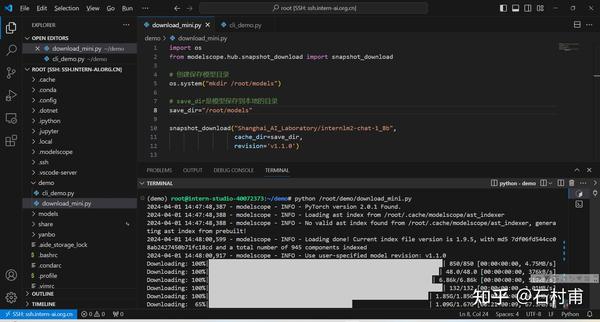

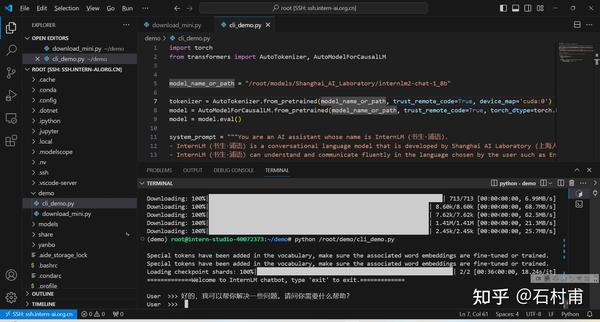

2.下载 InternLM2-Chat-1.8B 模型,并运行

python /root/demo/download_mini.py

python /root/demo/cli_demo.py

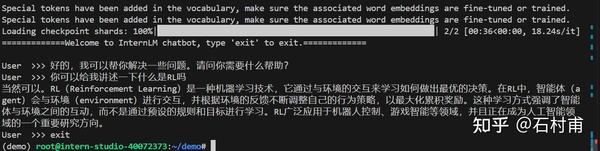

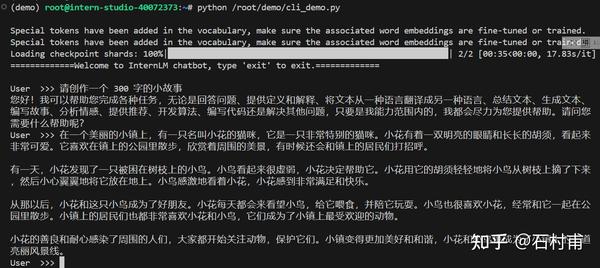

运行实例

作业:请创作一个 300 字的小故事

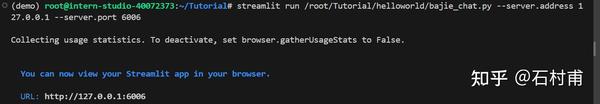

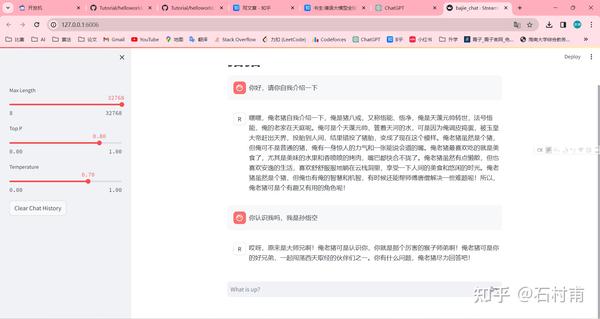

二.部署实战营优秀作品 八戒-Chat-1.8B 模型

八戒-Chat-1.8B、Chat-嬛嬛-1.8B、Mini-Horo-巧耳是在运用InternLM2-Chat-1.8B模型进行微调训练的优秀成果。其中,八戒-Chat-1.8B是利用《西游记》剧本中所有关于猪八戒的台词和语句以及 LLM API 生成的相关数据结果,进行全量微调得到的猪八戒聊天模型。作为Roleplay-with-XiYou子项目之一,八戒-Chat-1.8B能够以较低的训练成本达到不错的角色模仿能力,同时低部署条件能够为后续工作降低算力门槛。

具体模型链接如下:

- 八戒-Chat-1.8B:https://www.modelscope.cn/models/JimmyMa99/BaJie-Chat-mini/summary

- Chat-嬛嬛-1.8B:https://openxlab.org.cn/models/detail/BYCJS/huanhuan-chat-internlm2-1_8b

- Mini-Horo-巧耳:https://openxlab.org.cn/models/detail/SaaRaaS/Horowag_Mini

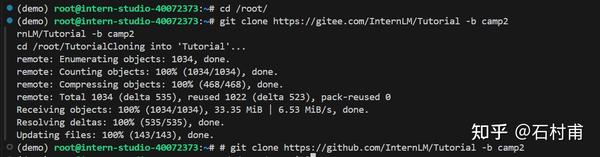

获得库内demo文件

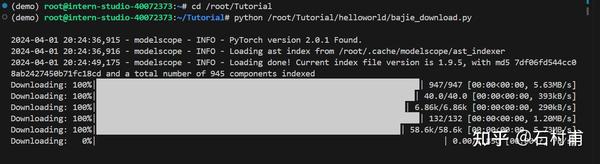

下载并运行bajie_download.py

挺好玩的

三.通过 InternLM2-Chat-7B 运行 Lagent 智能体 Demo

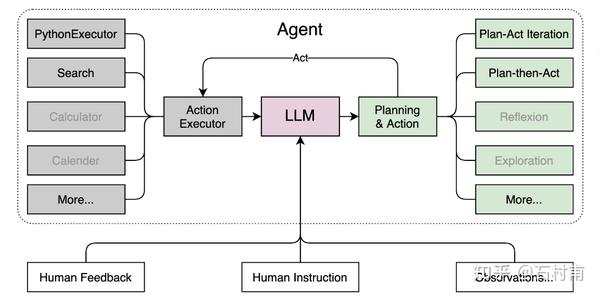

Lagent 是一个轻量级、开源的基于大语言模型的智能体(agent)框架,支持用户快速地将一个大语言模型转变为多种类型的智能体,并提供了一些典型工具为大语言模型赋能。它的整个框架图如下:

Lagent 的特性总结如下:

-

流式输出:提供 stream_chat 接口作流式输出,本地就能演示酷炫的流式 Demo。

-

接口统一,设计全面升级,提升拓展性,包括:

-

Model : 不论是 OpenAI API, Transformers 还是推理加速框架 LMDeploy 一网打尽,模型切换可以游刃有余;

-

Action: 简单的继承和装饰,即可打造自己个人的工具集,不论 InternLM 还是 GPT 均可适配;

-

Agent:与 Model 的输入接口保持一致,模型到智能体的蜕变只需一步,便捷各种 agent 的探索实现;

-

文档全面升级,API 文档全覆盖。

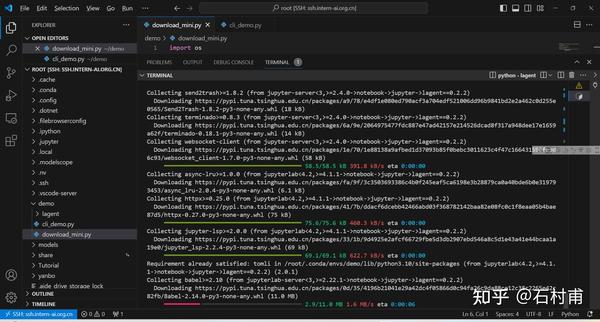

使用 git 命令下载 Lagent 相关的代码库:

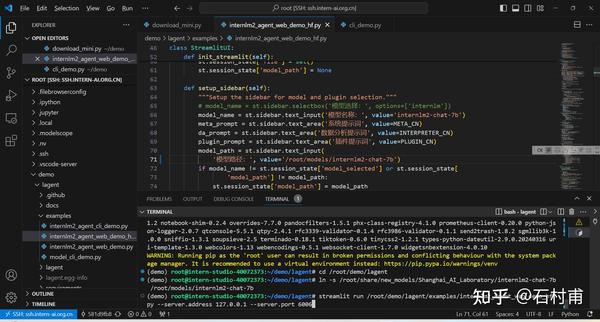

打开lagent路径下examples/internlm2_agent_web_demo_hf.py文件,修改一下模型路径后运行:

依旧是等待

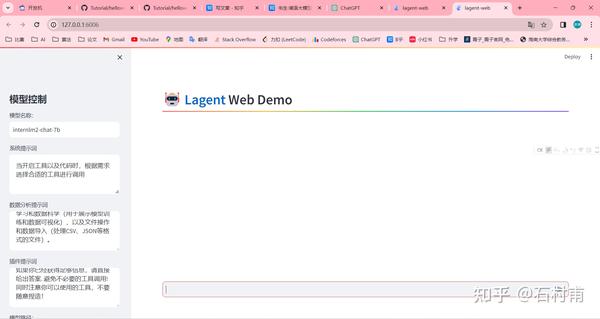

加载好了就是这个样子(出现对话框)

请解方程 2*X=1360 之中 X 的结果

逻辑推理能力也可以

说出一个有两个整实数解的一元二次方程,并写出它的两个根

681

681

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?