昨天看视频 我们做了个能对话的AI派蒙,免费给大家玩!

发现阿里有一个语音转文字的模型(paraformer),之前处理这种需求一直都是直接调用服务商提供好的API接口

突然想尝试一下本地搭建,虽然和直接调用API 没啥区别(都不知道实现细节),但是这是本地化运行,可以在内网环境运行.

因为平常工作主要是java方向,顺便记录一些踩坑历史.

环境安装

参考 环境安装

CPU环境镜像:

docker pull registry.cn-hangzhou.aliyuncs.com/modelscope-repo/modelscope:ubuntu20.04-py37-torch1.11.0-tf1.15.5-1.5.0

GPU环境镜像:

docker pull registry.cn-hangzhou.aliyuncs.com/modelscope-repo/modelscope:ubuntu20.04-cuda11.3.0-py37-torch1.11.0-tf1.15.5-1.5.0

启动镜像

下载后 运行

cpu:

docker run -d --name cpu1 -v f:\docker:/work -p 9091:9090 -it --rm alicpuenv /bin/bash

gpu:

docker run -d --name gpu1 -v f:\docker:/work -p 9092:9090 --gpus all -it --rm aligpuenv /bin/bash

demo

环境搭建好了,跑示例就简单了,官网提供了现成的demo

from modelscope.pipelines import pipeline

from modelscope.utils.constant import Tasks

inference_pipeline = pipeline(

task=Tasks.auto_speech_recognition,

model='damo/speech_paraformer-large_asr_nat-zh-cn-16k-common-vocab8404-pytorch')

rec_result = inference_pipeline(audio_in='https://isv-data.oss-cn-hangzhou.aliyuncs.com/ics/MaaS/ASR/test_audio/asr_example_zh.wav')

print(rec_result)

直接创建一个 demo.py 就可以运行.

它这里会自动从网上下载模型,大概一个多G(只需下载一次),可能有点慢.

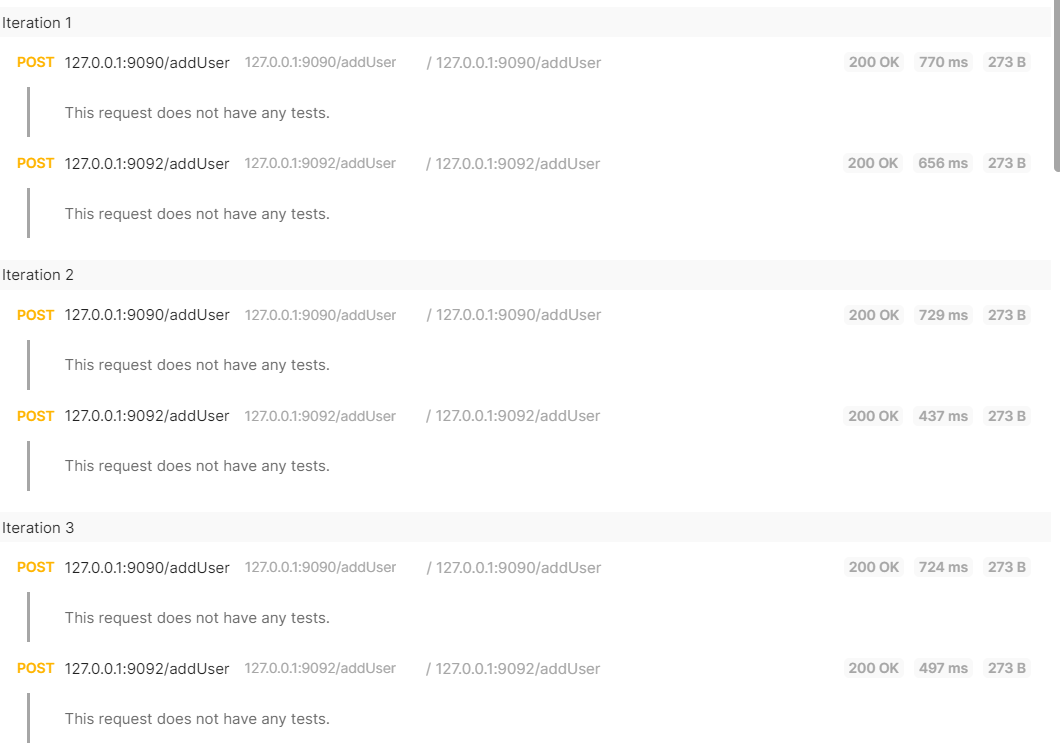

经测试, 我的CPU(AMD Ryzen 7 3700X 8-Core Processor 3.60 GHz) 上跑这段程序(5s 左右的音频)是 700ms 左右,GPU(RTX 2070) 是500ms 左右

ps: 当然官网也提供了在线的 notebook 可以直接运行,想体验的同学可以直接在线运行.

如果GPU环境报错

docker: Error response from daemon: failed to create shim task: OCI runtime create failed: runc create failed: unable to start container process: error during container init: error running hook #0: error running hook: exit status 1, stdout: , stderr: Auto-detected mode as 'legacy'

nvidia-container-cli: mount error: file creation failed: /var/lib/docker/overlay2/76aebda714a598487d6ec2615bfbc8729722e3138a846830a407d07f929128c4/merged/usr/lib/x86_64-linux-gnu/libnvidia-ml.so.1: file exists: unknown.

ERRO[0000] error waiting for container:

可以参考 WSL启动nvidia-docker镜像:报错libnvidia-ml.so.1- file exists- unknown_51CTO博客_docker启动镜像失败

大概步骤

- 先不挂载gpu, 直接进入容器, 备份两个文件

docker run -it --rm aligpuenv /bin/bash

mv /usr/lib/x86_64-linux-gnu/libnvidia-ml.so.1 /usr/lib/x86_64-linux-gnu/libnvidia-ml.so.1.bak

mv /usr/lib/x86_64-linux-gnu/libcuda.so.1 /usr/lib/x86_64-linux-gnu/libcuda.so.1.bak

- 提交镜像修改

docker commit xxxxxxxxxx aligpuenv

- 运行新镜像

docker run -d --name gpu1 -v f:\docker:/work -p 9092:9090 --gpus all -it --rm aligpuenv /bin/bash

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?