Cross-contrast mutual fusion network for joint MRI reconstruction and super-resolution

10.1016/j.patcog.2024.110599

摘要:

磁共振成像(MRI)是一种广泛使用的医学成像技术,已成为诊断各种疾病和可视化人体内部结构和组织的重要工具。MRI重建和超分辨率是两种可以提高图像质量和加速成像过程的技术。然而,目前的方法独立执行这些任务,没有考虑它们之间的相关性。此外,多对比度SR方法通常将不同对比度的特征连接起来,而不考虑它们的相关性。在这篇论文中,我们提出了一种新的交叉对比互融合网络(CMF-Net),通过在两个任务之间实现特征表示的相互传播来执行联合MRI重建和超分辨率。CMF-Net框架由两个阶段组成:第一阶段侧重于融合多对比度特征,而第二阶段旨在学习特定任务的信息,用于联合MRI重建和超分辨率。我们提出了一种多对比度特征聚合(MFA)模块,以促进多对比度特性的集成。该模块从辅助对比度中捕获多尺度信息,以增强特征表示的能力。此外,提出了一种多任务相互融合(MMF)模块来整合特定任务的特征,该模块探索了两个任务之间的相关性,以提高MR超分辨率性能。我们在两个公共MR数据集上评估了所提出的CMF-Net方法。定量和定性结果表明,我们的CMF-Net优于其他最先进的方法。

研究背景

磁共振成像(MRI)是一种广泛应用的医学成像技术,用于诊断各种疾病并可视化人体内部结构和组织。尽管MRI在医学影像中具有重要作用,但由于其数据采集过程较慢,扫描时间长,导致患者不适并增加了医疗成本。因此,MRI图像重建和超分辨率(SR)技术成为了研究的重点,这两种技术可以提高图像质量并加速成像过程。

然而,目前大多数现有方法是将MRI图像重建和超分辨率当作两个独立的任务进行处理,未能有效利用它们之间的相互关联。此外,现有的多对比度SR方法通常将不同对比度的特征简单地连接起来,但没有充分考虑它们之间的关联性,导致信息冗余,影响性能。

解决的问题

- 多对比度信息融合问题:现有的多对比度方法通常通过简单的拼接来融合不同对比度的信息,未充分利用对比度间的关联性。本文通过多对比度特征聚合MFA模块,充分利用T1WI和T2WI等不同对比度图像间的互补性,有效提升了图像质量。

- 独立处理重建和超分辨率任务:当前的重建和超分辨率方法通常将其视为独立任务进行处理,忽略了它们之间的共享特征。本文提出的多任务互融合MMF模块则能够利用两者的共享信息,增强任务特定的特征学习,从而提升重建和超分辨率的综合效果。

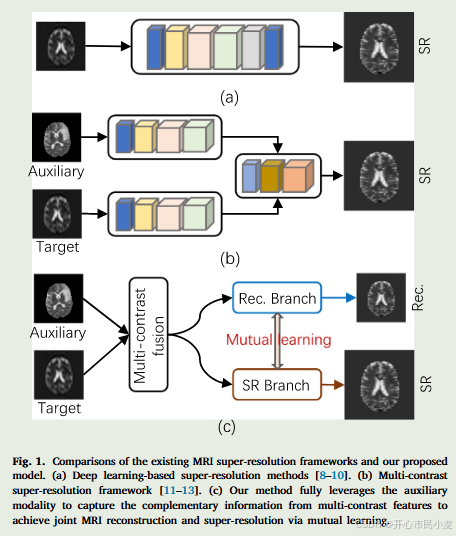

图 1 展示了现有 MRI 超分辨率框架与本文所提出模型的对比,具体如下:

(a) 基于深度学习的超分辨率方法

此部分呈现了传统基于深度学习的超分辨率处理方式。通常是将单一的输入图像(可能是低分辨率的 MRI 图像)直接送入深度学习网络中,网络经过一系列的卷积、激活等操作,尝试对图像进行超分辨率处理,最终输出一幅高分辨率的 MRI 图像。这种方法往往把超分辨率作为一个独立的任务进行处理,没有考虑与其他任务(如 MRI 图像重建)以及不同对比度图像之间的关联。

(b) 多对比度超分辨率框架

这里展示的是多对比度超分辨率的相关框架。输入包含了辅助图像和目标图像,它们具有不同的对比度。这些图像被送入网络后,通过特定的方式(如简单的特征拼接等)来处理不同对比度的信息,目的是利用多对比度图像之间的互补信息以提升超分辨率的效果。然而,现有这类方法通常只是简单地将不同对比度的特征连接起来,没有充分挖掘对比度之间的内在联系,存在信息利用不充分的问题。

(c) 本文提出的模型

该部分介绍了本文所提出的模型。输入同样是辅助图像和目标图像这两种不同对比度的图像,首先进行多对比度融合,将两种对比度图像的信息进行整合。之后通过互学习机制,让重建分支(Rec. Branch)和超分辨率分支(SR Branch)相互学习。重建分支专注于对 MRI 图像进行重建,超分辨率分支则负责提升图像的分辨率。这种设计充分利用了两种任务之间的共享特征和任务特定属性,同时也能更好地挖掘不同对比度图像之间的互补关系,从而实现更高质量的 MRI 图像重建和超分辨率,相较于前面两种方式,在信息利用和任务协同方面有显著改进 。

研究方法

为了解决上述问题,本文提出了一种新型的交叉对比互融合网络(CMF-Net),旨在通过互相传播特征表示来联合进行MRI图像重建和超分辨率任务。该网络框架包含两个阶段:

- 多对比度特征学习阶段:该阶段通过引入多对比度特征聚合(MFA)模块,融合来自不同对比度的图像特征,提升图像超分辨率表现。MFA模块通过多尺度的辅助对比度信息增强特征表示能力,帮助网络利用不同对比度之间的互补信息。

- 多任务学习阶段:该阶段利用多任务互融合(MMF)模块,同时处理重建和超分辨率任务。MMF模块通过挖掘这两个任务之间的相互关系,增强任务特定特征的学习,从而提高MRI图像的超分辨率效果。

MFA模块通过捕捉T1加权成像(T1WI)和T2加权成像(T2WI)等不同对比度之间的互补关系,提升了超分辨率重建效果。而MMF模块则通过增强任务特定的特征并提取任务间的相互关联,进一步改善了图像的重建质量。

主要贡献

- 提出了一个新的多对比度深度学习框架CMF-Net,该框架分为两个阶段:多模态融合和任务特定特征提取,能够联合处理MRI图像的重建和超分辨率任务,充分挖掘两者之间的关联。

- 提出了多对比度特征聚合(MFA)模块,通过利用不同模态之间的互补性来学习融合后的特征表示。

- 提出了多任务互融合(MMF)模块,增强任务特定的特征,并探索任务间的相互关系。

- 在两个公开的MRI数据集上进行了大量实验,结果表明,CMF-Net在MRI超分辨率重建任务中,优于其他现有的先进方法。

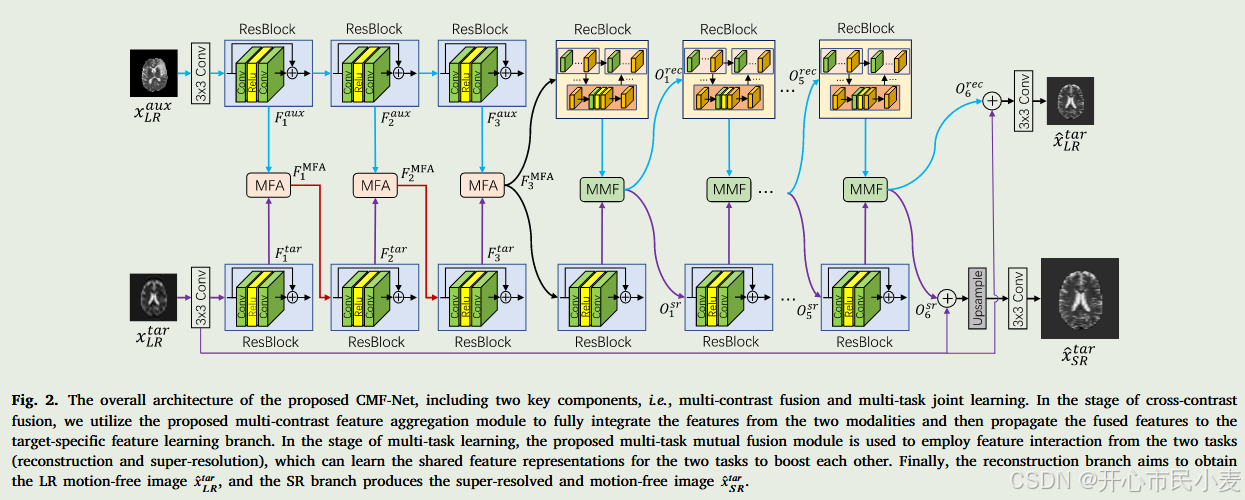

网络架构

提出的CMF-Net(Multi-Contrast Fusion Network)包含两个关键组成部分:

- 多模态融合(Multi-contrast Fusion):通过设计的多模态特征聚合模块(MFA),有效融合目标和辅助图像的特征。

- 多任务联合学习(Multi-task Joint Learning):在联合学习框架下,分别进行MRI的重建和超分辨率任务。重建任务的目标是从下采样的LR图像恢复运动无关的图像,超分辨率任务则从LR图像生成超分辨率图像。

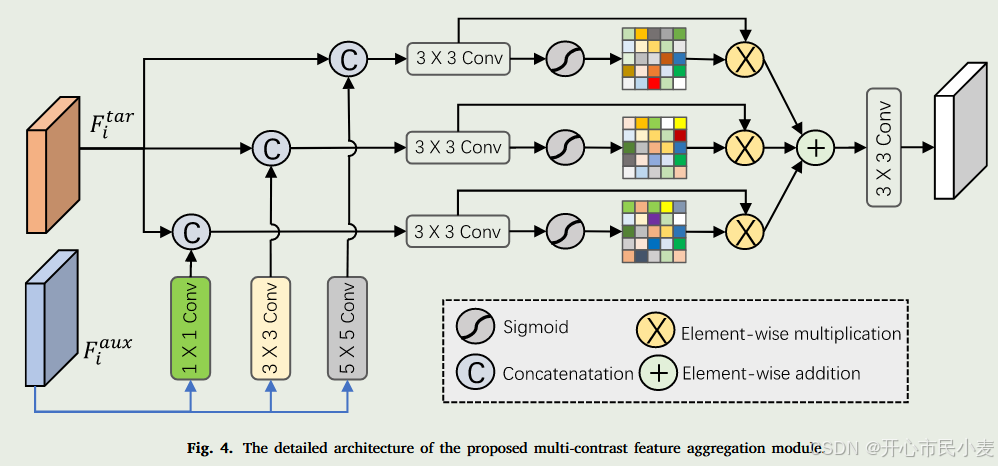

3.3 多模态特征学习

将目标图像 𝐱𝑡𝑎𝑟 和辅助图像 𝐱𝑎𝑢𝑥 经过卷积层处理,得到平滑的特征表示。随后,特征通过残差块(Residual Blocks)进行进一步的学习和优化。为了更好地利用两种模态的信息,设计了一个多模态特征聚合(MFA)模块。该模块通过不同大小的卷积核提取来自辅助模态的多尺度特征,并将其与目标图像的特征进行拼接。通过Sigmoid激活函数对这些特征进行归一化,得到不同尺度的注意力图,用于增强特征表示。

该融合特征整合了多对比度的信息,包含了从辅助图像和目标图像中提取的特征,这些特征对于两个分支后续的处理都是重要的输入,是两个任务共享的基础信息。

多对比度特征聚合模块(MFA)

3.4 联合重建与超分辨率

仅依赖于超分辨率分支不足以恢复出高分辨率的运动修正图像,因此设计了一个多任务框架,利用共享特征进行联合训练。该框架通过去除运动伪影,确保超分辨率分支能够专注于图像分辨率的提升。

- 超分辨率分支(SR Branch):通过融合特征 FMFA3F_{\text{MFA}}^3FMFA3,经过残差块操作后,进行图像的上采样和超分辨率重建。

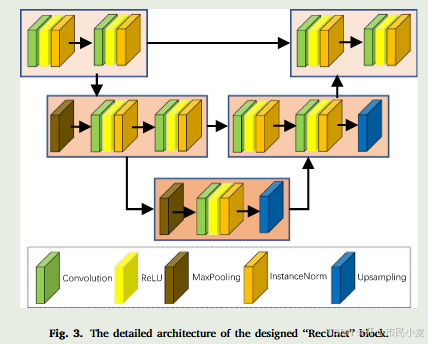

- 重建分支(Reconstruction Branch):重建分支使用多个“RecUnet”块对图像进行编码和解码操作,以生成高质量的LR图像.

通过联合训练,重建和超分辨率任务相互促进,最终得到运动修正且超分辨率的图像。

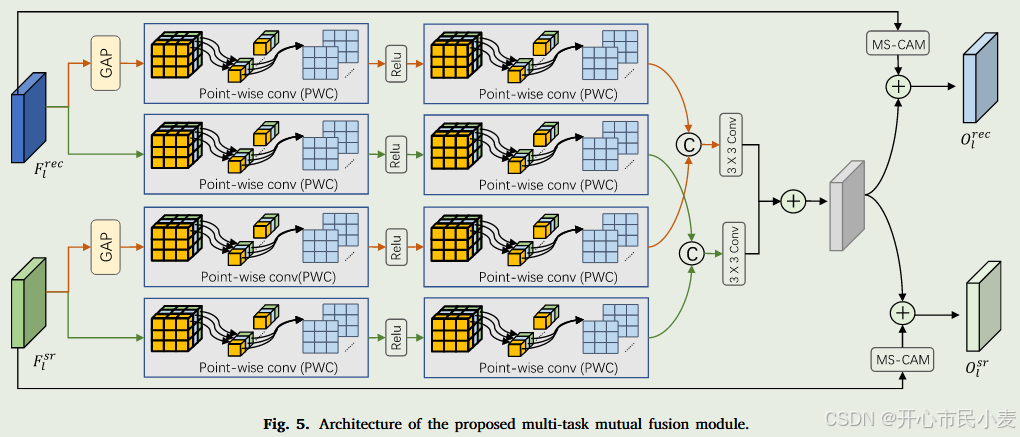

3.5 多任务互融合模块(MMF)

为了更好地融合来自不同任务的信息,提出了多任务互融合(MMF)模块。该模块通过全局平均池化(GAP)提取全局上下文信息,并通过保留原始特征大小的方式捕捉局部上下文。通过将全局和局部特征进行融合,进一步提升了超分辨率和重建任务的性能。

实现了两个分支之间特征信息的交互与共享,使得每个分支能够利用来自另一个分支的上下文信息,从而增强各自的特征表示和处理效果。例如,超分辨率分支可以从重建分支的全局和局部上下文信息中受益,更好地进行图像分辨率提升;重建分支也可以借助超分辨率分支的特征信息,更有效地减少或消除图像伪影,实现高质量的图像重建 。

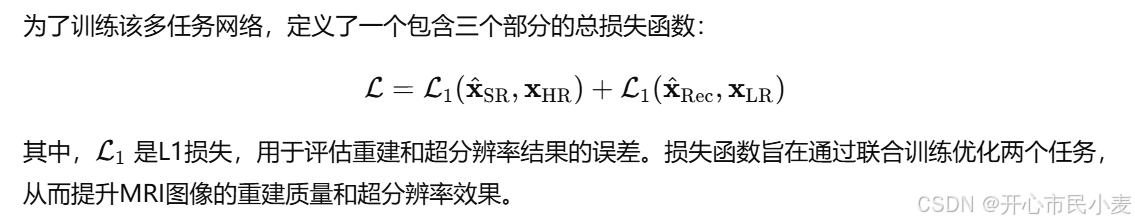

损失函数

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?