深度理解 TSS(总平方和):公式、意义与应用

在机器学习与统计建模领域,评价模型好坏的重要指标之一就是方差与误差分析。其中,TSS(Total Sum of Squares,总平方和)扮演着非常关键的角色。今天我们就来深入剖析 TSS,从公式理解到实际应用,一步步搞懂它!

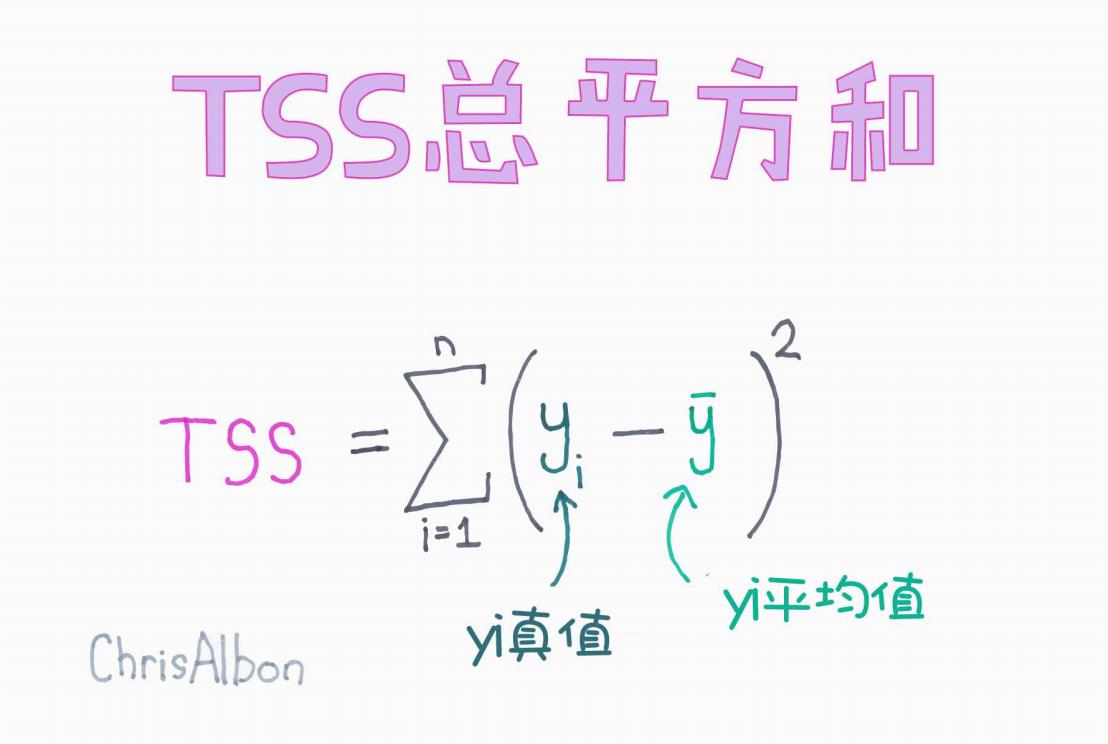

什么是 TSS?

TSS(总平方和) 是指样本数据中各观测值与其均值之间差异的总和,具体来说,是每个观测值到整体均值的偏差的平方,再将这些平方累加起来。

TSS可以用来衡量数据的总体变异性,也就是说:原始数据本身波动有多大?

TSS的数学公式

根据本文开头的图示,TSS 的定义公式为:

其中:

-

:第 i 个样本的真实值(观测值)

-

:所有样本的平均值

-

n:样本总数

图中的标注也特别清晰:

-

真实值 ➔ 每一个观测的数据点。

-

平均值 ➔ 所有观测点的均值,用于作为基准线。

这张图用简单的箭头标明了各元素的含义,非常友好。

为什么要平方?

也许你会好奇,为什么要对偏差进行平方呢?原因有两点:

-

避免正负抵消:如果不平方,正偏差和负偏差会互相抵消,导致总和接近零,失去意义。

-

强调大偏差:平方放大了大的误差,使得远离均值的点对 TSS 贡献更大。

因此,平方是必须的处理方式。

TSS的意义

TSS 衡量的是总体数据的分散程度。

-

如果 TSS 很小,说明大部分数据点离均值很近,数据比较集中。

-

如果 TSS 很大,说明数据点分布很散,离均值的距离很远。

在回归分析中,TSS 是衡量模型拟合优度(比如 决定系数)的基础部分。

与其他平方和的关系

在回归分析中,除了 TSS,还有两个重要的平方和:

-

RSS(残差平方和,Residual Sum of Squares):真实值与预测值之间的差异。

-

ESS(回归平方和,Explained Sum of Squares):预测值与真实均值之间的差异。

三者之间有着重要的关系:

TSS = ESS + RSS

这意味着,TSS 可以分解为模型解释的部分(ESS)和模型无法解释的残差部分(RSS)。

简而言之:

-

TSS:原始数据的总波动。

-

ESS:模型能解释的数据波动。

-

RSS:模型不能解释的数据波动。

一个简单例子

假设我们有以下数据:

| 样本编号 | |

|---|---|

| 1 | 2 |

| 2 | 4 |

| 3 | 6 |

计算过程如下:

-

计算均值:

-

计算每个点与均值的差值并平方:

-

-

将平方和加总:

因此,总平方和 TSS = 8。

TSS在实际中的应用

TSS 最常见的应用场景包括:

-

评估回归模型的拟合优度:TSS 用于计算 R2R^2 值。

越接近 1,说明模型越好。

-

特征工程中筛选特征:分析某个特征是否能有效减少数据波动。

-

聚类分析:衡量聚类效果,比如在 K-means 聚类中,也有类似的平方和概念。

总结

-

TSS 是理解数据变化范围的基础指标。

-

平方和的分解公式

是理解回归分析的核心。

-

掌握 TSS 有助于进一步深入理解 R²、模型评价、特征选择等机器学习技术。

记住,理解 TSS,就是理解数据本身的变化规律!

参考资料

-

Chris Albon 手绘笔记

-

《统计学习方法》李航

-

《An Introduction to Statistical Learning》

如果你觉得这篇讲解有帮助,欢迎点赞、评论、收藏!

后续我还会继续分享更多统计与机器学习基础知识系列,敬请期待!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?