LIV-GaussMap LiDAR-Inertial-Visual Fusion for Real-time 3D Radiance Field Map Rendering

项目仓库 代码未开源

2024年4月接收

LIV-GaussMap: LiDAR-惯性-视觉融合实时3D辐射场地图渲染

目录

LIV-GaussMap: LiDAR-惯性-视觉融合实时3D辐射场地图渲染

知识点补充

1.辐射场渲染

辐射场是指一个场景的连续光辐射分布,能够描述场景在不同视角下的外观和材质特性。

辐射场渲染(Radiance Field Rendering)是一种计算机图形学技术,用于生成三维场景的高质量图像。它通过捕捉场景中每个点的光辐射信息,来实现更加真实的渲染效果。这种方法通常涉及以下几个步骤:

-

场景采样:通过在场景中采样不同的位置和方向,收集光线的辐射数据。

-

模型训练:利用深度学习等技术,训练一个模型来表示场景的辐射场。这些模型可以是体积表示(如NeRF,Neural Radiance Fields)或其他形式。

-

图像生成:通过模型,从特定视角生成新的图像。这可以让用户从不同的视角查看场景,或者生成视角变化平滑的动画。

辐射场渲染在虚拟现实、增强现实、以及其他需要高质量视觉效果的应用中具有广泛的应用前景。

2.辐射场地图渲染

辐射场地图渲染(Radiance Field Map Rendering)通常指的是一种结合辐射场和地图数据的渲染技术。这种方法在生成三维场景时,利用辐射场技术来表示场景中的光照信息,同时结合地图数据来提供空间的几何结构和特征。

主要步骤包括:

-

地图构建:使用传感器(如LiDAR、相机等)采集场景的几何信息,构建一个高精度的三维地图。

-

辐射场表示:对场景中不同位置的光辐射进行建模,通常利用深度学习模型(如NeRF)来学习辐射场。

-

渲染:通过结合地图数据和辐射场信息,从特定视角生成高质量的图像或视频。这个过程可以实现更真实的光照和阴影效果,提供更自然的视觉体验。

这种方法特别适用于需要高保真度渲染的应用,如虚拟现实、增强现实和自动驾驶等领域。

3.松紧耦合

紧密耦合指的是将不同类型的传感器数据在数据处理和状态估计阶段进行实时的深度整合。具体来说,紧密耦合的特点包括:

-

实时数据融合:多个传感器(如LiDAR、摄像头和惯性测量单元IMU)生成的数据在同一时间被采集,并在数据处理的过程中进行同步和结合。这种方法比松散耦合(即先独立处理各传感器数据,再在后期进行融合)更为高效。

-

优化整体估计:通过联合优化传感器数据,可以更准确地估计传感器的位置和姿态(如姿态、位置、速度等),以及生成更精确的地图。这种优化通常涉及滤波器(如扩展卡尔曼滤波器)或图优化技术。

-

提升鲁棒性和精度:紧密耦合可以有效利用不同传感器的优势。例如,LiDAR提供高精度的距离测量,而视觉传感器提供丰富的环境信息,惯性传感器则可以帮助维持运动估计的连续性。通过实时融合,这些信息可以相互补充,提升系统的整体鲁棒性和精度。

在实际应用中,紧密耦合的方法适用于自动驾驶、机器人导航和增强现实等领域,能够在复杂和动态的环境中提供更可靠的定位和地图构建。

松散耦合在传感器融合的上下文中指的是将不同传感器的数据处理过程分开,先独立处理各个传感器的数据,然后再在后期阶段进行融合。具体特点包括:

-

独立处理:每个传感器的数据可以单独处理,不需要实时同步。这意味着各个传感器的数据可以以不同的频率采集和处理。

-

后期融合:各个传感器生成的结果(如位置估计、地图等)在后期阶段进行结合。这通常涉及将各个传感器的输出作为输入,进行融合算法(如加权平均、卡尔曼滤波等)来生成最终结果。

-

灵活性:松耦合的方法在系统设计上通常更灵活,可以更容易地添加或更换传感器,而不会影响整体系统的结构。

-

计算负担分配:由于各个传感器的数据处理是独立的,计算负担可以分配到不同的处理模块,使得系统的实现相对简单。

尽管松耦合方法在实现上比较容易,但通常在精度和鲁棒性上不如紧密耦合。特别是在动态环境中,紧密耦合能够更好地利用传感器之间的信息互补,从而提供更准确的状态估计和地图构建。因此,选择哪种方法取决于具体应用的需求和环境条件。

4.多模态传感器映射

多模态传感器映射是指将来自不同类型传感器(例如相机、雷达、激光雷达等)的输出数据进行融合和注册,以获得对同一场景的更完整和准确的感知。

这种技术可以提高感知系统的鲁棒性和准确性,在自动驾驶、智能机器人等领域有广泛应用。

关键技术

-

传感器标定: 确定各传感器之间的位置、角度关系,消除系统误差。

-

数据配准: 将不同传感器采集的数据映射到同一坐标系下,实现数据融合。

-

特征提取与关联: 从多源数据中提取有效特征,并关联这些特征以获得更高层次信息。

-

数据融合算法: 开发高效的多源数据融合算法,如卡尔曼滤波、贝叶斯滤波等。

5.里程计

惯性里程计(Inertial Odometry)和视觉里程计(Visual Odometry)是两种用于估计移动物体(如机器人或车辆)位置和姿态变化的方法,具体如下:

惯性里程计(Inertial Odometry)

-

原理:基于惯性测量单元(IMU)中的加速度计和陀螺仪数据,通过对加速度和角速度进行积分,计算出物体的位移和姿态变化。

-

优点:

-

可以在短时间内快速计算出位置和姿态变化,具有高频率的更新能力。

-

对光照和环境变化不敏感,适合在黑暗或复杂环境中使用。

-

-

缺点:

-

随时间推移,累积误差(漂移)会导致位置估计的精度下降。

-

对于长时间的定位任务,单独使用IMU通常不够精确。

-

视觉里程计(Visual Odometry)

-

原理:通过分析从摄像头捕获的连续图像,估计相机的运动。通常使用特征提取(如ORB、SIFT等)和匹配算法来跟踪图像中的特征点。

-

优点:

-

可以提供丰富的环境信息,通常在长时间内保持较好的定位精度。

-

不会产生漂移,适合大范围的环境建图和导航。

-

-

缺点:

-

对光照变化、遮挡、快速运动等情况较为敏感。

-

处理复杂,计算需求较高。

-

综合应用

在实际应用中,惯性里程计和视觉里程计常常结合使用,形成惯性-视觉里程计,通过互补的方式提高定位的准确性和鲁棒性。这样可以充分利用IMU在短时间内的高频更新能力和视觉传感器在长时间内的高精度定位能力。

6.外推视角

外推视角(extrapolated viewpoints)是指通过现有数据或模型推断出尚未直接观测到的视角或位置。这种方法在计算机视觉、3D渲染、机器人导航等领域广泛应用,具体含义和应用如下:

含义

-

推断新视角:利用已有的视角数据,使用插值或外推算法预测在新位置或新视角下场景的外观。这可以用于生成从未直接采集的视角的图像或深度信息。

-

基于模型的推断:通过训练模型(如神经网络),根据输入的图像序列或特征点,推断出其他可能的视角。这种方法在深度学习的应用中尤为常见。

应用

-

计算机图形学:在3D渲染中,通过外推现有视角的数据来生成新视角的图像,节省了重复渲染的时间。

-

视觉SLAM:在同时定位与地图构建(SLAM)中,外推视角可以帮助估计机器人在未观察区域的状态,从而增强地图构建的完整性。

-

增强现实和虚拟现实:在AR/VR中,可以通过外推视角生成用户可能看到的场景,提升用户体验。

关键点

外推视角的有效性通常依赖于已有数据的质量和分布,以及用于推断的算法的准确性。因此,尽管外推可以扩展视角范围,但不当使用也可能导致错误的估计或失真。

主要贡献

该方法提出了一种集成精确LiDAR、惯性和视觉(LIV)多模传感器的融合建图系统,利用可微分高斯模型提高了建图的保真度、质量和结构精度。

该方法的主要贡献如下:

-

利用LiDAR-惯性系统的高斯测量构建密集精确的场景地图。这种测量允许我们准确描述场景表面的特性,创建详细的地图。

-

使用具有球谐系数的可微分高斯构建LiDAR-视觉地图,能够表示不同视角下的视觉测量信息。这种方法实现了实时逼真渲染,提高了地图的精度和真实感。

-

进一步优化高斯椭球体表面,以减轻由于扫描角度造成的点云分布不均匀或测量不准确的问题,解决了非朗伯材质表面的建图挑战。

整体系统框架

-

硬件方面,采用硬件同步的LiDAR-惯性传感器与相机配合,确保LiDAR点云和图像捕获精确对齐和融合。

-

软件方面,首先使用具有自适应体素的LiDAR-惯性里程计进行定位,获得场景表面高斯模型的初始化。

-

然后利用视觉导出的光度梯度对高斯模型的结构和球谐系数进行优化和精化,实现高保真的LiDAR-视觉地图。

-

最后通过基于高斯的体素渲染技术,生成具有精确光度学和几何特性的实时逼真场景。

关键步骤

-

使用LiDAR测量初始化高斯模型:初始化时,利用具有自适应体素的LiDAR点云分割方法,估计每个体素内的平面特征,并使用协方差矩阵计算出高斯模型的位置、方向和尺度参数。

-

使用视觉梯度优化高斯模型:通过优化高斯模型的球谐系数,利用视觉测量的光度梯度进一步优化高斯模型的位置和结构,提高地图的精度和真实感。

-

自适应控制高斯模型结构:针对由于扫描角度造成的欠重建或过密问题,采用结构refinement来填补缺失区域,并剔除冗余的高斯模型,提高优化效率。

系统介绍

LIV-GaussMap系统概述

-

利用LiDAR-惯性测量初始化3D高斯分布:为获取3D场景的几何结构特征, LIV-GaussMap系统首先利用LiDAR和惯性传感器数据, 使用自适应尺寸的体素来建立初始高斯空间分布, 包括每个高斯分布的位置、方向和协方差等参数。

-

利用视觉信息优化高斯分布:随后利用摄像头数据提供的visual信息, 通过优化每个高斯分布的球谐系数, 进一步提升3D模型的光度真实感。通过这种方式实现了对 LiDAR结构的优化和融合。

-

实时渲染和视角合成:最后系统利用优化后的高斯分布进行实时渲染, 并合成新的视角, 生成高质量的3D场景。该系统在LiDAR-惯性-视觉数据融合的基础上,能够生成高保真度的实时3D辐射场景。

LIV-GaussMap系统的优势

-

利用LiDAR获取准确的几何结构:与仅依赖视觉或神经辐射场方法相比, LIV-GaussMap利用LiDAR数据获得了更准确的场景几何结构, 为后续的照片级渲染奠定了良好的基础。

-

利用视觉优化高斯分布的光度属性:通过利用视觉数据优化高斯分布的球谐系数, LIV-GaussMap能够生成更加逼真的表面材质和光照效果, 从而实现高质量的实时照片级渲染。

-

支持多种LiDAR设备: 该系统支持机械LiDAR、半机械LiDAR和固态LiDAR等多种类型LiDAR设备, 具有良好的通用性。

LIV-GaussMap系统的关键步骤

-

利用LiDAR-惯性数据初始化高斯分布:首先利用LiDAR和惯性传感器数据, 使用自适应尺寸的体素建立场景的初始3D高斯分布, 包括每个高斯分布的位置、方向和协方差等参数。

-

利用视觉数据优化高斯分布:然后利用摄像头采集的图像数据, 通过优化每个高斯分布的球谐系数, 提高3D模型的光度真实感。

-

实时渲染和视角合成:最后, 系统利用优化后的高斯分布进行实时渲染, 并合成新的视角, 生成高质量的3D场景。

LIV-GaussMap系统的实验评估

-

多模态传感器设备:该系统采用高精度的LiDAR、惯性和视觉传感器组合, 包括机械LiDAR、半机械LiDAR和固态LiDAR等多种类型, 确保了数据的精度和可靠性。

-

测试场景涵盖:实验数据集包括室内外不同规模的场景, 涵盖了复杂的几何结构和材质属性, 全面验证了系统的性能。

-

与最新算法的性能对比:系统的照片级渲染质量和实时性能均优于最新的神经辐射场等算法, 在 PSNR、SSIM和LPIPS等指标上表现出色。

LIV-GaussMap系统的创新点

-

利用LiDAR获取准确的几何结构:'相比仅依赖视觉的方法, LIV-GaussMap利用LiDAR数据获得了更准确的场景几何信息, 为后续的高质量渲染奠定了良好的基础。

-

融合视觉数据优化高斯分布:'通过优化高斯分布的球谐系数, 系统能够生成更逼真的表面材质和光照效果, 实现了LiDAR几何信息与视觉属性的有机融合。

-

支持多种LiDAR设备:'该系统对LiDAR设备类型具有良好的通用性, 可兼容机械LiDAR、半机械LiDAR和固态LiDAR等, 扩展性强。

LIV-GaussMap系统的潜在应用

-

实时SLAM和机器人领域:该系统能够生成高保真度的实时3D场景, 为SLAM和机器人领域提供了可靠的环境感知和建图能力。

-

数字孪生和虚拟现实:系统生成的3D场景具有出色的视觉真实感, 可用于构建数字孪生和虚拟现实应用。

-

3D重建和可视化:LIV-GaussMap系统集成了准确的几何信息和高保真的视觉属性, 对于实现高质量的3D重建和可视化应用具有重要意义。

论文介绍

-

提出了一种集成精确的LiDAR、惯性和视觉(LIV)多模态传感器融合映射系统

-

基于可微分高斯函数来改善映射保真度、质量和结构精度

-

这是一种新型的LiDAR-视觉-惯性传感器融合的紧密耦合地图

系统特点

-

利用LiDAR和视觉数据的互补特性捕捉大规模3D场景的几何结构

-

高保真度恢复视觉表面信息

-

使用LiDAR-惯性系统的自适应体素特征初始化场景表面高斯和每帧传感器姿态

-

使用视觉导出的光度梯度优化和细化高斯函数,提高质量和密度

兼容性和应用

-

兼容各种类型的LiDAR,包括固态和机械LiDAR

-

支持重复和非重复扫描模式

-

通过LiDAR加强结构构建,实现实时生成逼真渲染

-

在生成实时逼真场景方面表现出显著的弹性和多功能性

-

潜在应用于数字孪生和虚拟现实

-

在实时SLAM和机器人领域具有潜在应用性

相关工作

多模态传感器映射

-

多传感器融合从松耦合发展到紧耦合,在复杂环境中表现出更强的鲁棒性

-

LIC-fusion和LIC-Fusion 2.0通过平面特征跟踪实现了显著的精度和鲁棒性提升

-

LVI-SAM和R2LIVE进一步推进了LiDAR、视觉和惯性数据的紧密结合

-

VoxelMap提出了一种使用自适应体素的高效LiDAR-惯性里程计方法

新视角合成

-

隐式表示:NeRF等使用连续辐射场建模场景

-

显式表示:如mesh、点云和有符号距离场(SDF)

-

Instant-NGP使用多分辨率哈希网格和球谐函数编码空间和角度信息

-

Mip-NeRF 360处理无界场景和采样问题

-

PlenOctrees和Plenoxels使用球谐函数进行基于体素的体积渲染

-

3D高斯溅射模拟空间物体表面为各向异性高斯

方法论

硬件设置

-

硬件同步的LiDAR-惯性传感器与相机配对

-

确保LiDAR点云和图像捕获的精确同步,实现准确的数据对齐和融合

软件流程

-

使用自适应大小体素的LiDAR-惯性里程计进行定位

-

使用LiDAR测量初始化高斯函数

-

使用视觉光度梯度优化球谐系数和结构

-

生成光度准确的LiDAR-视觉地图

使用LiDAR测量初始化高斯函数

-

使用自适应大小体素对LiDAR点云进行分区

-

计算体素的平均位置、法向量和协方差矩阵

-

引入缩放因子以重新调整平面高斯分布

-

确定LiDAR点云对辐射场的影响

球谐系数优化和地图结构细化

-

使用二阶球谐函数,每个高斯需要27个谐波系数

-

计算从不同视角的观察方向

-

使用Adam优化器优化损失函数,细化高斯结构和球谐系数

-

通过alpha混合合成新视角图像

3D高斯地图的结构自适应控制

-

处理欠重建和过密情况

-

在欠重建区域复制邻近高斯并优化位置

-

在过密区域评估不透明度并消除冗余点

实验结果

该方法在真实场景数据集上的评估结果如下:

-

新视角合成性能:与最新的隐式表示(如NeRF)和显式表示(如3D高斯splatting)方法相比,在插值和外推视角的PSNR指标上表现出竞争力,特别是在外推视角方面优于3D高斯splatting。

-

地图结构重建评估:使用Chamfer距离、EMD和F-score等指标对地图结构进行定量评估,结果显示LiDAR初始化能显著改善重建效果,而后续的视觉优化在保持较高PSNR的同时,也能保证较好的结构指标。

-

运行性能:训练和渲染速度略慢于3D高斯splatting,但仍能达到实时性要求,展现了在数字孪生、虚拟现实以及SLAM等应用中的潜力。

我们的方法已经在各种公开的真实世界数据集上进行了彻底的测试和验证, 包括不同类型的 LiDAR, 如机械 Ouster OS1-128、半机械 Livox Avia 和固态 RealSense L515。评估数据集涵盖了室内(有界场景)和室外(无界场景)。实验结果证实了我们算法在有效捕捉和存储来自多个视点的图像信息方面的有效性, 从而实现了更出色的新视角渲染性能。

数据集

-

使用两个公开数据集和两个专有数据集

-

包括重复和非重复扫描LiDAR数据

-

覆盖室内和室外环境

-

提供地面真实结构以进行结构精度评估

新视角合成评估

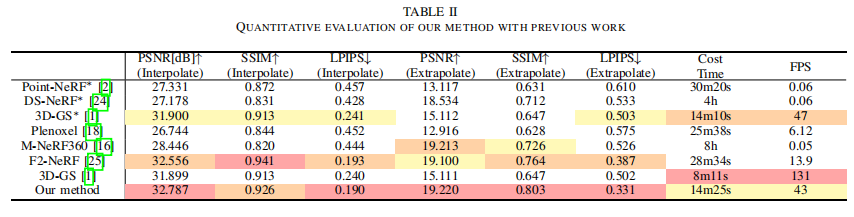

请注意,表二中用星号(*)标记的方法是使用密集的激光雷达点云进行增强的。

-

与其他最先进的框架进行比较,如Plenoxel、F2-NeRF等

-

在插值和外推视图上都显示出竞争性能

-

在峰值信噪比(PSNR)方面表现优异,特别是在外推视角

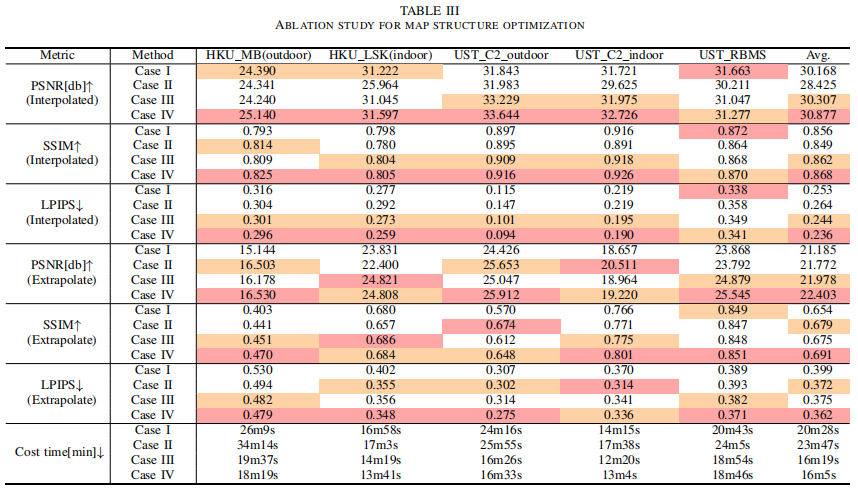

消融研究

-

逐步集成优化方法,监测PSNR变化

-

设计了四种比较实验案例

-

结果显示,该方法在所有场景的插值和外推任务中都优于3DGS

使用LiDAR数据初始化高斯分布大大提高了几何结构的精度,在复杂的户外场景如'HKU MB'中,PSNR性能有所下降,而在简单的室内场景如'UST C2 outdoor'中,PSNR性能则有所提高,尤其是在外推任务中。使用光度梯度优化高斯分布位置能够进一步提高PSNR性能,但会略微降低几何结构的质量。通过融合LiDAR初始化和光度优化,该方法在几何结构指标如CD、EMD和F-score上表现优于仅使用视觉的方法,整体展现出更优秀的性能。

消融研究结果如下:

案例I: 实现3D-GS作为基线。案例II: 使用LiDAR测量初始化高斯分布,展示未经视觉优化的场景重建效果。案例III: 在案例II的基础上进一步使用光度梯度优化高斯位置。案例IV: 继续优化高斯姿态来进一步改善性能。

从案例I和案例II的对比可以看出,在复杂场景下LiDAR的精度会下降,从而降低PSNR性能,而在简单场景中LiDAR的精度较高,可以有效提升PSNR,特别是在外推任务中。

在案例III中,通过优化点云分布可以加快处理速度,但会略微降低PSNR。

最终,该方法(案例IV)通过进一步优化场景结构,在各场景的插值和外推任务中都优于3D-GS。

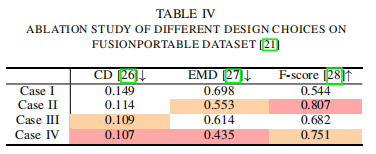

结构重建评估

-

使用CD、EMD和F-score进行定量评估

-

LiDAR初始化显著改善了这些指标

-

光度优化略微降低了结构质量,但高斯姿态细化显示出混合结果

对于结构重建的评估,定量分析使用了三个指标:

-

CD (Chamfer Discrepancy):该指标显著改善,说明LiDAR初始化大大提高了几何结构的精度。

-

EMD (Earth Mover Distance):EMD也有明显改善,进一步验证了LiDAR初始化的有效性。

-

F-score:引入光度优化略有下降,但仍优于仅使用视觉的方法。这说明在保证较好的PSNR性能的同时,几何结构也得到了较好的维护。

总的来说,该方法在几何结构指标上整体表现优异,证明了融合LiDAR测量来构建初始结构的有效性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?