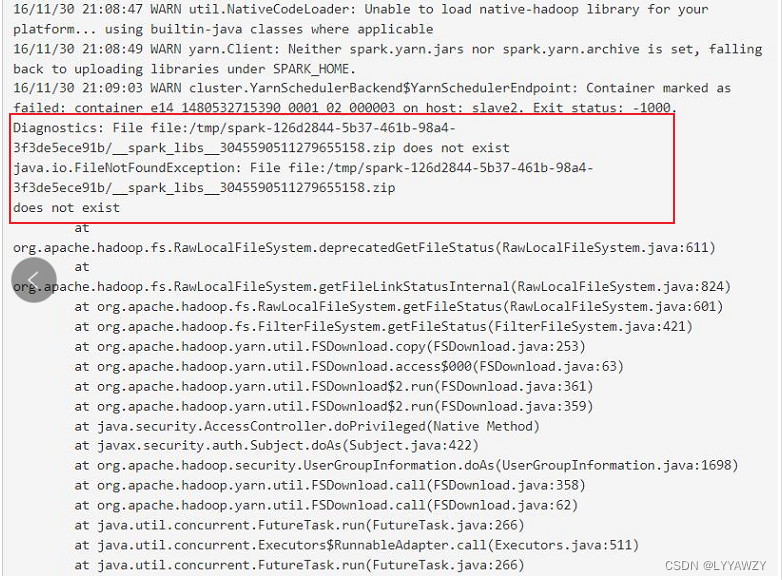

关于spark使用yarn提交代码出现的错误

问题症状:

解决方案:

①:在/etc/bashrc的配置文件中添加环境变量:

export SPARK_HOME=/export/server/spark

其中的

/export/server/spark

指的是我们的spark的安装目录

方案②:

import os

os指的是python的操作系统的系统模块

然后使用

os.environ[‘SPARK_HOME’] = ‘/export/server/spark’

其中的/export/server/spark指的是我们的spark的安装目录

但是这个有一个弊端:

就是每次运行的时候,都要导入,

建议使用方案一来解决该问题,长久使用

5166

5166

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?