一共七台服务器

hadoop01 -- NameNode、DFSZKFailoverController(zkfc)

hadoop02 -- NameNode、DFSZKFailoverController(zkfc)

hadoop03 -- ResourceManager

hadoop02 -- ResourceManager

hadoop02 -- DataNode、NodeManager、JournalNode、QuorumPeerMain

hadoop02 -- DataNode、NodeManager、JournalNode、QuorumPeerMain

hadoop02 -- DataNode、NodeManager、JournalNode、QuorumPeerMain

先搭建zookeeper集群,三台服务器

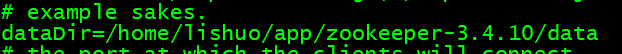

先修改其配置文件

更改data目录

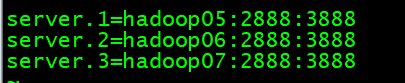

在配置文件最后添加信息

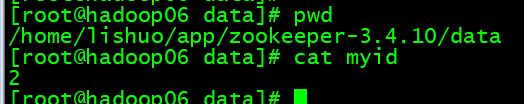

再dataDir下添加一个 myid 文件,,指明这个zookeeper的id

(在三台机器上都做相同的更改,然后可以启动)

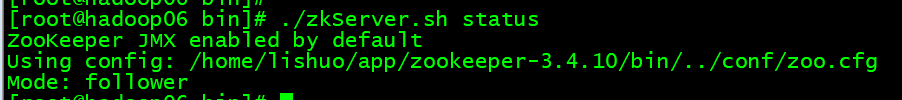

./zkServer.sh start

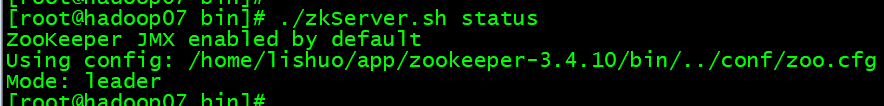

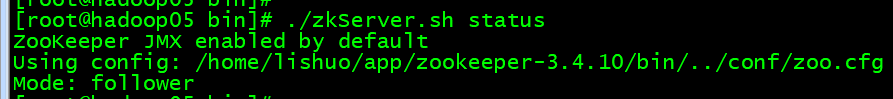

查看情况:

zookeeper集群搭建完成。

开始配置hadoop

首先配置好机器之间的无秘登录,namenode,ResourceManager,到对应的datanode和本身的等等。。。

ssh-keygen -t rsa

ssh-coyp-id hostname

配置好系统的 Java hadoop的环境变量

export JAVA_HOME=/home/lishuo/app/jdk1.8.0_181

export HADOOP_HOME=/home/lishuo/app/hadoop

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$JAVA_HOME/bin:$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

修改hadoop的配置文件:

先修改 hadoop-env.sh ,

为其指定java路径

然后修改 core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://ns1/</value>

</property>

最好先自己手动建立好 tmp 文件夹

<property>

<name>hadoop.tmp.dir</name>

<value>/home/lishuo/app/hadoop/tmp</value>

</property>

<property>

<name>ha.zookeeper.quorum</name>

<value>hadoop05:2181,hadoop06:2181,hadoop07:2181</value>

</property>

</configuration>

再修改 hdfs-site.xml

<configuration>

<!--指定hdfs的nameservice为ns1,需要和core-site.xml中的保持一致 -->

<property>

<name>dfs.nameservices</name>

<value>ns1</value>

</property>

<!-- ns1下面有两个NameNode,分别是nn1,nn2 -->

<property>

<name>dfs.ha.namenodes.ns1</name>

<value>nn1,nn2</value>

</property>

<!-- nn1的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns1.nn1</name>

<value>hadoop01:9000</value>

</property>

<!-- nn1的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns1.nn1</name>

<value>hadoop01:50070</value>

</property>

<!-- nn2的RPC通信地址 -->

<property>

<name>dfs.namenode.rpc-address.ns1.nn2</name>

<value>hadoop02:9000</value>

</property>

<!-- nn2的http通信地址 -->

<property>

<name>dfs.namenode.http-address.ns1.nn2</name>

<value>hadoop02:50070</value>

</property>

<!-- 指定NameNode的元数据在JournalNode上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://hadoop05:8485;hadoop06:8485;hadoop07:8485/ns1</value>

</property>

<!-- 指定JournalNode在本地磁盘存放数据的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/home/lishuo/app/hadoop/journaldata</value>

</property>

<!-- 开启NameNode失败自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.ns1</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔离机制方法,多个机制用换行分割,即每个机制暂用一行-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

shell(/bin/true)

</value>

</property>

<!-- 使用sshfence隔离机制时需要ssh免登陆 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>~/.ssh/id_rsa</value>

</property>

<!-- 配置sshfence隔离机制超时时间 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

</configuration>

再修改 yarn-site.xml

<configuration>

<!-- 开启RM高可用 -->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!-- 指定RM的cluster id -->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>yrc</value>

</property>

<!-- 指定RM的名字 -->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!-- 分别指定RM的地址 -->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>hadoop03</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>hadoop04</value>

</property>

<!-- 指定zk集群地址 -->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>hadoop05:2181,hadoop06:2181,hadoop07:2181</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

再修改 mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

</configuration>

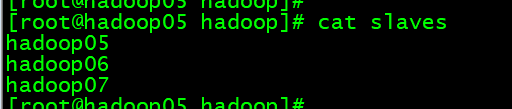

修改 namenode,和 resourcemanager 对应的 slaves,我这里是都一样的

之后就开始启动。

先启动zookeeper集群

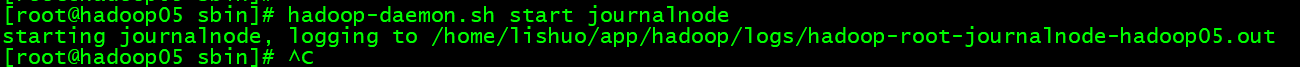

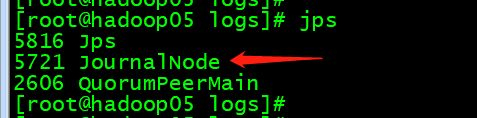

再启动 journalnode ,在 hadoop05,hadoop06,hadoop07 上都要执行

hadoop/sbin/hadoop-daemon.sh start journalnode

看一下启动日志

多了一个进程

再启动namenode, 在hadoop01上执行就可以

hdfs namenode -format

对hadoop02上的namenode执行format操作(在hadoop01上执行就可以)

scp -r tmp/ root@hadoop02:/home/lishuo/app/hadoop/

就是将hadoop01 上 tmp这个文件目录拷贝到 hadoop02上。

(也可以使用 hdfs namenode -bootstrapStandby 但是好像得先启动hadoop02上的namenode服务,这个过程好像要连接那个服务,我用这个命令没有成功)

格式化ZKFC (在hadoop01上执行就可以了)

hdfs zkfc -formatZK

之后启动 dfs 就可以了

开启了 hadoop01, hadoop02,的namenode 和 zkfc, hadoop05, hadoop06, hadoop07的datanode和journalnode,

启动 yarn (这个要在 hadoop03,hadoop04上都要运行)

start-yarn.sh

验证:

107

107

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?