1.上传文件

百度网盘提取地址

提取码:9xy5

右键传输,这里我传过就不传输了哈

2.解压hadoop与jdk文件

[root@master /]# cd /opt/ //进入/opt/目录

[root@master opt]# ls //查看/opt/目录下的文件

bigdata hadoop-3.0.0.tar.gz jdk-8u161-linux-x64.tar.gz

[root@master opt]#tar -zxvf hadoop-3.0.0.tar.gz //解压hadoop压缩包

把解压后的文件夹放到bigdata目录中

[root@master opt]#Ls //查看当前目录(opt)下的文件

[root@master opt]#mv hadoop-3.0.0 bigdata // 把hadoop-3.0.0 目录拷贝到bigdata目录里

[root@master opt]#cd bigdata // 进入bigdata目录

[root@master bigdata]#ls // 查看bigdata目录里是否有hadoop-3.0.0目录

效果如下:

[root@master /]# cd /opt/

[root@master opt]# ls

bigdata hadoop-3.0.0 hadoop-3.0.0.tar.gz jdk-8u161-linux-x64.tar.gz

[root@master opt]# mv hadoop-3.0.0 bigdata/

[root@master opt]# cd /opt/bigdata

[root@master bigdata]# ls

hadoop-3.0.0 jdk1.8.0_161

解压jdk

[root@master opt]# cd /

[root@master /]# cd /opt/

[root@master opt]# ls

bigdata jdk-8u161-linux-x64.tar.gz

//解压jdk压缩包

[root@master opt]# tar -zxvf jdk-8u161-linux-x64.tar.gz

[root@master opt]# ls

bigdata jdk1.8.0_161 jdk-8u161-linux-x64.tar.gz

//把Jdk目录移动至bigdata目录

[root@master opt]# mv jdk1.8.0_161/ bigdata

[root@master opt]# cd bigdata/

//查看是否移动成功

[root@master bigdata]# ls

jdk1.8.0_161

### 3.配置hadoop环境变量

注:环境变量是让系统变量,在环境变量配置的命令目录后,该目录的命令将可以在任何位置都可以使用。

```powershell

[root@master bigdata]# vi /etc/profile

编辑环境变量profile文件,添加如下内容,然后保存

export JAVA_HOME="/opt/bigdata/jdk1.8.0_161"

export PATH=$JAVA_HOME/bin:$PATH

export HADOOP_HOME=/opt/bigdata/hadoop-3.0.0

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

位置如下,加在done下面

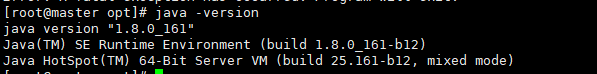

保存后激活profile文件,并查看hadoop是否能够正常使用。

[root@master bigdata]# source /etc/profile

[root@master bigdata]# java -version

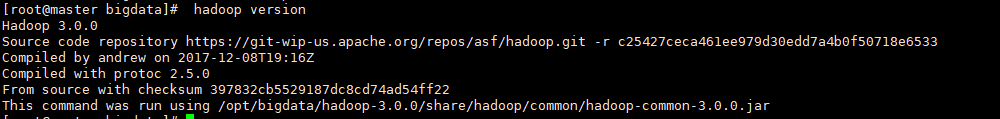

[root@master bigdata]# hadoop version

[root@master bigdata]# hadoop version

配置hadoop守护程序环境

😃 配置文件比较多耐心细心一点啊(╯‵□′)

建立namenode节点的存放位置

[root@master hadoop]# cd /opt/bigdata/hadoop-3.0.0

[root@master hadoop-3.0.0]# mkdir hdfs

[root@master hadoop-3.0.0]# cd hdfs/

[root@master hdfs]# mkdir name

配置hadoop-env.sh编辑hadoop-env.sh文件

cd /opt/bigdata/hadoop-3.0.0/etc/hadoop/

[root@master hadoop]# vi hadoop-env.sh

在打开hadoop-env.sh中查找JAVA_HOME 配置的位置

:/export JAVA_HOME

如下位置配置

定位到export JAVA_HOME输入JAVA_HOME的绝对路径。

export JAVA_HOME=/opt/bigdata/jdk1.8.0_161

6.配置hadoop守护进程

三个虚拟机同样操作

(1)配置core-site.xml

当前目录:/opt/bigdata/Hadoop-3.0.0/etc/Hadoop/

[root@master hadoop]# vi core-site.xml

进入core-site.xml文件中结构如下所示,找到configuration的位置

添加配置信息“

<property>

<name>fs.default.name</name>

<value>hdfs://master:9000</value>

</property>

<property>

<name>hadoop.temp.dir</name>

<value>/opt/bigdata/hadoop-3.0.0/tmp</value>

</property>

(2)配置 hdfs-site.xml

[root@master hadoop]# vi hdfs-site.xml

找到configuration的位置

添加配置信息“

<configuration>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/opt/bigdata/hadoop-3.0.0/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/opt/bigdata/hadoop-3.0.0/hdfs/name</value>

</property>

<property>

<name>dfs.datanode.secondary.http-address</name>

<value>node1:9001</value>

</property>

<property>

<name>dfs.http.address</name>

<value>0.0.0.0:50070</value>

</property>

</configuration>

(3)配置mapred-site.xml

[root@master hadoop]# vi mapred-site.xml

找到configuration的位置

添加配置信息“

<configuration>

<property>

<name>mapred.task.tracker.http.address</name>

<value>0.0.0.0:50060</value>

</property>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.application.classpath</name>

<value>

/opt/bigdata/hadoop-3.0.0/etc/hadoop,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/common/*,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/common/lib/*,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/hdfs/*,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/hdfs/lib/*,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/mapreduce/*,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/yarn/*,

/opt/bigdata/hadoop-3.0.0/etc/hadoop/yarn/lib/*

</value>

</property>

</configuration>

(4)配置yarn-sit.xml

(4)配置yarn-sit.xml

[root@node3 hadoop]# vi yarn-site.xml

配置内容如下:

<configuration>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>master:8099</value>

</property>

</configuration>

7.配置worker

[root@master hadoop]# vi workers

在文件works中添加节点名

node1

node2

此处因为前面配置了hosts,所以此处可以直接写主机名,如果没有配置,必须输入相应主机的ip地址。配置的workers,hadoop会把配置在这里的主机当作datanode。

8.hadoop复制到其他host

把hadoop复制到所有datanode节点,此处是node1和node2。

命令如下:

当前目录 :/opt/bigdata

[root@master bigdata]# scp -r hadoop-3.0.0/ node1:/opt/bigdata

[root@master bigdata]# scp -r hadoop-3.0.0/ node2:/opt/bigdata

然后配置node1和node2的环境变量,方法如master一样。

下一篇:

2569

2569

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?