环境:

IDE:pycharm2019.1.3

python版本:3.7.3

spark版本:spark-2.4.4-bin-hadoop2.7

java版本:1.8

MySQL版本:MySQL Server 5.7

问题如下:

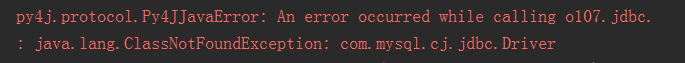

运行sparksql清洗数据后以DataFrame的形式通过jdbc连接存入数据库的相关代码时出现以下错误:

相关代码:

MysqlConfig.py

MYSQL_USER = "root"

MYSQL_PWD = "159357abc"

MYSQL_CONN = "jdbc:mysql://localhost:3306/city"

MYSQL_DRIVER = "com.mysql.cj.jdbc.Driver"

具体出错代码:

from compute import MysqlConfig

from pyspark import Row

from pyspark.sql import SparkSession

def GDP_Top_Ten_Handel():

def to_pair(item):

items = item.split("\t")

cityName = items[0]

try:

GDP = float(items[1])

except Exception as e:

GDP = 0

return cityName, GDP

spark = SparkSession \

.builder \

.appName("Python Spark SQL basic example") \

.config("spark.some.config.option", "some-value") \

.getOrCreate()

sc = spark.sparkContext

city_rdd = sc.textFile("F:/pycharm_workspace/CityBigData/stock_original_data/GDP.txt")

ten = city_rdd.map(lambda x: to_pair(x)).sortBy(lambda x: x[1], False).take(10)

ten_rdd = sc.parallelize(ten)

final_rdd = ten_rdd.map(lambda x: Row(cityName = x[0], GDP = x[1]))

schema = spark.createDataFrame(final_rdd)

conn_param = {}

conn_param['user'] = MysqlConfig.MYSQL_USER

conn_param['password'] = MysqlConfig.MYSQL_PWD

conn_param['driver'] = MysqlConfig.MYSQL_DRIVER

schema.write.jdbc(MysqlConfig.MYSQL_CONN, 'GDP_Top_Ten', 'overwrite', conn_param)

print("GDP_Top_Ten_Handel 执行完毕")

解决:

获取jar包 mysql-connector-java-8.0.19.jar

方式一:

从以下目录(MySQL的安装目录,以下为默认目录)

C:\Program Files (x86)\MySQL\Connector J 8.0

找到 mysql-connector-java-8.0.19.jar

方式一:

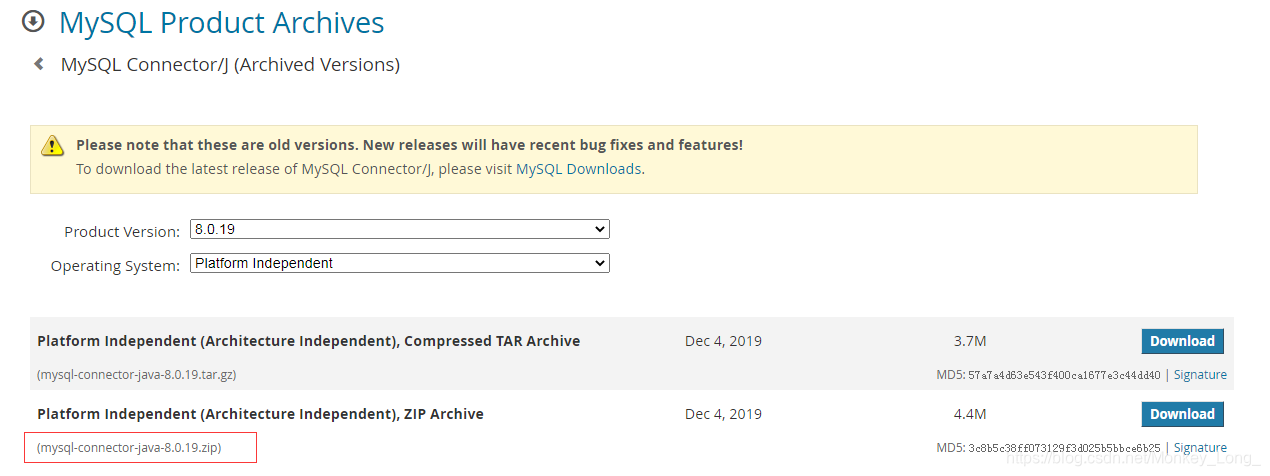

到 MySQL官网下载,注意选择操作系统对应文件

解压并复制其中的 mysql-connector-java-8.0.19.jar

获取到 mysql-connector-java-8.0.19.jar 这个文件后将其复制到spark安装目录下的jars目录(以下是我的目录)

E:\MySpark\spark-2.4.4-bin-hadoop2.7\jars

并在传入URL时添加 serverTimezone 这一参数,具体类似于下面代码:

url=jdbc:mysql://localhost:3306/test?serverTimezone=Shanghai&?useUnicode=true&characterEncoding=utf8&useSSL=false

重新运行,问题解决。

收获:

mysql5及之前的版本使用的是旧版驱动 “com.mysql.jdbc.Driver”

-------- 对应mysql-connector-java-5.*.jar

mysql6以及之后的版本需要更新到新版驱动,对应的Driver是"com.mysql.cj.jdbc.Driver"

-------- 对应mysql-connector-java-8.*.jar

后者需要指定serverTimezone,前者不需要

521

521

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?