Kafka特点

1.解耦:

允许你独⽴的扩展或修改两边的处理过程,只要确保它们遵守同样的接⼝约束。

2.冗余:

消息队列把数据进⾏持久化直到它们已经被完全处理,通过这⼀⽅式规避了数据丢失⻛险。许多消息队

列所采⽤的"插⼊-获取-删除"范式中,在把⼀个消息从队列中删除之前,需要你的处理系统明确的指出该消

息已经被处理完毕,从⽽确保你的数据被安全的保存直到你使⽤完毕。

3.扩展性:

因为消息队列解耦了你的处理过程,所以增⼤消息⼊队和处理的频率是很容易的,只要另外增加处理过程即可。

4.灵活性 & 峰值处理能⼒:

在访问量剧增的情况下,应⽤仍然需要继续发挥作⽤,但是这样的突发流量并不常⻅。如果为以能处理

这类峰值访问为标准来投⼊资源随时待命⽆疑是巨⼤的浪费。使⽤消息队列能够使关键组件顶住突发的访问

压⼒,⽽不会因为突发的超负荷的请求⽽完全崩溃。

5.可恢复性:

系统的⼀部分组件失效时,不会影响到整个系统。消息队列降低了进程间的耦合度,所以即使⼀个处理

消息的进程挂掉,加⼊队列中的消息仍然可以在系统恢复后被处理。

6.顺序保证:

在⼤多使⽤场景下,数据处理的顺序都很重要。⼤部分消息队列本来就是排序的,并且能保证数据会按

照特定的顺序来处理。(Kafka 保证⼀个 Partition 内的消息的有序性)

7.缓冲:

有助于控制和优化数据流经过系统的速度,解决⽣产消息和消费消息的处理速度不⼀致的情况。

8.异步通信:

很多时候,⽤户不想也不需要⽴即处理消息。消息队列提供了异步处理机制,允许⽤户把⼀个消息放⼊

队列,但并不⽴即处理它。想向队列中放⼊多少消息就放多少,然后在需要的时候再去处理它们。

相关概念

1)Producer :消息生产者,就是向kafka broker发消息的客户端;

2)Consumer :消息消费者,向kafka broker取消息的客户端;

3)Consumer Group (CG):消费者组,由多个consumer组成。消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个组内消费者消费;消费者组之间互不影响。所有的消费者都属于某个消费者组,即消费者组是逻辑上的一个订阅者。

4)Broker :一台kafka服务器就是一个broker。一个集群由多个broker组成。一个broker可以容纳多个topic。

5)Topic :可以理解为一个队列,生产者和消费者面向的都是一个topic;

6)Partition:为了实现扩展性,一个非常大的topic可以分布到多个broker(即服务器)上,一个topic可以分为多个partition,每个partition是一个有序的队列;

7)Replica:副本,为保证集群中的某个节点发生故障时,该节点上的partition数据不丢失,且kafka仍然能够继续工作,kafka提供了副本机制,一个topic的每个分区都有若干个副本,一个leader和若干个follower。

8)leader:每个分区多个副本的“主”,生产者发送数据的对象,以及消费者消费数据的对象都是leader。

9)follower:每个分区多个副本中的“从”,实时从leader中同步数据,保持和leader数据的同步。leader发生故障时,某个follower会成为新的follower。

安装

1,上传Kafka安装包并解压

2,修改配置⽂件

vi server.properties#指定broker的id

broker.id=1

#数据存储的⽬录

log.dirs=/data/kafka

#指定zk地址

zookeeper.connect=linux01:2181,linux01:2181,linux01:2181

3,拷贝到其他节点

4,修改其他节点Kafka的servier.properties中的broker.id

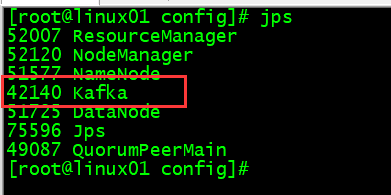

启动与常用命令

前提:必须先启动好zookeeper

启动:

/opt/app/kafka_2.12-2.4.1/bin/kafka-server-start.sh -daemon /opt/app/kafka_2.12-2.4.1/config/server.properties

创建Topic

/opt/app/kafka_2.12-2.4.1/bin/kafka-topics.sh --zookeeper linux01:2181 --create --topic wordcount --replication-factor 3 --partitions 3查看所有的Topic

/opt/app/kafka_2.12-2.4.1/bin/kafka-topics.sh --list --zookeeper localhost:2181 查看Topic详情

/opt/app/kafka_2.12-2.4.1/bin/kafka-topics.sh --zookeeper localhost:2181 --describe --topic wordcount命令行启动生产者

/opt/app/kafka_2.12-2.4.1/bin/kafka-console-producer.sh --broker-list linux01:9092,linux02:9092,linux03:9092 --topic wordcount命令行启动消费者:(--from-beginning 消费以前产⽣的所有数据,如果不加,就是消费消费者启动后产⽣的数据)

/opt/app/kafka_2.12-2.4.1/bin/kafka-console-consumer.sh --bootstrap-server linux01:9092,linux02:9092,linux03:9092 --topic wordcount --from-beginning删除Topic

/opt/app/kafka_2.12-2.4.1/bin/kafka-topics.sh --delete --topic wordcount --zookeeper localhost:2181动态查看topic偏移量

/opt/app/kafka_2.12-2.4.1/bin/kafka-console-consumer.sh --topic __consumer_offsets --bootstrap-server linux01:9092,linux02:9092,linux03:9092 --formatter "kafka.coordinator.group.GroupMetadataManager\$OffsetsMessageFormatter" --consumer.config /opt/app/kafka_2.12-2.4.1/config/consumer.properties --from-beginning新建消费者(命令行创建需要制定topic)

kafka-console-consumer --bootstrap-server linux01:9092,linux02:9092,linux03:9092 --consumer-property group.id=group_name --topic test消费指定分区指定offset消费

kafka-console-consumer --bootstrap-server 192.168.0.156:9092 --topic getCoupon_cdp_marketing --partition 0 --offset 148778 --max-messages 10

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?