1、准备工作

到 https://archive.cloudera.com/csa/1.0.0.0/下载相应的csd文件和parcels文件到本地

FLINK-1.9.0-csa1.0.0.0-cdh6.3.0-el7.parcel

FLINK-1.9.0-csa1.0.0.0-cdh6.3.0-el7.parcel.sha

manifest.json(可以直接替换,也可以先将原来的移走)

将上面三个放到/opt/cloudera/parcel-repo目录下

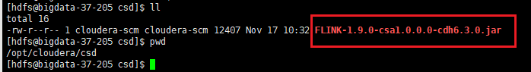

FLINK-1.9.0-csa1.0.0.0-cdh6.3.0.jar 放到/opt/cloudera/csd目录下

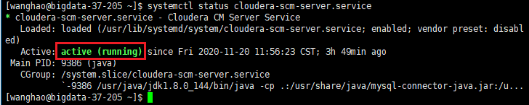

2、重启cm server

systemctl restart cloudera-scm-server确认重启ok,需要等待一会时间(可以查看启动日志是否ok,默认日志路径/var/log/cloudera-scm-server/cloudera-scm-server.log)

3、分配激活flink

主机->parcel 分配,激活

如果没有出现可能 需要修改一下上传的包的用户名和用户组

4、添加flink服务

5、选择主机

6、后面默认重启即可

7、测试Flink案例

创建一个word.txt文件上传到hadoop上,路径自己选择

执行

flink run -m yarn-cluster -yn 4 -yjm 1024 -ytm 1024 /opt/cloudera/parcels/FLINK/lib/flink/examples/streaming/WordCount.jar --input hdfs://bigdata-37-205:8020/tmp/flinktest/word.txt --output hdfs://bigdata-37-205:8020/tmp/result运行成功

8、测试报错

如果执行flink的测试案例报错如图,以为我将word.txtx上传到的他/tmp路径下,而/tmp的写全权限只有hdfs,所以可以使用hdfs用户执行,或者修改一下读写权限

1830

1830

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?