发表日期、所属会议/期刊/预印本:

arXiv 2014

做得什么:

本文提出了一种新的神经网络模型,即RNN Encoder-Decoder, 由两个神经网络(RNN)组成。一个RNN将一个符号序列(sequence of symbols)编码成一个固定长度的向量表示,另一个则将这个表示解码成另一个符号序列。该模型的编码器和解码器被联合训练,以最大化给定源序列的目标序列的条件概率。对学习语言短句的表达且其在语义上和句法上都是有意义的。

怎么做的(重点):

循环神经网络(RNN)是一个包含隐藏状态h和可变输出y的神经网络,其可操作于可变长度序列x =(x1,…,xT).。在每个时间步长t,f 是非线性激活函数,RNN的隐藏状态更新:

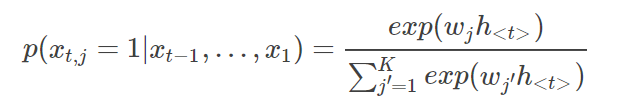

通过训练预测序列中的下一个symbol,RNN可以学习序列上的概率分布。在这种情况下,每个时间步长t的输出是条件分布 p(xt|xt−1,…,x1)。例如,对于所有 j=1,…,K,可以使用softmax激活功能输出多项式分布(1-K编码):

计算序列x的概率,每个时间步长迭代采样符号来直接抽样新序列:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

369

369

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?